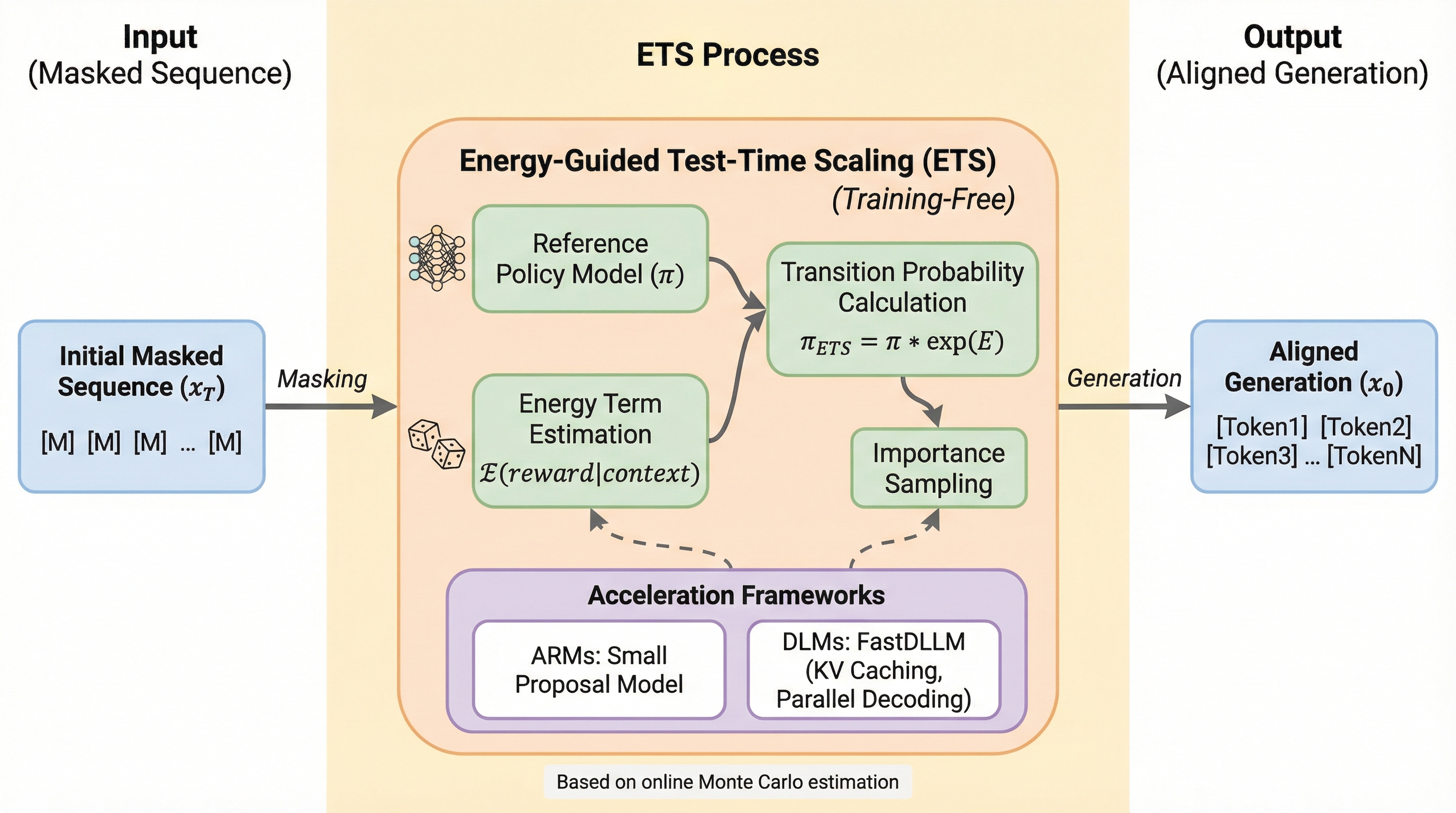

ETS: 強化学習アライメントを学習なしで実現するエネルギー誘導型テスト時スケーリング

言語モデルの強化学習(RL)による事後学習アライメントは、複雑なトレーニングプロセスや高コストな報酬モデリング、不安定な学習動態といった課題を抱えていますが、本研究では追加の学習を一切行わずに推論時に最適なRLポリシーから直接サンプリングを行う手法「Energy-Guided Test-Time Scaling(ETS)」を提案しています。 ETSは、マスク言語モデリング(MLM)の枠組みにおいて遷移確率をリファレンスポリシーとエネルギー項に分解し、オンラインモンテカルロ法を用いてこのエネルギー項を推定することで、学習なしでのアライメントを実現し、推論時の計算量を増やすことで生成品質を向上させる新しいテスト時スケーリングの形態を提示しています。 実用的な効率を確保するために、重点サンプリングと軽量なプロポーザルモデルを組み合わせた加速戦略を導入しており、理論的な収束性を保証しながら推論の遅延を大幅に削減し、推論やコーディングなどのベンチマークにおいて従来の学習ベースのRL手法を凌駕する性能を一貫して達成していることが確認されました。