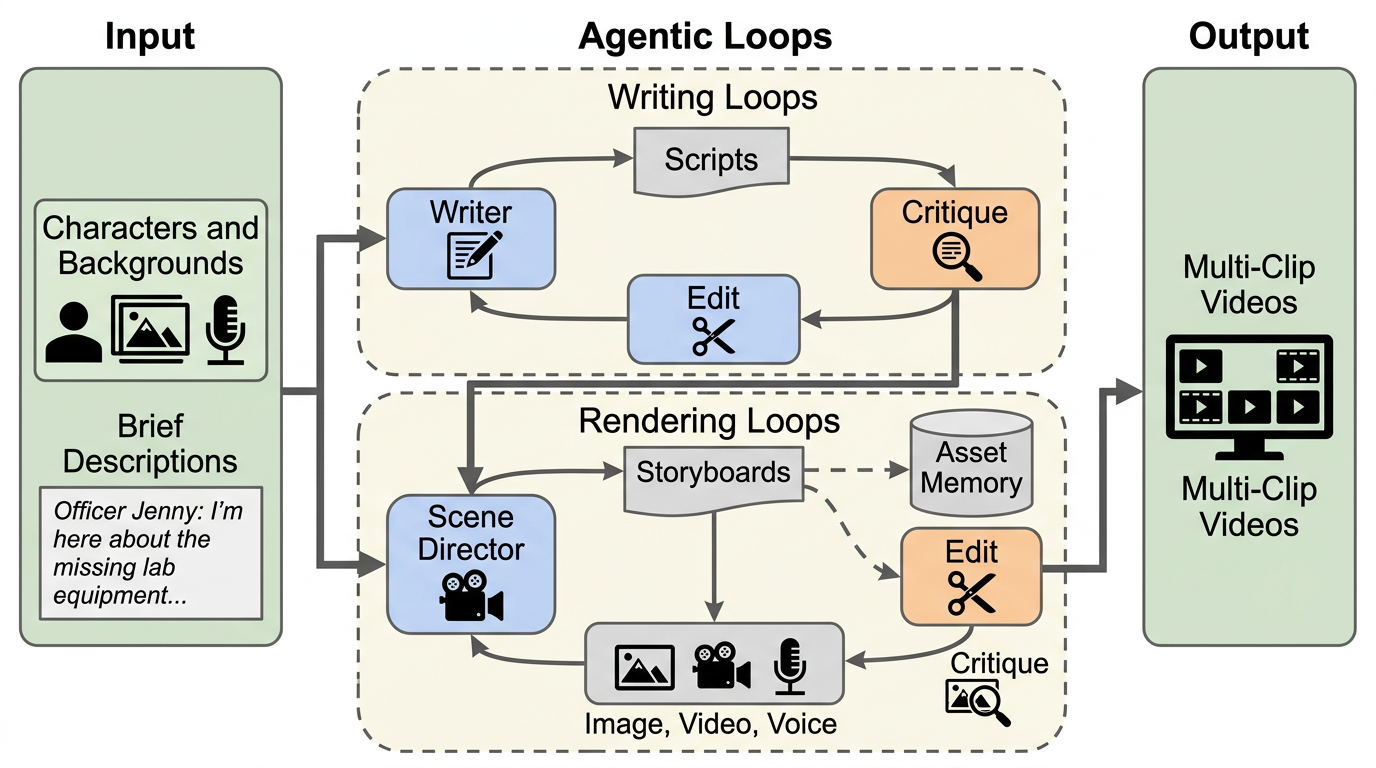

COMIC:エージェントでスケッチコメディ動画を自動生成する

COMIC は、キャラクター画像・音声・短い説明から、サタデー・ナイト・ライブ風の短いスケッチコメディ動画を全自動で作るエージェント型動画生成システムです。 企画、脚本、批評、編集、演出、レンダリング批評を複数エージェントに分け、しかも YouTube 上の視聴者エンゲージメントに合わせて批評家を選抜することで、「人が笑うか」に寄せた反復改善ループを作っています。 実験では agentic baseline や生の frontier video model を上回り、プロ制作スケッチに近い品質まで迫ったとされ、ユーモアのような主観タスクでも批評家の設計が性能を大きく左右することを示しました。