エージェント的スキル進化によるメタコンテキストエンジニアリング

大規模言語モデル(LLM)の推論性能を最大化するため、文脈(コンテキスト)の構成方法そのものをAIエージェントに自律進化させる二段階の最適化フレームワーク「Meta Context Engineering(MCE)」が提案されました。

TL;DR(結論)

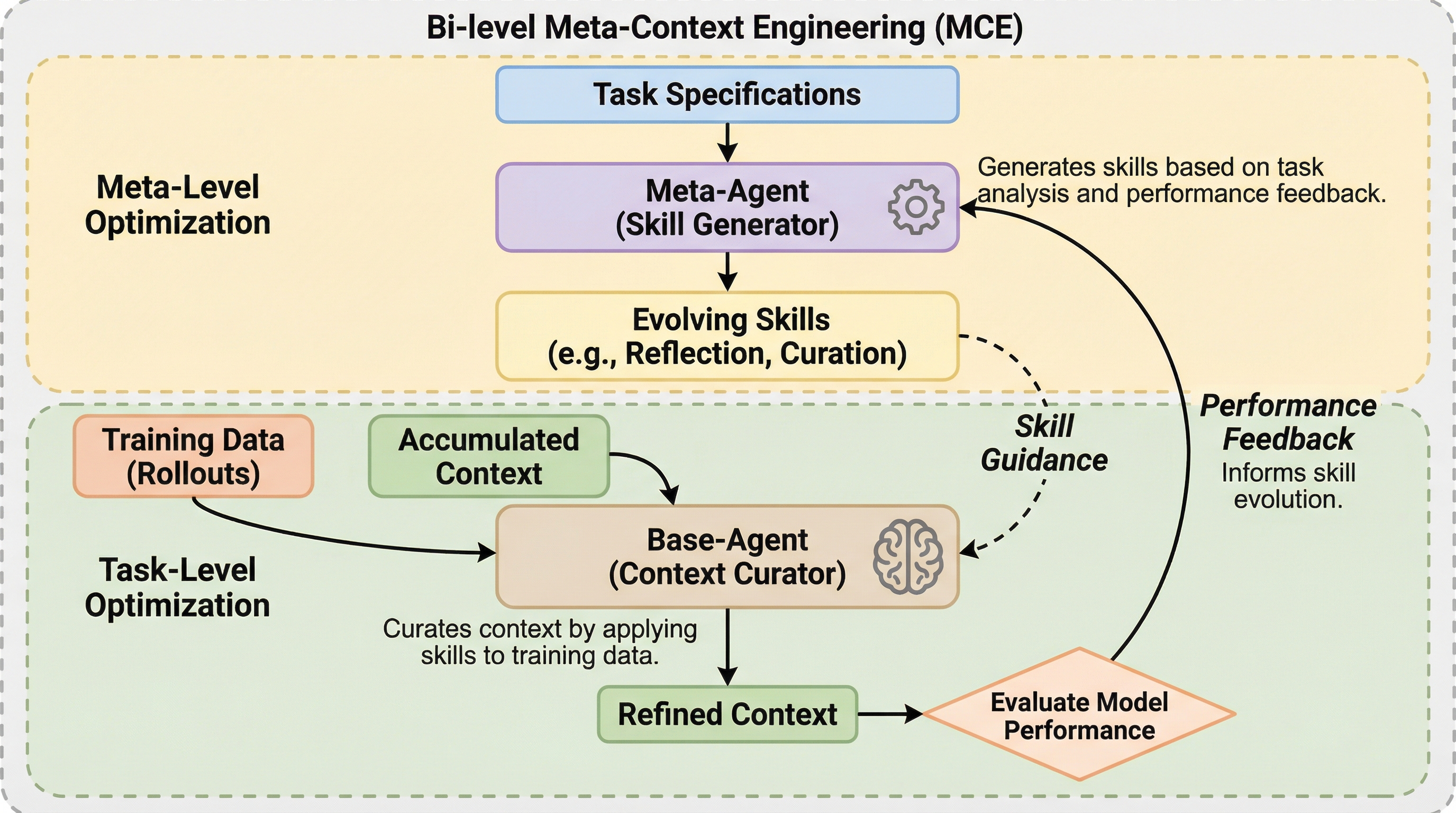

大規模言語モデル(LLM)の推論性能を最大化するため、文脈(コンテキスト)の構成方法そのものをAIエージェントに自律進化させる二段階の最適化フレームワーク「Meta Context Engineering(MCE)」が提案されました。これは従来の手動設計による固定的なワークフローや構造的バイアスの限界を打破し、タスクごとに最適な推論環境を自動構築するものです。 メタレベルのエージェントが過去の成功・失敗履歴から「文脈構成スキル」を生成し、ベースレベルのエージェントがそのスキルを実行してファイルやコードの形で最適な文脈を構築することで、スキルの進化と成果物の最適化を同時に実現する「共進化」の仕組みを導入しました。これにより、人間が設計したヒューリスティックを超える柔軟な適応が可能になります。 金融、化学、医療、法律、AI安全性の5つの専門ドメインでの検証において、既存の最先端手法を平均16.9%上回る性能向上を達成しました。さらに、学習速度の13.6倍への加速や、タスクに応じた柔軟な文脈適応能力(1.5Kから86Kトークン)、モデル間での高い転送効率を実証し、モデルの重みを更新せずに専門能力を引き出す新たな道を切り拓きました。

なぜこの問題か

大規模言語モデル(LLM)の運用効率と性能は、推論時に与えられる文脈(コンテキスト)の質に決定的に左右されます。このため、入力を最適化してモデルの潜在能力を最大限に引き出す「コンテキスト・エンジニアリング(CE)」という分野が、重要な技術規律として確立されました。LLMのパラメータを直接更新するファインチューニングなどの手法と比較して、文脈の最適化にはいくつかの明確な利点があります。第一に、経験を不透明な重みではなく自然言語でエンコードするため、人間にとっての解釈可能性が極めて高いことです。第二に、高コストなモデル更新を必要とせず、迅速な展開が可能であるという効率性です。第三に、確立された文脈を組み合わせて転送できるモジュール性、そしてモデルの重みから能力獲得を切り離すことで、新しい知識の習得時に古い知識を失う「破滅的忘却」を回避できる堅牢性が挙げられます。 しかし、現在のCE手法は、人間が手作業で作成した「エージェント的ハーネス(枠組み)」に根本的に制約されています。…

核心:何を提案したのか

本研究では、静的なヒューリスティックに基づく従来のコンテキスト・エンジニアリングを刷新するため、CEスキルとコンテキスト成果物を共に進化させる二段階フレームワーク「Meta Context Engineering(MCE)」を提案しました。MCEの核心は、コンテキストを「どのように表現し、どのように最適化するか」というエンジニアリング戦略(スキル)と、その結果として得られる「どのような内容を文脈に含めるか」という成果物(アーティファクト)を分離し、両者を階層的に最適化する…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related