言語の共起統計にある「平行移動対称性」が、モデル表現の幾何を形づくる

大規模言語モデルの内部表現で、月が円環状に並ぶ、年が滑らかな一次元のまとまりになる、都市の緯度経度が線形な読み出しで復号できるといった幾何学的構造が現れる理由を、学習データ側の二語共起統計から説明する枠組みが示されています。

TL;DR(結論)

- 大規模言語モデルの内部表現で、月が円環状に並ぶ、年が滑らかな一次元のまとまりになる、都市の緯度経度が線形な読み出しで復号できるといった幾何学的構造が現れる理由を、学習データ側の二語共起統計から説明する枠組みが示されています。

- 連続的な概念に属する語どうしでは、共起確率が「概念空間上の距離」だけでほぼ決まるという平行移動対称性が成り立ちうるとし、そのとき正規化した共起行列の上位固有モードが正弦・余弦のようなフーリエ型の成分になって埋め込み幾何が決まることを理論的に導いています。

- 月が同時に出る文を除去するような強い摂動を共起統計に加えても構造が残る現象を、連続な潜在変数が語彙全体の共起を集合的に制御するためだと説明し、単語埋め込み・テキスト埋め込み・大規模言語モデル内部表現で経験的に確かめています。

なぜこの問題か

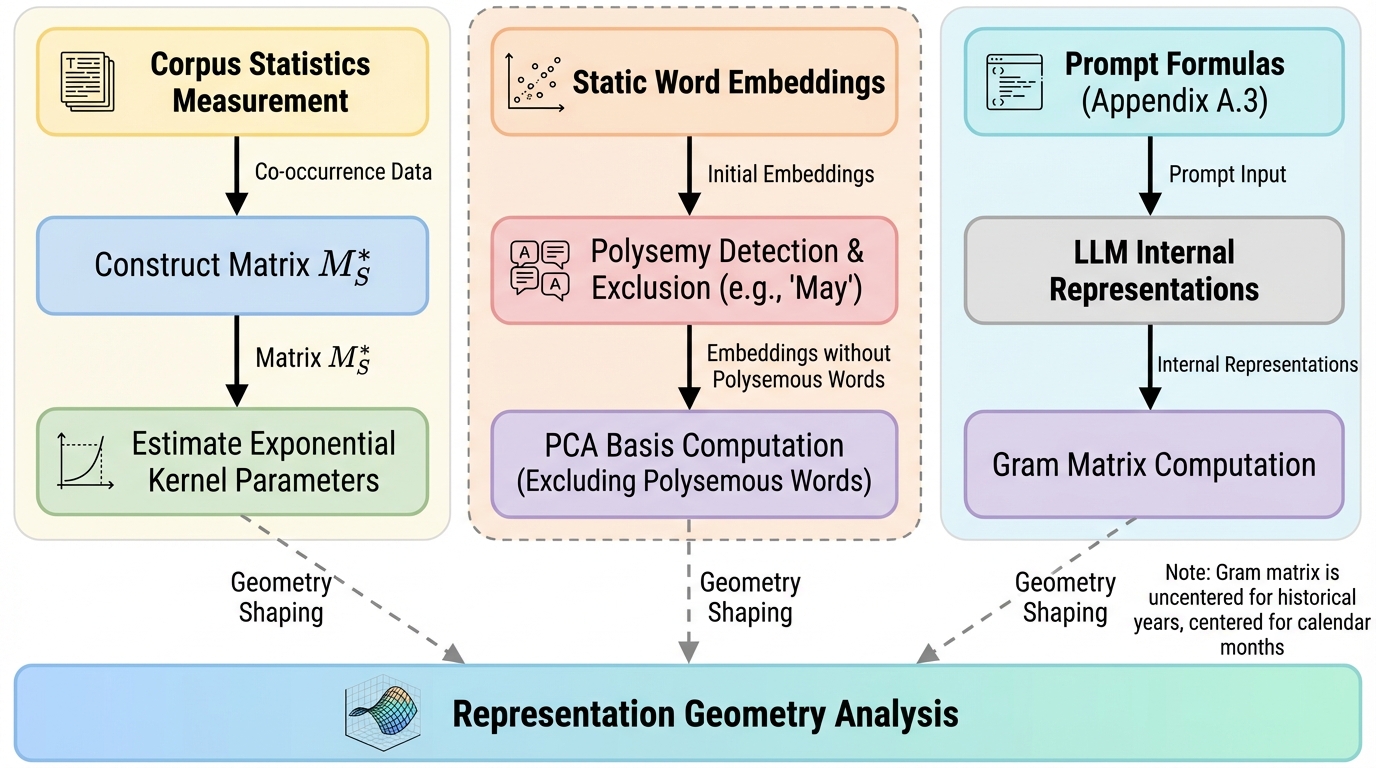

ニューラルネットワークの性能は、学習で得られる表現に強く依存しますが、その表現がどのような原理で形づくられるかは十分に整理されていないと論文は述べています。とりわけ目を引くのが、大規模言語モデルの表現空間に「単純な幾何」が自発的に現れる観察です。例として、暦の月が円のように配置される、歴史年が滑らかな一次元の多様体として並ぶ、都市の緯度・経度が線形プローブで復号できる、という現象が挙げられています。さらに、先行研究ではプリズム、ループ、連続一次元多様体など多様な形が報告され、モデルのアーキテクチャやタスクが違っても繰り返し現れる点が強調されています。こうした普遍性がある一方で、なぜそのような幾何が生じるのかを一つの見取り図で説明する「整理原理」が欠けていることが問題になります。モデル内部の計算や学習則だけに注目すると、観察の種類が増えるほど説明が個別対応になりやすいです。そこで本研究は視点を変え、学習データである自然言語の低次統計、特に二語共起という最も基本的な統計に立ち戻ります。…

核心:何を提案したのか

本論文の中心提案は、表現の幾何は語と語のペア共起統計を反映する、という整理原理です。とくに重要な鍵として、連続的な概念(暦、歴史、地理など)に沿った語集合では、共起確率が「概念上の位置の差」ではなく「距離」だけでほぼ決まるという平行移動対称性(翻訳対称性)が現れると主張します。例として、二つの月の共起確率が月どうしの時間間隔のみに依存する、という形が挙げられています。この対称性が成り立つとき、高次元の単語埋め込みモデルにおいて、月が円、年が一次元の滑らかな構造、地理が座標として線形に読み出せる、といった現象が導かれるとされています。さらに論文は、共起統計を強く乱す操作をしても幾何構造が残りうることを扱います。具体例として、二つの月が同時に現れる文をすべて取り除くような摂動を加えても構造が持続し、埋め込み次元が中程度でも残る、という観察が述べられています。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related