連続制御におけるANNからSNNへの変換を阻む「誤差増幅」の壁

学習済みANNをSNNへ変換する手法は、連続制御タスクにおいて性能が著しく低下するが、その主因が微小な行動誤差の累積による「状態分布の乖離」と、誤差が時間的に正の相関を持つ「誤差増幅」にあることを突き止めた。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

学習済みANNをSNNへ変換する手法は、連続制御タスクにおいて性能が著しく低下するが、その主因が微小な行動誤差の累積による「状態分布の乖離」と、誤差が時間的に正の相関を持つ「誤差増幅」にあることを突き止めた。

本研究は、実世界の3Dアノテーションを一切必要とせず、完全に合成データのみで学習を行うことで、単一の画像から船舶の3Dモデルを再構成する効率的なパイプラインを提案しています。 3Dガウス表現を用いるSplatter Imageネットワークを基盤とし、ShapeNetの船舶データと独自に作成した高精度な合成船舶データセットの2段階でファインチューニングを行うことで、合成データと実データのドメインギャップを克服しています。 YOLOv8によるセグメンテーション、AISメタデータを用いた実寸スケーリング、地理参照によるWebマップ上への配置を統合しており、港湾監視や船舶の寸法検証などの実用的な海洋状況把握を支援するシステムとして機能します。

大規模言語モデル(LLM)の学習において、計算結果の再現性を保証する決定論的アテンションは不可欠だが、従来のFlashAttention-3等では勾配蓄積の直列化によりスループットが最大37.9%低下する課題があった。

ビジネスプロセスモデリング(BPMN)における大規模言語モデル(LLM)の能力を客観的に評価するため、39個の指標を用いた新しい評価フレームワーク「BEF4LLM」が開発されました。17種類のオープンソースLLMを対象とした大規模なベンチマーク調査により、LLMは構文や実用性の面で優れた成果を出す一方で、意味論的な正確性や有効なXML形式の生成には依然として課題があることが判明しました。特に、モデルの規模が必ずしもモデリング品質の向上に直結しないという結果は、今後のLLMの選択や特定のタスクに向けた微調整において、パラメータ数以外の要素を重視すべきであることを示唆しており、LLMが専門家と同等のモデルを作成できる可能性を示しつつ、実用化に向けた具体的な改善点を明確にしました。

ECSELは、物理法則に多く見られる「シグノミアル方程式」という数式形式を学習モデルに採用することで、高い予測精度と人間が直接読み解ける透明性を両立した新しい分類手法である。 従来の記号回帰手法が抱えていた膨大な計算コストという課題を、勾配ベースの最適化とL1正則化を組み合わせることで解決し、既存の最先端手法を上回る数式復元率と劇的な計算時間の短縮を達成した。 学習された数式からは、特徴量の変化が予測に与える影響を弾力性や反実仮想推論といった数学的指標で直接算出でき、不正検知や電子商取引などの実務において根拠に基づいた意思決定を強力に支援する。

大規模言語モデルを身体化エージェントとして活用する際、長期的な計画立案において文脈の逸脱や物理的制約を無視した幻覚が生じるという課題に対し、二層のグラフ構造を用いた記憶アーキテクチャ「GiG(Graph-in-Graph)」を提案しました。

暗号化トラフィックの急増に伴い、従来のTransformerモデルでは計算コストの増大やデータの不均衡、表現力の不足が課題となっていたが、本研究では線形時間計算量を持つMambaアーキテクチャとFlash Attentionを統合した「NetMamba+」を提案し、効率性と精度の両立を実現した。

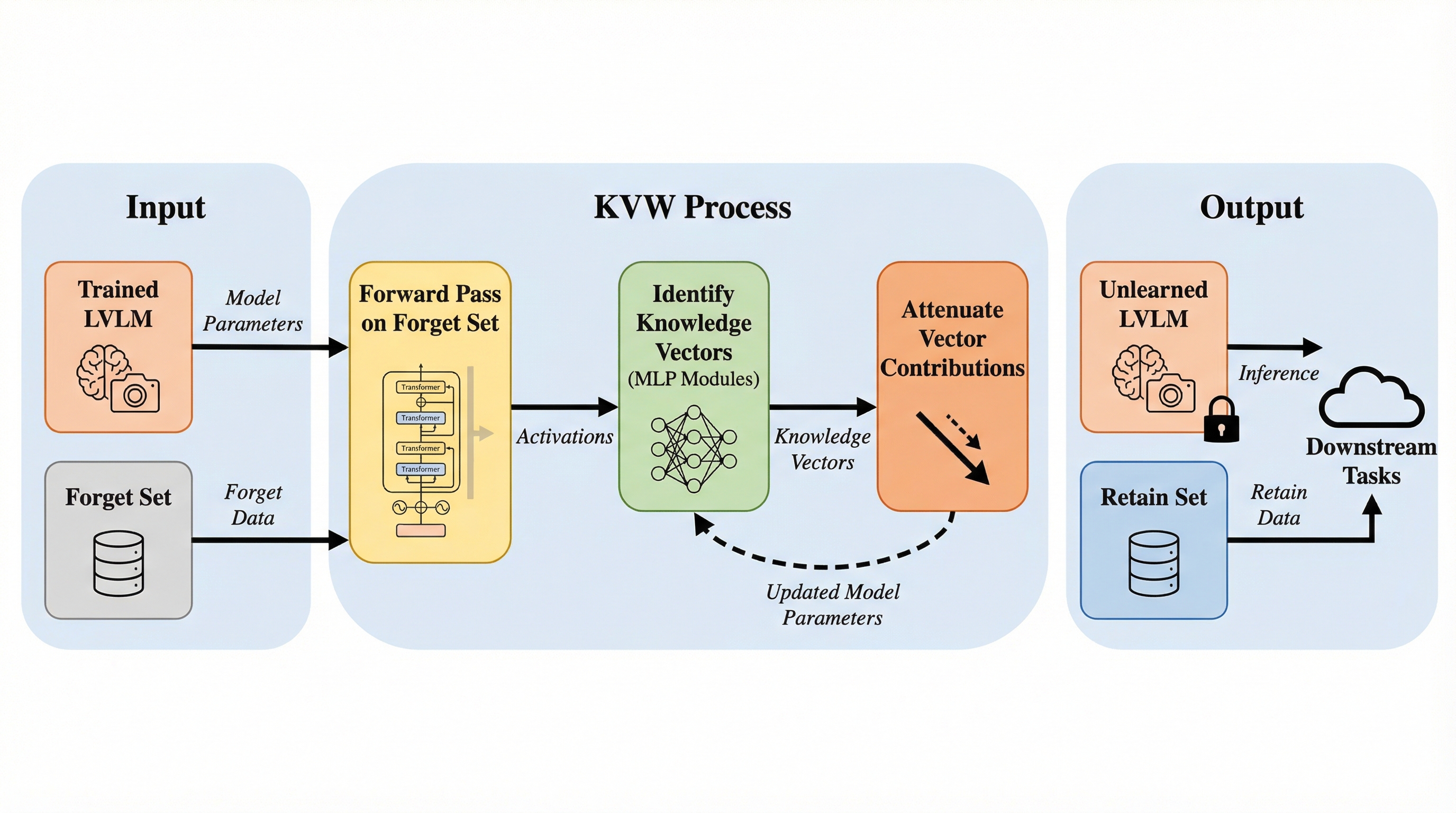

大規模視覚言語モデル(LVLM)において、プライバシー侵害や有害情報の生成を防ぐために特定の学習データの影響を取り除く「アンラーニング」を、勾配計算や再学習を一切行わず、推論時の順伝播のみで実現する新手法「Knowledge Vector Weakening(KVW)」が提案されました。

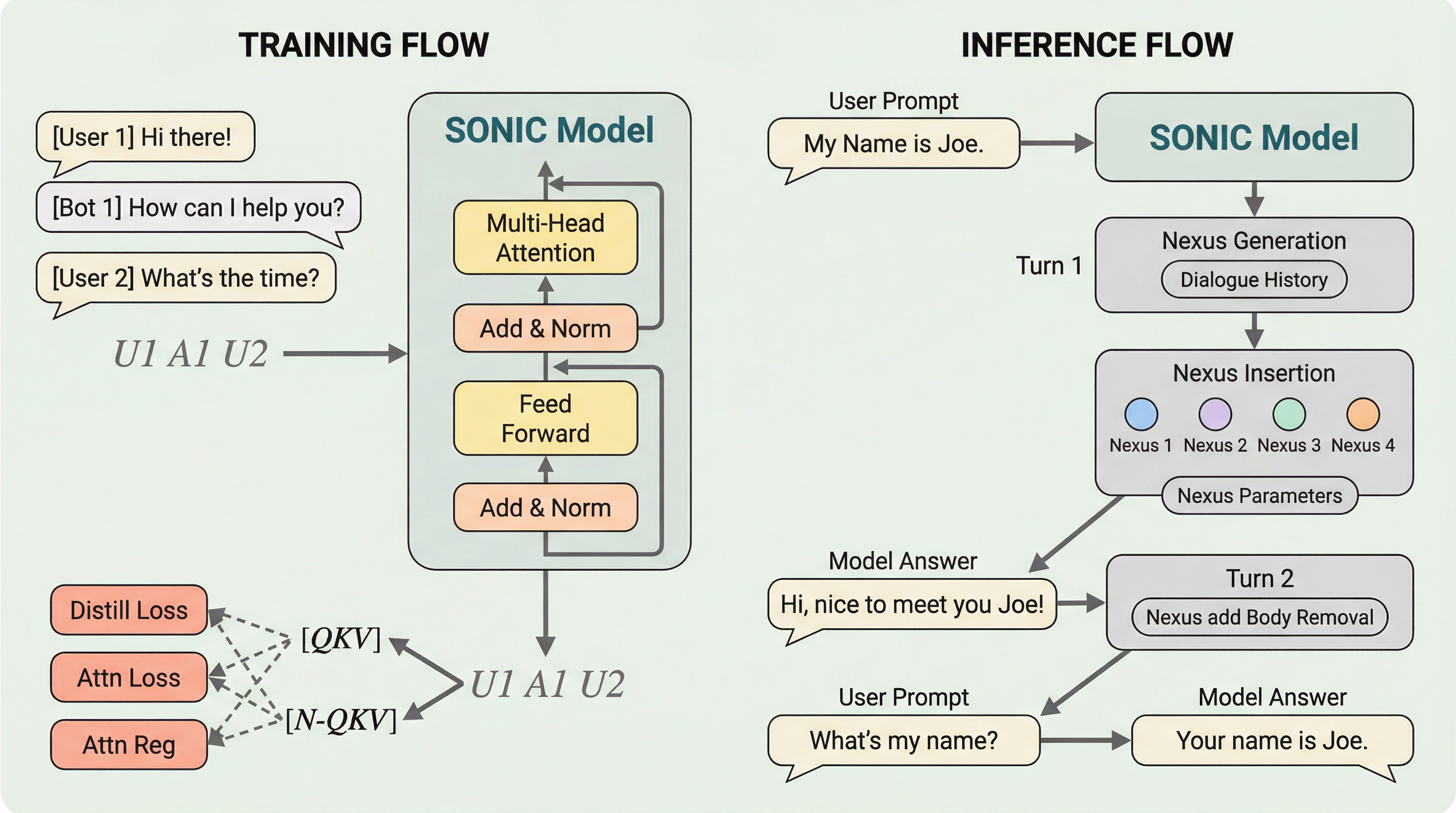

大規模言語モデルのマルチターン対話において、履歴の増加に伴い線形に肥大化するKVキャッシュのメモリ問題を解決するため、履歴セグメントを「Nexus」と呼ばれる少数の学習可能なトークンに集約して圧縮する新しいフレームワーク「SONIC」が提案されました。

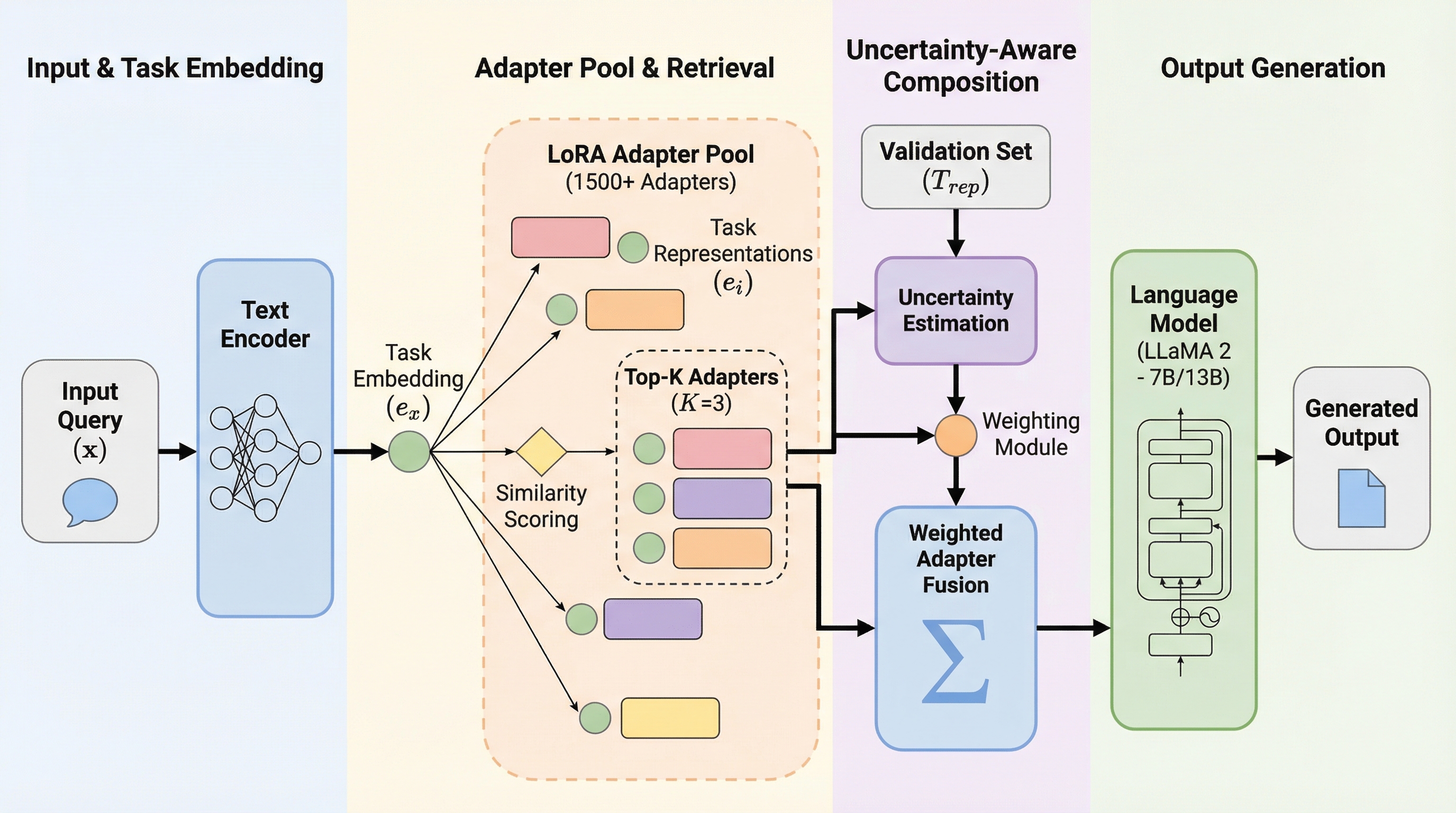

大規模言語モデルの効率的な専門化を実現するLoRAアダプターの膨大なプールから、入力クエリに最適なものを選択・統合する新しいルーティング枠組み「LORAUTER」が提案されました。 従来手法とは異なり、アダプターそのものの特性ではなく「タスク表現」を介してルーティングを行うことで、アダプターの学習データにアクセスできないブラックボックス設定でも動作し、タスク数に応じた高い拡張性を実現しています。 検証では、既存のタスクに最適化されたアダプターと同等以上の性能(101.2%)を達成したほか、未知のタスクに対しても従来手法を5.2ポイント上回る精度を示し、1500個以上のアダプターを含む大規模でノイズの多い環境でも堅牢に機能することが確認されました。