大規模言語モデルを用いたグラフ情報に基づく行動生成による身体化されたタスク計画

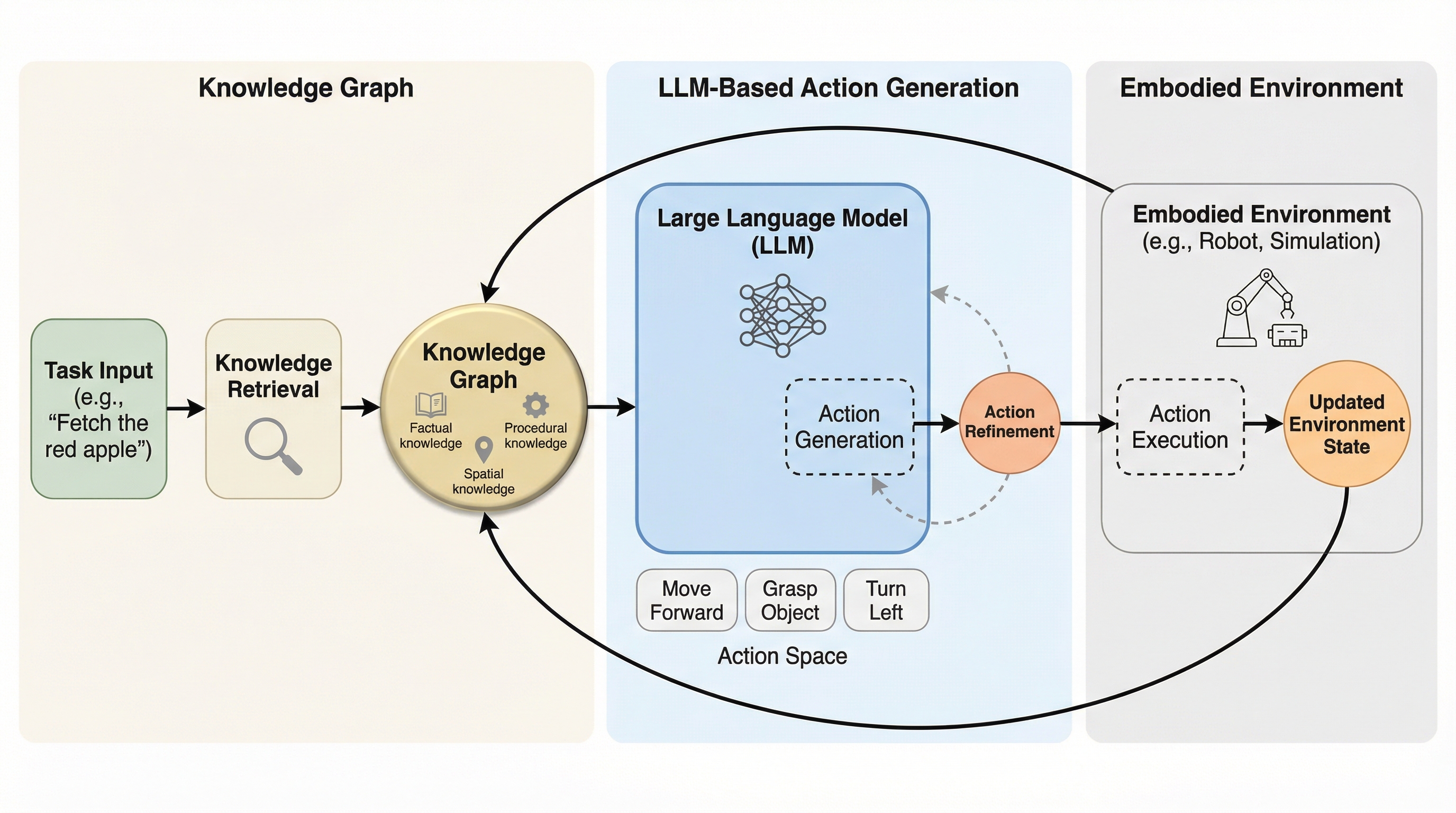

大規模言語モデルを身体化エージェントとして活用する際、長期的な計画立案において文脈の逸脱や物理的制約を無視した幻覚が生じるという課題に対し、二層のグラフ構造を用いた記憶アーキテクチャ「GiG(Graph-in-Graph)」を提案しました。

TL;DR(結論)

大規模言語モデルを身体化エージェントとして活用する際、長期的な計画立案において文脈の逸脱や物理的制約を無視した幻覚が生じるという課題に対し、二層のグラフ構造を用いた記憶アーキテクチャ「GiG(Graph-in-Graph)」を提案しました。 この手法は、環境の状態をグラフニューラルネットワーク(GNN)でエンコードして経験メモリに蓄積し、現在の状況と構造的に類似した過去の成功事例を検索して計画の指針とすることで、複雑なタスクの実行精度を大幅に向上させます。 検証の結果、RobotouilleやALFWorldといったベンチマークにおいて、従来手法を最大37%上回る成功率を達成し、計算コストを抑えつつ並列的なサブタスクの処理や長期的な戦略の一貫性を維持できることが確認されました。

なぜこの問題か

大規模言語モデル(LLM)は、ゼロショット推論において優れた能力を示していますが、物理的な環境で活動する身体化エージェントとして展開する場合、長期的な計画立案(ロングホライズン・プランニング)において根本的な困難に直面します。テキスト生成のような自由度の高いタスクとは異なり、身体化エージェントは高レベルの意図を具体的な行動可能なサブゴールに分解し、動的に変化する環境の論理に厳密に従わなければなりません。標準的なLLMプランナーは、対話履歴が長くなるにつれて文脈ウィンドウの制限により「コンテキスト・ドリフト」を引き起こし、高レベルの目標を見失ったり、同じ行動を繰り返したりする傾向があります。また、環境の制約を無視した遷移を「幻覚」として生成してしまい、実行不可能な計画を立ててしまうことも少なくありません。 既存の解決策として、行動と観察を交互に行う手法や、タスクを木構造で分解する手法が提案されていますが、これらにも構造的な限界が存在します。例えば、木構造による分解では、あるサブタスクが完了するまで他のサブタスクがブロックされる「兄弟ノードのブロック」制約が生じます。…

核心:何を提案したのか

本論文では、身体化エージェントの記憶を構造化するための新しいフレームワーク「GiG(Graph-in-Graph)」を提案しています。このフレームワークの核心は、二層のトポロジカルなメモリ構造にあります。第一の層は「シーングラフ(内部グラフ)」であり、特定の時点における環境内のエンティティ間の空間的な関係(例:チーズがテーブルの上にある、トマトが未切断である等)をキャプチャします。第二の層は「状態遷移グラフ(外部グラフ)」であり、タスクの進行状況を追跡し、エージェントの探索軌跡を記録することで、循環的な失敗(ループ)の検出を可能にします。 GiGは、軽量なグラフニューラルネットワーク(GNN)を用いてシーングラフを構造認識的な埋め込みベクトルに変換し、これらを経験メモリバンクに保存します。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related