双曲空間における階層情報を活用した話者照合のためのHAM-Softmax

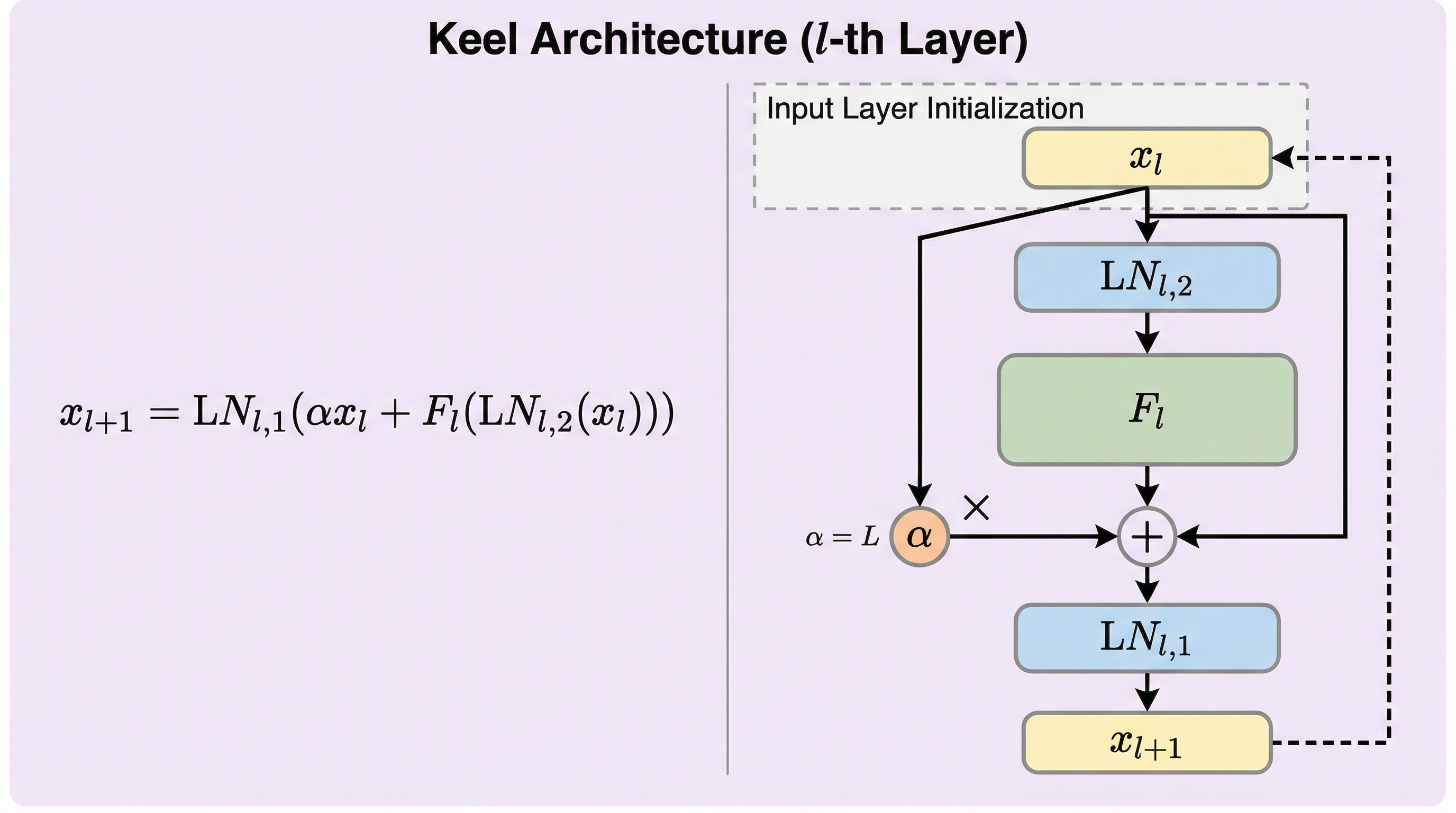

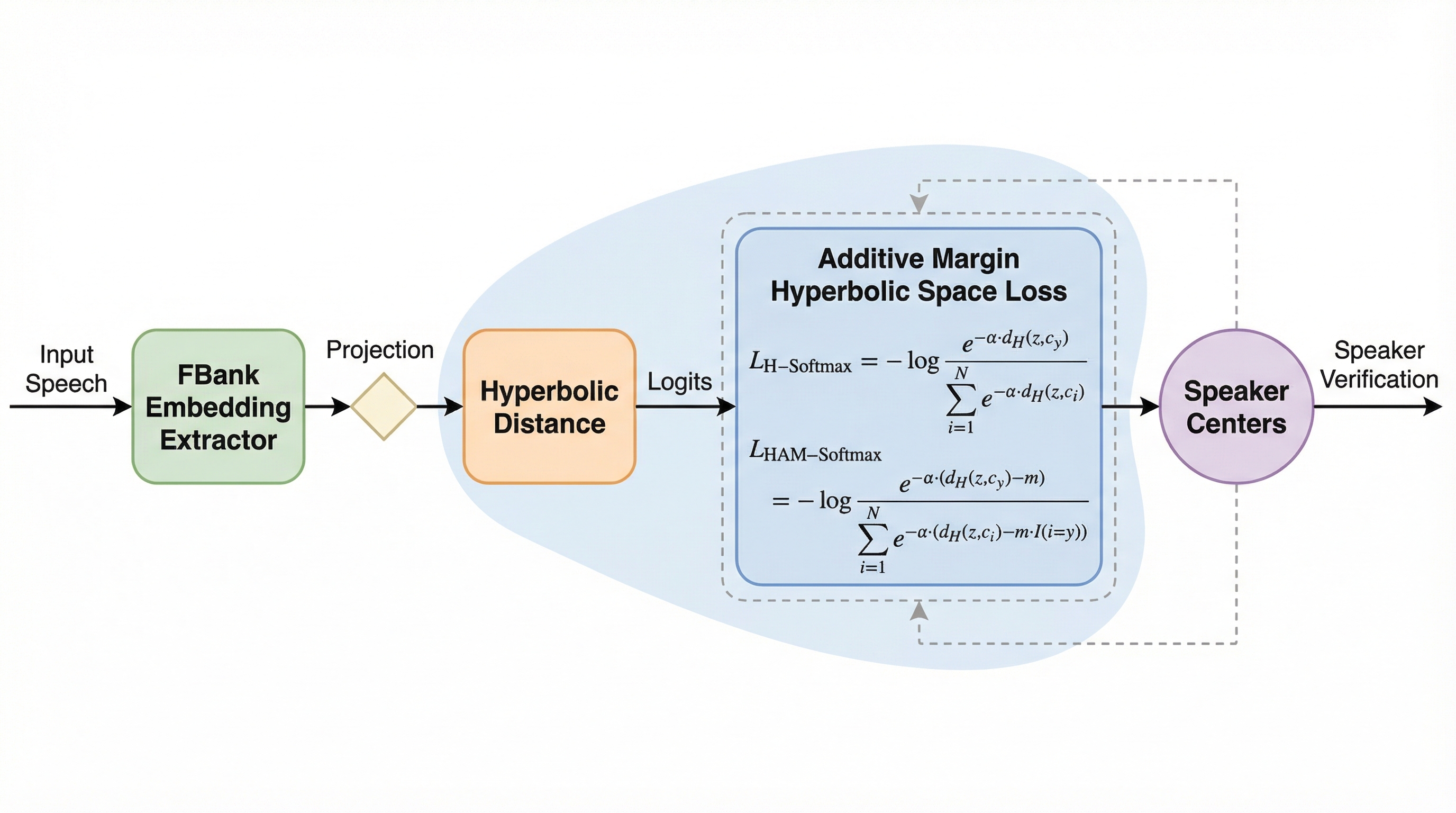

従来の話者照合はユークリッド空間での学習が主流であったが、基本周波数やフォルマント構造といった話者特徴が持つ木構造のような階層的な情報を十分に表現できないという課題があった。本研究では、負の曲率を持ち有限の体積内で指数関数的なデータ配置が可能な双曲空間(ポアンカレ球モデル)を導入し、階層構造を効率的にモデル化するH-Softmaxと、クラス間の分離性を高めるマージン制約を加えたHAM-Softmaxを提案した。実験の結果、VoxCelebやCNCeleb等のデータセットにおいて、従来のSoftmaxやAM-Softmaxと比較して等価誤り率(EER)を大幅に削減することに成功し、特に複雑なクロスドメインデータにおいて高い性能と階層情報の保持能力を示した。