勾配ベースの重要度推定によるニューラルネットワークコントローラのためのコンポーネントを考慮したプルーニングフレームワーク

従来のニューラルネットワーク制御器の圧縮手法は、重みの絶対値に基づく静的な指標に依存しており、複数のコンポーネント間の複雑な依存関係や機能的な重要性を十分に考慮できていないため、過酷な圧縮条件下で制御性能や安定性が著しく低下するという課題がありました。

TL;DR(結論)

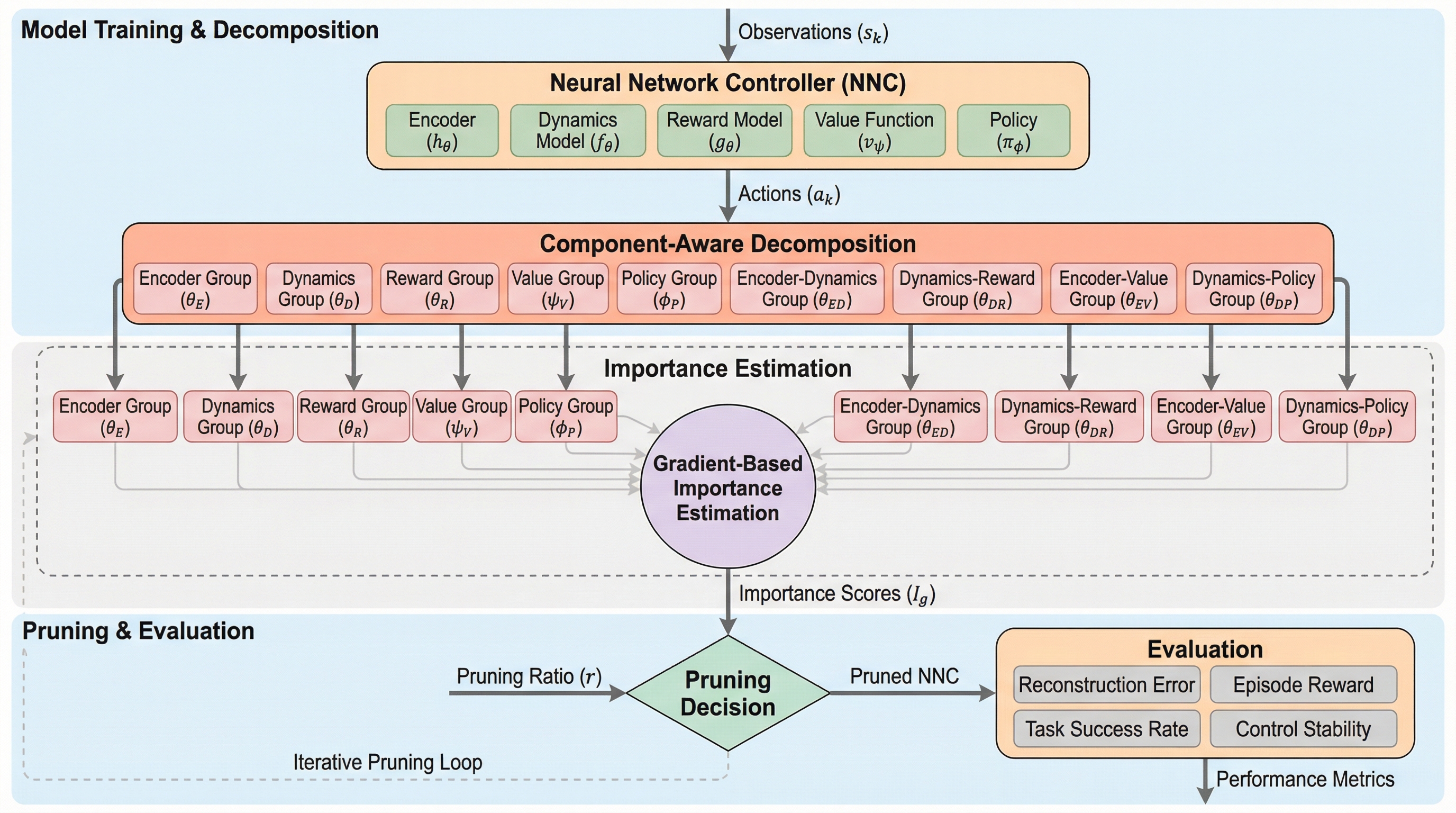

従来のニューラルネットワーク制御器の圧縮手法は、重みの絶対値に基づく静的な指標に依存しており、複数のコンポーネント間の複雑な依存関係や機能的な重要性を十分に考慮できていないため、過酷な圧縮条件下で制御性能や安定性が著しく低下するという課題がありました。 本研究は、学習中の勾配情報を活用して「勾配累積」「フィッシャー情報」「ベイズ的不確実性」という3つの動的指標を算出する、コンポーネントを意識した新しい構造化剪定フレームワークを提案し、各パラメータグループがタスク損失に与える影響をオンラインで正確に評価することを可能にしました。 オートエンコーダとTD-MPCを用いた実験により、結合グループや初期層が常に重要であるという従来の定説を覆し、重要度はアーキテクチャの制約や学習段階に応じて動的に変化することを明らかにし、この知見に基づく剪定が高度な制御性能の維持に寄与することを示しました。

なぜこの問題か

現代のニューラルネットワーク制御器(NNC)は、環境理解や高度な意思決定を実現するために、単一の巨大な構造から、複数の専門化されたコンポーネントを組み合わせた多成分アーキテクチャへと移行しています。しかし、これらの高度なモデルは計算複雑性が非常に高く、リソースが厳しく制限された実世界の組み込みシステムに実装する際には大きな障壁となります。このギャップを埋めるためには効果的なモデル圧縮が不可欠ですが、従来の剪定手法にはいくつかの根本的な問題が存在していました。 まず、多くの既存手法はネットワークを分割不可能な単一の構成体として扱い、コンポーネント間の固有の依存関係を無視する傾向があります。特に、重みのノルム(大きさ)に基づいて重要度を推定する一般的な構造化剪定では、パラメータの数値的な大きさが必ずしもその機能的な重要性と一致しないため、制御システムの安定性や性能を維持するために不可欠な接続を誤って削除してしまうリスクがあります。また、従来のルールベースのヒューリスティックな手法は静的であり、学習の進展に伴って変化するパラメータの役割を捉えることができません。…

核心:何を提案したのか

本研究の核心は、ニューラルネットワークの学習過程で得られる勾配情報を直接利用して、各パラメータグループの重要度を動的に推定する「コンポーネントを意識した剪定フレームワーク」を提案した点にあります。このフレームワークは、単一の指標に頼るのではなく、相補的な性質を持つ3つの異なる勾配ベースの指標を導入することで、グループの機能的な寄与を多角的に評価します。 具体的には、モデルの即時的な感度を示す「勾配マグニチュード累積」、損失曲面の曲率を捉える「フィッシャー情報」、そして長期的な学習活動を統計的にモデル化する「ベイズ的不確実性」の3つを算出します。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related