LVLMと人間における参照的コミュニケーションの基盤化(グラウンディング)の違い

生成AIエージェントが人間と効果的に協力するには意図の予測が不可欠ですが、現在の大型視覚言語モデル(LVLM)は「共通基盤(コモングラウンド)」を構築する能力が欠如していることが明らかになりました。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

生成AIエージェントが人間と効果的に協力するには意図の予測が不可欠ですが、現在の大型視覚言語モデル(LVLM)は「共通基盤(コモングラウンド)」を構築する能力が欠如していることが明らかになりました。

本研究は、外部報酬のない環境でエージェントが自律的に目標を設定し、効率的な探索と適応能力を習得するための教師なしメタ学習フレームワーク「ULEE」を提案しました。 従来の「現在の達成しやすさ」に基づくカリキュラムとは異なり、ULEEは「一定期間の適応後に達成可能な性能」を予測し、能力の境界にある適切な難易度の目標を敵対的に生成する仕組みを導入しています。 検証の結果、ULEEで事前学習されたエージェントは、未知の目的や環境構造、動特性に対しても優れた適応能力を示し、従来の学習手法を大幅に上回る汎用性を実証しました。

人間が書いた10億トークンの著作物と、21種類の言語モデルから生成された19億トークンのテキストを組み合わせた、合計29億トークンに及ぶ大規模なコーパスを構築し、AI生成テキストを識別するための新しい学習手法を提案した。

多言語大規模言語モデルが直面する「回答は正しいが出力言語を誤る」という言語一貫性の欠如と、「言語は正しいがタスクに失敗する」という多言語転送の停滞という二つの主要なボトルネックを特定し、モデル内部の層が「初期の意味整合」「中間のタスク推論」「終盤の言語制御」という明確な三段階の機能構造を持つことを解明しました。

大規模言語モデル(LLM)が不完全な情報の下で計画を立てる際、欠落した事実を捏造したり制約に違反したりする問題を解決するため、自己質問型双方向圏論的計画法(SQ-BCP)が提案されました。 この手法は、前提条件の状態を「充足」「違反」「不明」として明示的に管理し、不明な点については外部への質問や「ブリッジ」アクションによって解決を図ることで、計画の実行可能性を確保します。 実験では、WikiHowやRecipeNLGのタスクにおいて、既存手法と比較してリソース違反率を大幅に低減しつつ、高い計画の質を維持することに成功しており、情報の欠落がある環境での有効性が示されました。

自然言語による指示に含まれる「適切な代用品」や「十分に安定した」といった曖昧な述語は、従来の二値的な論理では扱えず、多段階の計画における品質の低下を追跡できないという課題がありました。 本研究が提案するFuzzy Category-theoretic Planning(FCP)は、圏論的プランニングにファジィ論理を導入し、各アクションに0から1の満足度を付与することで、厳密な実行可能性を維持しながら計画全体の品質を構成的に計算することを可能にしました。 検証の結果、FCPはレシピ計画ベンチマークにおいてLLMのみの手法やReActスタイルのベースラインよりも成功率を向上させ、制約違反を減少させると同時に、古典的なPDDL3プランナーと同等の競争力を示しました。

エッジデバイス上での大規模言語モデル(LLM)のパーソナライズにおいて、検索拡張生成(RAG)は有効な手法ですが、メモリと演算のボトルネックを解消するために導入されるメモリ内演算(CiM)アーキテクチャは、環境ノイズによって検索精度が低下するという課題を抱えています。

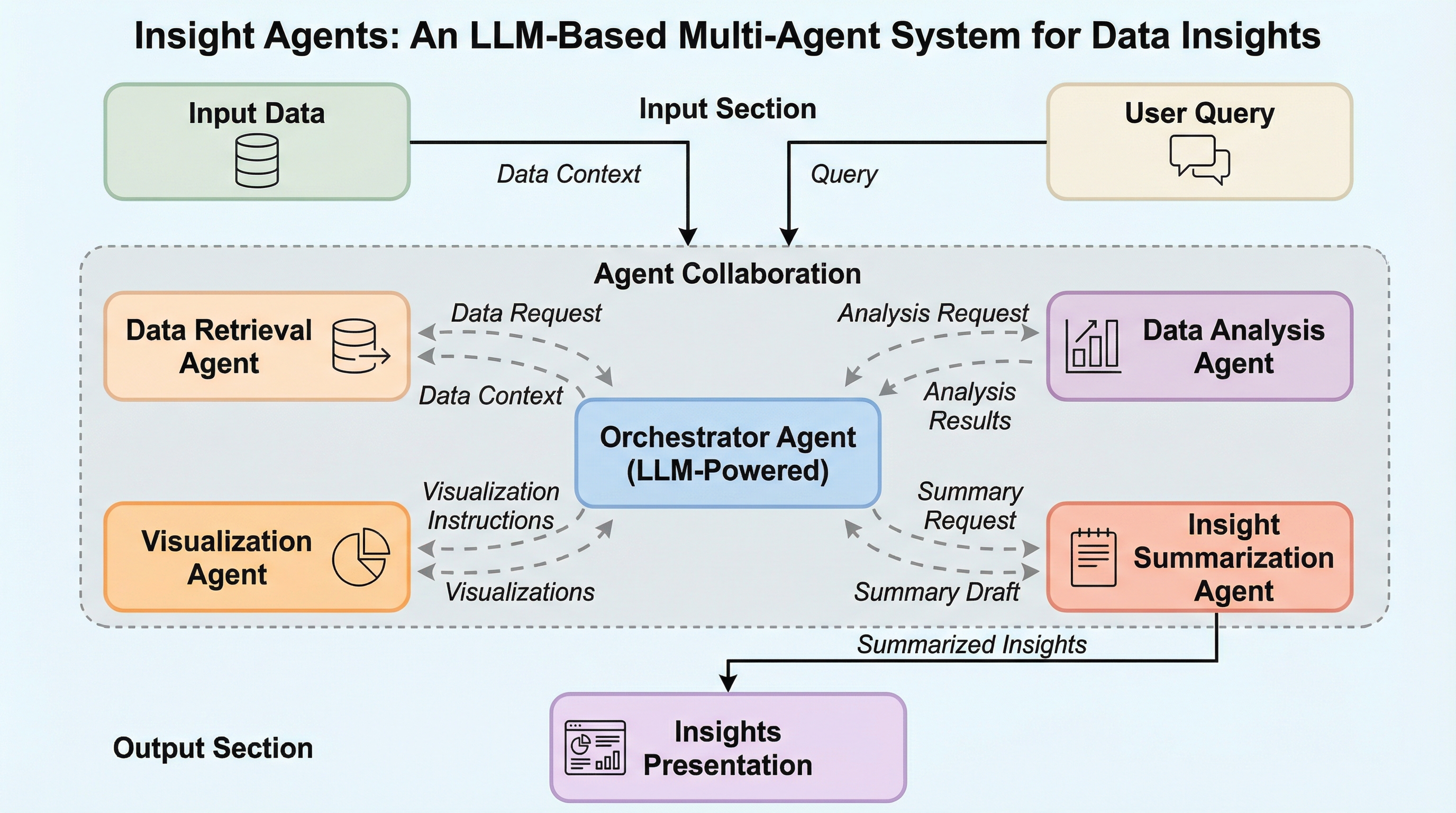

現代のEコマース出品者が直面する膨大なデータと複雑な分析ツールの活用障壁を解消するため、LLMを活用した会話型マルチエージェントシステム「Insight Agents(IA)」を開発し、出品者が自身のデータと対話することで迅速な意思決定を行える環境を構築しました。

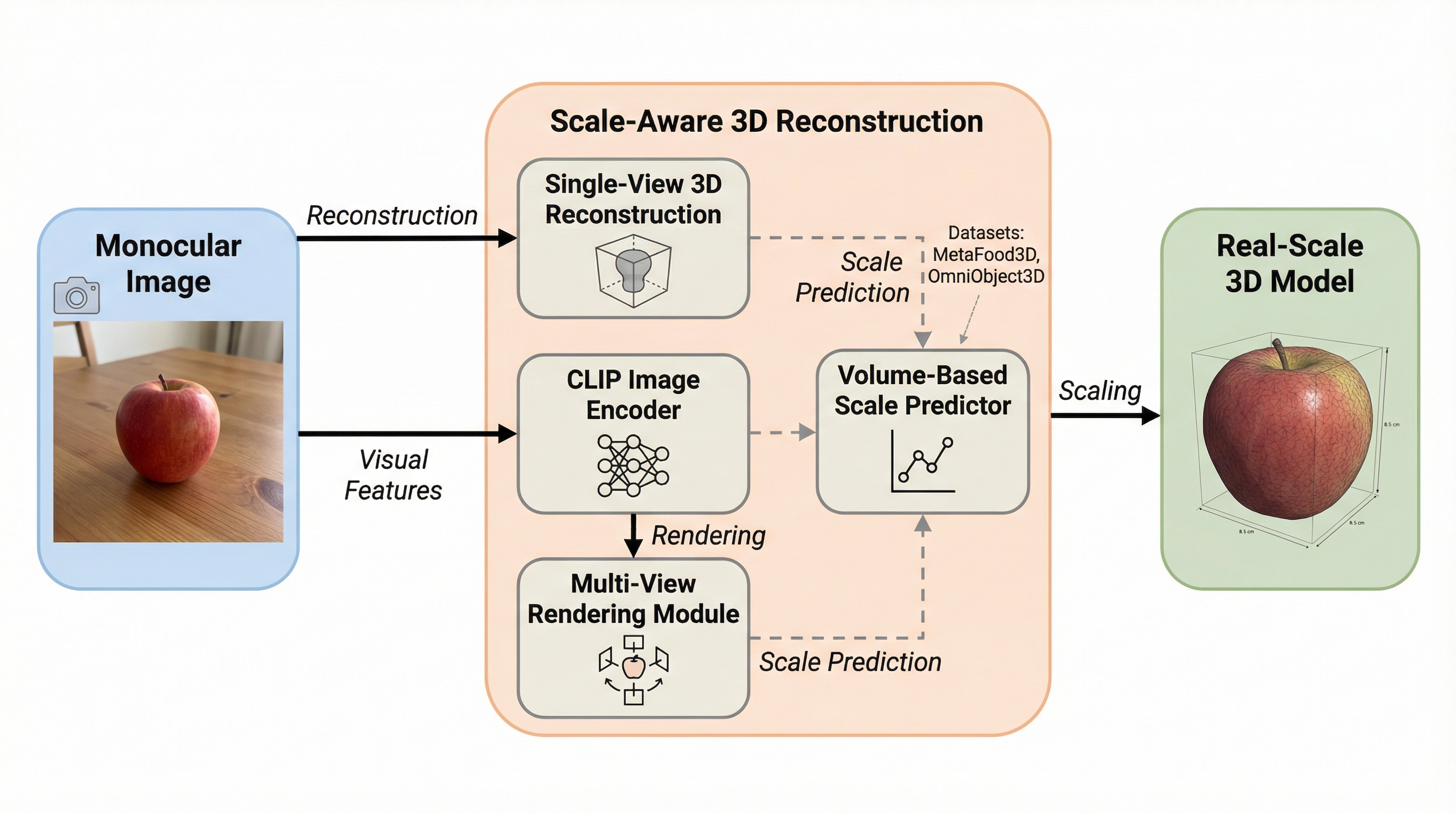

従来の単眼画像からの3D再構築手法では、ブルーベリーとカボチャが同じサイズに見えるような「物理的スケールの欠如」が課題でしたが、本研究はCLIPの視覚的特徴と多角的なレンダリング画像を組み合わせることで、実寸大の3Dモデルを復元する手法を提案しました。

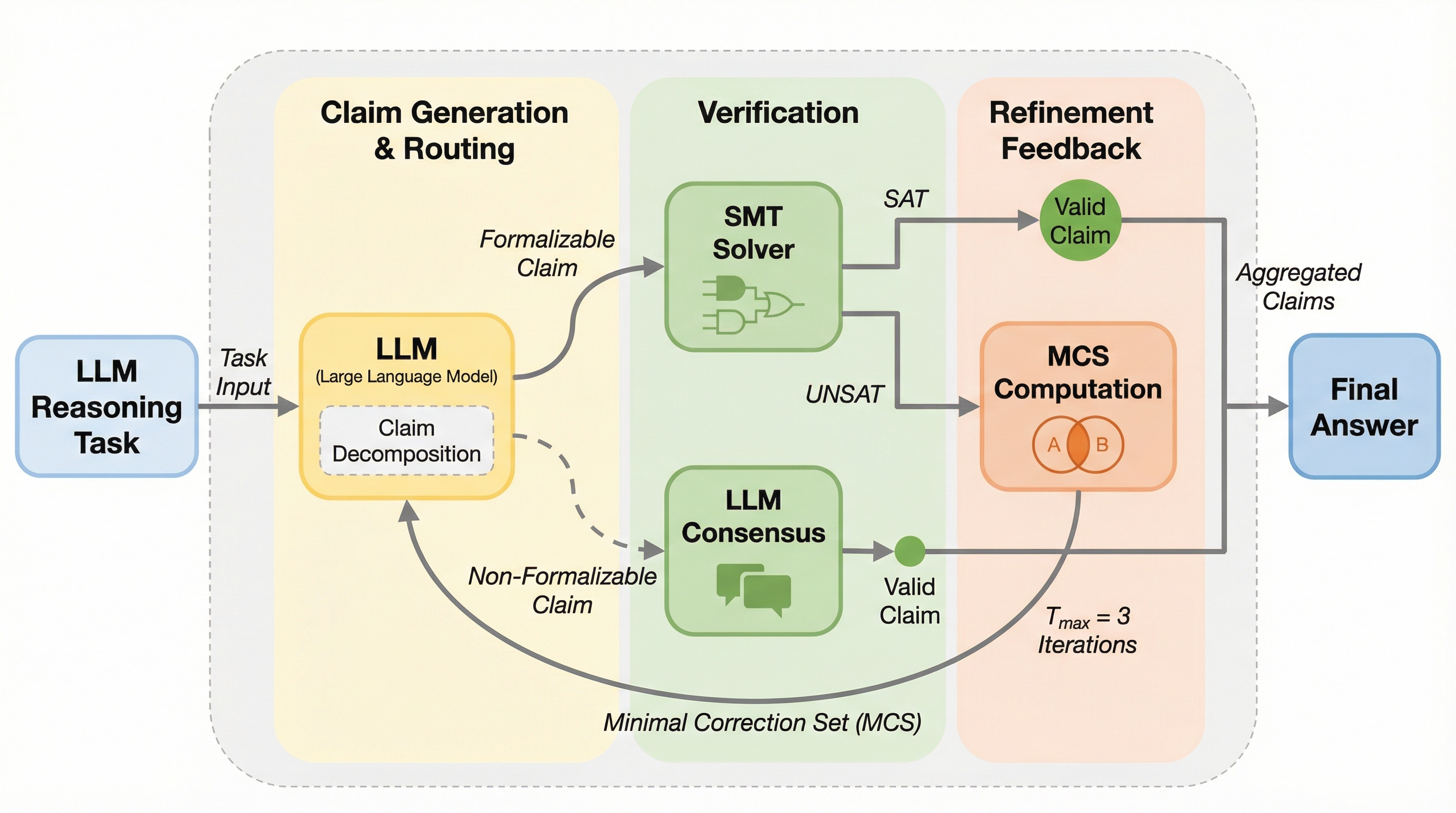

大規模言語モデル(LLM)の論理的正確性を保証するため、LLMとSMTソルバーを統合し、反復的な洗練を通じて検証済みの回答を生成する神経記号的フレームワーク「VERGE」が提案されました。 このシステムは、出力を原子的な主張に分解し、論理的な内容は記号ソルバーで、常識的な内容はLLMアンサンブルで検証するセマンティックルーティングと、最小修正サブセット(MCS)によるエラー箇所の特定を導入しています。 検証の結果、GPT-OSS-120Bモデルにおいて、従来のシングルパス手法と比較して平均18.7%の性能向上が確認され、特に法的な推論や複雑な論理問題において、形式的な検証がハルシネーションの抑制に大きく寄与することが示されました。