LLMに「質問する能力」を教える:不完全な情報下での推論を行う圏論的計画法

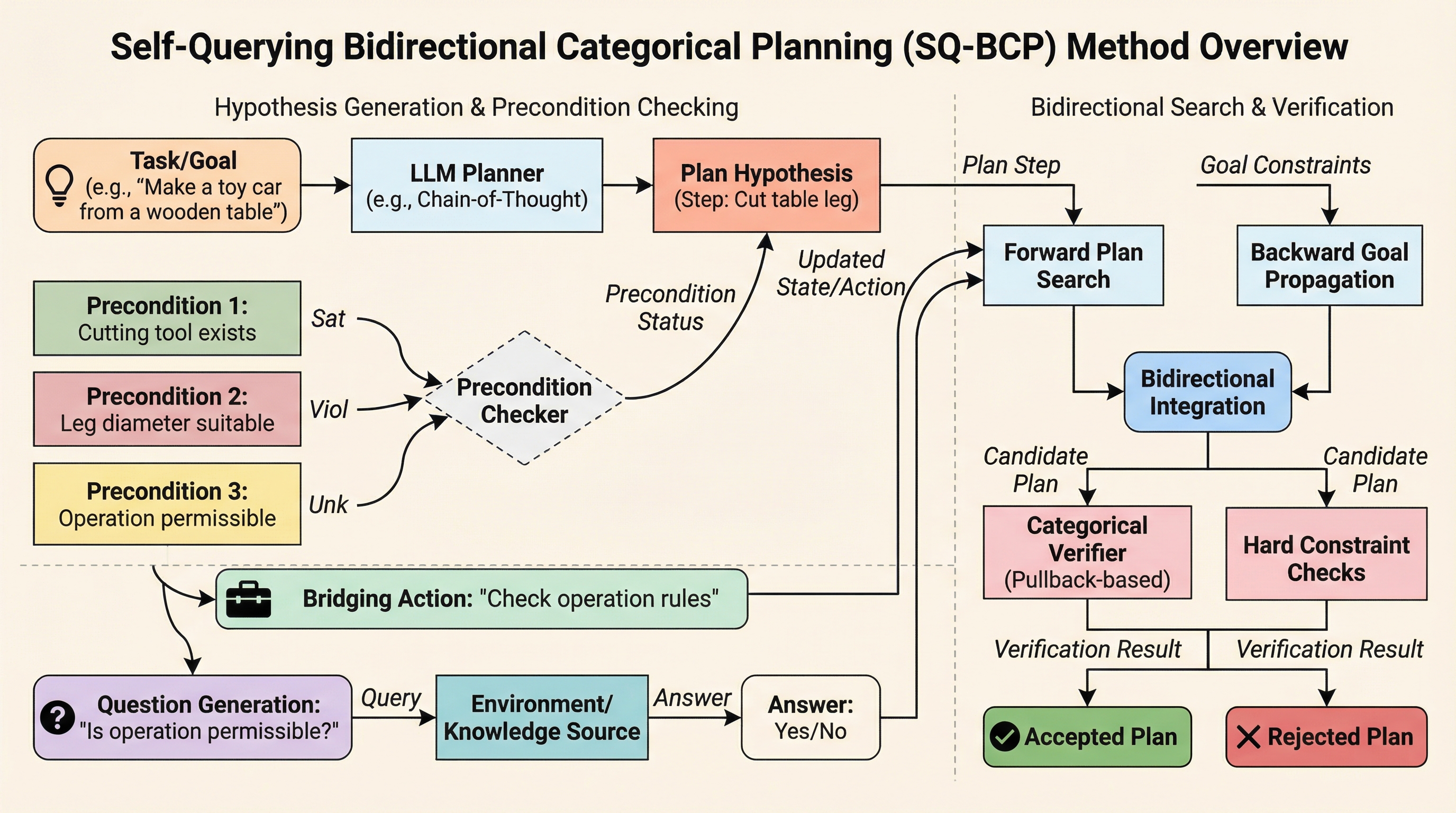

大規模言語モデル(LLM)が不完全な情報の下で計画を立てる際、欠落した事実を捏造したり制約に違反したりする問題を解決するため、自己質問型双方向圏論的計画法(SQ-BCP)が提案されました。 この手法は、前提条件の状態を「充足」「違反」「不明」として明示的に管理し、不明な点については外部への質問や「ブリッジ」アクションによって解決を図ることで、計画の実行可能性を確保します。 実験では、WikiHowやRecipeNLGのタスクにおいて、既存手法と比較してリソース違反率を大幅に低減しつつ、高い計画の質を維持することに成功しており、情報の欠落がある環境での有効性が示されました。

TL;DR(結論)

大規模言語モデル(LLM)が不完全な情報の下で計画を立てる際、欠落した事実を捏造したり制約に違反したりする問題を解決するため、自己質問型双方向圏論的計画法(SQ-BCP)が提案されました。 この手法は、前提条件の状態を「充足」「違反」「不明」として明示的に管理し、不明な点については外部への質問や「ブリッジ」アクションによって解決を図ることで、計画の実行可能性を確保します。 実験では、WikiHowやRecipeNLGのタスクにおいて、既存手法と比較してリソース違反率を大幅に低減しつつ、高い計画の質を維持することに成功しており、情報の欠落がある環境での有効性が示されました。

なぜこの問題か

大規模言語モデルは、思考の連鎖(Chain-of-Thought)や木構造の探索などの推論戦略を用いることで、多段階の解決策を生成することができます。しかし、既存のアプローチの多くは、プロンプトにタスクの仕様が完全に含まれていることを前提としています。現実のユーザーの要求では、リソースの可用性や隠れた制約、観察されていない環境の事実など、重要な前提条件が欠落していることが頻繁にあります。このような情報の欠落がある設定において、モデルはもっともらしい仮定でギャップを埋めてしまう傾向があり、その結果、流暢ではあるが実行不可能な計画が生成されるという問題が生じます。 具体的な例として、「木製のテーブルからおもちゃの車を作る」という要求を考えます。この計画が実現可能かどうかは、テーブルの形状、利用可能な道具、許容される改造といった、クエリには記載されていない事実に依存します。標準的なプロンプトや探索ベースの推論では、「テーブルの脚を車輪の形に切る」といった手順を提案する可能性がありますが、その際に「切断工具が存在するか」「脚の直径が適切か」「その操作がユーザーの制約に違反しないか」といった点を確認しません。…

核心:何を提案したのか

本論文では、前提条件を第一級のオブジェクトとして扱い、アクションを確定させる前に不確実性を解消する推論時計画フレームワークである「自己質問型双方向圏論的計画法(SQ-BCP)」を提案しています。SQ-BCPは、各候補ステップを「充足(Sat)」「違反(Viol)」「不明(Unk)」というラベルが付いた前提条件を伴う仮説として表現します。不明な前提条件が検出された場合、SQ-BCPは決定論的な洗練ポリシーを適用します。具体的には、欠落した事実を得るために焦点を絞った質問をユーザーやオラクルに投げかけるか、あるいは、その前提条件を確立するための補助的な「ブリッジ」アクション(測定、確認、準備など)を提案します。 これらの局所的に洗練された仮説は、前向きの進行と後ろ向きに伝播されたゴール要件を接続する双方向探索手順に統合されます。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related