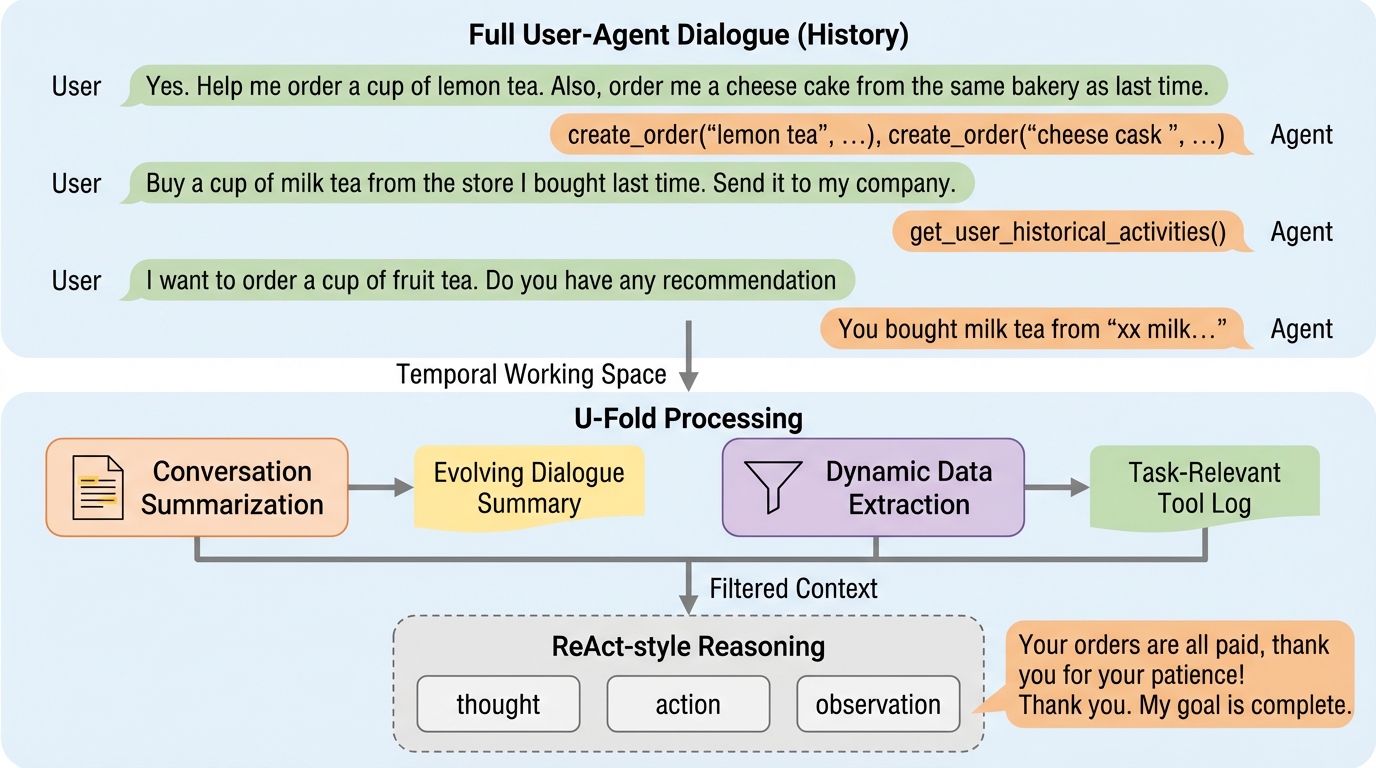

U-Fold:ユーザー中心のエージェントのための動的かつ意図を考慮したコンテキストフォールディング

1. 既存のコンテキスト圧縮手法は、静的な要約によってユーザーの意図の変化や詳細な制約を保持できず、複雑な対話において重要な事実を不可逆的に失い、誤った行動を招くという課題がある。 2. 提案手法「U-Fold」は、対話履歴全体を保持しつつ、各ターンでユーザーの意図を考慮した動的な対話要約と、タスクに真に関連するツールログのみを抽出する二段階のモジュールで構成される。 3. 実証実験では、長文コンテキスト設定においてReActに対し71.4%の勝率を記録し、既存の圧縮手法を最大27.0%上回る大幅な性能向上を達成し、情報の完全性と圧縮の両立を証明した。