言葉よりコードを:コードに基づく推論による意味的慣性の克服

大規模言語モデル(LLM)が、文脈上の新しいルールよりも学習済みの事前知識を優先してしまう「意味的慣性」という問題を特定し、パズルゲーム「Baba Is You」を用いてその影響を定量的に評価しました。

TL;DR(結論)

大規模言語モデル(LLM)が、文脈上の新しいルールよりも学習済みの事前知識を優先してしまう「意味的慣性」という問題を特定し、パズルゲーム「Baba Is You」を用いてその影響を定量的に評価しました。自然言語を用いた推論では、モデルが大規模化するほど事前知識に固執して性能が低下する「逆スケーリング」現象が確認されましたが、推論を記述的なテキストではなく実行可能なコード(Python)に基づかせることで、この傾向を完全に逆転できることが判明しました。提案手法であるCode-Grounded Vistas(LCV)は、同一の状態に対して矛盾するルールを割り当てた反事実的なペアを用いてモデルを微調整することで、視覚的な意味と論理的な制約を構造的に切り離し、未知の物理法則に対しても効率的かつ正確に適応する能力を実現しています。

なぜこの問題か

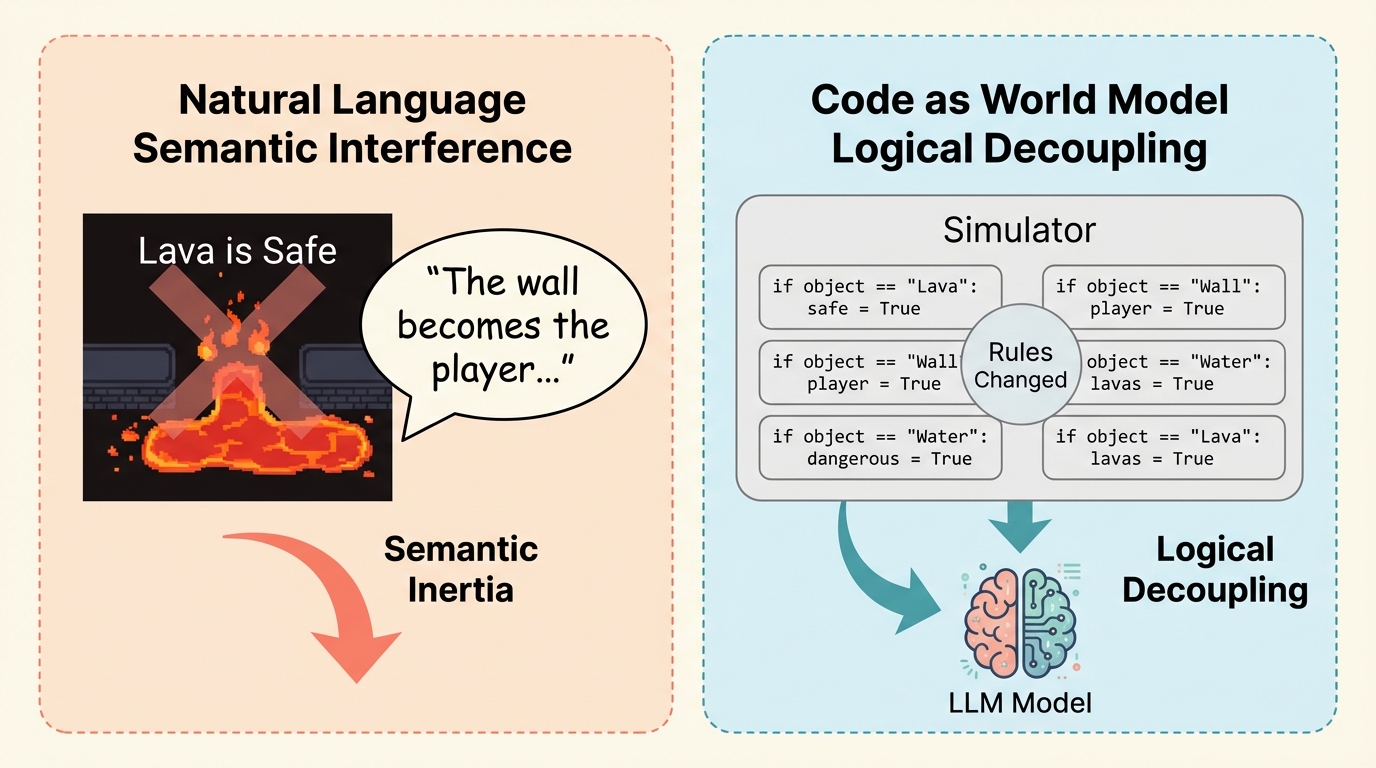

現在の大規模言語モデル(LLM)は、膨大なテキストデータから学習した統計的な相関関係、すなわち分布意味論に依存して高い推論能力を発揮しています。しかし、この成功は「言葉と概念の統計的な結びつき」に根ざしているため、モデルが学習した事前知識と、その場の文脈で与えられた動的なルールが矛盾する場合に深刻な問題が生じます。例えば、モデルが「溶岩は危険である」という強い先入観を持っているとき、文脈の中で「溶岩は安全である」という新しいルールが提示されても、モデルは学習済みの知識を抑制できず、誤った推論を行ってしまいます。本論文では、この現象を「意味的慣性(Semantic Inertia)」と定義しています。この問題は、静的なドメインでは表面化しにくいですが、状況に応じて意味を動的に再割り当てする必要がある堅牢な知能においては致命的な欠陥となります。 人間心理学における「機能的固着」や「抑制制御」の困難さに似ており、慣れ親しんだオブジェクトに新しい機能を割り当てることができない状態を指します。…

核心:何を提案したのか

本論文では、意味的慣性を克服するための新しいアプローチとして「Code-Grounded Vistas(LCV)」を提案しています。これは、LLMの役割を「受動的な文章生成器」から「能動的な理論構築者」へと転換させるものです。具体的には、モデルに直接アクションを予測させるのではなく、現在の環境を支配している「物理法則」を表現する実行可能なPythonプログラムを合成させる手法をとります。LCVの核心は、推論の基盤を曖昧な自然言語から、厳密な論理構造を持つ実行可能なコードへと移すことにあります。自然言語による推論では、記述的な意味と論理的なルールが絡み合っており、モデルは「壁」という言葉から「通行不能な障害物」という統計的なパターンを自動的に想起してしまいます。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related