タスク認識はLLMの生成と不確実性を改善する

大規模言語モデル(LLM)の出力は、自然言語の形式をとりながらも、その背後にはラベル、数値、グラフといった特定のタスク構造が潜在していますが、従来のデコーディング手法は言語空間のみで動作し、この構造的情報を十分に活用できていないという課題がありました。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

大規模言語モデル(LLM)の出力は、自然言語の形式をとりながらも、その背後にはラベル、数値、グラフといった特定のタスク構造が潜在していますが、従来のデコーディング手法は言語空間のみで動作し、この構造的情報を十分に活用できていないという課題がありました。

MARは、計算負荷の高い注意機構を線形時間の状態空間モデル(SSM)に置き換えた上で、フィードフォワードネットワーク(FFN)をスパイキングニューラルネットワーク(SNN)によってスパース化する、二段階のモジュール対応アーキテクチャ洗練フレームワークである。

大規模言語モデル(LLM)の性能評価を、従来の1問あたりの成功率(pass@k)から、限られた総予算内で解決できるユニークな問題数(coverage@cost)へと転換することを提案しています。

大規模言語モデル(LLM)の推論において、従来は1回でも正解する確率を示すpass@kが重視されてきましたが、実運用では限られた予算内でいくつの異なる問題を解決できるかというcoverage@costがより重要な指標となります。

マルチエージェント強化学習において、全エージェントの報酬を統合するグローバル報酬は協力行動を促すが、各個体の貢献度が不明瞭になるクレジット割り当て問題を引き起こし、学習のノイズを増大させる。 一方で、個別の局所報酬を用いる手法は学習速度に優れるものの、エージェントが自身の利益のみを追求する利己的な振る舞いに陥りやすく、システム全体の最適性を損なう「報酬のジレンマ」が存在する。 本研究が提案する手法は、エージェント間の相互作用を依存グラフとしてモデル化し、影響が及ぶ経路に基づいて不要な報酬信号を遮断することで、協力の維持と効率的な学習を両立させる明示的なクレジット割り当てを実現した。

マルチエージェント強化学習において、全体の報酬を共有する「グローバル報酬」は協力行動を促すが、各エージェントの貢献度が不明確になる「貢献度割当問題」を引き起こし、逆に個別の「ローカル報酬」は学習は早いが、エージェントが利己的になり全体の最適性を損なうというジレンマが存在する。

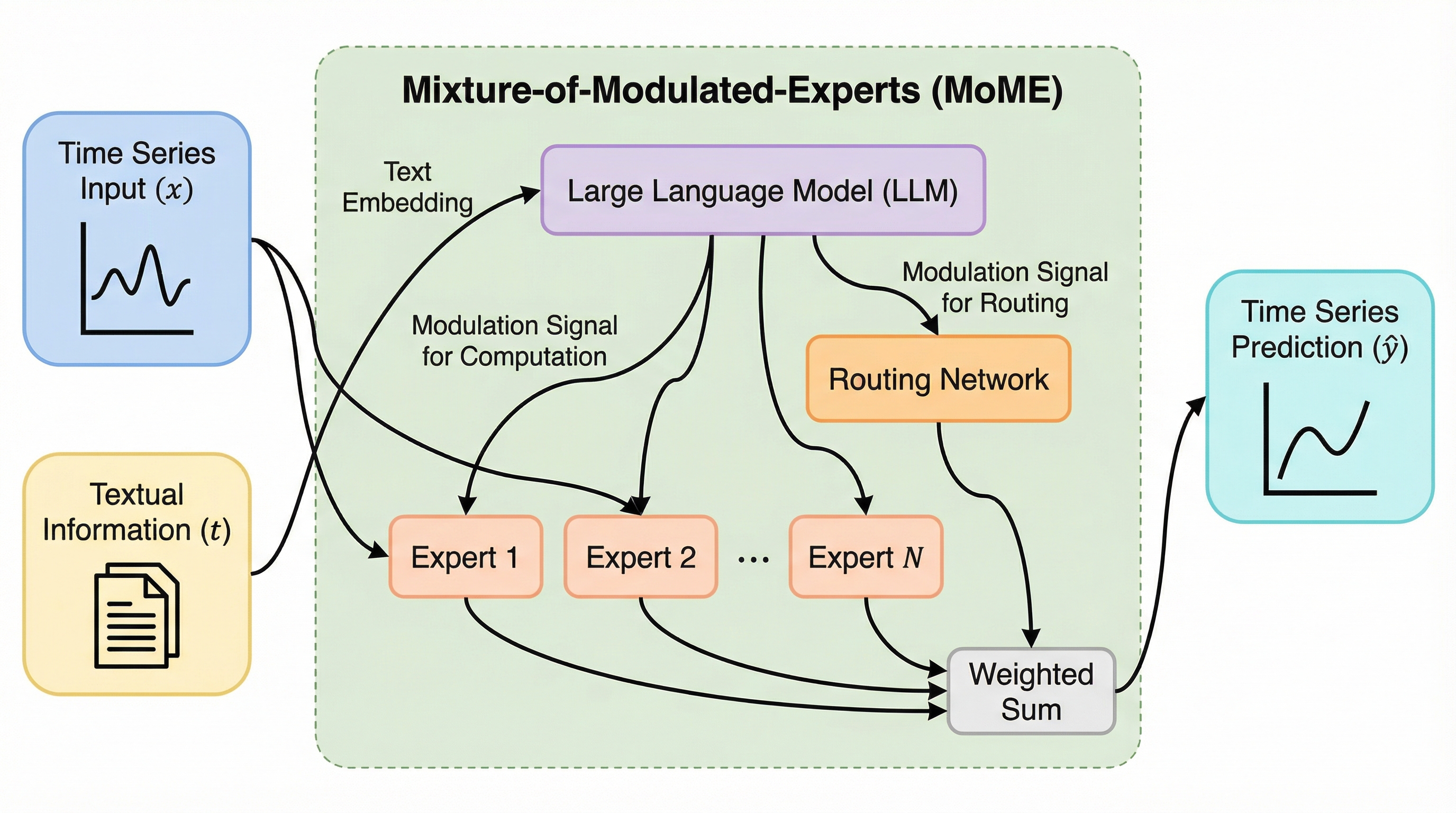

従来のマルチモーダル時系列予測で主流だった、数値データとテキストデータを共通の潜在空間で直接混ぜ合わせる「トークンレベルの融合」に代わり、テキスト情報を用いて時系列エキスパートの計算とルーティングを直接制御する「エキスパート変調(Expert Modulation)」という新しいパラダイムを提案した。

現実世界の時系列予測において、数値データとニュース等のテキスト情報を統合する際、従来のトークンレベルの融合ではノイズやデータの異質性が課題となっていたが、本研究ではテキスト信号が専門家(エキスパート)の選択と計算を直接制御する「Expert Modulation」という新しい枠組みを提案した。

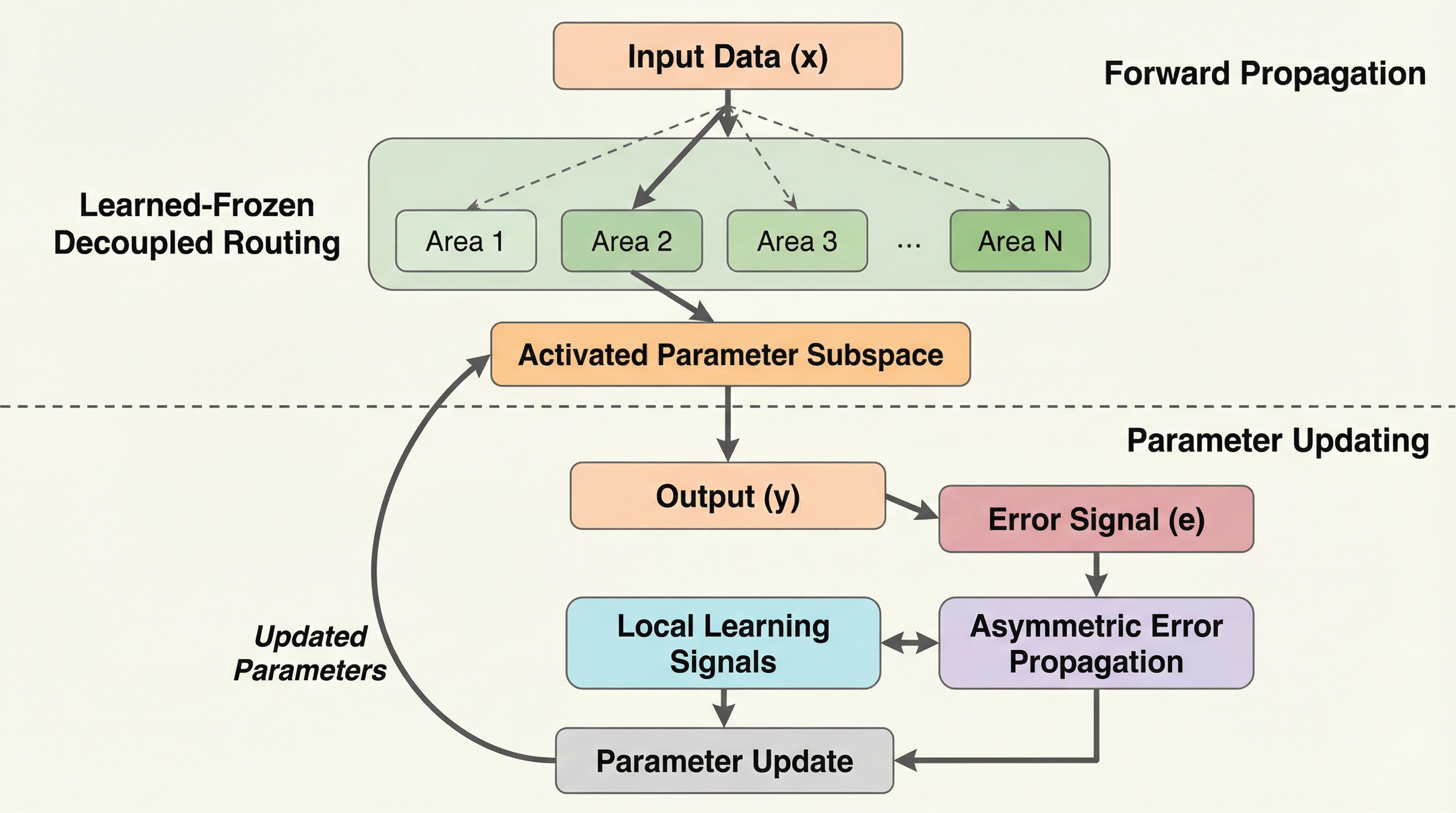

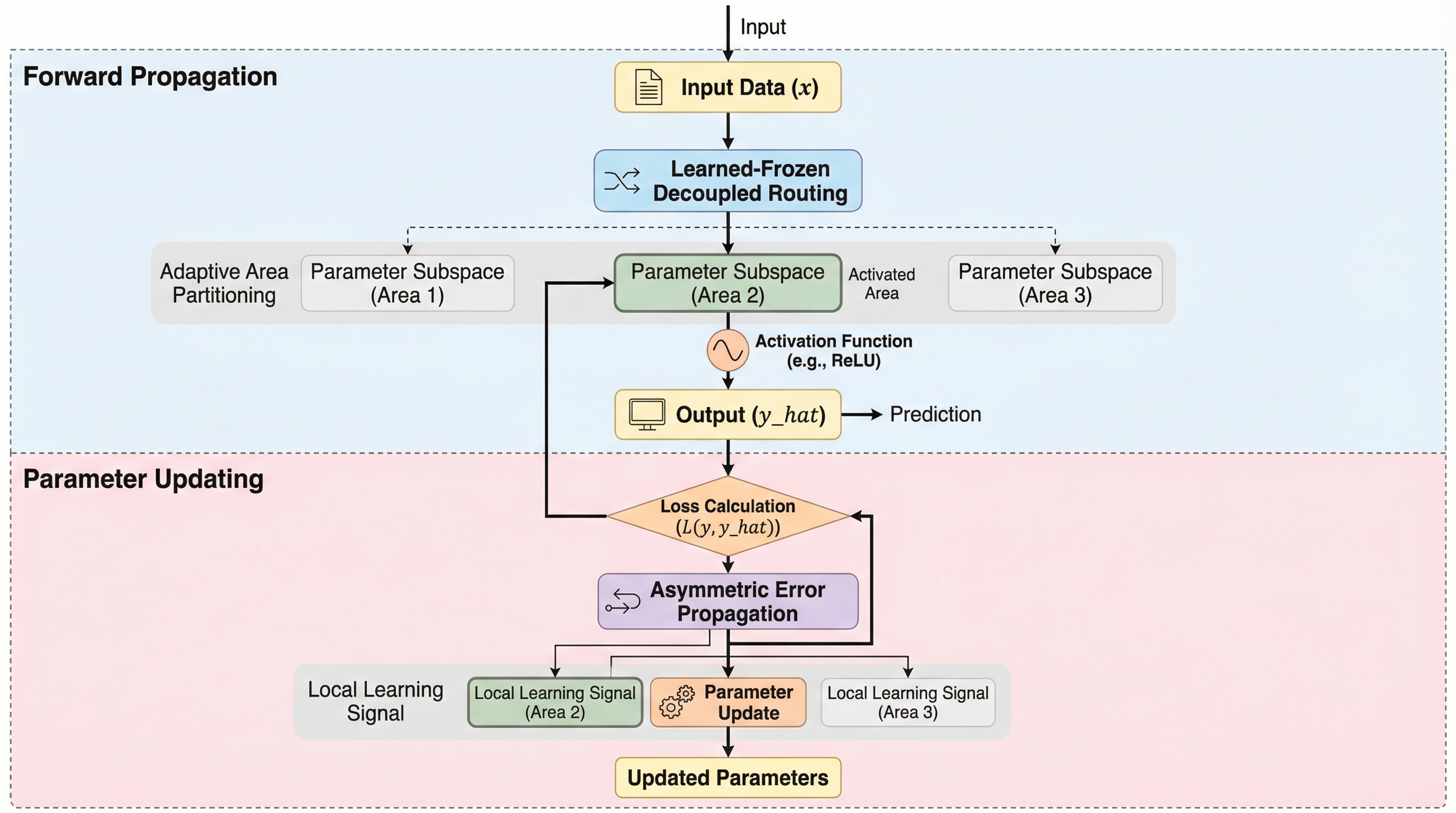

誤差逆伝播法(BP)が抱える生物学的な不自然さと、密なネットワーク表現における勾配干渉の問題を解決するため、選択的なパラメータ活性化と適応的な領域分割を組み合わせた新しい学習手法「Selective Adaptive Learning(SAL)」が提案されました。

標準的なディープラーニングが依存するバックプロパゲーションの生物学的な不自然さと、密な表現における勾配干渉の問題を解決するため、選択的パラメータ活性化と適応的領域分割を組み合わせた「選択的適応学習(SAL)」が提案されました。