シミュレーション合成データでAIエージェントを育てるには何が要るか:不足データ問題からデジタルツイン参照枠組みまで。

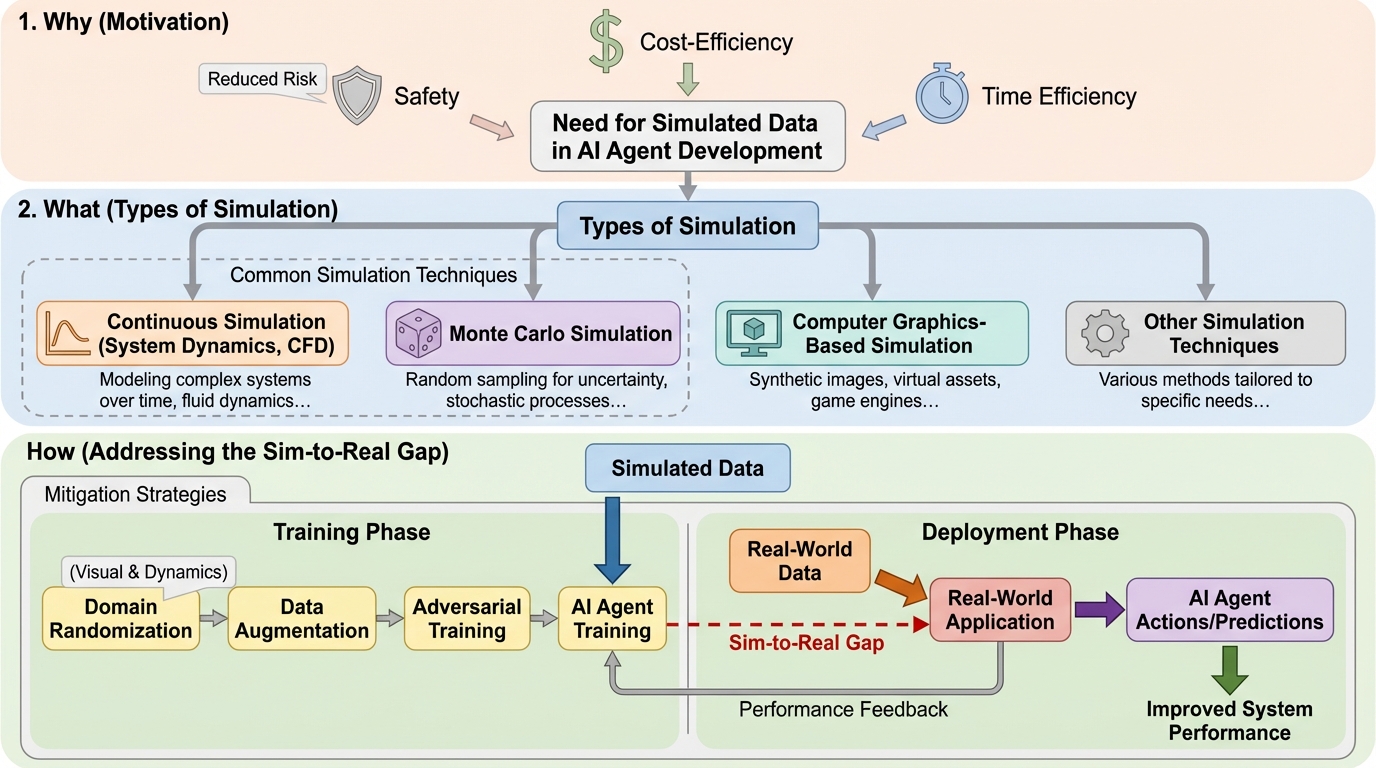

現代のサブシンボリックAIは大量かつ高品質な学習データに支えられますが、実世界データは取得コスト、プライバシー、安全性、組織内サイロなどの制約で集めにくく、さらに欠損や重複やノイズが使い勝手を下げるため、合成データ生成の需要が高まります。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

現代のサブシンボリックAIは大量かつ高品質な学習データに支えられますが、実世界データは取得コスト、プライバシー、安全性、組織内サイロなどの制約で集めにくく、さらに欠損や重複やノイズが使い勝手を下げるため、合成データ生成の需要が高まります。

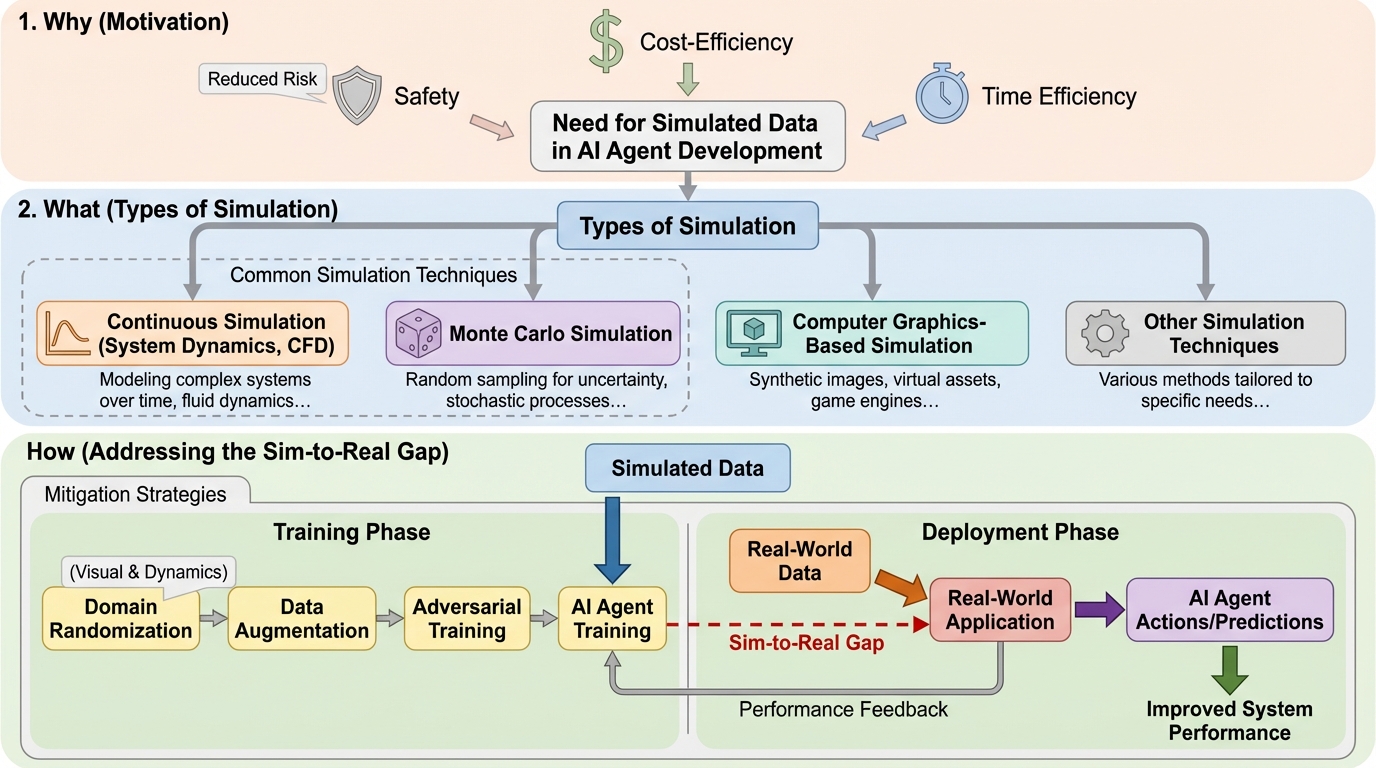

安全集合を最大化して「ずっと安全」を保証したい目的と、強化学習がユーザ指定の分布に対する期待値を最適化しやすい目的のずれにより、確率は低いが本来は安全にできる状態で方策が破綻しやすくなります。 / そこで、初期状態・ダイナミクス・安全仕様を決めるパラメータ集合のうち「安全な方策が存在する部分集合」を探索で広げながら、その部分集合上で最悪条件に耐える回避方策を学習するFGEを提案しています。 / MuJoCo上の高次元回避問題の実験では、難しい初期条件において既存最良手法よりカバレッジが50%を超えて増え、最悪条件がそもそも不可能な設定でも学習が停滞しにくい方向性を示しています。

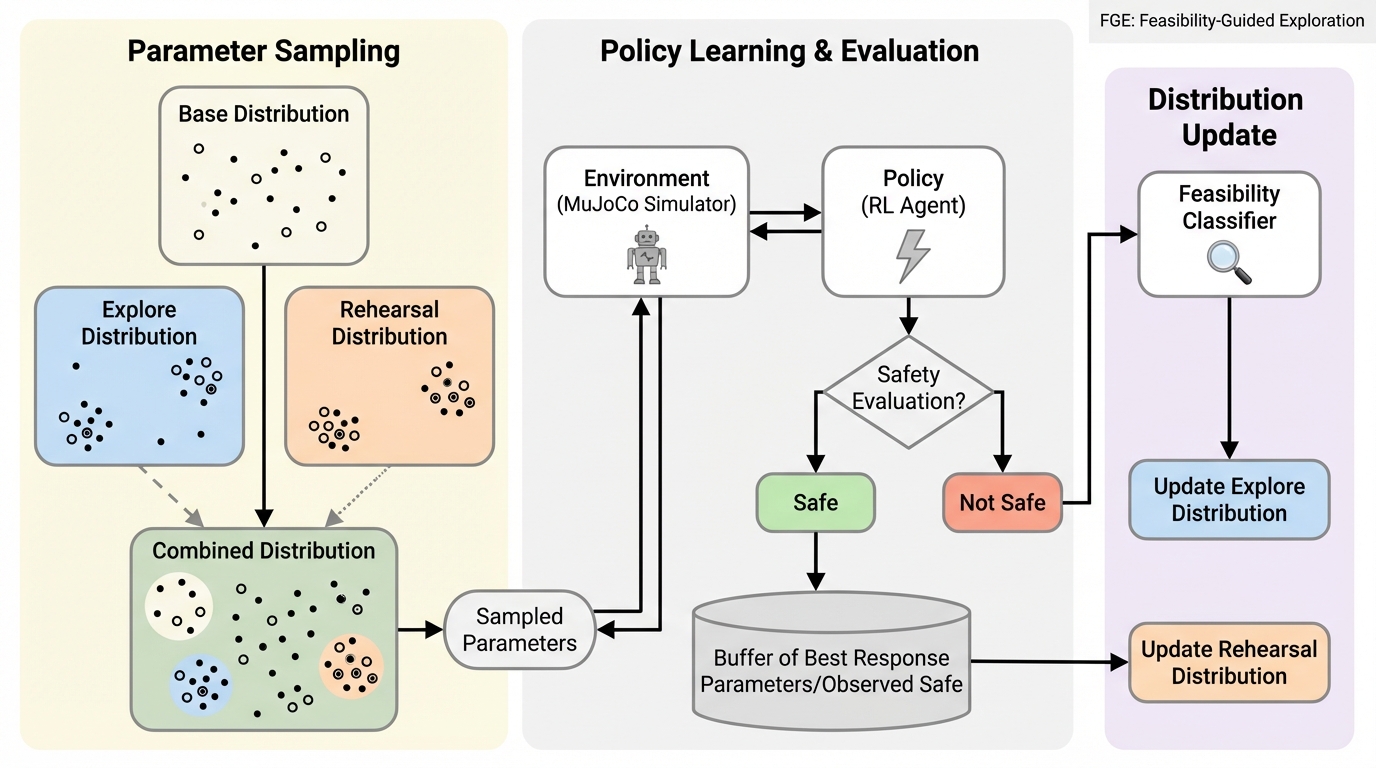

CrispEditは、編集が一見成功しても一般的な能力が静かに壊れるという「能力保持」の難しさを正面から扱い、能力の変化を小さく抑えることを明示的な制約として組み込む手法です。 / 編集を制約付き最適化として定式化し、能力損失の地形で曲率が小さい部分空間へ更新を射影して、能力に敏感な方向の更新成分を取り除く設計にしています。 / 標準的なモデル編集ベンチマーク全体で高い編集成功を保ちながら、データセット平均の能力劣化を1%未満に抑え、従来の編集器より編集と保持のトレードオフを大きく改善したと報告されています。

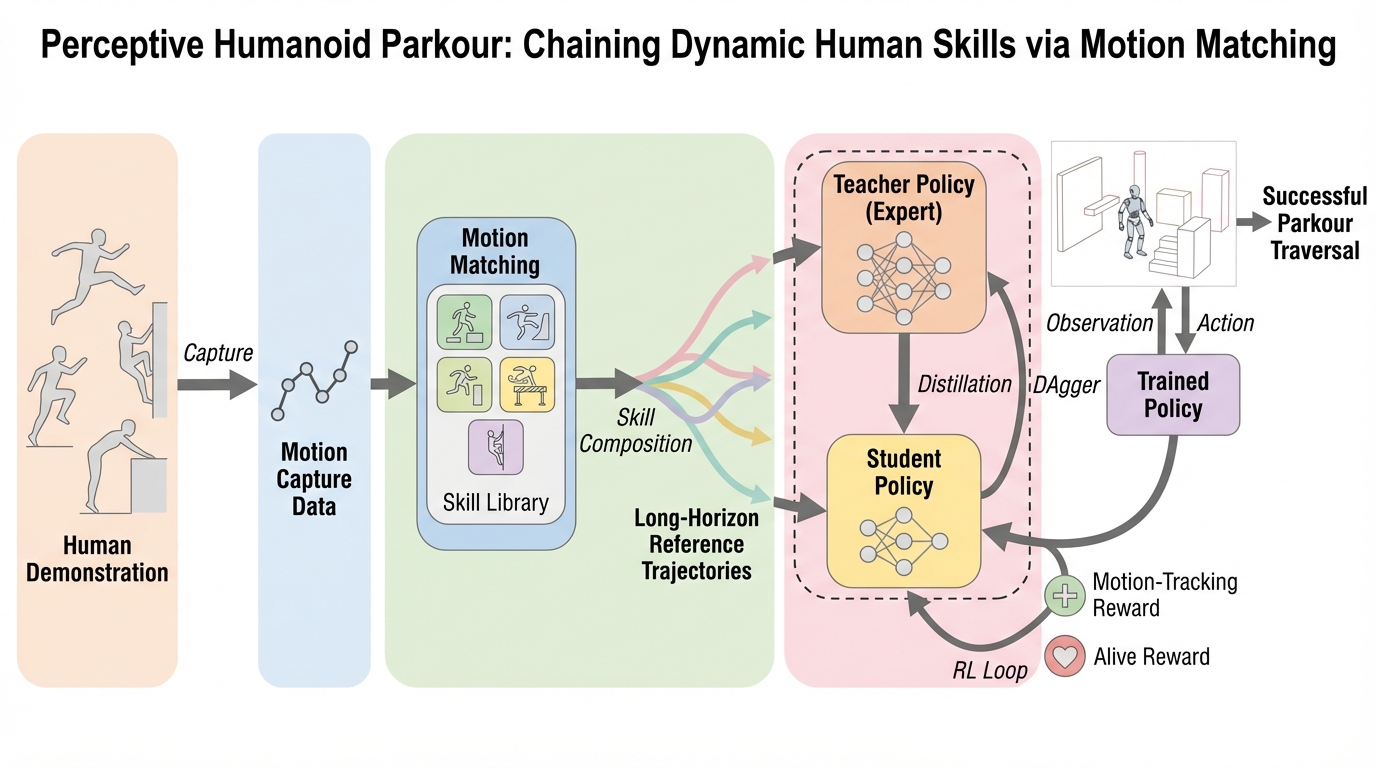

少数で短い人間の高ダイナミクス動作データからでも、ヒューマノイドが視覚にもとづいて障害物コースを長時間にわたり自律走破できるようにする、モジュール型の枠組みが示されています。 / Motion Matchingを特徴空間での最近傍探索として使い、歩行・走行と原子スキルをつないで長時間の参照軌道を合成し、その参照を追従する複数の強化学習専門家を学習したうえで、DAggerと強化学習を組み合わせて深度入力の単一方策へ蒸留します。 / Unitree G1の実機で、深度センサと離散的な2次元速度指令だけを用い、約3 m/sの跳び越えや1.25 m(身長の96%)までの壁登り、60秒の連続走破、障害物の摂動に対する閉ループ適応が確認されています。

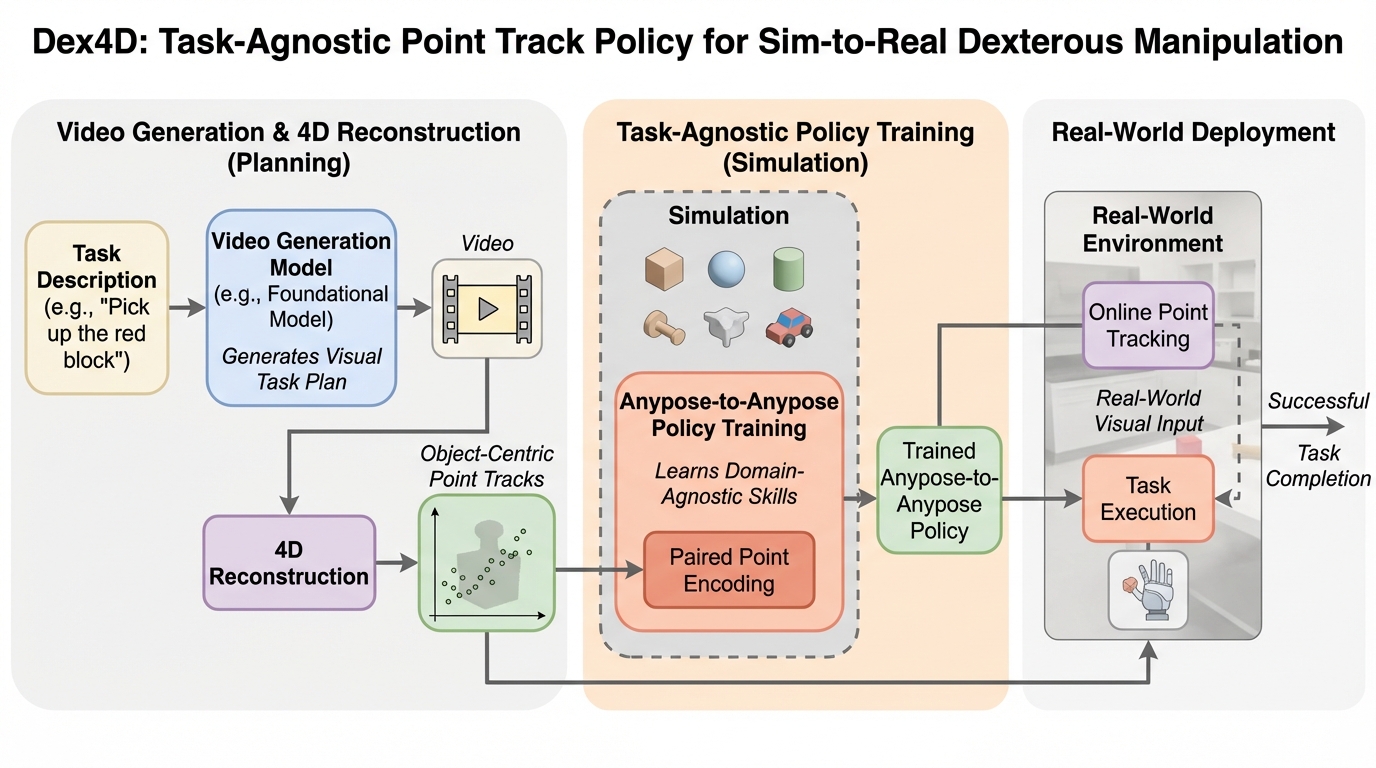

Dex4Dは、個別タスクごとの環境設計や報酬設計を増やすのではなく、「物体を現在姿勢から目標姿勢へ動かす」という共通能力をシミュレーションで学び、実機の多様な巧緻操作へつなげる枠組みです。 / 目標は言語そのものではなく、生成動画と4D再構成から得る物体中心の3D点トラックで与え、実行中はオンライン点追跡で現在の点を更新しながら、点トラック条件付きポリシーで閉ループ制御します。 / シミュレーションと実機の広範な実験により、ファインチューニングなしのゼロショット展開、先行ベースラインに対する成功率・タスク進捗・頑健性の一貫した改善、そして新規物体や背景などへの強い汎化が報告されています。

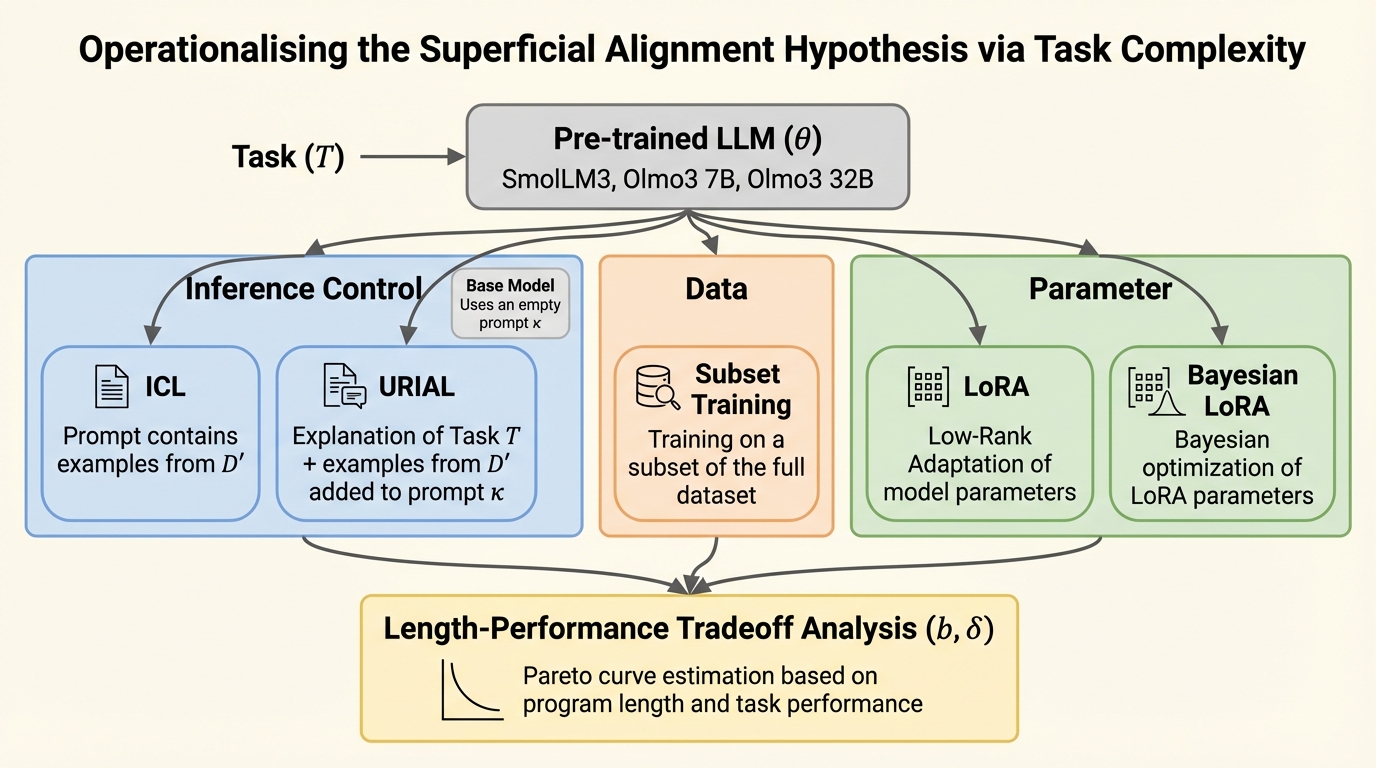

SAHは「大規模言語モデルは事前学習で知識の大半を得て、事後学習はそれを表に出すだけ」という見立てですが、重要語の定義が曖昧なため、支持と批判が同じ土俵で噛み合いにくい状況でした。 / 本研究は、目標性能を満たすための「最短プログラム長」をタスク複雑性として定義し、少量データでの微調整、少数パラメータ更新、推論時のプロンプト制御を、短いプログラムを見つけるための別戦略として同一の指標で比較できるようにします。 / 数学推論・機械翻訳・指示追従で複雑性を推定したところ、事前学習モデルへのアクセスにより複雑性が非常に小さくなり得る一方、強い性能へ到達するには長大なプログラムが必要になる場合もあり、事後学習は同等の性能へ到達する複雑性を大きく縮め、適応に必要な情報が数キロバイトで足りることが多いと示されました。

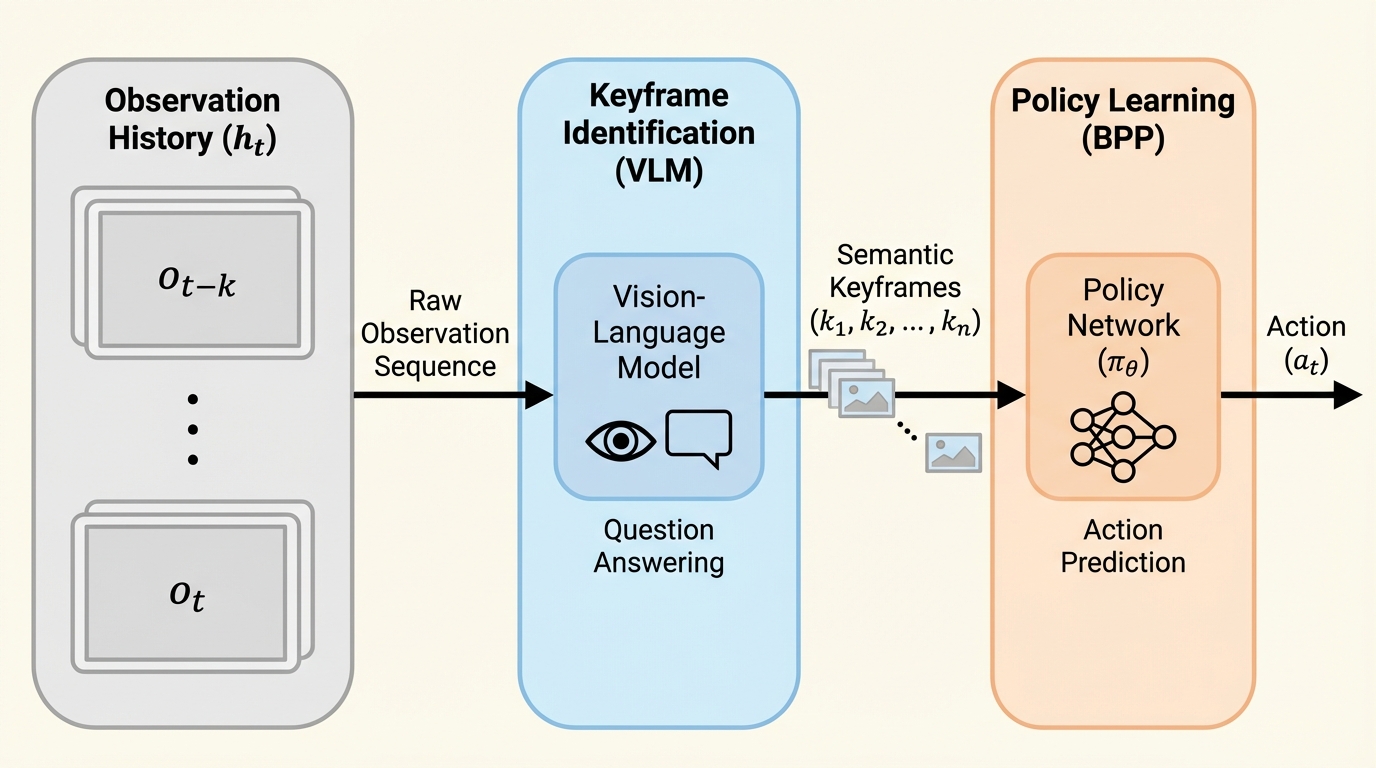

ロボットが過去の出来事を覚える必要があるタスクでは、観測履歴をそのまま入力に足すだけでは学習時の履歴に含まれる偶然の手掛かりへ依存しやすく、運用時に少し軌跡がずれただけで未学習の履歴に遭遇して失敗が連鎖しやすいと分析されています。

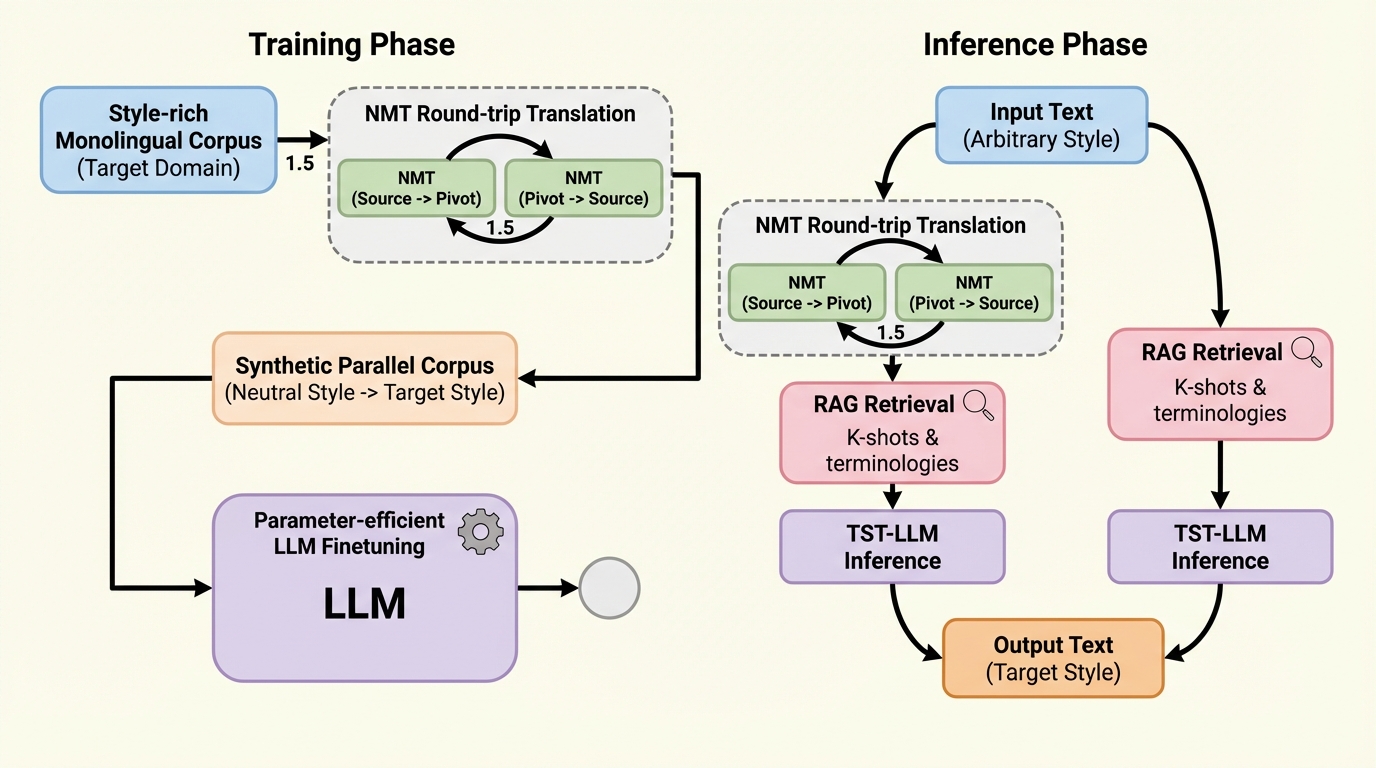

スタイル間の対応が付いた学習データが乏しい状況でも、単言語でスタイルが一貫したコーパスから疑似的な対応データを作り、大規模言語モデルをパラメータ効率よく微調整してスタイル変換を行う枠組みが示されています。

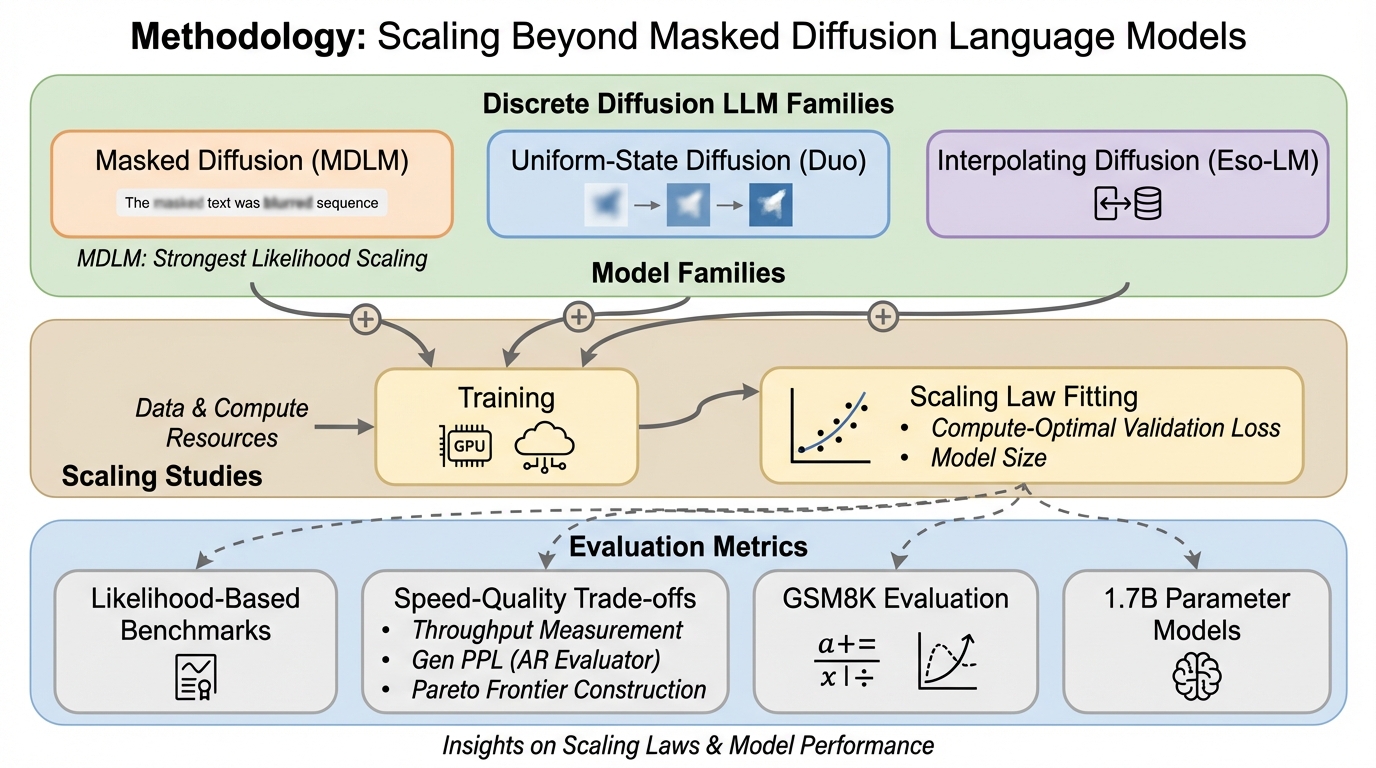

Scaling Beyond Masked Diffusion Language Models:離散拡散言語モデルを「パープレキシティ中心」から拡張して捉え直す

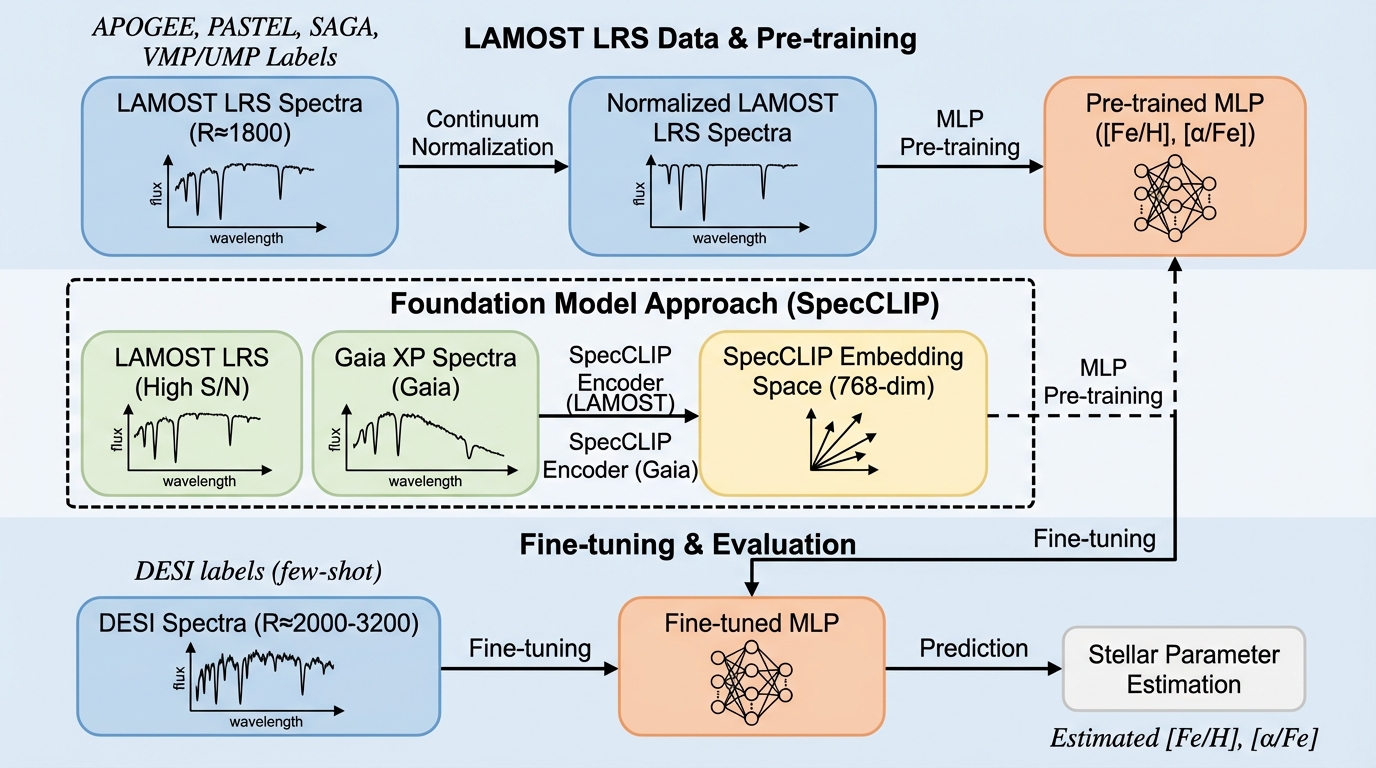

低分解能サーベイで学習した単純な多層パーセプトロン(MLP)でも、別サーベイの中分解能スペクトルへそのまま適用しても良好に推定でき、少量データでの追加学習でさらに整えられることを示しました。 / LAMOSTの低分解能スペクトルそのもの、またはトランスフォーマー系の自己教師ありモデルが作る埋め込みを入力としてMLPを事前学習し、DESIスペクトルに対してゼロショット適用と少数ショットの微調整を行い、残差ヘッド、LoRA、全層微調整を比較しました。 / 鉄の存在度では金属量が高い領域([Fe/H] > −1.0)で埋め込みが有利になり得る一方、金属量が低い領域ではスペクトル直接入力のMLPが相対的に優位になり、最適な微調整法は推定したい恒星パラメータによって変わることが分かりました。