GhostUI:モバイルUIにおける隠されたインタラクションを明らかにする

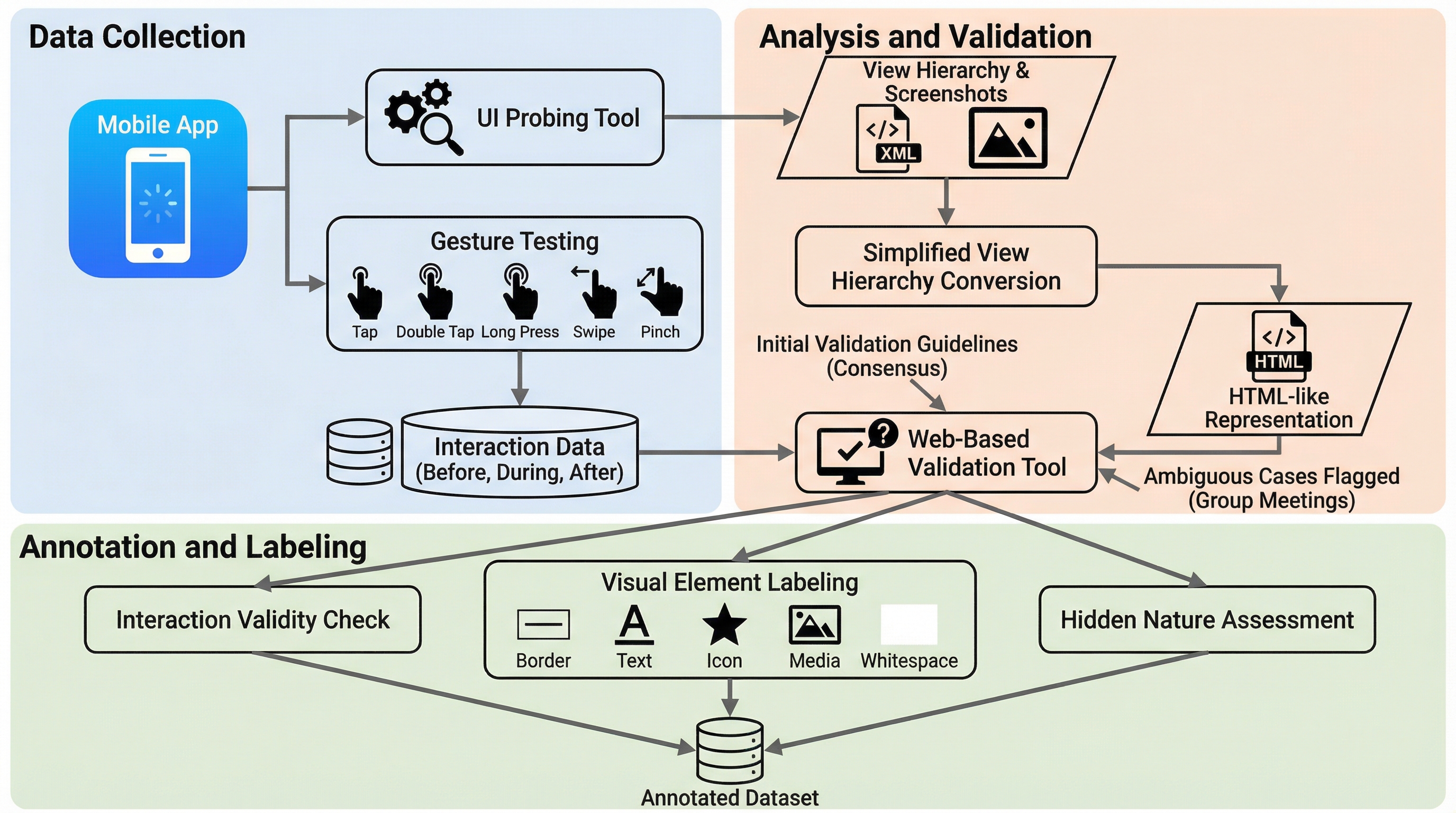

現代のモバイルアプリには、スワイプや長押しといった視覚的な手がかりのない「隠れたインタラクション」が数多く存在し、これが視覚情報に依存するAIエージェントの操作を困難にしている。本研究では、81種類の人気アプリから1,970件の隠れた操作事例を収集した世界初のデータセット「GhostUI」を構築し、操作前後の画像や構造データ、自然言語によるタスク説明を体系化した。検証の結果、GhostUIで学習した視覚言語モデルは、隠れた操作の予測精度や操作後の画面状態の推論能力が大幅に向上し、モバイルタスク自動化における視覚的手がかりの欠如という課題を克服する重要な基盤となることが示された。