GhostUI:モバイルUIにおける隠されたインタラクションを明らかにする

現代のモバイルアプリには、スワイプや長押しといった視覚的な手がかりのない「隠れたインタラクション」が数多く存在し、これが視覚情報に依存するAIエージェントの操作を困難にしている。本研究では、81種類の人気アプリから1,970件の隠れた操作事例を収集した世界初のデータセット「GhostUI」を構築し、操作前後の画像や構造データ、自然言語によるタスク説明を体系化した。検証の結果、GhostUIで学習した視覚言語モデルは、隠れた操作の予測精度や操作後の画面状態の推論能力が大幅に向上し、モバイルタスク自動化における視覚的手がかりの欠如という課題を克服する重要な基盤となることが示された。

TL;DR(結論)

現代のモバイルアプリには、スワイプや長押しといった視覚的な手がかりのない「隠れたインタラクション」が数多く存在し、これが視覚情報に依存するAIエージェントの操作を困難にしている。本研究では、81種類の人気アプリから1,970件の隠れた操作事例を収集した世界初のデータセット「GhostUI」を構築し、操作前後の画像や構造データ、自然言語によるタスク説明を体系化した。検証の結果、GhostUIで学習した視覚言語モデルは、隠れた操作の予測精度や操作後の画面状態の推論能力が大幅に向上し、モバイルタスク自動化における視覚的手がかりの欠如という課題を克服する重要な基盤となることが示された。

なぜこの問題か

現代のモバイルアプリケーションは、限られた画面スペースを最大限に活用するために、ボタンやメニューといった直接的な視覚要素に頼らない多様な操作手法を採用している。これらは「隠れたインタラクション」と呼ばれ、特定の要素に対して長押しやスワイプを行うことで、初めて機能やメニューが呼び出される仕組みである。人間は過去の経験やチュートリアル、あるいは試行錯誤を通じてこれらの操作を発見できるが、スクリーンショットなどの視覚情報のみを頼りに動作する視覚言語モデル(VLM)を搭載したAIエージェントにとって、これは極めて深刻な障害となっている。AIは画面上に明示されていない操作の可能性を認識できず、結果として複雑なタスクを完結させることができない。 この問題の背景には、UIデザインにおける「アフォーダンス」の概念がある。通常、ボタンの形をしていれば「押せる」という視覚的な示唆(アフォーダンス)が存在するが、隠れたインタラクションにはこれが欠如している。さらに、一つのUI要素に対して複数のジェスチャが異なる結果をもたらす「多対多」の関係が問題をより複雑にしている。…

核心:何を提案したのか

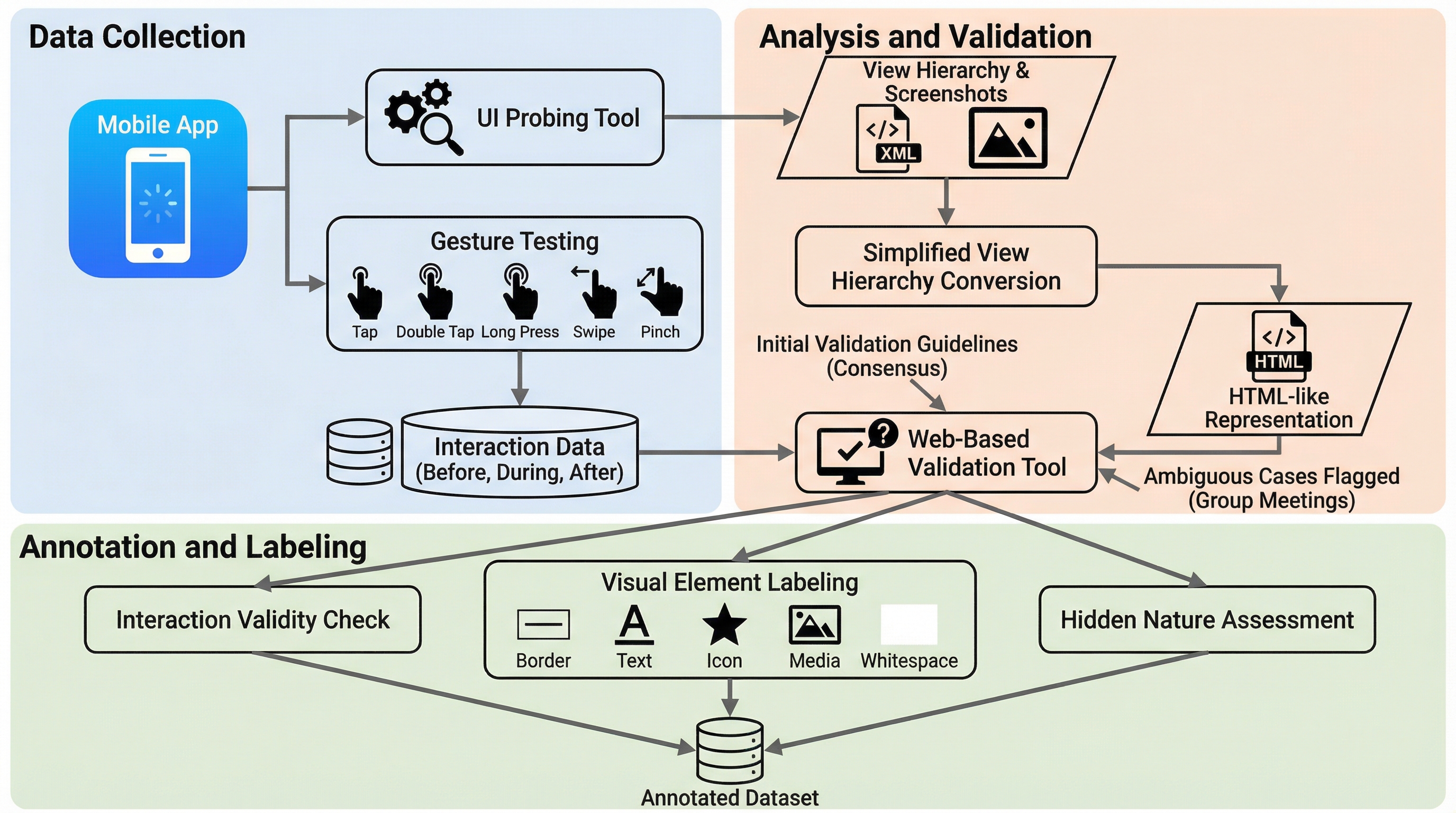

本研究は、モバイルUIにおける隠れたインタラクションを体系的に検出し、AIモデルがそれを理解・学習できるようにするための新しいデータセット「GhostUI」を提案した。このデータセットは、Google Playストアで人気の高い81種類のアプリケーションから収集された1,970件の隠れた操作のインスタンスで構成されている。GhostUIの最大の特徴は、単なる操作ログではなく、操作前のスクリーンショット、操作によって変化した後のスクリーンショット、簡略化されたHTML形式のビュー階層、詳細なジェスチャのメタデータ、そしてその操作がどのような目的で行われるかを示す自然言語によるタスク説明を一つのセットとして提供している点にある。これにより、AIは視覚的な手がかりがない状態からでも、適切な操作を予測するための多角的な情報を得ることができる。 研究チームは、隠れたインタラクションを定義するために3つの特性を確立した。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related