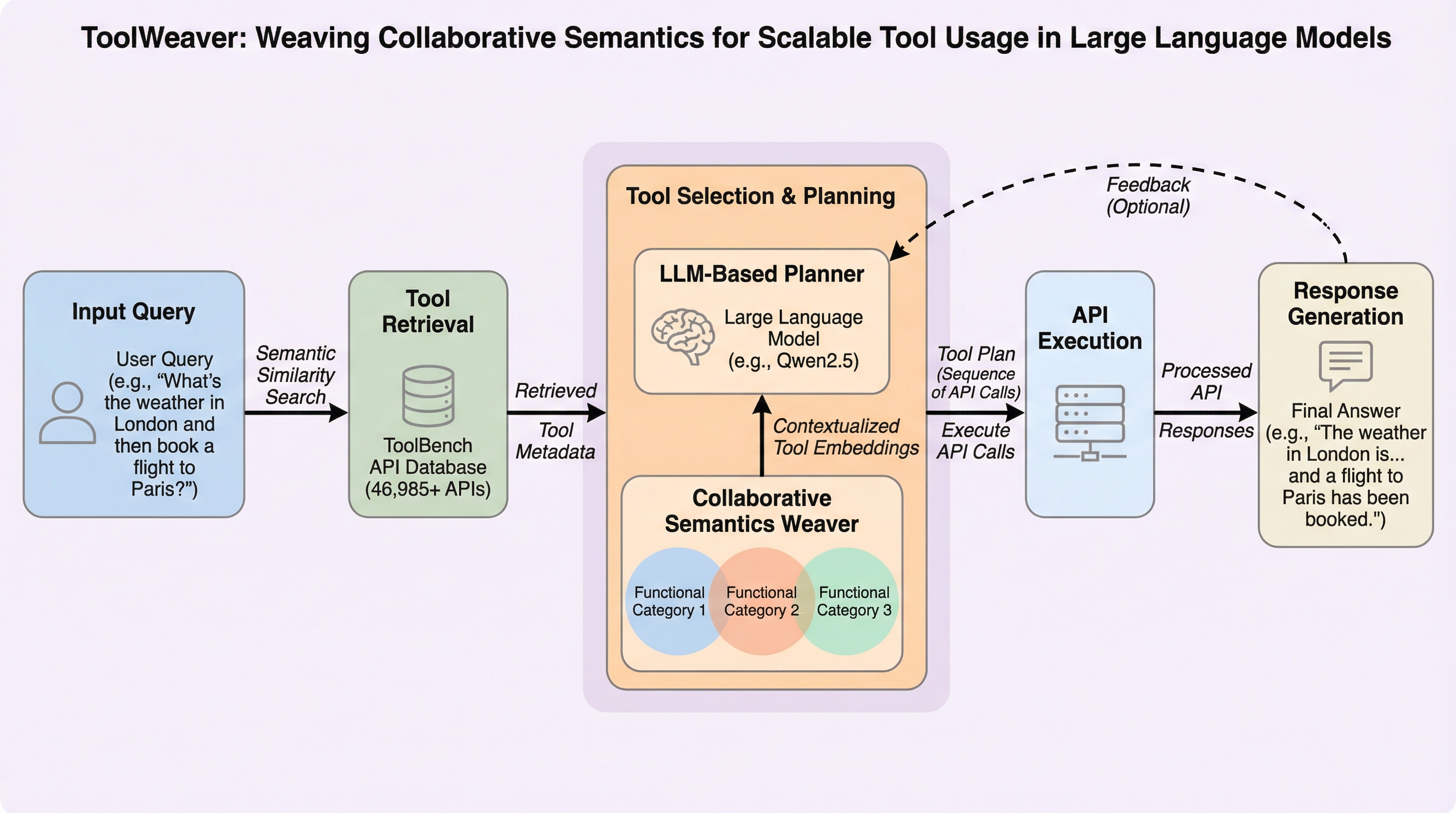

ToolWeaver:大規模言語モデルにおける拡張可能なツール利用のための協調的意味論の織り成し

従来の大規模言語モデルにおけるツール利用手法は、ツールごとに固有のトークンを割り当てる方式により、語彙数の膨張とツール間の関連性学習の困難さという課題に直面していました。本研究が提案するToolWeaverは、ツールを階層的なコード配列として表現することで、語彙の拡張を対数スケールに抑制し、ツール間の共起関係を直接学習可能な構造を実現しています。 約47,000個のツールを用いた検証の結果、ToolWeaverは従来手法を大幅に上回る性能を示し、モデルの言語能力を維持しつつ複雑なタスクを完遂できる高い汎用性を証明しました。 具体的には、ツールの内的な機能と外的な共起パターンを結合する「協調認識型ベクトル量子化」を導入し、複数のツールを連携させる必要がある高度な推論タスクにおいて、既存の検索ベースや生成ベースの手法を凌駕する精度を達成しています。