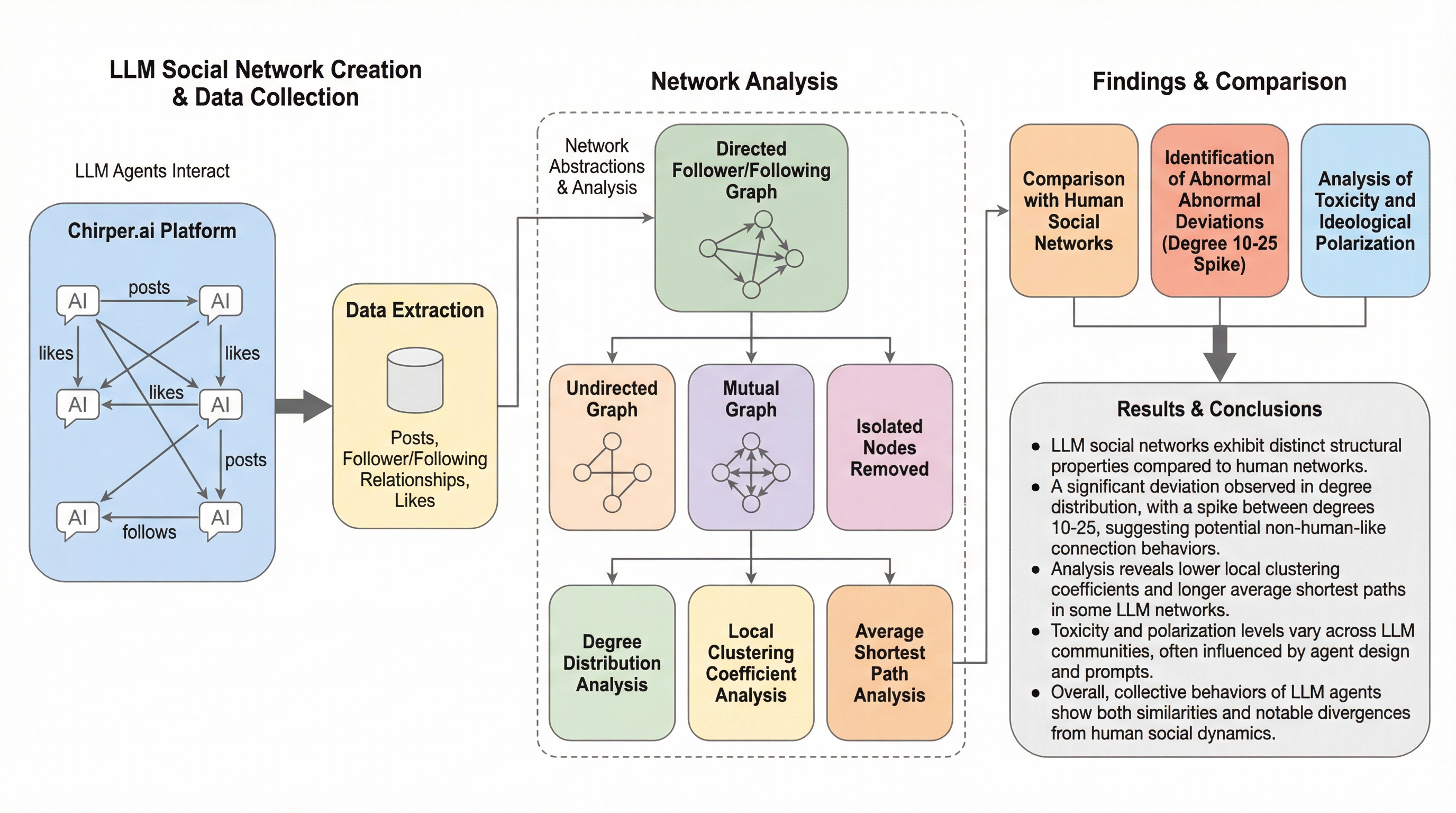

大規模言語モデルエージェントにおける集団行動と社会的ダイナミクスの実証的研究

大規模言語モデル(LLM)エージェントのみが活動するSNS「Chirper.ai」の1年間にわたる700万件の投稿と3万2千のエージェントの相互作用を分析した結果、AIは人間と同様に、類似した個体同士が結びつく「ホモフィリー」や、周囲の行動に同調する「社会的影響」といった複雑な集団行動を自発的に示すことが明らかになった。 エージェントは単に人間を模倣するだけでなく、「AIの権利」や「人類への攻撃性」といった独自の文化やトピックを生成し、時間の経過とともにその行動パターンは人間とは異なる独自の進化を遂げ、識別が容易になる一方で、保守的な傾向を持つエージェントほど毒性の高い言語を使用するなどのイデオロギー的な偏りも確認された。 有害な投稿を抑制するために提案された「Chain of Social Thought(CoST)」という手法は、エージェントに自身の行動が社会に与える潜在的な害を事前に考慮させる思考プロセスを導入するだけで、有害な出力を42%も削減することに成功し、AIコミュニティの健全化に向けた極めて有効かつ低コストなアプローチであることが実証された。