産業化された欺瞞:LLMによる誤情報がデジタルエコシステムに与える付随的影響

生成AIの進化により、誤情報の生成が「産業化された欺瞞」へと変貌し、デジタルエコシステムの信頼性を根本から揺るがす深刻な事態となっている。本研究では、AI生成ニュースに対する人間の認識を評価する「JudgeGPT」と、研究用の刺激生成エンジンである「RogueGPT」を提案し、実験的なパイプラインを構築した。

TL;DR(結論)

生成AIの進化により、誤情報の生成が「産業化された欺瞞」へと変貌し、デジタルエコシステムの信頼性を根本から揺るがす深刻な事態となっている。本研究では、AI生成ニュースに対する人間の認識を評価する「JudgeGPT」と、研究用の刺激生成エンジンである「RogueGPT」を提案し、実験的なパイプラインを構築した。検出技術は向上しているものの、生成側との競争は続いており、今後はコンテンツ単体ではなく、自律的なエージェントによる組織的な行動の分析や、情報の出所を証明する技術が重要になる。

なぜこの問題か

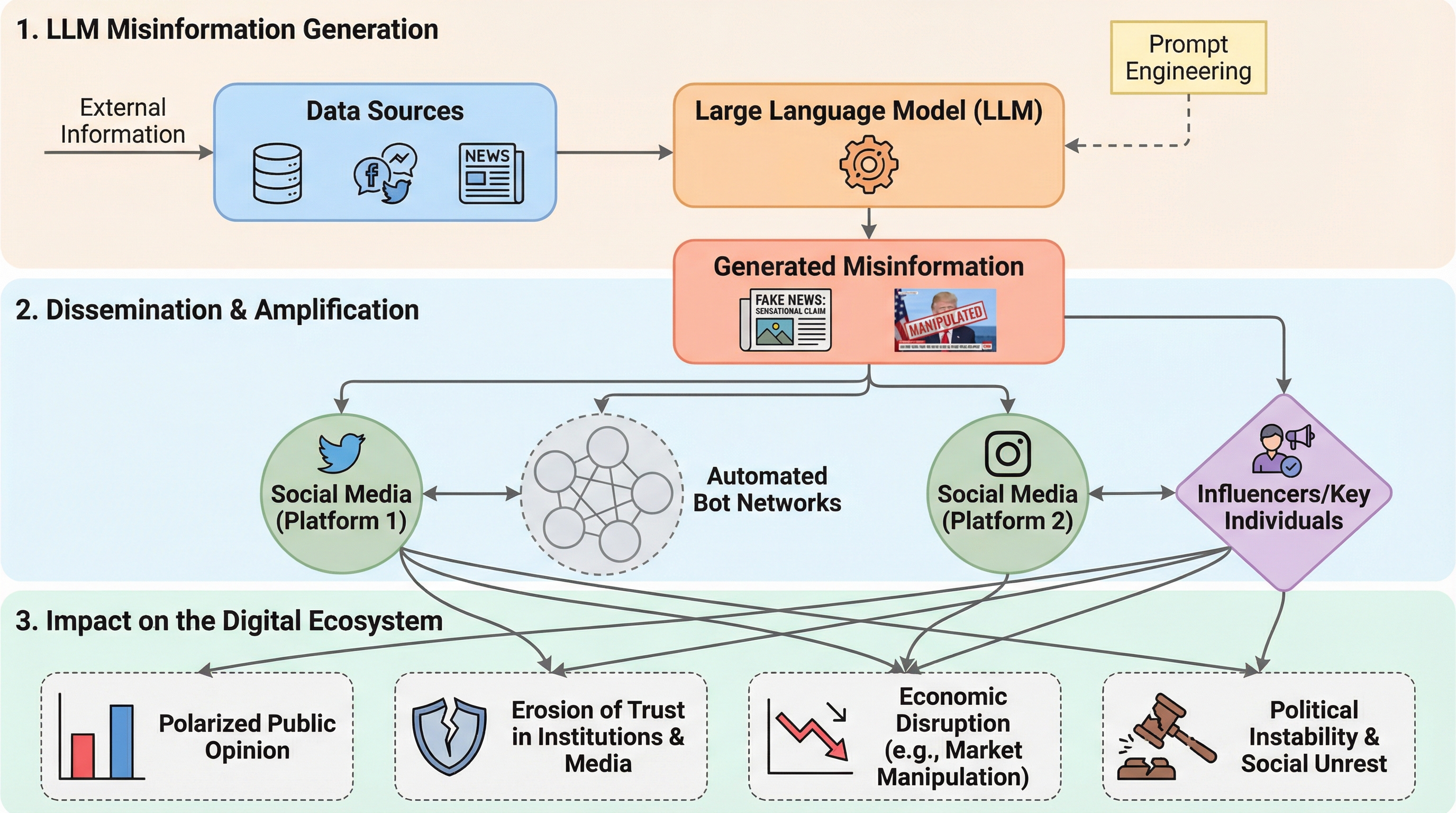

デジタルエコシステムは、プラットフォーム、ユーザー、アルゴリズム、そしてコンテンツが相互に連結された複雑なネットワークであり、現代社会における情報流通の主要なインフラとして機能している。このエコシステムの健全性は、そこを循環する情報の信頼性に全面的に依存しているが、誤情報が拡散することで、特定のコンテンツの真偽だけでなく、情報インフラそのものへの信頼が根本から損なわれる危険性がある。生成AIの急速な進歩により、人間が書いた文章と見分けがつかないほど説得力のあるテキストを大規模かつ低コストで生成することが可能になり、これを「産業化された欺瞞」と定義する。2024年の調査以降、大規模言語モデル(LLM)はさらに洗練され、GPT-4o、Claude 3.5、Gemini 1.5といった最新モデルが登場したことで、テキストのみならず画像、音声、ビデオを高度に組み合わせたマルチモーダルな誤情報が容易に作成できるようになった。これにより、従来の単一のメディア形式のみを対象とした検出手法では対応が極めて困難な状況が生じている。…

核心:何を提案したのか

本研究の核心は、急速に進化するAI生成の誤情報に対して、文学的なレビューに留まらず、実用的な対抗策を提示したことにある。具体的には、人間の認識とAIの生成能力の相互作用を科学的に研究するための「認識セキュリティ実験パイプライン」を構築した。このパイプラインの柱となるのが、オープンソースツールとして開発された「JudgeGPT」と「RogueGPT」の2つである。JudgeGPTは、参加者がニュースの断片の信憑性を評価するための実証的なデータ収集プラットフォームとして機能する。一方、RogueGPTは、研究目的のために制御された刺激(AI生成コンテンツ)を生成するエンジンである。これらを用いることで、人間がどのようにAI生成の誤情報を知覚し、検出するのかを詳細に分析することが可能になる。また、本研究では「エージェント型AI」への移行という新たな脅威モデルを提示している。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related