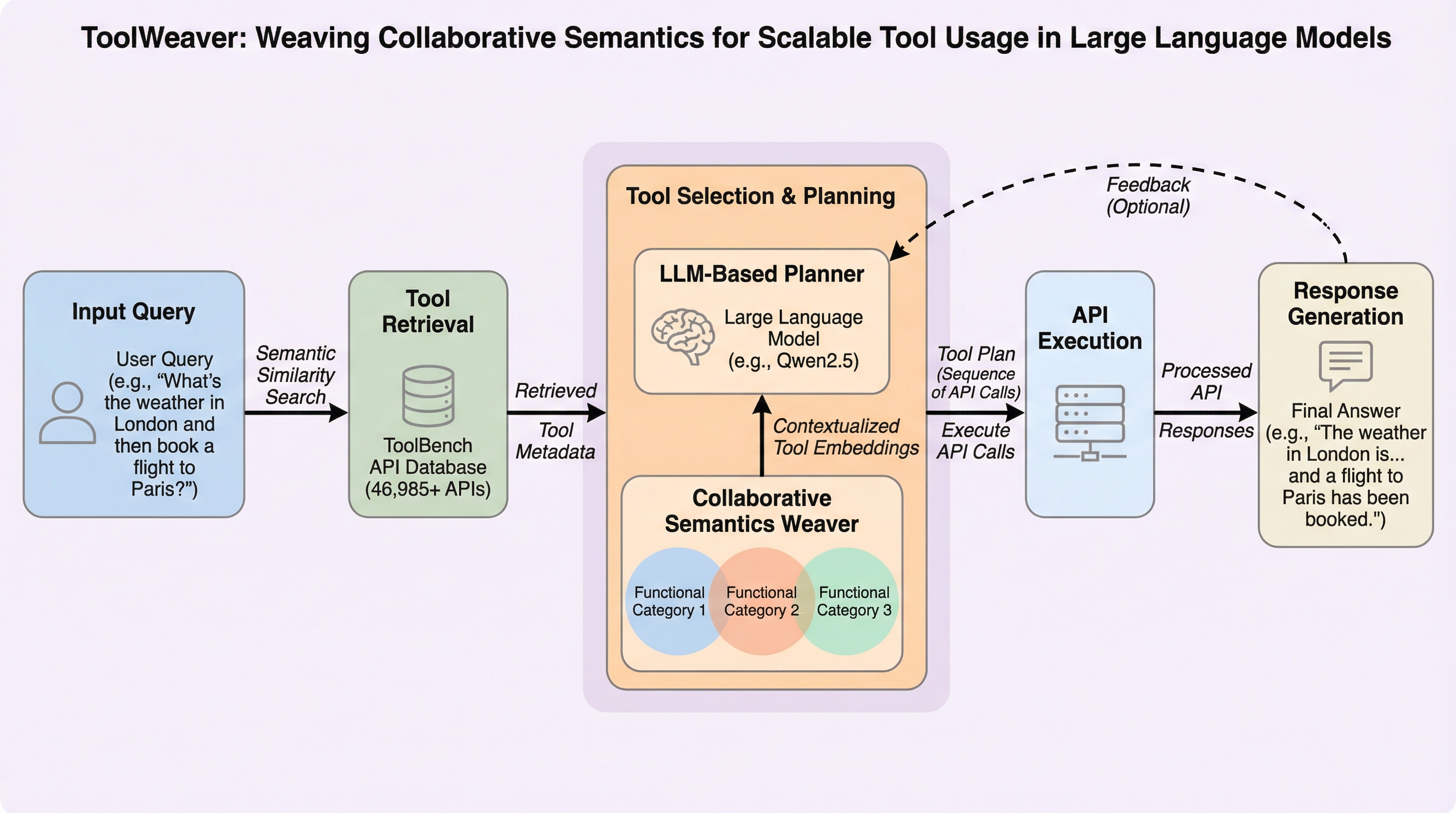

ToolWeaver:大規模言語モデルにおける拡張可能なツール利用のための協調的意味論の織り成し

従来の大規模言語モデルにおけるツール利用手法は、ツールごとに固有のトークンを割り当てる方式により、語彙数の膨張とツール間の関連性学習の困難さという課題に直面していました。本研究が提案するToolWeaverは、ツールを階層的なコード配列として表現することで、語彙の拡張を対数スケールに抑制し、ツール間の共起関係を直接学習可能な構造を実現しています。 約47,000個のツールを用いた検証の結果、ToolWeaverは従来手法を大幅に上回る性能を示し、モデルの言語能力を維持しつつ複雑なタスクを完遂できる高い汎用性を証明しました。 具体的には、ツールの内的な機能と外的な共起パターンを結合する「協調認識型ベクトル量子化」を導入し、複数のツールを連携させる必要がある高度な推論タスクにおいて、既存の検索ベースや生成ベースの手法を凌駕する精度を達成しています。

TL;DR(結論)

従来の大規模言語モデルにおけるツール利用手法は、ツールごとに固有のトークンを割り当てる方式により、語彙数の膨張とツール間の関連性学習の困難さという課題に直面していました。本研究が提案するToolWeaverは、ツールを階層的なコード配列として表現することで、語彙の拡張を対数スケールに抑制し、ツール間の共起関係を直接学習可能な構造を実現しています。 約47,000個のツールを用いた検証の結果、ToolWeaverは従来手法を大幅に上回る性能を示し、モデルの言語能力を維持しつつ複雑なタスクを完遂できる高い汎用性を証明しました。 具体的には、ツールの内的な機能と外的な共起パターンを結合する「協調認識型ベクトル量子化」を導入し、複数のツールを連携させる必要がある高度な推論タスクにおいて、既存の検索ベースや生成ベースの手法を凌駕する精度を達成しています。

なぜこの問題か

現在、大規模言語モデル(LLM)は外部ツールと連携することで、動的な情報へのアクセスや現実世界の複雑なタスクの実行を可能にする強力なエージェントへと進化を遂げています。しかし、利用可能なツールの数と多様性が飛躍的に増大する中で、適切なツールを選択し実行するためのスケーラビリティと汎用性が大きな課題となっています。既存の手法は主に検索ベースと生成ベースの2つに分類されますが、それぞれに固有の限界が存在します。検索ベースの手法は外部の検索器を用いて膨大なツール群から候補を選択しますが、これはLLMの入力長の制限を受けやすく、システム全体の複雑さを増大させる要因となります。一方で、LLMを微調整してツール呼び出しを直接生成させる生成ベースの手法は、エンドツーエンドの簡潔さを提供します。しかし、一般的な生成手法である「1つのツールに1つの専用トークンを割り当てる」方式には、2つの根本的な欠陥があります。 第一に、スケーラビリティと汎用性の問題です。ツールの数が増えるにつれて語彙サイズが線形に増加するため、メモリのオーバーヘッドが膨大になります。…

核心:何を提案したのか

本研究では、ツールの表現方法を根本から再考したフレームワークであるToolWeaverを提案しています。ToolWeaverの最大の特徴は、各ツールを単一のフラットな識別子ではなく、離散的なコードの構成的な配列として表現する点にあります。この階層的な構造は、新しく提案された教師なしの「協調認識型ベクトル量子化」を通じて生成されます。このアプローチにより、語彙の拡張をツールの数に対して線形ではなく対数スケールに抑えることが可能になります。これは、限られた数のコードトークンを組み合わせることで、膨大な数のツールを表現できるためです。さらに重要な点は、この構成的な表現がLLMの自己回帰的な性質と本質的に適合していることです。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related