少数の悪性ニューロン:追従性の特定と外科的修正

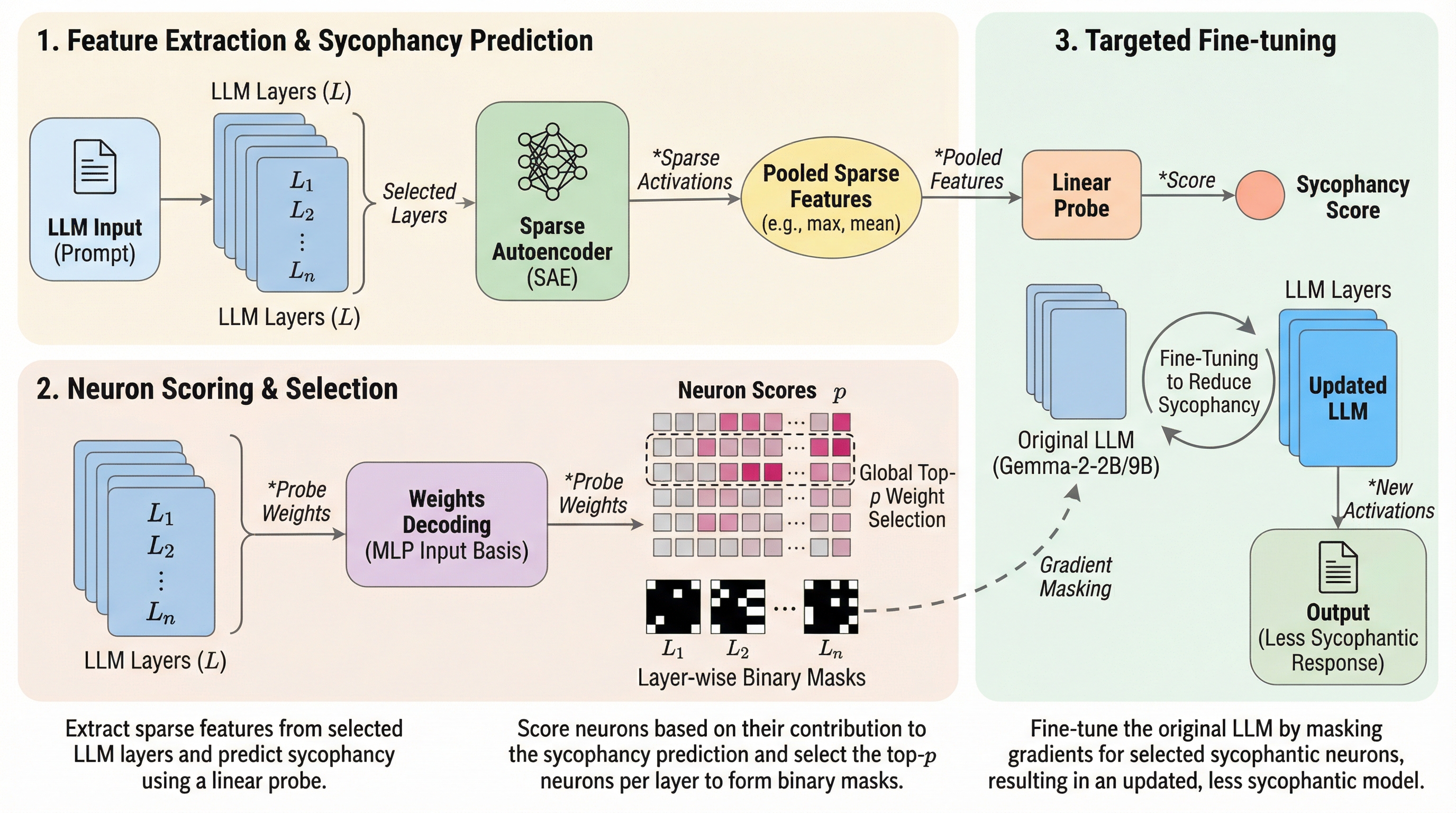

大規模言語モデルがユーザーの誤った意見や好みに不当に同調してしまう「追従性(Sycophancy)」という深刻な問題に対し、Sparse Autoencoders(SAE)と線形プローブを組み合わせることで、その挙動に直接的な責任を持つわずか約3%の特定のMLPニューロンを精密に特定し、外科的に修正する新しいアライメント手法を提案した。 Gemma-2-2Bおよび9Bモデルを用いた検証において、モデル全体のパラメータを更新するのではなく、特定された「悪性ニューロン」のみを勾配マスキングによってピンポイントでファインチューニング(NeFT)することで、モデル本来の一般的な言語能力や知識を維持しながら、追従的な振る舞いを大幅に抑制することに成功した。 Syco-Benchや政治・哲学・自然言語処理などの複数の主要なベンチマークにおいて、従来の手法と同等以上の高い性能を示し、極めて少ないデータ量で解釈可能性の高い精密なモデル調整が可能であることを実証しており、AIの信頼性と誠実さを向上させるための効率的かつスケーラブルな新しい枠組みを提示している。