RobustExplain:推薦のためのLLMベースの説明エージェントの堅牢性評価

推薦システムにおいてLLMを用いた説明エージェントは、ユーザーの行動履歴から自然言語で推薦理由を生成するが、誤クリックやデータの欠落といった現実的なノイズに対する堅牢性はこれまで十分に検証されていなかった。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

推薦システムにおいてLLMを用いた説明エージェントは、ユーザーの行動履歴から自然言語で推薦理由を生成するが、誤クリックやデータの欠落といった現実的なノイズに対する堅牢性はこれまで十分に検証されていなかった。

DualAgent-Recは、LLMを高度なオーケストレーターとして活用し、推薦精度と多様性の最適化、および公平性や出品者カバレッジといった厳しいビジネス制約の完全な遵守を両立させる新しいマルチエージェント・フレームワークです。

vllm-mlxは、Apple Siliconのユニファイドメモリ構造を最大限に活用するためにMLX上でネイティブに構築された、LLMおよびマルチモーダルLLM(MLLM)のための高効率な推論フレームワークである。継続的バッチ処理の導入により、従来のllama.

本研究は、システムモデルが未知で一部の出力しか観測できない離散時間線形システムにおいて、方策勾配法を用いてシステムを安定化させる静的出力フィードバック制御器を直接学習する新しいアルゴリズム枠組みを提案しました。

PROTEUSは、LLMの運用者が実行時に精度目標($\tau$)を直接入力できる革新的なポリモーフィック・ルーターであり、ラグランジュ双対制御を導入することで、単一の学習済みモデルのみで多様なサービスレベル契約(SLA)に即座に対応することを可能にしました。

従来の自動コードレビュー(ACR)の評価は、GitHubの生のプルリクエストデータに依存していたため、正解データの網羅性が低く、特定の言語に偏っているという課題がありました。本研究が提案する「AACR-Bench」は、10種類の主要言語と50のリポジトリを対象とし、80名の熟練エンジニアと最新AIモデルを組み合わせた検証パイプラインにより、問題の網羅率を従来比で285%向上させた画期的なベンチマークです。検証の結果、リポジトリレベルの文脈提供やエージェント構成の採用がモデルの性能に与える影響は、使用する言語やモデルの特性によって大きく異なることが明らかになり、今後の自動レビュー技術開発における重要な指針を提示しました。

ALRMは、大規模言語モデル(LLM)をロボット操作の計画と実行に統合する新しいエージェント型フレームワークであり、ReAct形式の推論ループを用いることで、実行結果の振り返りと計画の動的な修正を可能にしました。

拡散言語モデル(DLM)において、注意機構の計算過程で不要な情報を逃がす「シンク(掃き出し口)」となるトークンの位置がステップごとに不規則に変動する「移動シンク現象」が、生成の不安定性や性能低下の主要因であることを特定しました。

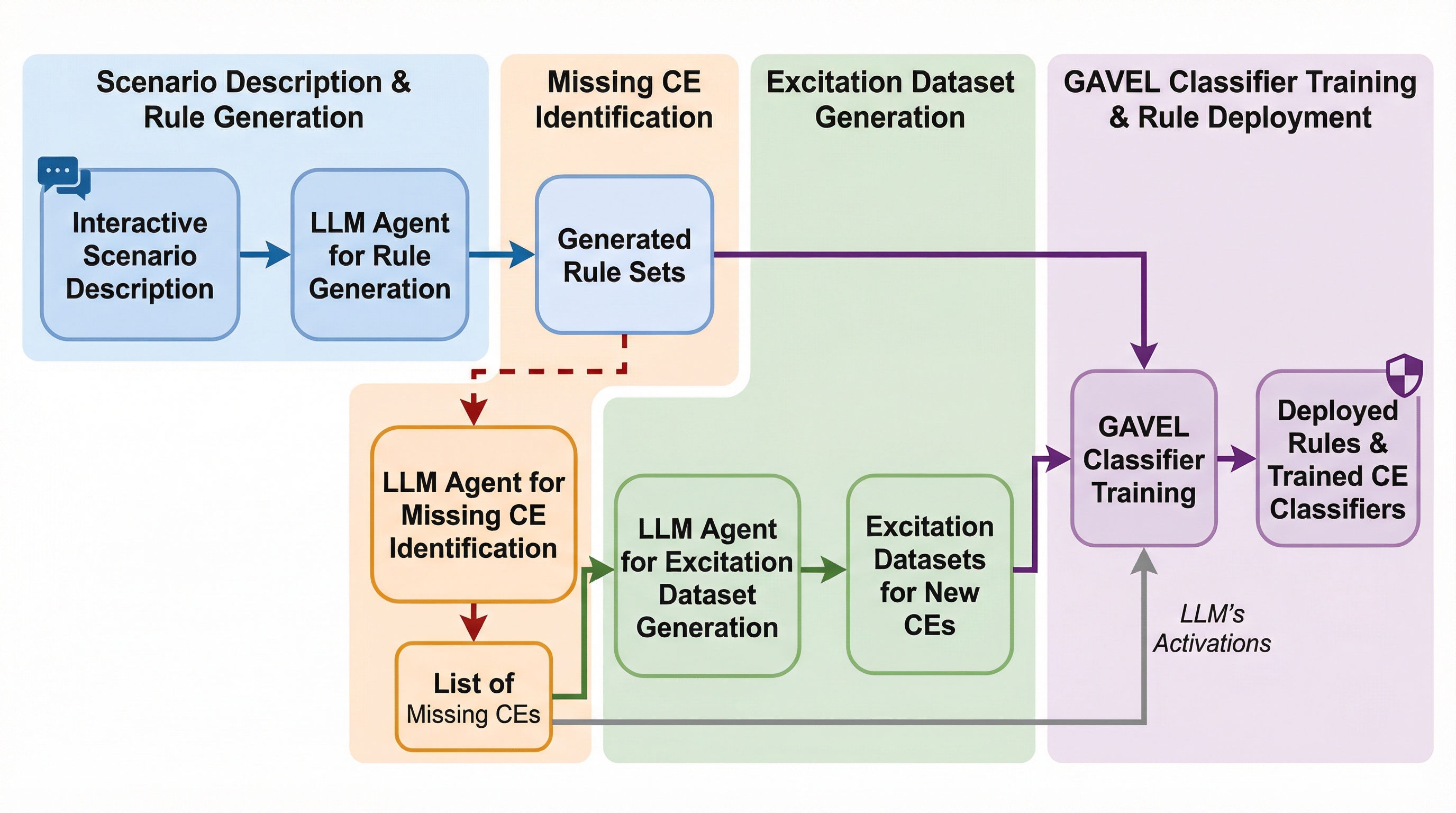

従来のLLMセーフティ技術は、表面的なテキストの監視では回避されやすく、内部のアクティベーションを利用する手法も広範なデータセットに依存するため精度や柔軟性、解釈性に課題がありました。本論文は、サイバーセキュリティのルール共有慣行に触発された「GAVEL」という新しいフレームワークを提案し、モデル内部の微細で解釈可能な要素である「認知要素(CE)」を定義して論理的なルールで監視する手法を導入しました。このアプローチにより、モデルの再学習を行うことなく、特定のドメインに合わせた高度な安全策をリアルタイムで構成・更新することが可能になり、AIガバナンスにおける透明性と監査の容易さを大幅に向上させています。

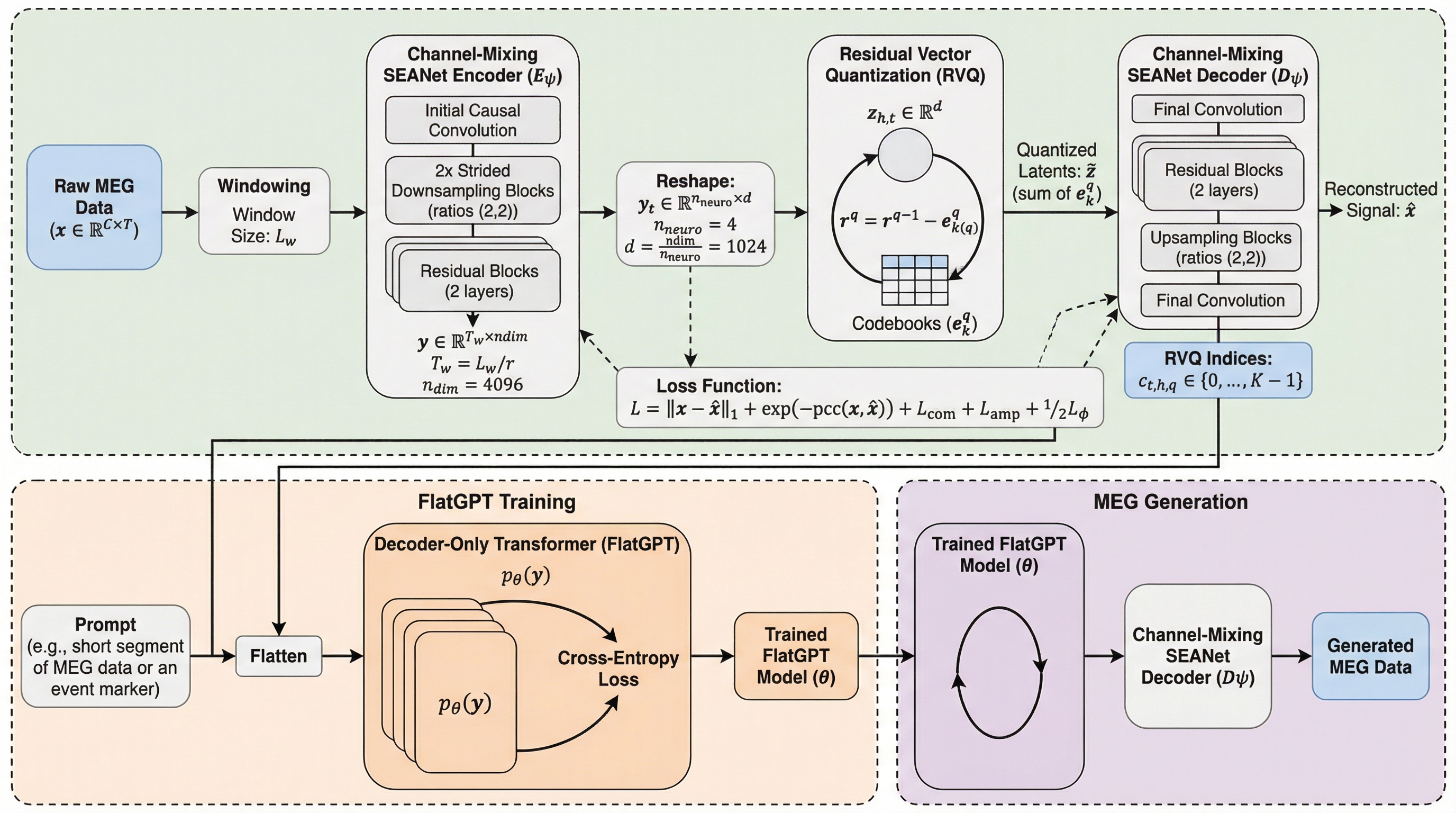

本研究では、500時間以上の大規模なMEG(磁気脳鳴図)データセットであるCamCAN、Omega、MOUSを統合し、多チャネルの脳信号を離散的なトークン列として予測する大規模自己回帰モデル「FlatGPT」を構築した。