ALRM: ロボット操作のためのエージェント型LLM

ALRMは、大規模言語モデル(LLM)をロボット操作の計画と実行に統合する新しいエージェント型フレームワークであり、ReAct形式の推論ループを用いることで、実行結果の振り返りと計画の動的な修正を可能にしました。

TL;DR(結論)

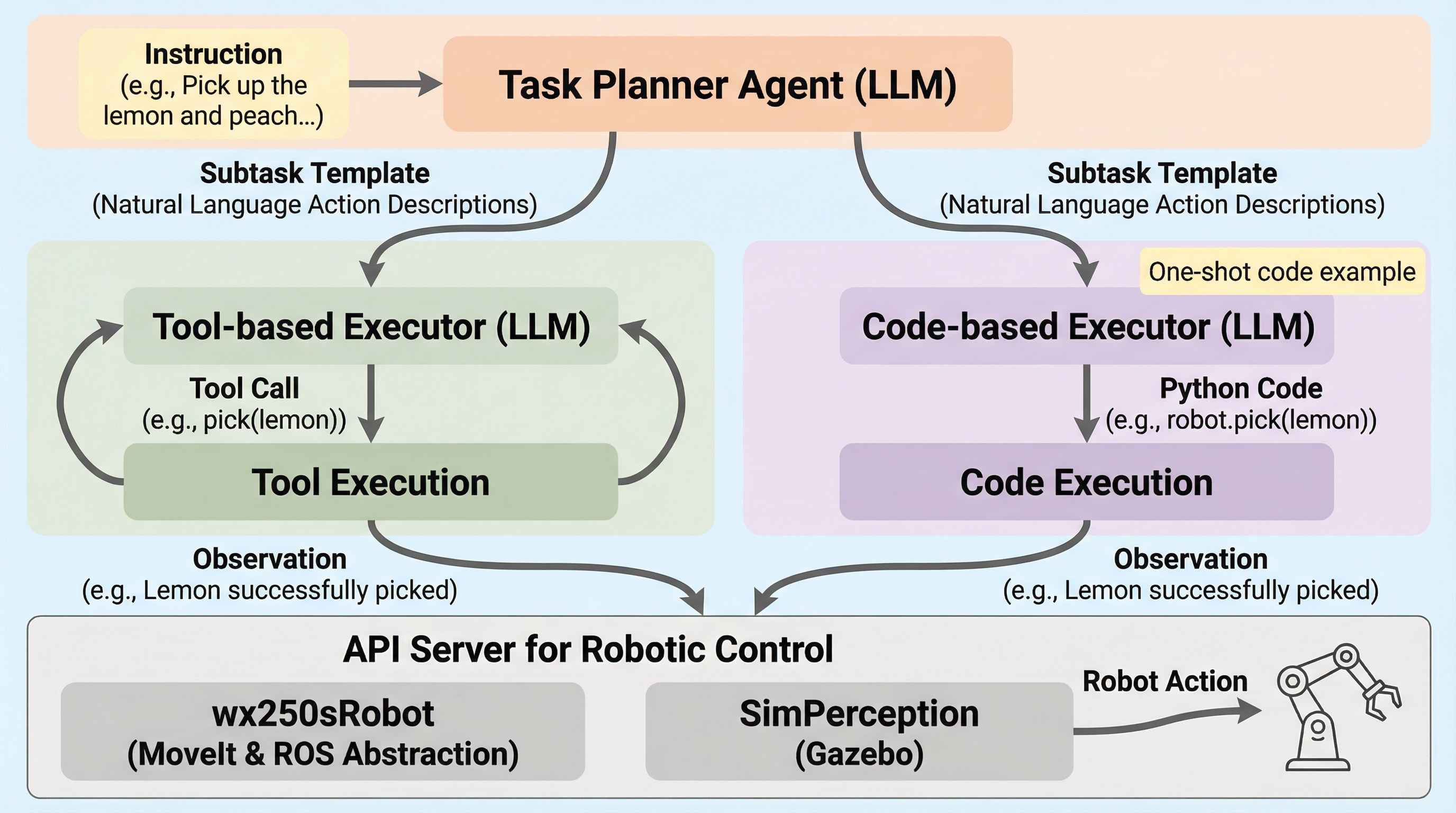

ALRMは、大規模言語モデル(LLM)をロボット操作の計画と実行に統合する新しいエージェント型フレームワークであり、ReAct形式の推論ループを用いることで、実行結果の振り返りと計画の動的な修正を可能にしました。 このシステムは、実行可能なPythonコードを生成するCode-as-Policy(CaP)と、モデルのツール呼び出し機能を利用するTool-as-Policy(TaP)という2つの実行モードを使い分けることで、複雑な多段階タスクへの適応力を高めています。 評価のために言語的多様性と多段階推論を重視した56種類のタスクを含む新ベンチマークを導入し、実験ではClaude-4.1-Opusが90%以上の成功率で首位となり、オープンソースではFalcon-H1-7Bが優れた性能と低遅延を両立することを実証しました。

なぜこの問題か

従来のロボットシステムは、あらかじめプログラムされた明示的なタスク仕様に基づいて構築されており、制御ロジックは手動で記述された振る舞いとしてエンコードされてきました。これらのシステムは、ロボットオペレーティングシステム(ROS)やMoveItといったミドルウェア、ハードウェア抽象化APIなどの多層的なソフトウェアスタックに依存して、知覚、計画、および作動を調整しています。長年の研究により制御や知覚のための高度に最適化されたモジュールが生み出されてきましたが、これらのコンポーネントは依然として硬直的でドメイン固有であり、新しいタスクへの一般化や環境の変化に対する動的な適応が困難であるという課題があります。 近年の大規模言語モデル(LLM)の進歩は、自然言語生成にとどまらず、コード合成、画像解釈、ツールの使用、記号的推論など、多様な領域で強力な能力を解放しました。これにより、LLMを埋め込み型AIの基盤として活用し、非構造化言語の解釈や記号的な目標に対する推論、APIを介した制御の自動化を行う可能性が開かれました。しかし、これまでのLLMをロボット工学に統合する試みには、いくつかの制限が存在しています。…

核心:何を提案したのか

本論文では、LLMベースのアクション生成とエージェント実行を組み合わせた、ロボット操作のための新しいフレームワークであるALRM(Agentic LLM for Robot Manipulation)を提案しています。ALRMの最大の特徴は、専門化されたエージェントがタスクの計画と実行を分担して処理する、モジュール化されたエージェントアーキテクチャにあります。このフレームワークは、ReAct(Reasoning and Acting)スタイルのループを採用しており、システムが目標について反復的に推論し、実行状況を監視し、必要に応じて計画を修正することを可能にしています。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related