分解と形式化:再帰的に検証可能な自然言語推論

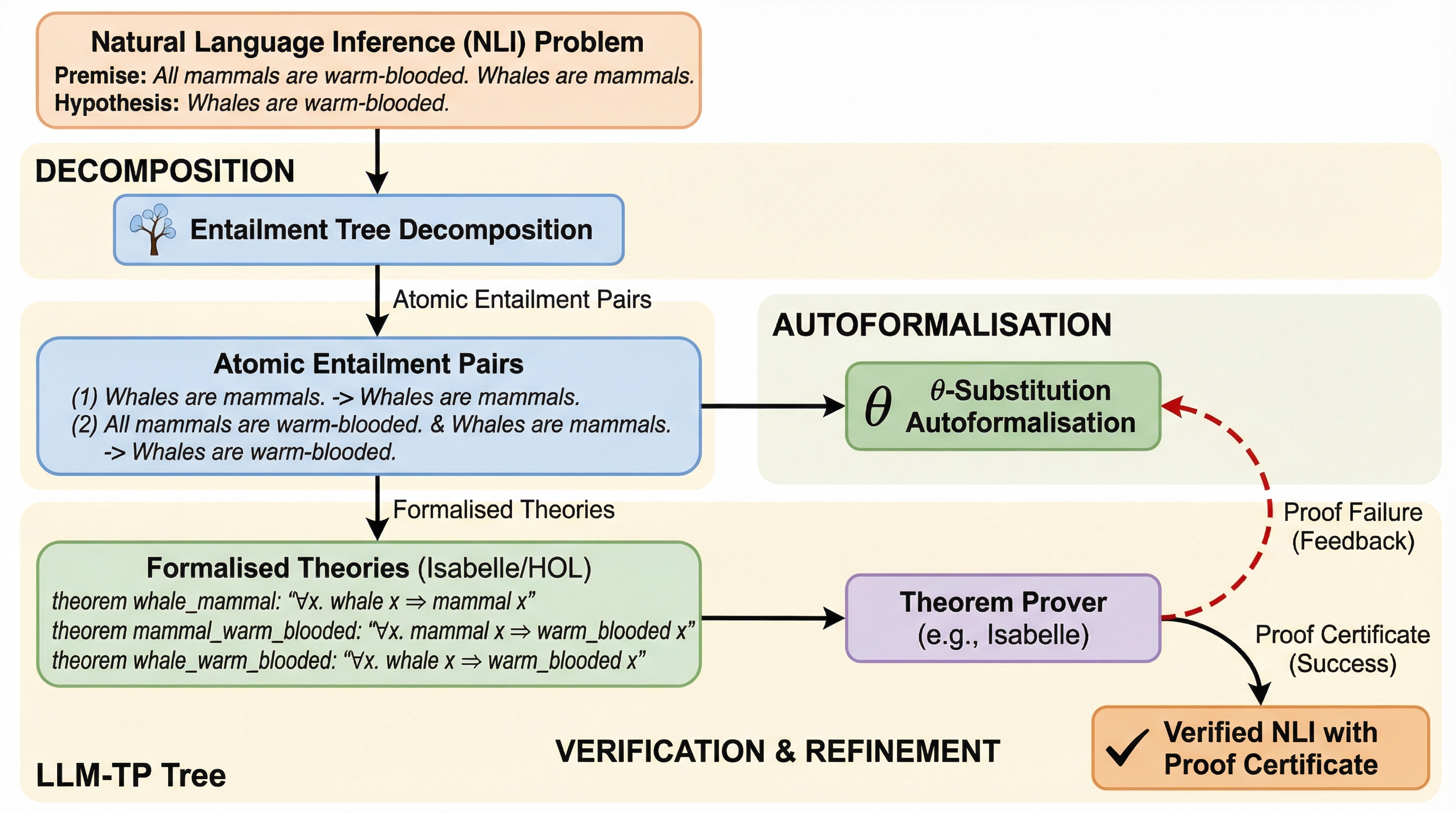

自然言語推論において、大規模言語モデルと定理証明器を統合する際の課題であった、長文や複雑な構文に起因する形式化エラーと、それによる推論チェーン全体の破綻を解決するため、推論過程を「含意ツリー」として構造化し、各ステップを最小単位の命題に分解して再帰的に検証・修正するフレームワーク「LLM-TP Tree」を提案しました。 この手法では、文を最小単位に切り分ける「原子的分解」と、イベントベースの論理形式で意味的な役割結合を厳密に管理する「$\theta$置換」を導入することで、定理証明器との互換性と元の文章への忠実性を両立させ、失敗した箇所のみを特定して局所的に修正する効率的なプロセスを実現しています。 5つの最新の大規模言語モデルを用いた評価の結果、従来手法と比較して検証成功率を最大48.9%向上させ、修正のための反復回数や実行時間を大幅に削減しながら、高い推論精度を維持することに成功し、複雑な多段階推論を論理的に厳密な形で検証できる実用的な可能性を示しました。