不変軌道学習による一般化可能なマルチモーダル大規模言語モデル編集

マルチモーダル大規模言語モデル(MLLM)の知識編集において、従来の固定的なマッピングが引き起こす「因果的な過小適合」と「因果的な過学習」を解決するため、編集を分布外(OOD)汎化問題として再定義しました。

TL;DR(結論)

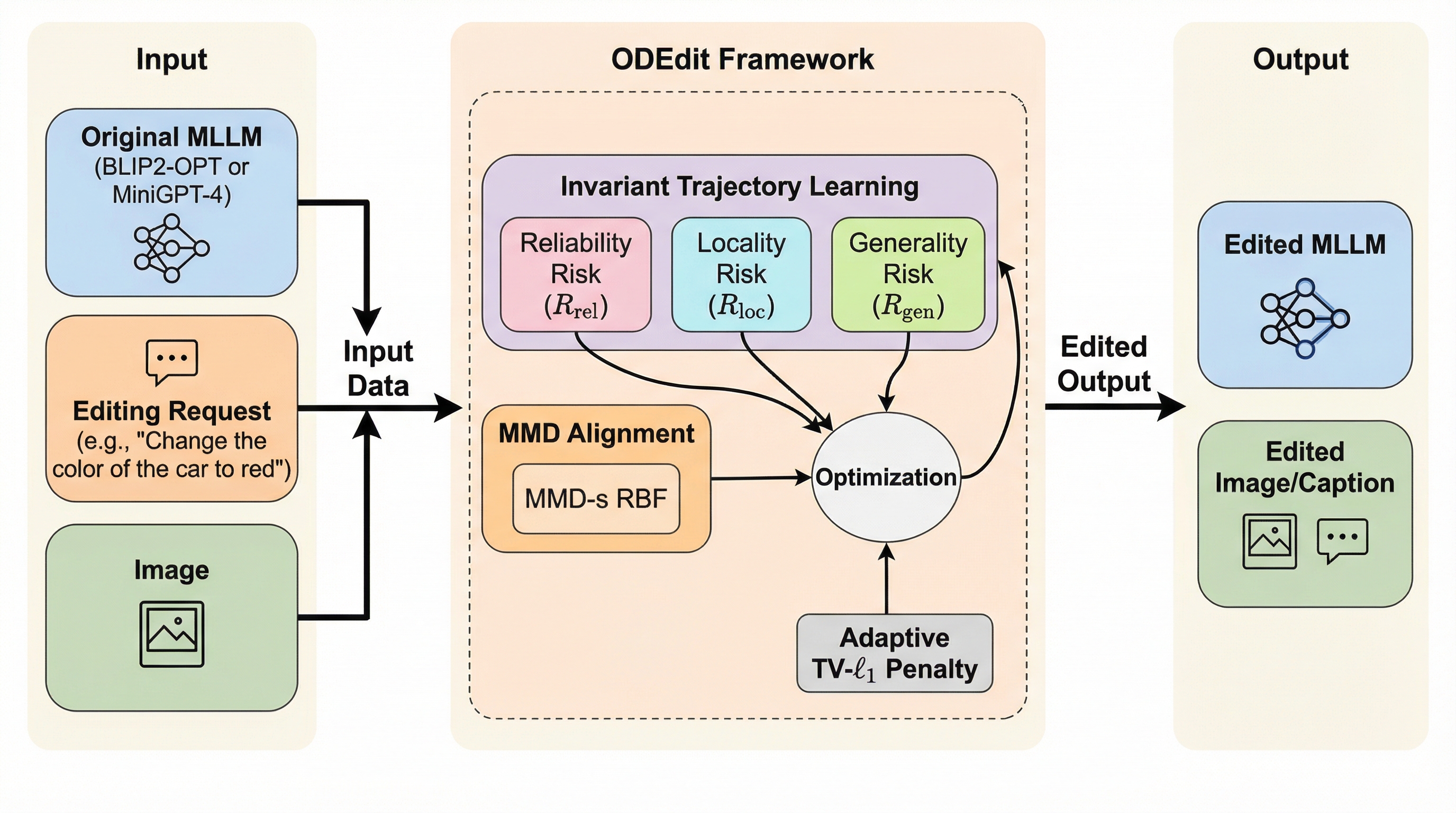

マルチモーダル大規模言語モデル(MLLM)の知識編集において、従来の固定的なマッピングが引き起こす「因果的な過小適合」と「因果的な過学習」を解決するため、編集を分布外(OOD)汎化問題として再定義しました。 意味的変化と事実的変化を識別する三部構成のOODリスク目的関数と、環境の変化に左右されない「不変軌道学習(ETIL)」を導入することで、多様なクロスモーダルなプロンプトに対する堅牢な編集を実現しました。 理論的解析と広範な実験により、提案手法「ODEdit」は既存の編集手法に組み込み可能なプラグアンドプレイな枠組みとして、編集の信頼性、局所性、汎用性を同時に向上させることを実証しました。

なぜこの問題か

大規模言語モデル(LLM)の知識を効率的に修正する技術は、モデルの正確性と最新性を保つために極めて重要ですが、これをマルチモーダル大規模言語モデル(MLLM)に適用する際には特有の困難が伴います。MLLMの計算グラフは、単一モダリティの知覚、クロスモーダルな整列、そして共有された意味推論という一連の因果チェーンで構成されています。既存の編集手法は、パラメータの直接的な調整や補助的なコンポーネントの追加を通じて出力を変化させますが、これらは限られた学習事例からの固定的なマッピングに依存しています。このアプローチは、MLLMにおいて「因果的な過小適合」と「因果的な過学習」という二つの深刻な問題を引き起こします。 因果的な過小適合とは、多様なクロスモーダルな文脈に共通する因果構造を分離できないために、意味的な汎用性が失われ、単なる事例ごとの調整に留まってしまう現象です。これにより、モデルは再利用可能な意味の基盤を発見できなくなります。…

核心:何を提案したのか

本研究では、MLLMの編集を「分布外(OOD)汎化問題」として捉え直す新しい最適化フレームワーク「ODEdit」を提案しました。OOD汎化とは、分布のシフトを引き起こす不変な特徴と偽の相関を識別し、未知のドメインへ適応する能力を指します。MLLMの編集において、プロンプトの因果的範囲を二つの分布シフトに分割して定義しました。第一に「意味的シフト(Semantic-shift)」であり、これは編集対象の知識が類似の文脈や言い換えに波及する汎用性の側面です。第二に「事実的シフト(Factual-shift)」であり、これは編集対象外の無関係な概念へと移行する局所性の側面です。 ODEditの核心は、クロスモーダルな予測のための「不変な因果軌道」を特定し、因果関係を乱す偽の要因を排除することにあります。具体的には、意味的シフトと事実的シフトを明示的に区別するための三部構成のOODリスク目的関数を導入しました。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related