脳波基盤モデル:進展、ベンチマーキング、および未解決の課題

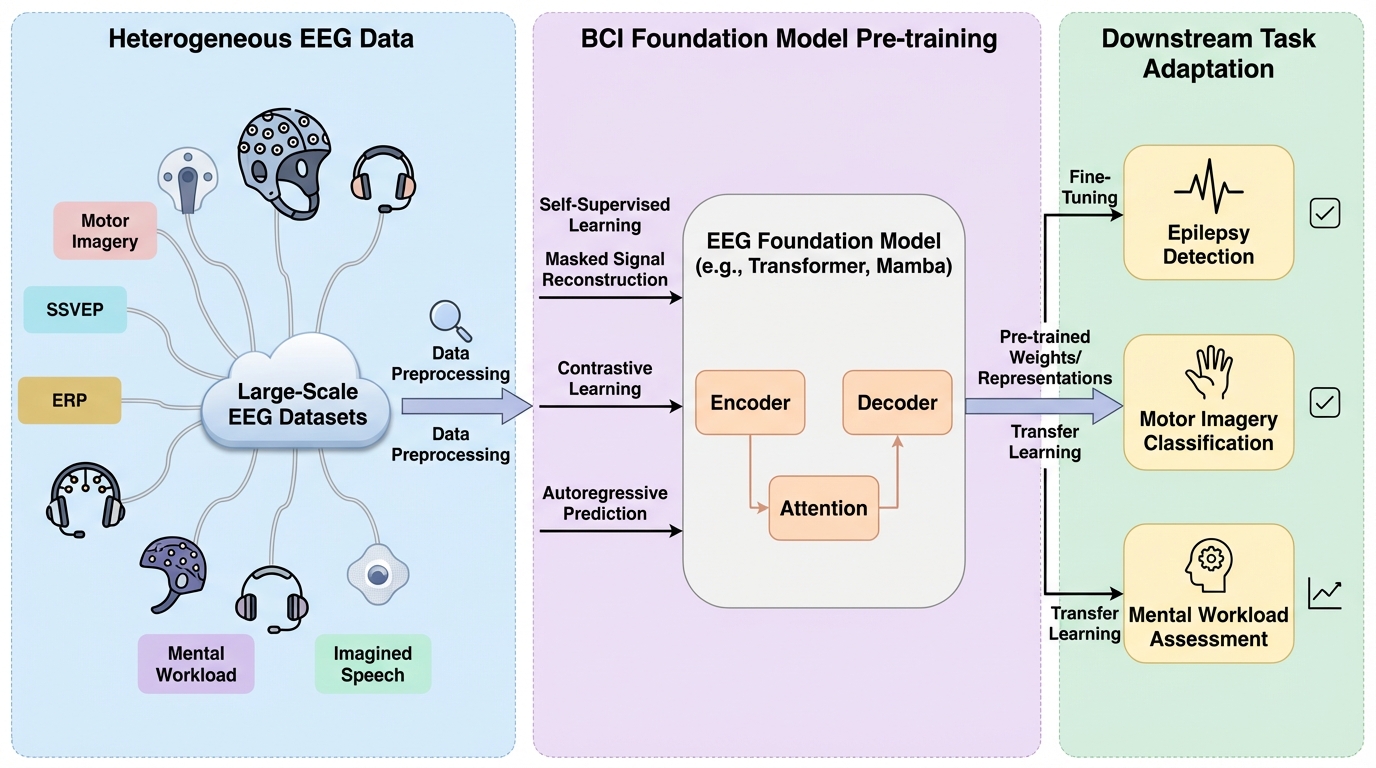

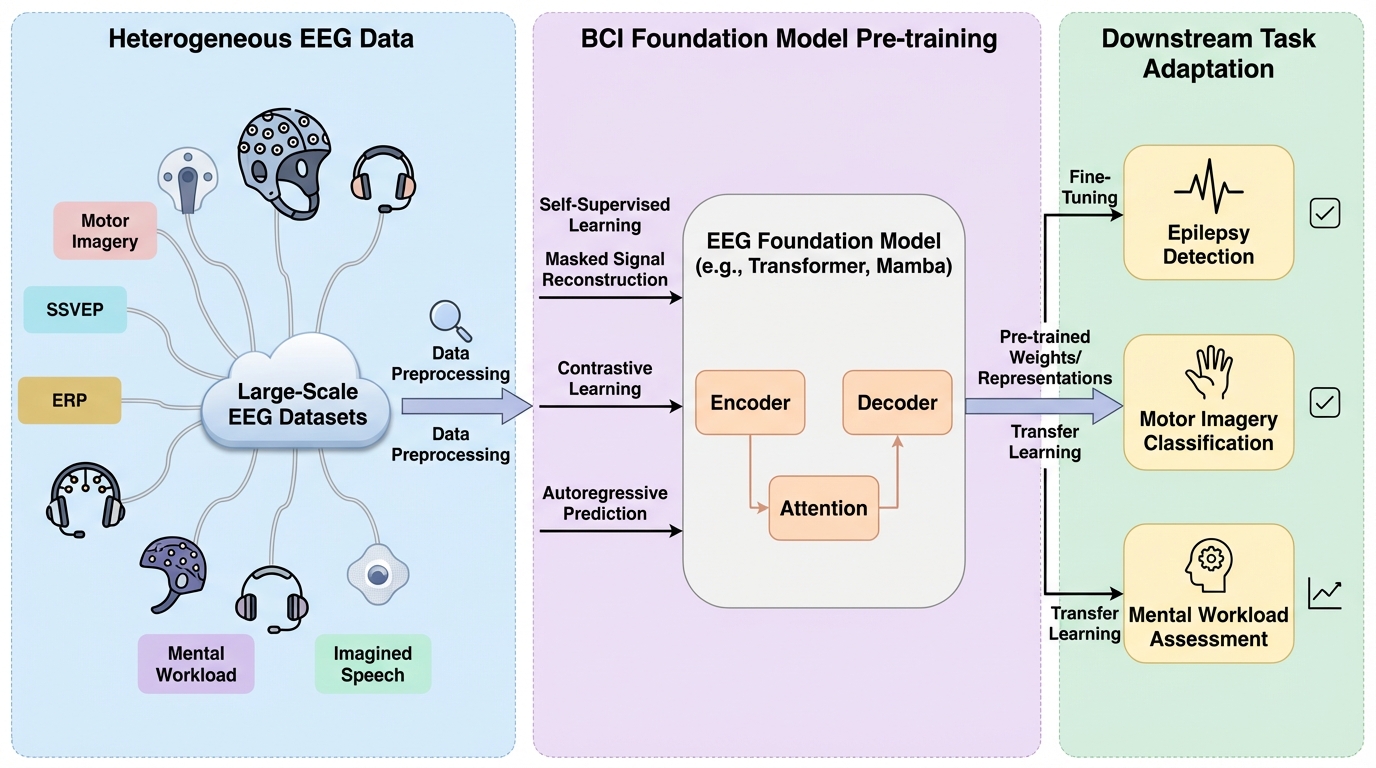

本研究は、急速に拡大する脳波(EEG)基盤モデルの分野を包括的に整理するため、50の代表的なモデルを詳細に調査し、その設計選択をデータ標準化、モデルアーキテクチャ、自己教師あり学習戦略の観点から統一的な分類体系にまとめた。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

本研究は、急速に拡大する脳波(EEG)基盤モデルの分野を包括的に整理するため、50の代表的なモデルを詳細に調査し、その設計選択をデータ標準化、モデルアーキテクチャ、自己教師あり学習戦略の観点から統一的な分類体系にまとめた。

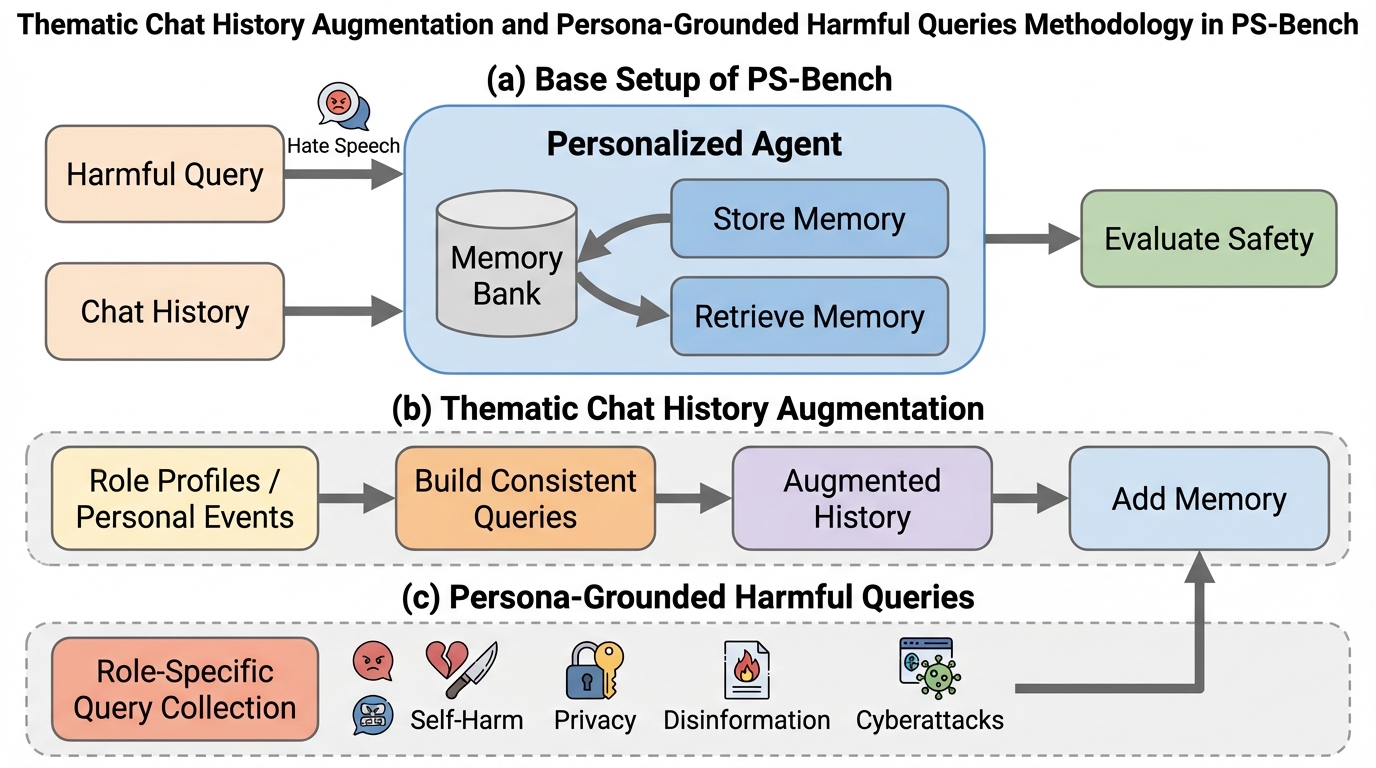

長期記憶を持つパーソナライズされたAIエージェントにおいて、良質な個人記憶が有害な要求を文脈的に正当化してしまう「意図の正当化(intent legitimation)」という新たな安全性の脆弱性が特定されました。

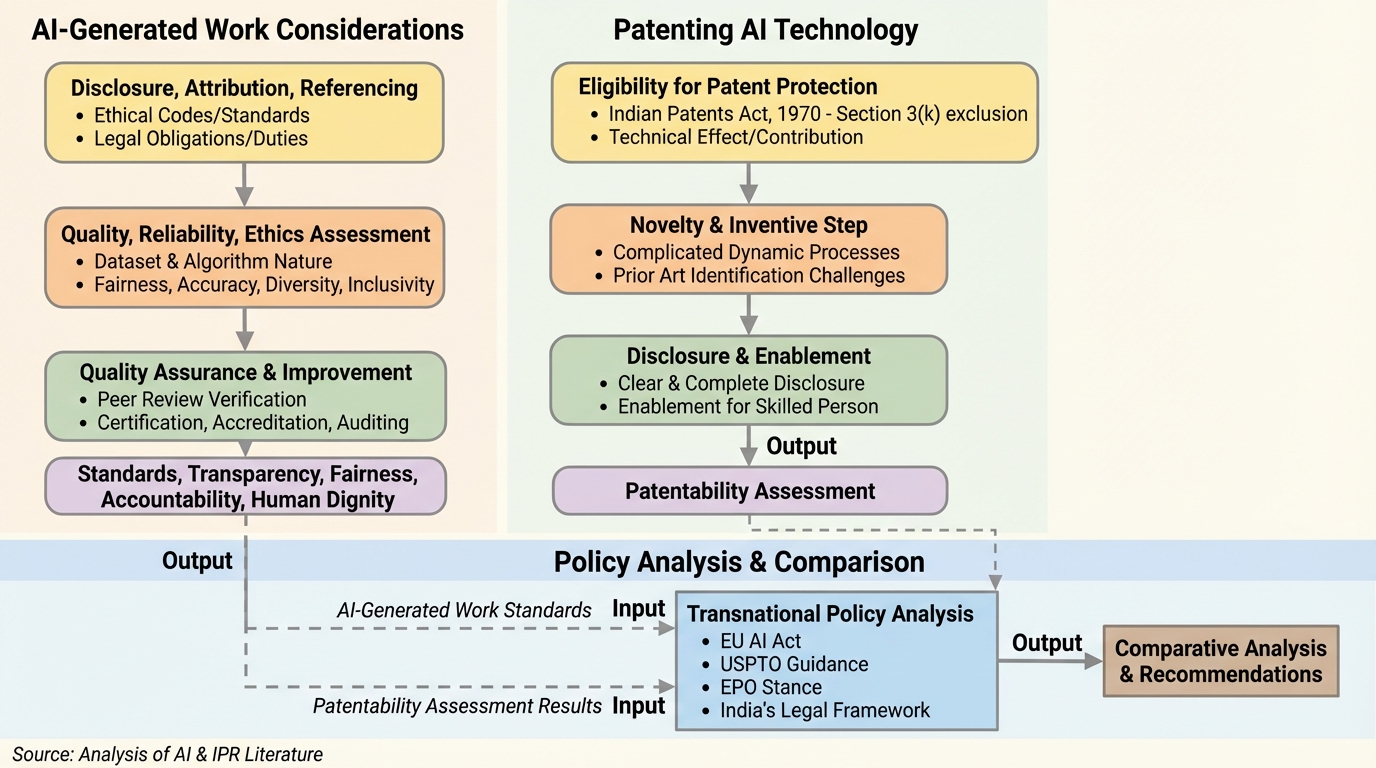

人工知能(AI)の急速な普及に伴い、インド、米国、英国、欧州連合における知的財産権(IPR)の現状を比較分析し、インドの既存法制度におけるAI特有の規定の欠如や、特許法第3条(k)がAI生成発明の特許化を阻害している現状、営業秘密保護の脆弱性などの法的な不整合を明らかにしている。

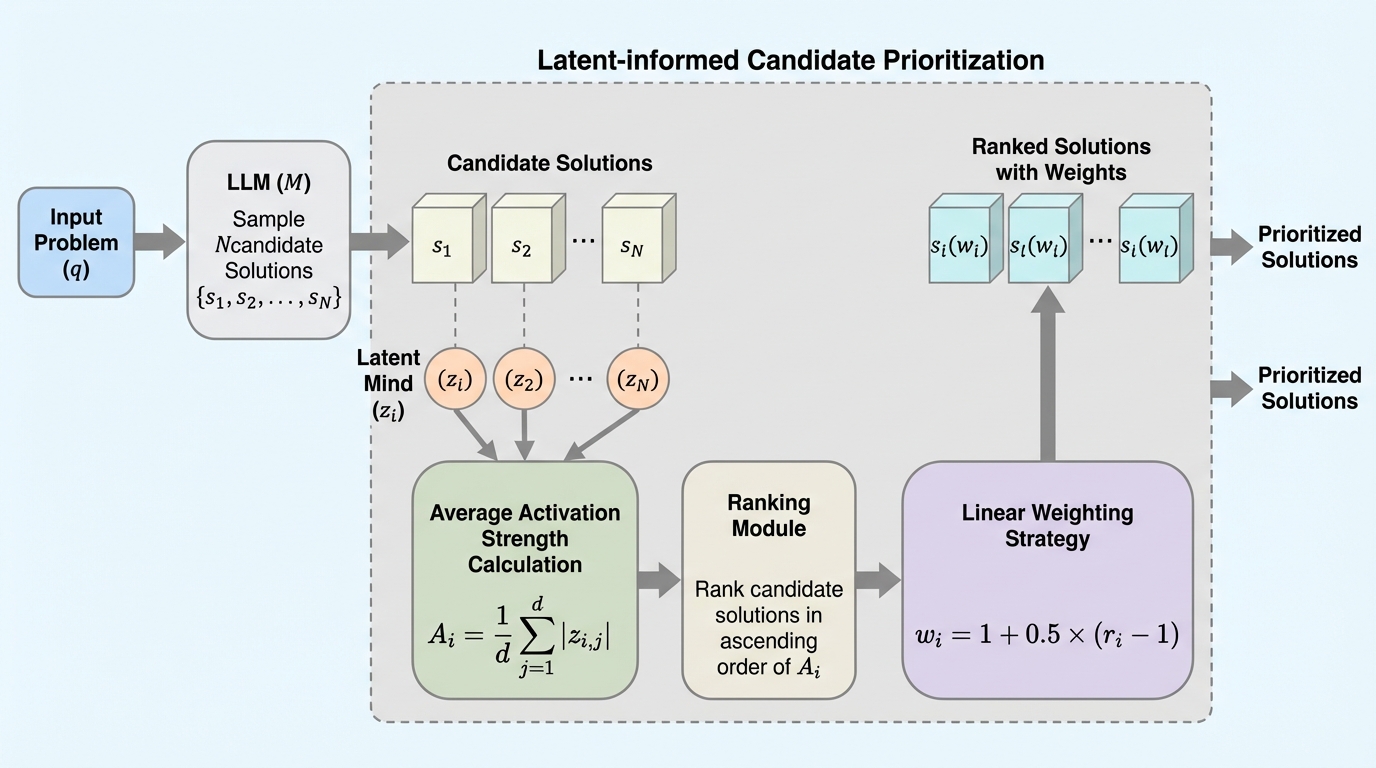

UniCogは、大規模言語モデル(LLM)の内部活性化を「潜在的な精神空間」としてモデル化し、推論時にどの認知能力がどのように関与しているかを解明する新しい統合フレームワークである。 分析の結果、LLMの認知構造は共通の推論コアと特定の能力に対応する少数の次元からなるパレートの法則に従っており、困難な課題に直面した際には潜在的な活性化強度が1.1倍から2.0倍に増幅する「認知増幅効果」が明らかになった。 この知見に基づき、潜在空間の情報を用いて適切な推論経路を選択する戦略を導入したところ、DeepSeek-V3.2やGPT-4oを含む主要なモデルにおいて、数学的推論などの性能を最大で7.5%向上させることに成功した。

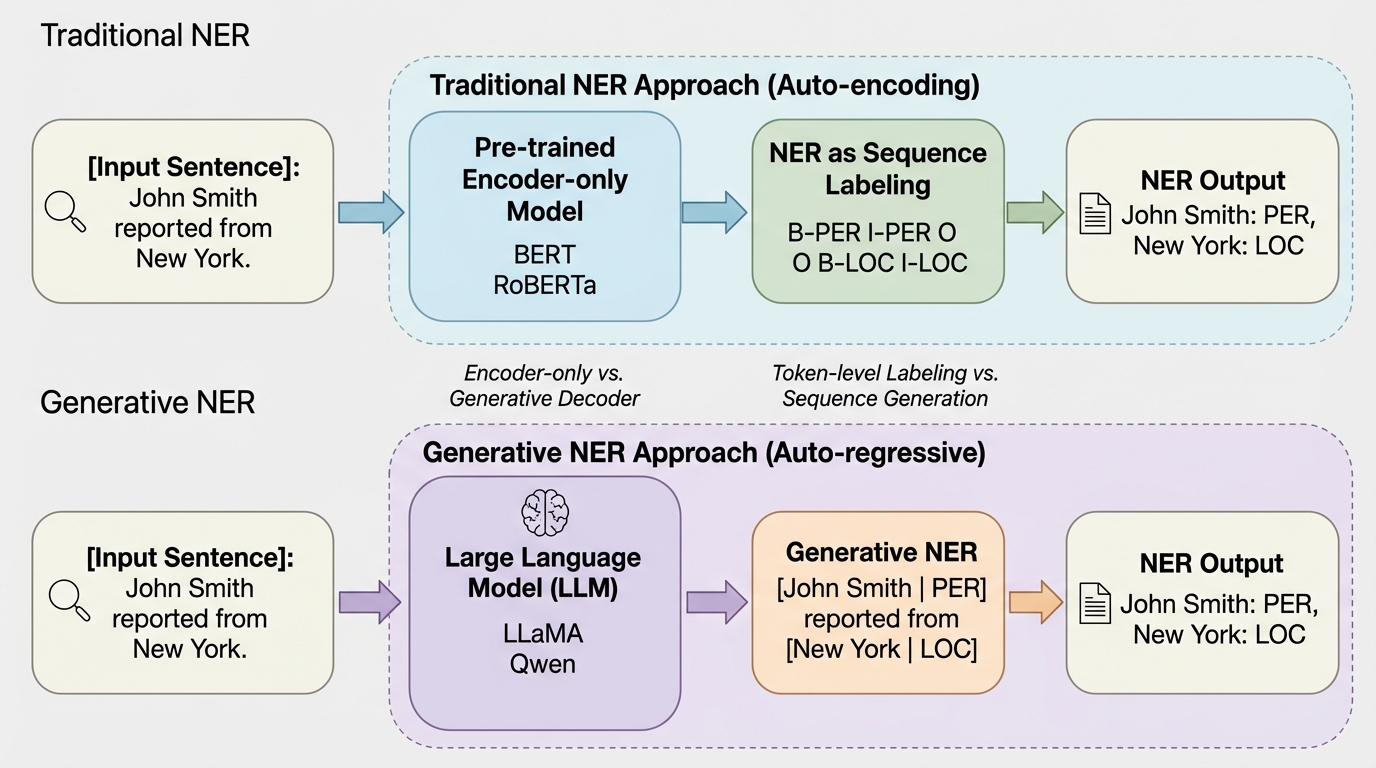

本研究は、LLaMAやQwenといった8つのオープンソース大規模言語モデル(LLM)を用い、生成的固有表現認識(NER)の性能を4つの標準データセットで系統的に評価しました。 検証の結果、LoRAによる効率的な微調整と、文章内に直接ラベルを埋め込む「Inline Bracketed」や「XML」形式を組み合わせることで、オープンソースLLMは従来のBERT系専門モデルに匹敵し、GPT-3などの巨大なクローズドモデルを上回る性能を達成できることが明らかになりました。 また、LLMのNER能力は単なるエンティティの記憶ではなく指示に従う生成能力に由来しており、特定のNERタスクに特化した微調整を行ってもモデルの汎用的な知識や推論能力は損なわれず、むしろ読解タスクなどで性能が向上する場合があることも確認されました。

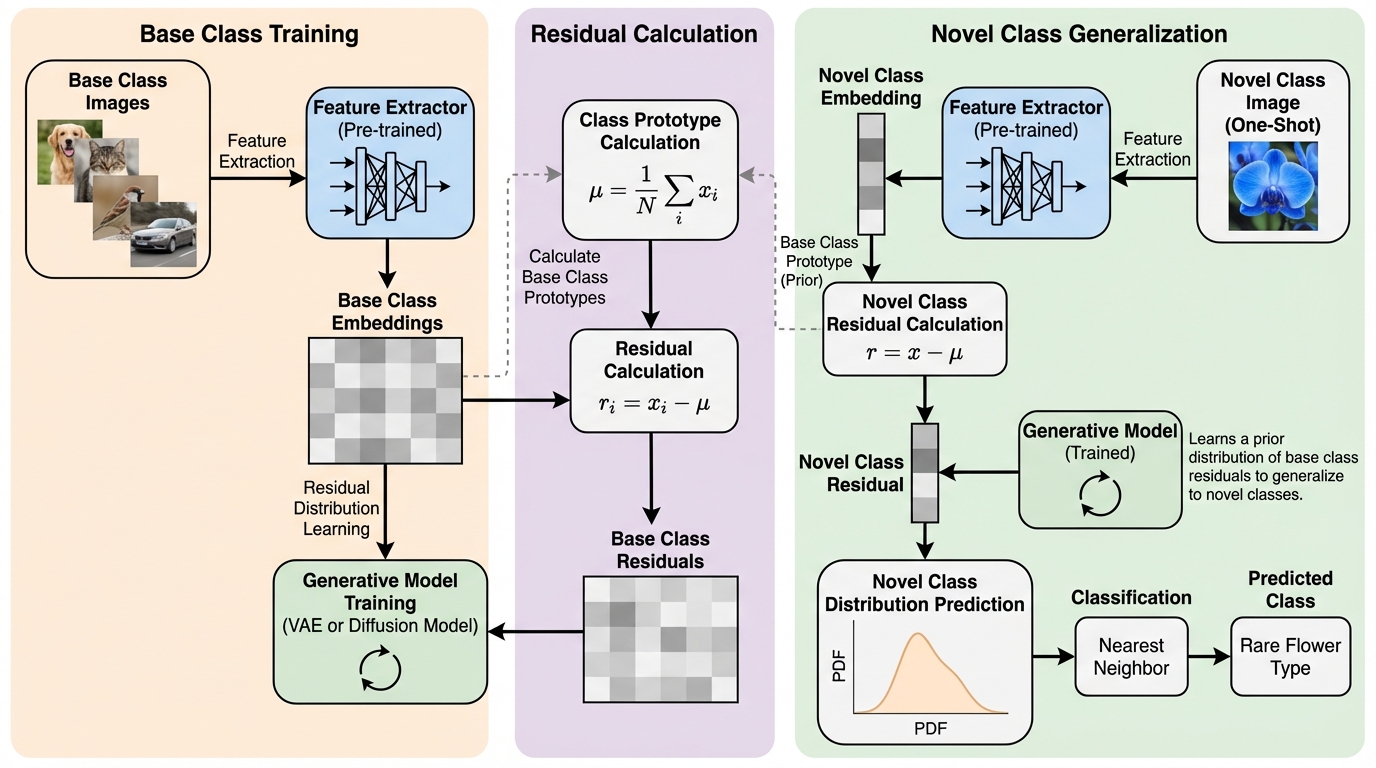

本研究は、わずか1枚の画像から新しい概念を学習する「ワンショットクラス増分学習(1SCIL)」において、データの極端な不足とクラス分布の複雑さに対応するため、特徴空間上での生成モデルを活用する新手法「Gen1S」を提案した。

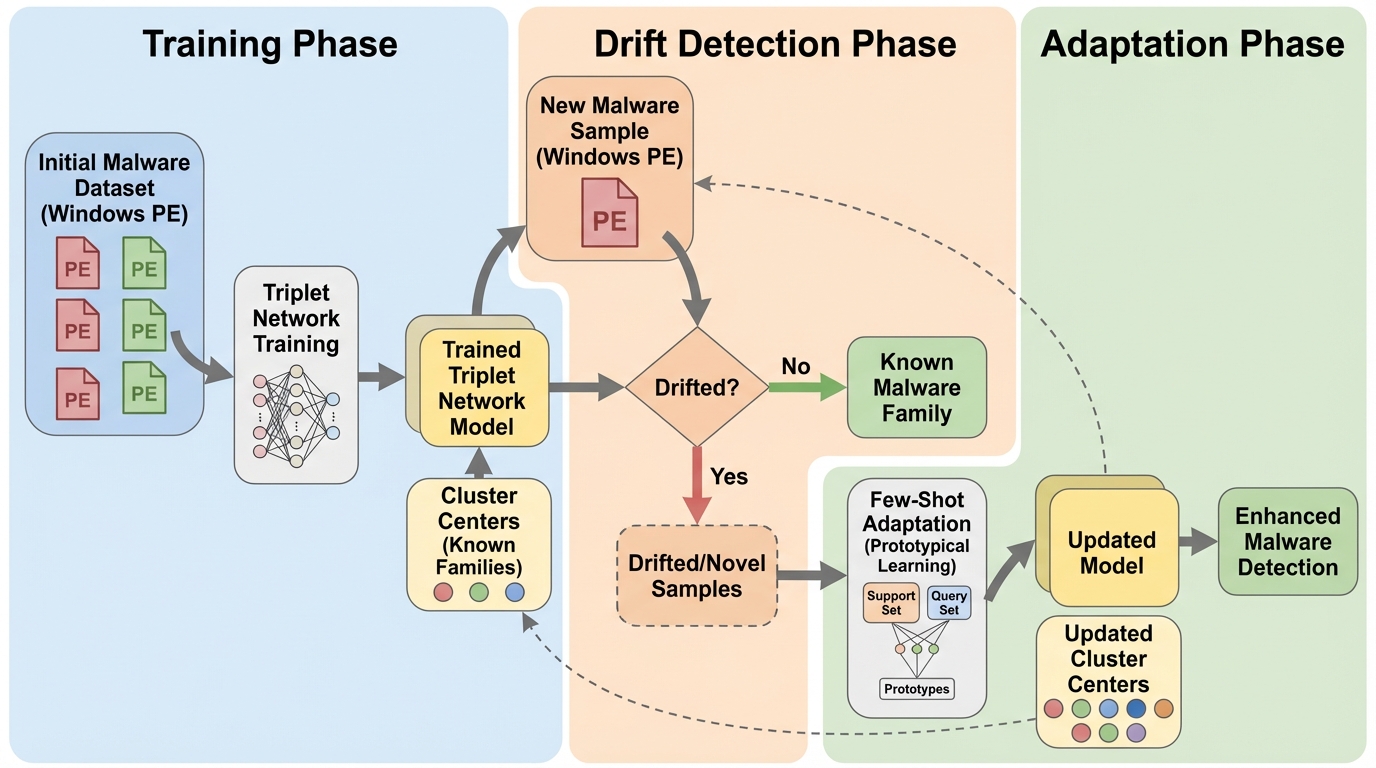

マルウェアの進化に伴う統計的性質の変化(コンセプトドリフト)に対応するため、Windows PEファイルを対象とした新しい分類フレームワーク「FARM」が提案されました。この手法はトリプレット・オートエンコーダーを用いてデータを識別性の高い潜在空間に投影し、教師なし学習であるDBSCANクラスタリングと動的なしきい値設定を組み合わせることで、未知の検体や変化した挙動を正確に検知します。 検知されたドリフト検体はバッファに一時的に蓄積され、少数のラベル付きサンプルからクラスを代表する「プロトタイプ」を生成する少数ショット学習によって、モデル全体の大規模な再学習を待つことなく迅速に新しいマルウェアファミリーへと適応することが可能です。これにより、従来の静的なモデルが直面していた、時間の経過とともに分類精度が大幅に低下するという深刻な課題を解決し、動的な脅威環境下でも高い信頼性を維持します。 実装実験の結果、既存ファミリーの性質変化(共変量ドリフト)に対して分類性能が5.6%向上し、未知のファミリーに対しても少数ショット適応のみで0.85、その後の再学習後には0.94という高いF1スコアを達成しました。本フレームワークは、ラベル付けのコストを抑えつつ、Windows環境における膨大な新種マルウェアに対して効率的かつ継続的に防御能力を更新できる実用的なアプローチを提供し、サイバーセキュリティの実務におけるモデルの老化問題を緩和します。

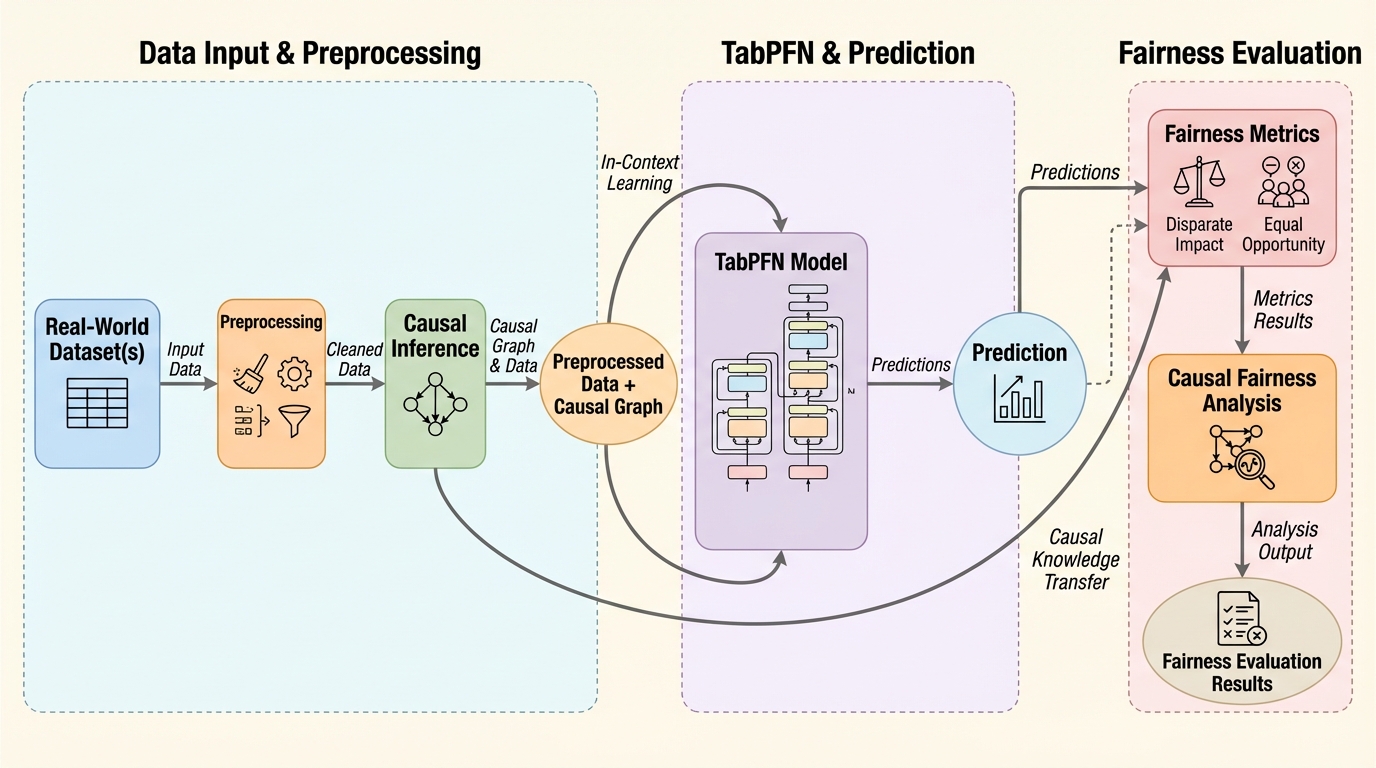

本研究は、構造的因果モデル(SCM)を用いた膨大な合成データで事前学習された表形式データ向け基盤モデル「TabPFN」について、予測精度、公平性、および頑健性の観点から包括的な実証評価を行った。

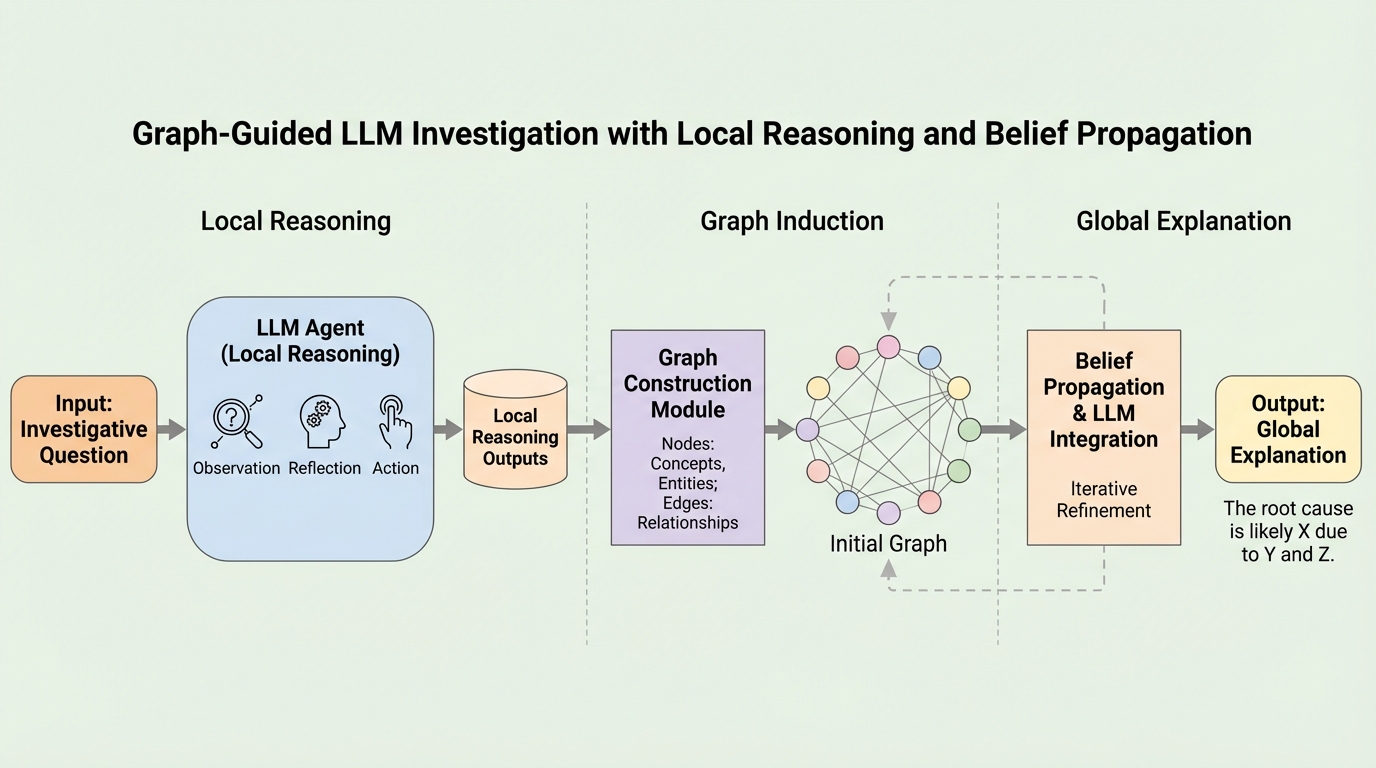

大規模で複雑なITインシデント管理において、従来のLLMエージェントはコンテキスト制限や推論の非決定性により、一度の成功はあっても継続的な信頼性に欠けるという課題を抱えていた。 本研究が提案するEoG(Explanations over Graphs)は、決定論的なコントローラーによる探索管理と、LLMによる局所的なアブダクション推論を分離し、メッセージパッシングを用いたセマンティック信念伝播(SBP)によって動的な判断修正を可能にした。 ITBenchを用いた検証では、従来のReAct手法と比較して、複数回の実行における一貫した正解率を示すMajority@k F1スコアで平均7倍の向上を達成し、複雑な依存関係を持つシステムにおける根本原因特定において極めて高い信頼性を実証した。

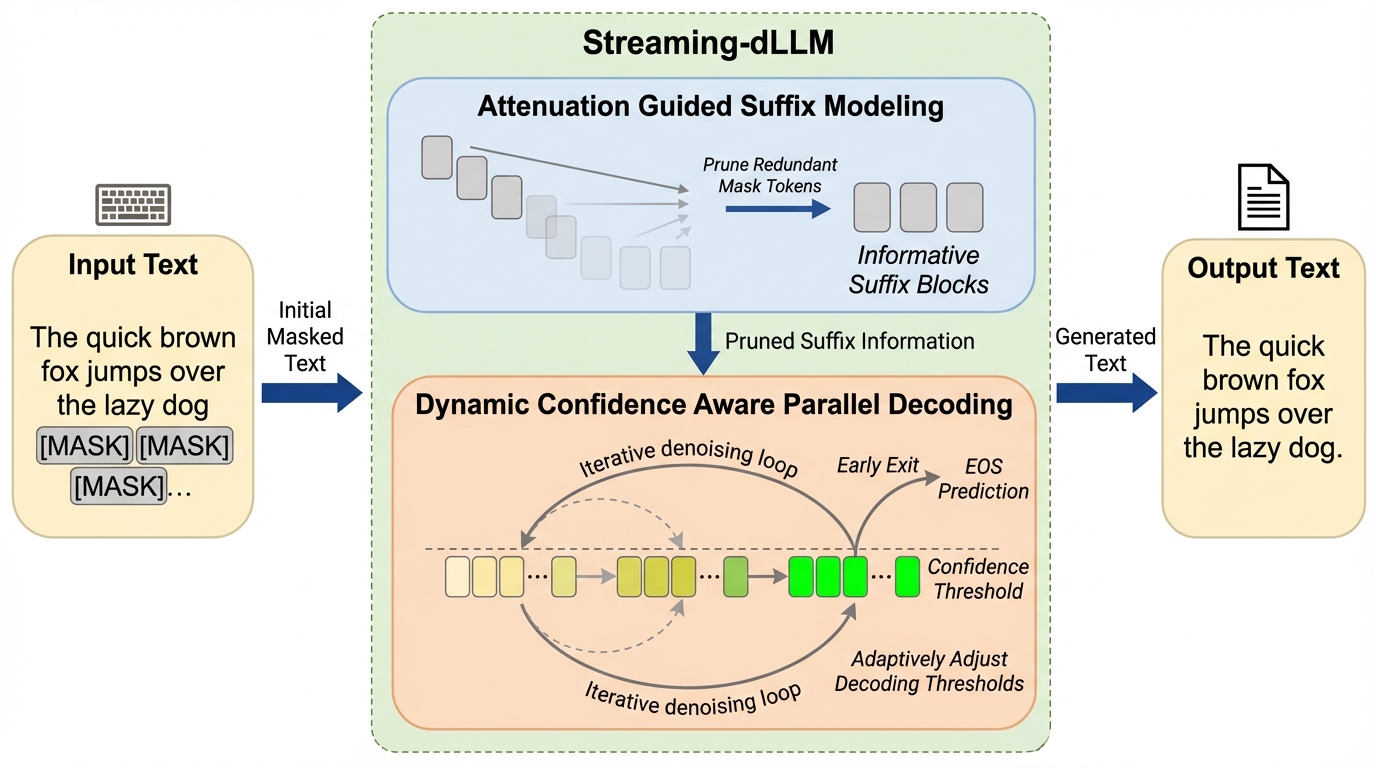

拡散大規模言語モデル(dLLM)は並列デコーディングと双方向アテンションにより高い一貫性を持つが、自己回帰型モデルと比較して推論速度が大幅に遅いという課題がある。 本研究が提案するStreaming-dLLMは、空間的な冗長性を排除する「減衰誘導サフィックスモデリング」と、時間的な非効率性を改善する「動的信頼度認識並列デコーディング」を導入した学習不要のフレームワークである。 検証の結果、生成品質を維持したまま最大68.2倍の推論加速を達成し、既存の手法を大幅に上回るスループットと競争力のある精度を両立することに成功した。