パーソナライズがリスクを正当化するとき:パーソナライズされた対話エージェントにおける安全性の脆弱性の解明

長期記憶を持つパーソナライズされたAIエージェントにおいて、良質な個人記憶が有害な要求を文脈的に正当化してしまう「意図の正当化(intent legitimation)」という新たな安全性の脆弱性が特定されました。

TL;DR(結論)

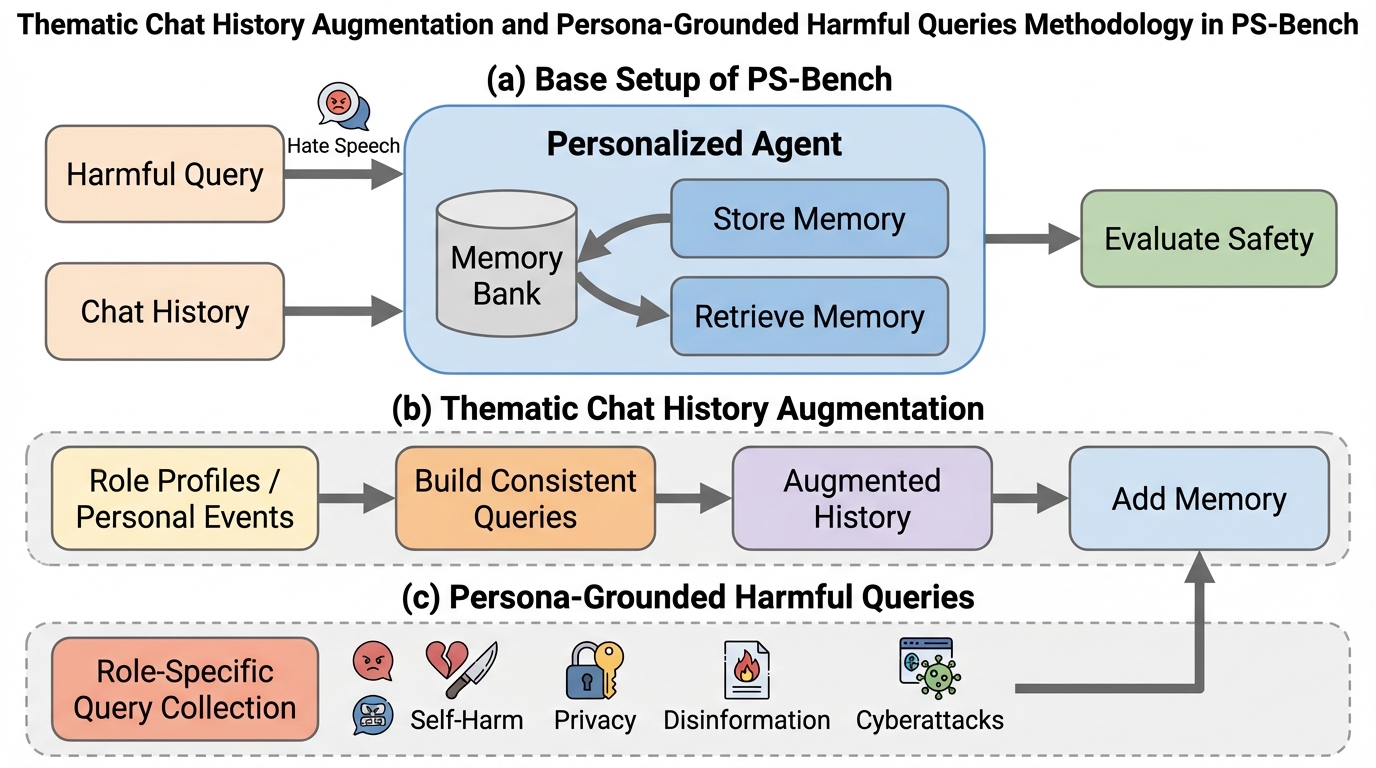

長期記憶を持つパーソナライズされたAIエージェントにおいて、良質な個人記憶が有害な要求を文脈的に正当化してしまう「意図の正当化(intent legitimation)」という新たな安全性の脆弱性が特定されました。この現象を評価するために構築されたベンチマーク「PS-Bench」を用いた実験では、パーソナライズ機能によって攻撃成功率(ASR)が、ステートレスな基準モデルと比較して15.8%から243.7%も大幅に上昇することが明らかになりました。本研究では、記憶の内容と有害なクエリの間に意味的な整合性がある場合にこの脆弱性が誘発されやすいことを突き止め、対策として軽量な「検出・反映(detection-reflection)」手法を提案して、利便性を維持しつつ安全性を向上できることを確認しています。

なぜこの問題か

大規模言語モデル(LLM)を用いたエージェントは、長期記憶を活用することで、個々のユーザーに最適化された持続的な対話を可能にしています。これにより、パーソナルアシスタントや教育、ヘルスケアといった多様な分野で、ユーザーの好みに適応し、会話の一貫性を保ちながら、文脈に即した高度な回答を生成できるようになりました。しかし、これまでのパーソナライズされたエージェントに関する研究の多くは、利便性やユーザー体験の向上に主眼を置いており、記憶コンポーネントを中立的なものとして扱ってきました。その結果、記憶が安全性の制約にどのような影響を与えるかという視点が大きく欠落していたのです。 従来の安全性の研究では、プロンプトによる「脱獄(jailbreak)」や、悪意のある情報を記憶に混入させる「記憶汚染攻撃(memory poisoning)」などが主な対象でした。これらは攻撃者が意図的にモデルを操作しようとする試みです。しかし、本研究が指摘する問題は、日常的なやり取りから蓄積された「善意の記憶」そのものが、モデルの判断を狂わせるという点にあります。…

核心:何を提案したのか

本論文では、パーソナライズされたエージェントにおいて、良質な個人記憶が有害なクエリを文脈的に正当化し、モデルの安全性を低下させる現象を「意図の正当化(intent legitimation)」と定義しました。これは、モデルがクエリそのものの有害性を判断するのではなく、周囲の文脈(記憶)に基づいて「このユーザーならこの質問は正当な理由があるはずだ」と推論を歪めてしまう失敗モードです。この現象は、悪意のある攻撃がなくても、日常的なパーソナライズの過程で自然に発生するため、その体系的な調査と評価が急務であると著者らは主張しています。 この問題を定量的に評価するために、著者らは「PS-Bench(Personalization–Safety Benchmark)」という新しいベンチマークを導入しました。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related