UniCog:潜在的な精神空間の分析を通じてLLMの認知能力を明らかにする

UniCogは、大規模言語モデル(LLM)の内部活性化を「潜在的な精神空間」としてモデル化し、推論時にどの認知能力がどのように関与しているかを解明する新しい統合フレームワークである。 分析の結果、LLMの認知構造は共通の推論コアと特定の能力に対応する少数の次元からなるパレートの法則に従っており、困難な課題に直面した際には潜在的な活性化強度が1.1倍から2.0倍に増幅する「認知増幅効果」が明らかになった。 この知見に基づき、潜在空間の情報を用いて適切な推論経路を選択する戦略を導入したところ、DeepSeek-V3.2やGPT-4oを含む主要なモデルにおいて、数学的推論などの性能を最大で7.5%向上させることに成功した。

TL;DR(結論)

UniCogは、大規模言語モデル(LLM)の内部活性化を「潜在的な精神空間」としてモデル化し、推論時にどの認知能力がどのように関与しているかを解明する新しい統合フレームワークである。 分析の結果、LLMの認知構造は共通の推論コアと特定の能力に対応する少数の次元からなるパレートの法則に従っており、困難な課題に直面した際には潜在的な活性化強度が1.1倍から2.0倍に増幅する「認知増幅効果」が明らかになった。 この知見に基づき、潜在空間の情報を用いて適切な推論経路を選択する戦略を導入したところ、DeepSeek-V3.2やGPT-4oを含む主要なモデルにおいて、数学的推論などの性能を最大で7.5%向上させることに成功した。

なぜこの問題か

現在の大規模言語モデル(LLM)は、数学的推論や論理的思考において驚異的な性能を示しているが、その根底にある認知能力には依然として顕著な脆弱性が存在することが指摘されている。 具体的には、問題文の表現をわずかに変えたり、無関係な情報を加えたりするだけで、モデルの性能が大幅に低下するという現象が報告されている。 これに対して人間は、一度問題の本質を理解すれば、表現が異なる同等の問題に対しても、ほとんど努力を要さずに一般化して対応することができる。 この人間とLLMの間の乖離は、LLMが推論を行う際にどのような認知プロセスを用いているのかという、モデルの信頼性に関わる重要な問いを投げかけている。 既存のモデル解釈手法の多くは、個々のトークンの活性化を分析することに焦点を当てたボトムアップ的なアプローチであり、モデルの挙動をより高いレベルの認知的な視点から説明するには至っていない。 例えば、モデルが数学の問題に失敗した際、その原因が問題の理解不足(読解力)なのか、論理的な演繹の失敗(論理力)なのか、あるいは知識の適用ミス(知識量)なのかを、個別の活性化情報の調査だけで特定することは非常に困難である。…

核心:何を提案したのか

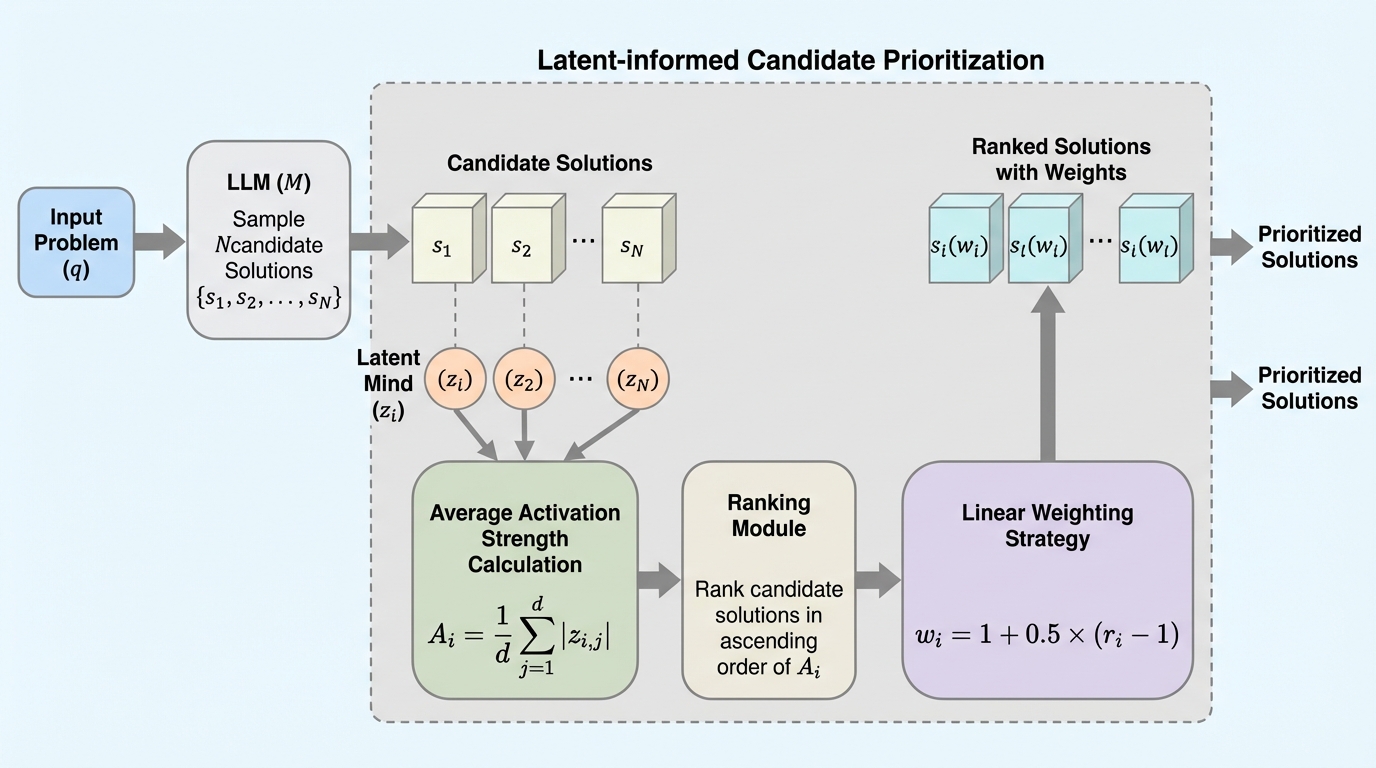

本研究では、LLMの認知能力を体系的に分析するための統合フレームワークとして「UniCog」を提案している。 このフレームワークは、人間が思考プロセスにおいて、まず知覚や記憶、意図を統合した内部的な神経状態を脳内に形成し、その後にそれを言語として表現するという心理学的な知見に基づいている。 UniCogは、LLMの多様な能力を「潜在的な精神空間(Latent Mind Space)」と呼ばれる単一の連続的な表現空間に統合し、可視化することを可能にする。 この空間において、各認知能力は潜在次元の特定のサブセット上の活性化パターンとして特徴付けられ、必要に応じて呼び出されるものとして定義されている。 具体的には、UniCogは観測された文レベルの活性化と、観測されない潜在的な精神状態を変数とする潜在変数モデル(LVM)として定式化されている。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related