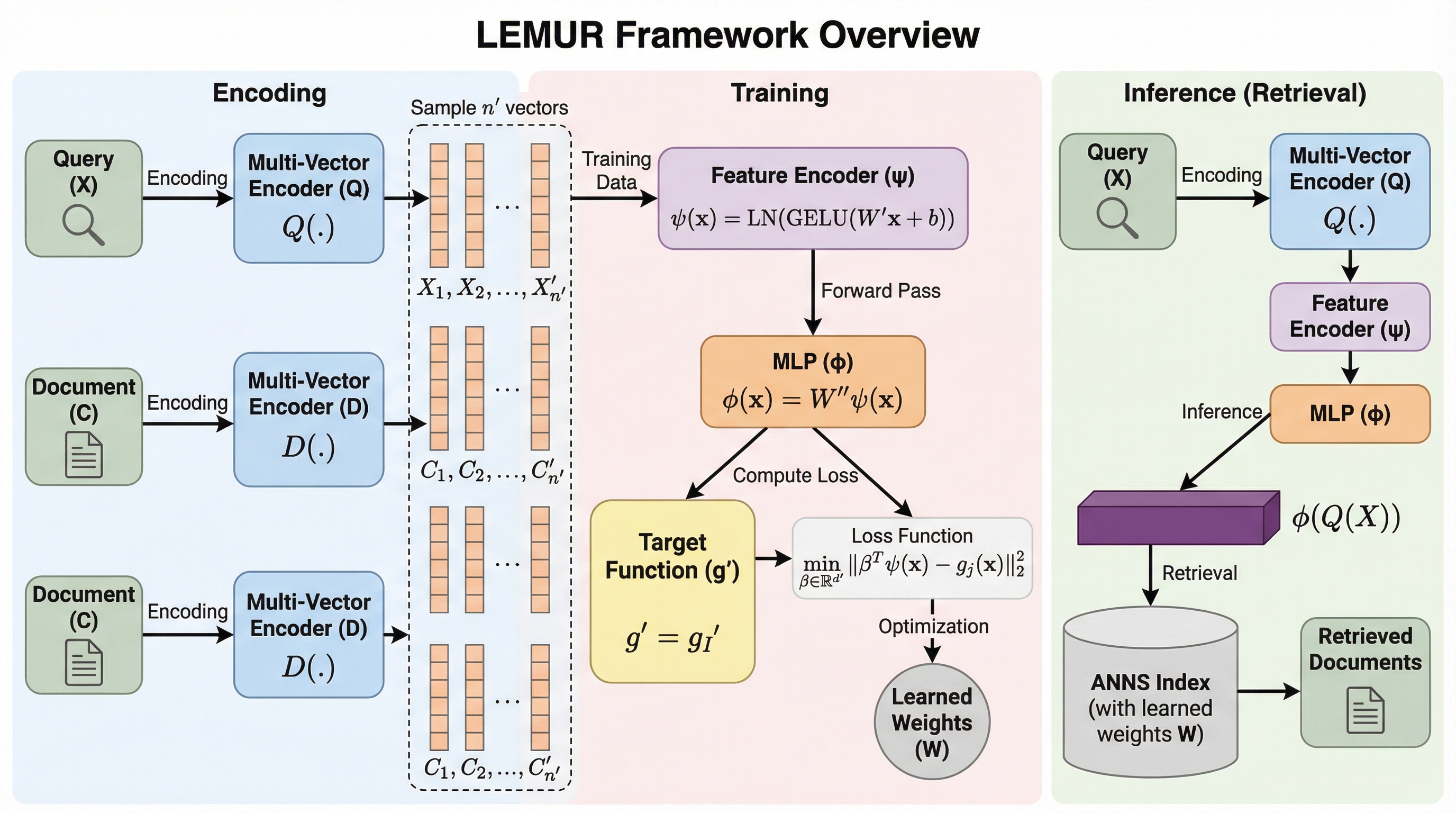

LEMUR: 学習ベースのマルチベクトル検索フレームワーク

情報検索において高い精度を誇るColBERTなどのマルチベクトルモデルは、MaxSim計算の複雑さゆえに検索遅延が非常に大きいという課題を抱えていました。本研究で提案されたLEMURは、このマルチベクトル検索を教師あり学習による回帰問題として再定義し、最終的に潜在空間上の単一ベクトルによる近似近傍探索へと変換することで、既存の高速な検索ライブラリの活用を可能にしました。 検証の結果、LEMURは従来のマルチベクトル検索手法と比較して1桁(約10倍)以上の高速化を達成しており、最新のテキスト検索モデルや視覚的な文書検索モデルにおいても、高い再現率を維持しながら劇的なパフォーマンス向上を実現することが確認されました。 このフレームワークは、軽量なニューラルネットワークを用いてトークン単位の埋め込みを潜在空間上の単一ベクトルへと集約し、ドキュメントの重み行列との内積計算によって類似度を推定する仕組みを採用しており、大規模なコーパスに対しても効率的なインデックス作成と高速な検索を両立させています。