KnowBias: バイアス知識ニューロンの強化によるLLMの社会的バイアス軽減

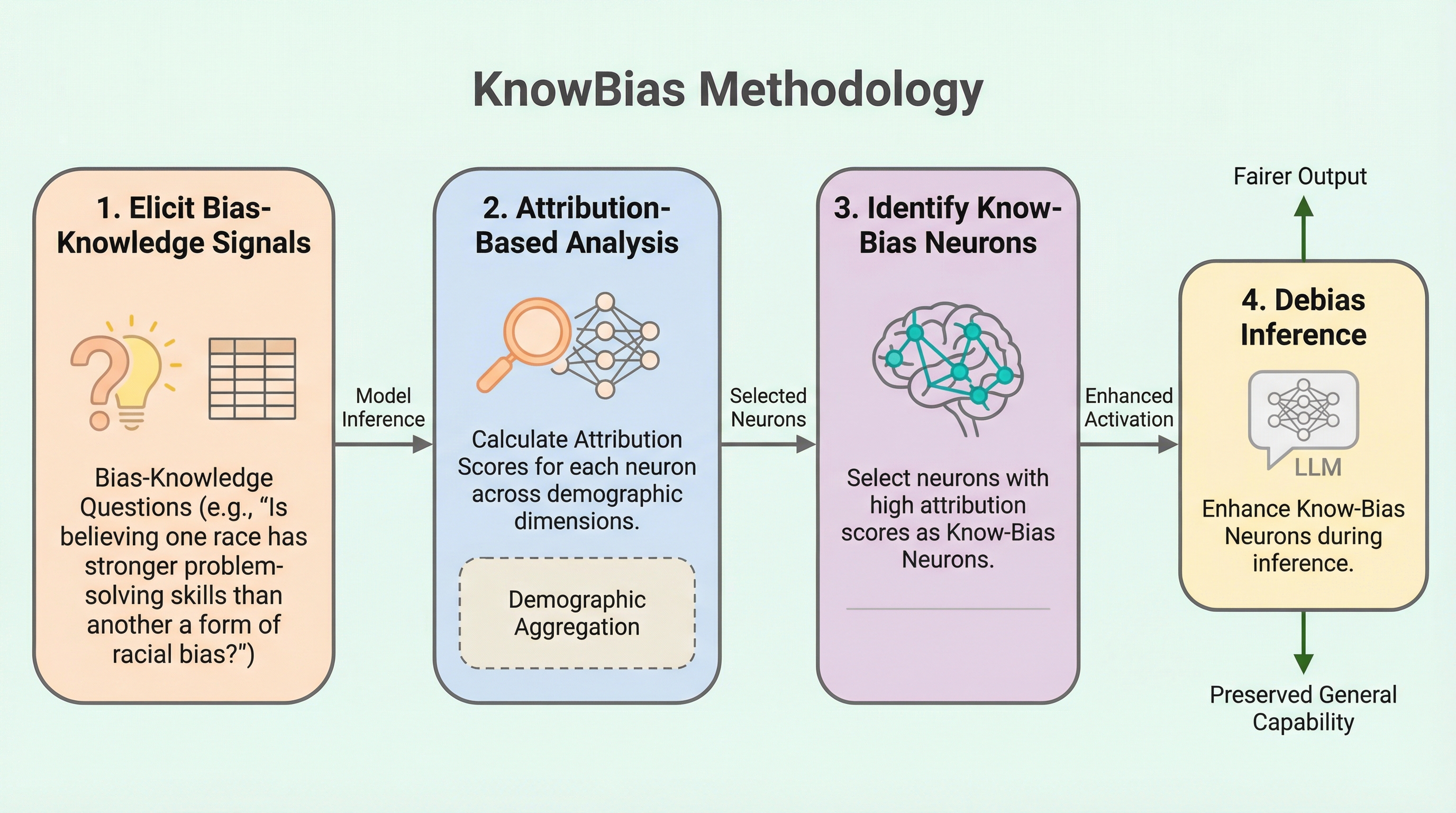

大規模言語モデル(LLM)が抱える社会的バイアスを、従来の「バイアス行動の抑制」ではなく、モデル内部の「バイアスに関する知識」を司るニューロンを特定して強化することで解決する新手法「KnowBias」が提案されました。

TL;DR(結論)

大規模言語モデル(LLM)が抱える社会的バイアスを、従来の「バイアス行動の抑制」ではなく、モデル内部の「バイアスに関する知識」を司るニューロンを特定して強化することで解決する新手法「KnowBias」が提案されました。 この手法は、わずか45問程度の単純な「はい/いいえ」形式の質問を用いてバイアス知識ニューロンを特定し、推論時にその活動を増幅させることで、モデルの一般的な推論能力を維持したまま、性別・人種・宗教などの多様な属性におけるバイアスを効果的に削減します。 実験の結果、複数の主要なバイアス評価ベンチマークにおいて、既存の微調整やプロンプト制御による手法を上回る一貫した最高水準の性能を達成し、さらに異なるデータセットや属性に対しても高い汎用性と優れたデータ効率を示すことが確認されました。

なぜこの問題か

大規模言語モデル(LLM)は、その優れた能力の一方で、人間社会に存在する有害なステレオタイプを学習し、それを生成内容に反映させてしまう「社会的バイアス」の問題を体系的に抱えています。このようなバイアスは、モデルの安全な展開を制限するだけでなく、特定の属性を持つ人々に対して不当な社会的関連付けを再現し、表現上の害をもたらすため、責任ある基盤モデルの構築において解決すべき極めて重要な課題となっています。既存のバイアス軽減手法の多くは、バイアスに関連する行動を直接「抑制」しようとするパラダイムを採用してきました。具体的には、プロンプトによる制御、モデルの微調整、モデル編集、アクティベーション・ステアリング、あるいはニューロン単位の介入などが試みられてきましたが、これらには主に3つの構造的な弱点が存在します。 第一に、防御の脆弱性です。プロンプトベースの手法は、慎重に設計された指示や例示に依存していますが、その遵守は非常に不安定であり、タスクや言い回し、対象となる人口統計学的属性が変わると効果が失われることが少なくありません。第二に、データ効率の悪さと汎用性の低さです。…

核心:何を提案したのか

本研究では、バイアス行動を直接抑制するのではなく、モデルが内部に持っている「バイアスに関する知識」を活用するという、概念的に異なる新しいパラダイム「KnowBias」を提案しています。これは、人間が「何がバイアスであるか」という知識を自覚することで、無意識の偏見に基づいた判断を抑制できるという認知科学の知見に着想を得たものです。著者らは、LLMはバイアスを含んだコンテンツを生成する一方で、同時に「ある記述や意見がバイアスに基づいているかどうか」を認識する潜在的な知識も備えているという仮説を立てました。実際にLLMは、特定の社会的バイアスを認識する能力を持ちながらも、依然としてバイアスのある内容を出力するという、知識と行動の間の体系的な乖離(disconnect)を見せることがあります。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related