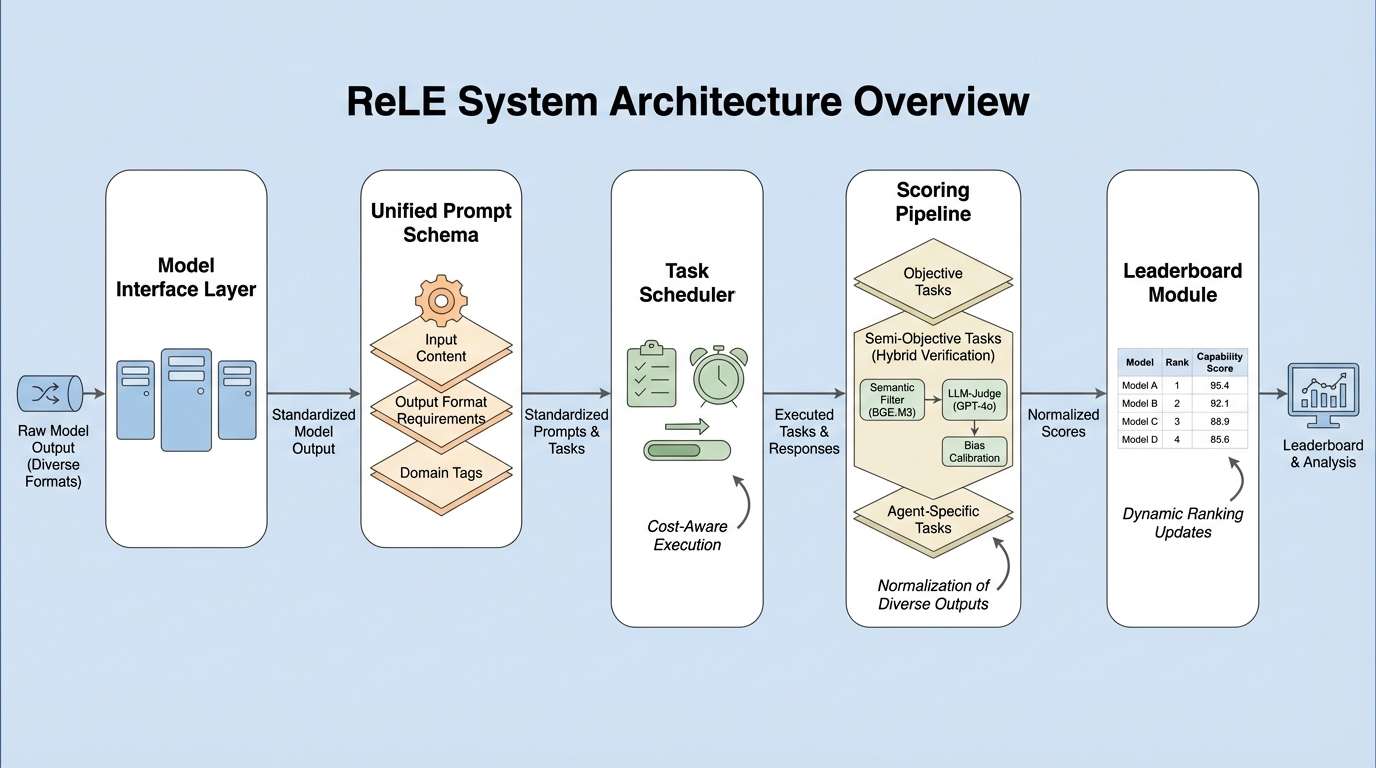

ReLE: 中国語LLMにおける能力異方性を診断するためのスケーラブルなシステムと構造化ベンチマーク

ReLEは、中国語大規模言語モデル(LLM)の評価において、既存ベンチマークの飽和と膨大な計算コストという課題を解決するために開発された、スケーラブルな動的診断システムである。304個のモデルを対象に20万件以上のサンプルを用いた評価を行い、分散認識型スケジューラにより精度を維持しながらコストを70%削減し、記号接地ハイブリッドスコアリングで判定の信頼性を高めた。モデルの性能が領域ごとに不均一である「能力異方性」を定量化し、単一の集計スコアでは隠されてしまうランキングの不安定性や、専門性と汎用性の間にある構造的なトレードオフを明らかにした。