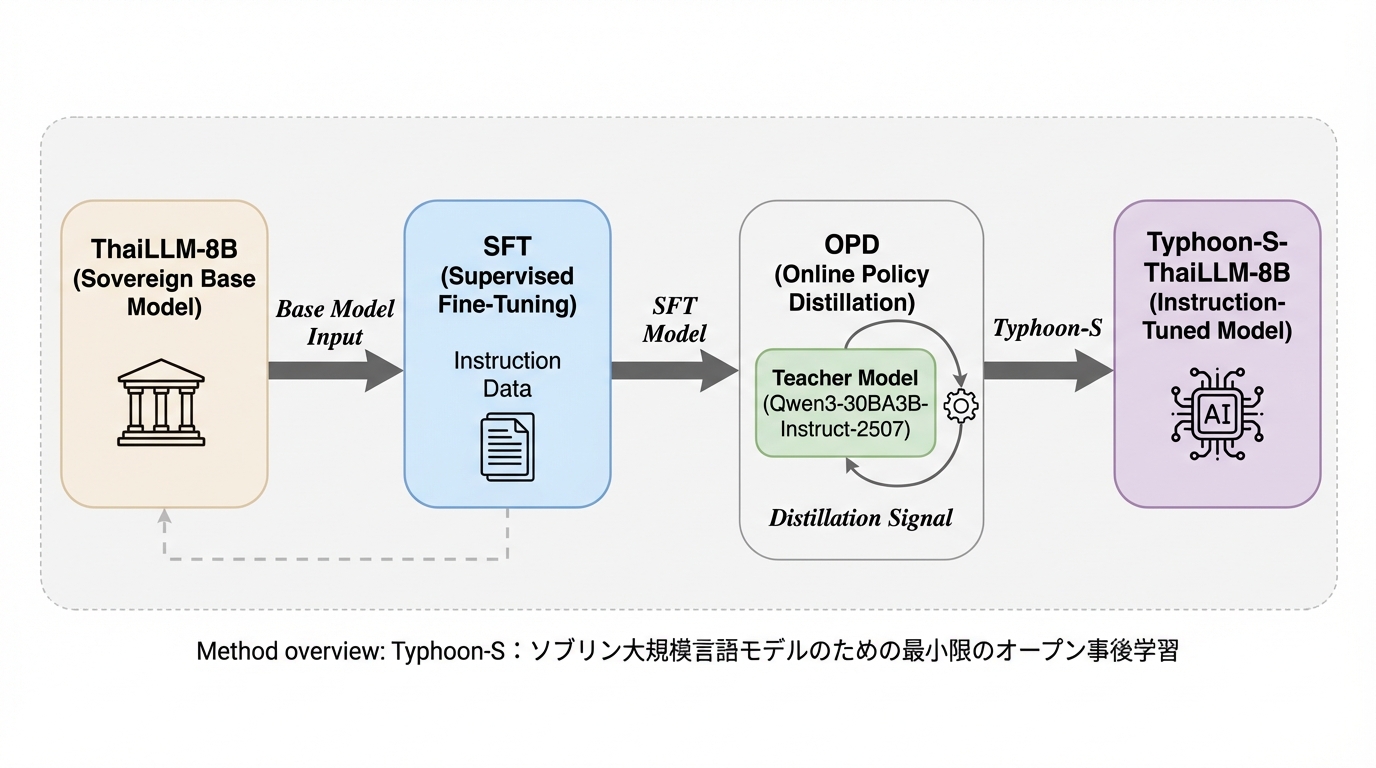

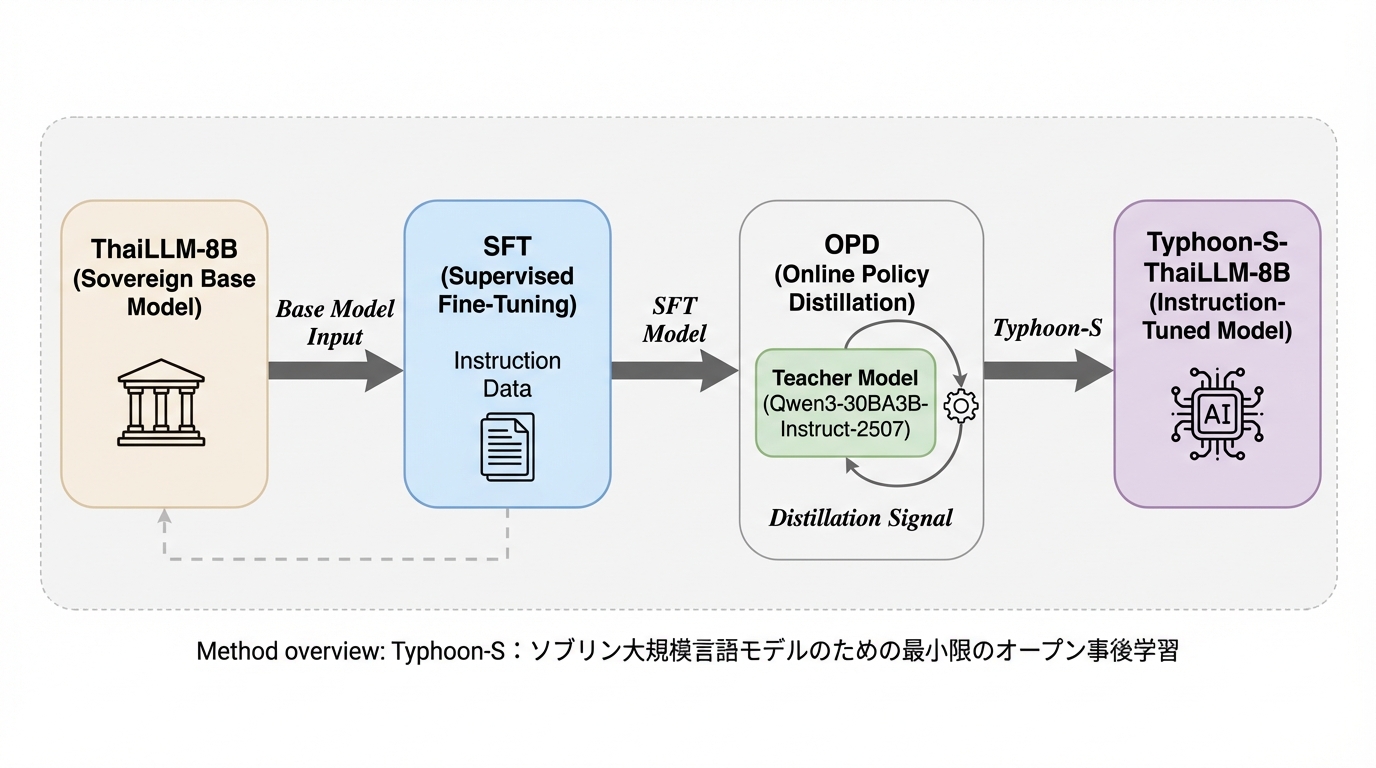

Typhoon-S:ソブリン大規模言語モデルのための最小限のオープン事後学習

現在の大規模言語モデル開発は膨大な計算資源とデータを持つ一部の組織に集中しており、特定の地域や国が独自のデータ管理や制御を維持しつつモデルを構築する「ソブリン設定」において、リソースの制約が大きな障壁となっています。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

現在の大規模言語モデル開発は膨大な計算資源とデータを持つ一部の組織に集中しており、特定の地域や国が独自のデータ管理や制御を維持しつつモデルを構築する「ソブリン設定」において、リソースの制約が大きな障壁となっています。

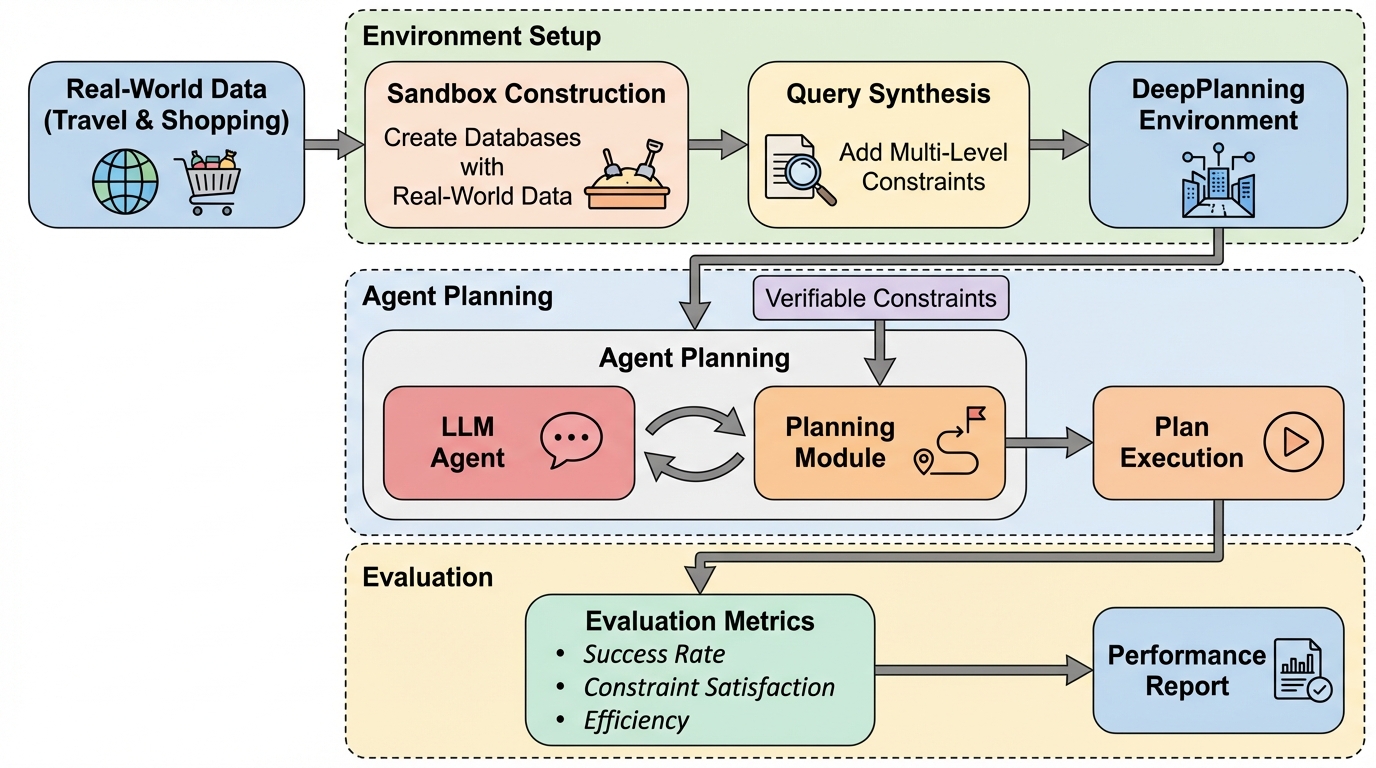

DeepPlanningは、大規模言語モデル(LLM)エージェントが持つ長期的な計画能力を多角的に評価するために開発された新しいベンチマークであり、従来の評価手法が重視していた局所的なステップ単位の推論を超えて、予算や時間といった全体的なリソース制約を最適化する真の計画能力を厳格に測定することを目的としている。

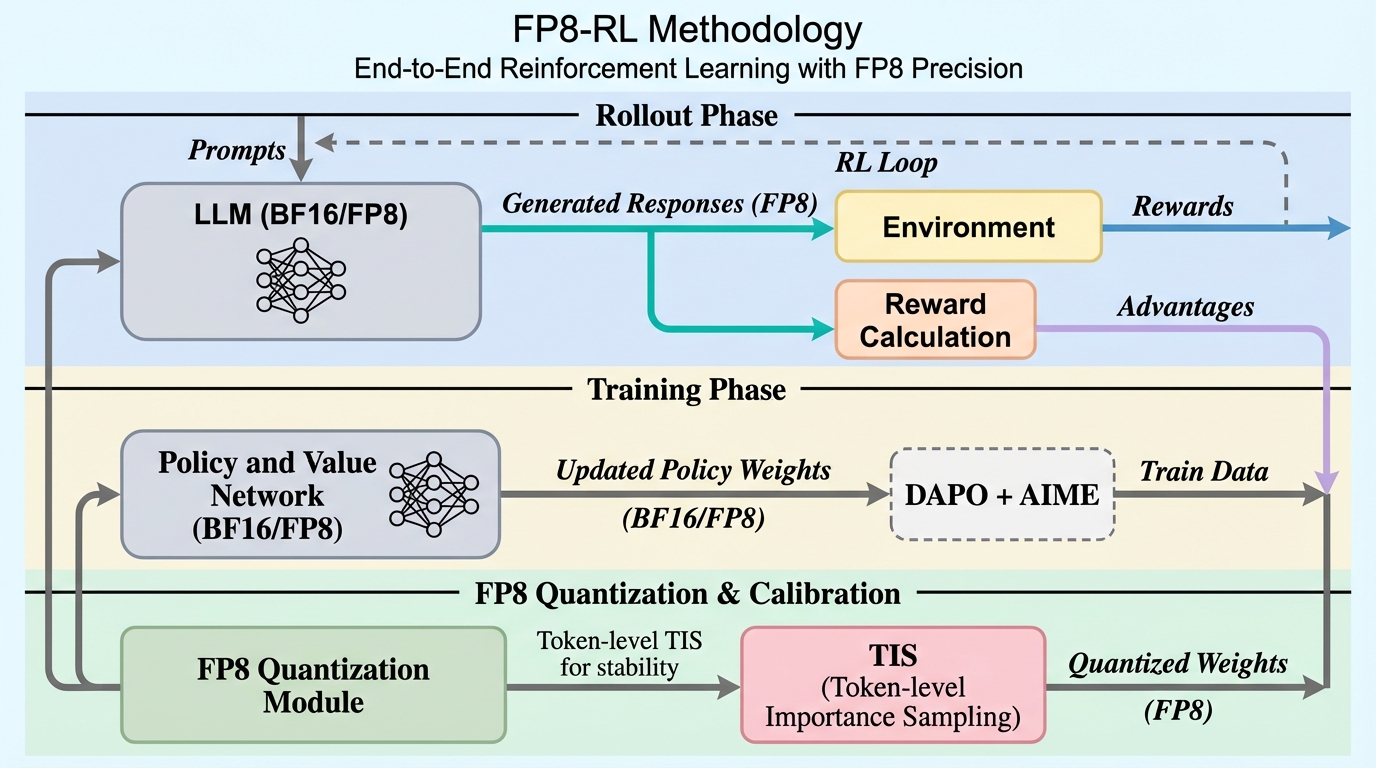

大規模言語モデルの強化学習において、実行時間の約8割を占めるロールアウト(生成)フェーズのボトルネックを解消するため、FP8精度を全面的に活用した計算スタック「FP8-RL」を提案しました。 ステップごとに更新されるポリシー重みの動的な量子化同期、KVキャッシュのFP8化、および重要度サンプリング(TIS/MIS)による不一致補正を導入することで、低精度化に伴う学習の不安定性を克服しています。 高密度モデルと混合専門家(MoE)モデルの両方で検証を行い、BF16と同等の学習性能を維持しながらロールアウトのスループットを最大44%向上させ、長文脈生成における計算効率を大幅に改善することに成功しました。

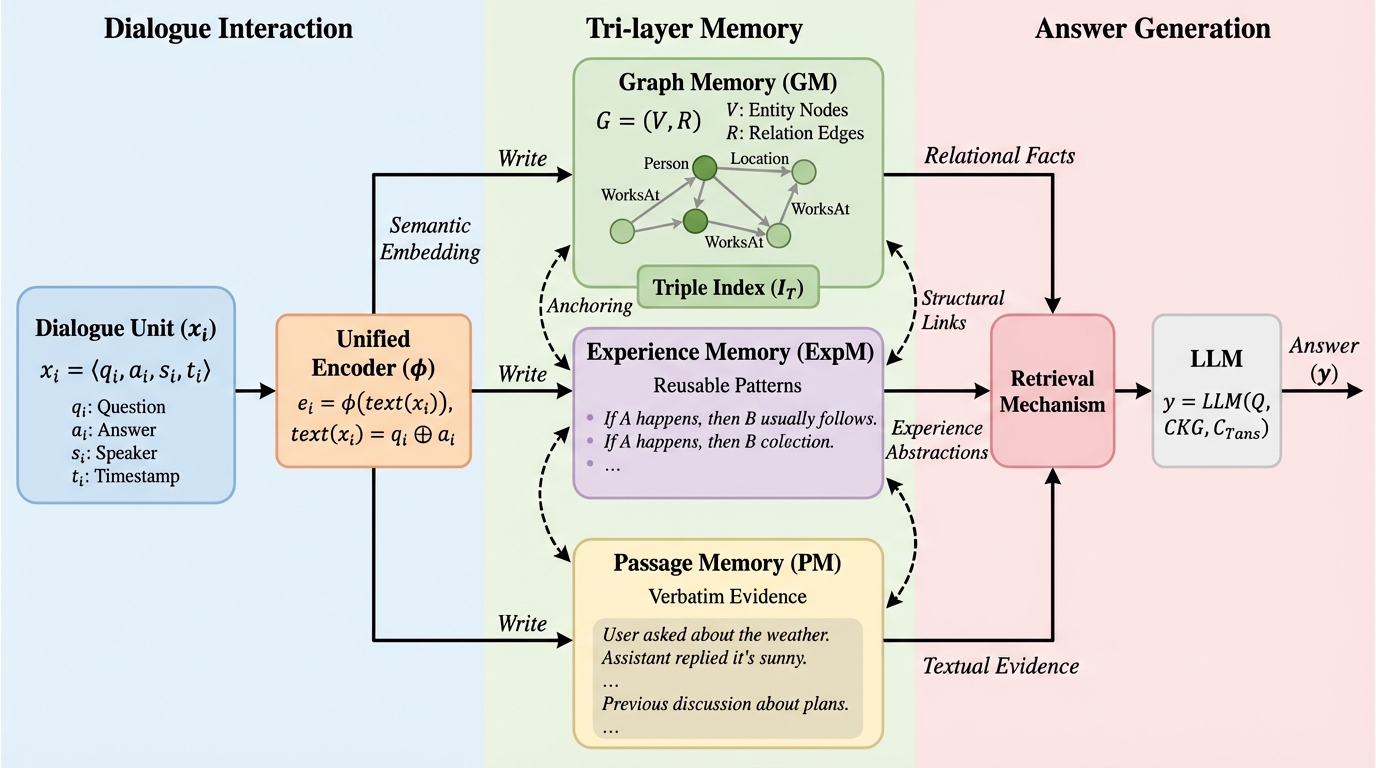

大規模言語モデル(LLM)ベースのエージェントが長期的な対話において、時間の経過に伴う一貫性の欠如や複雑な推論の困難さに直面する問題を解決するため、グラフ、経験、パッセージの3層からなる統合メモリフレームワーク「MemWeaver」が提案されました。

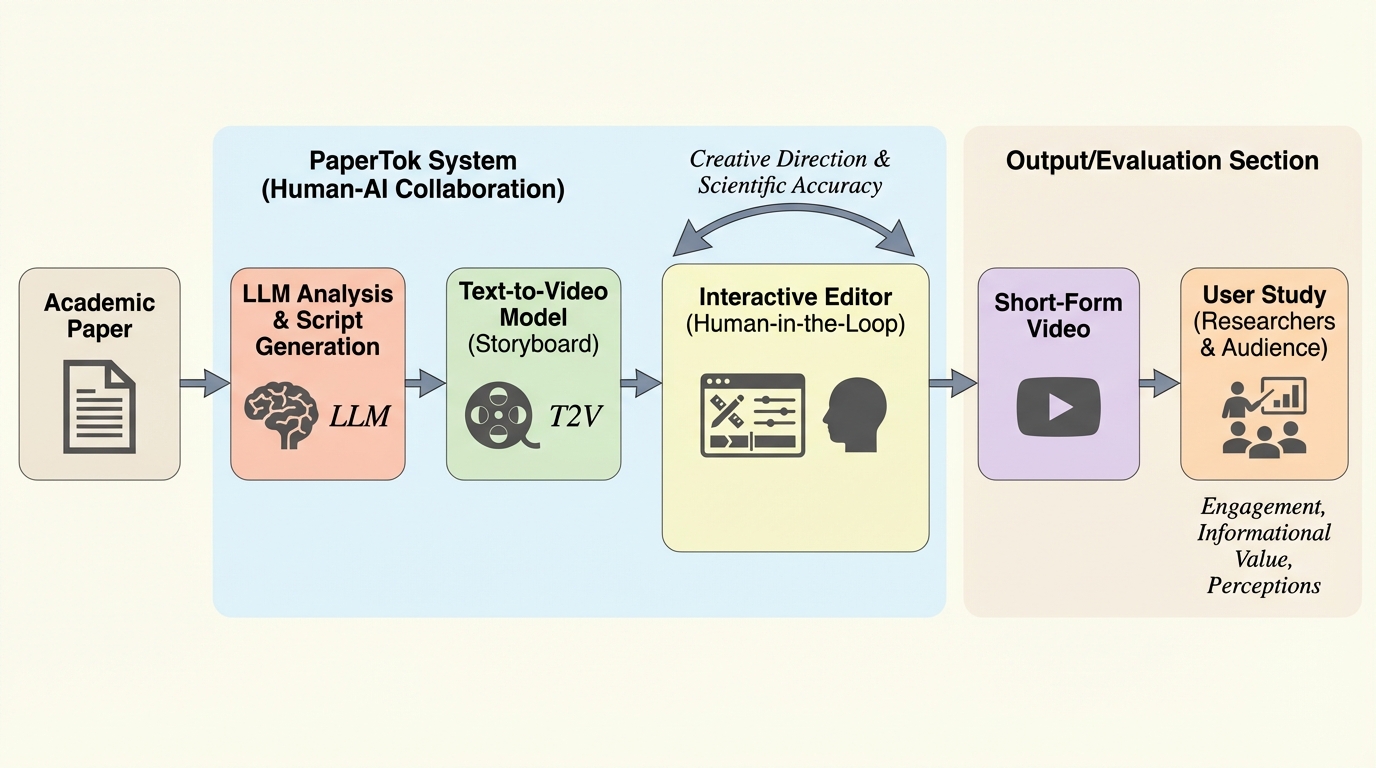

研究者が学術論文の内容をTikTokやInstagram Reelsのような短編動画へ変換する作業を支援するため、生成AIを活用した制作システム「PaperTok」が開発されました。 このシステムは、論文から脚本、音声、視覚的なストーリーボードを自動生成し、研究者が内容の正確性を維持しながら編集できる「人間とAIの協調ワークフロー」を提供することで、制作の負担を大幅に軽減します。 評価実験の結果、PaperTokで作成された動画は既存のツールよりも視聴者の関心を引きやすく、研究者にとっても専門知識を損なわずに魅力的な発信を行うための有効な手段であることが確認されました。

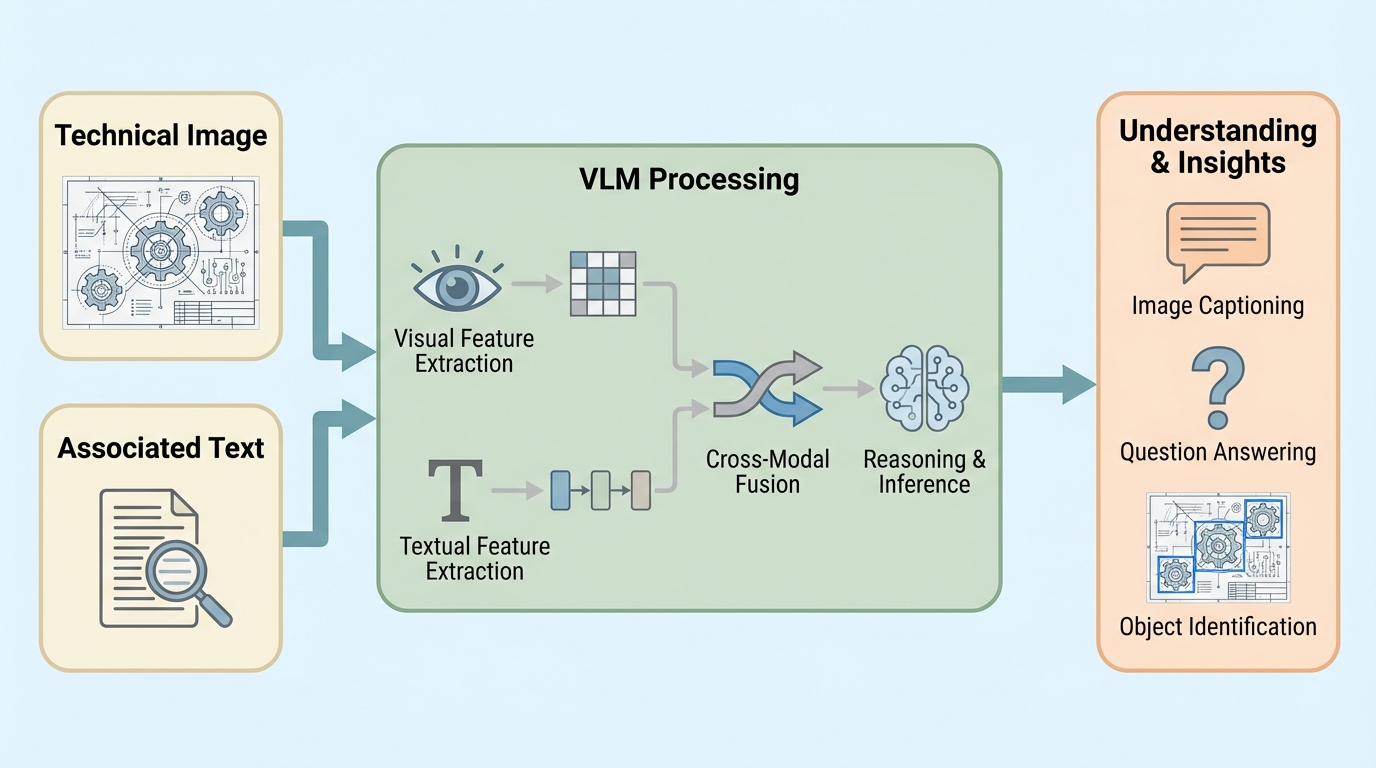

技術的な議論で多用される手書きの図表を、編集可能なMermaidコードへと変換し理解するための大規模データセット「TechING」と、それを用いた学習モデル「LLama-VL-TUG」が提案されました。 11万件超の合成データと545件の実世界の手書き画像を用い、Llama 3.

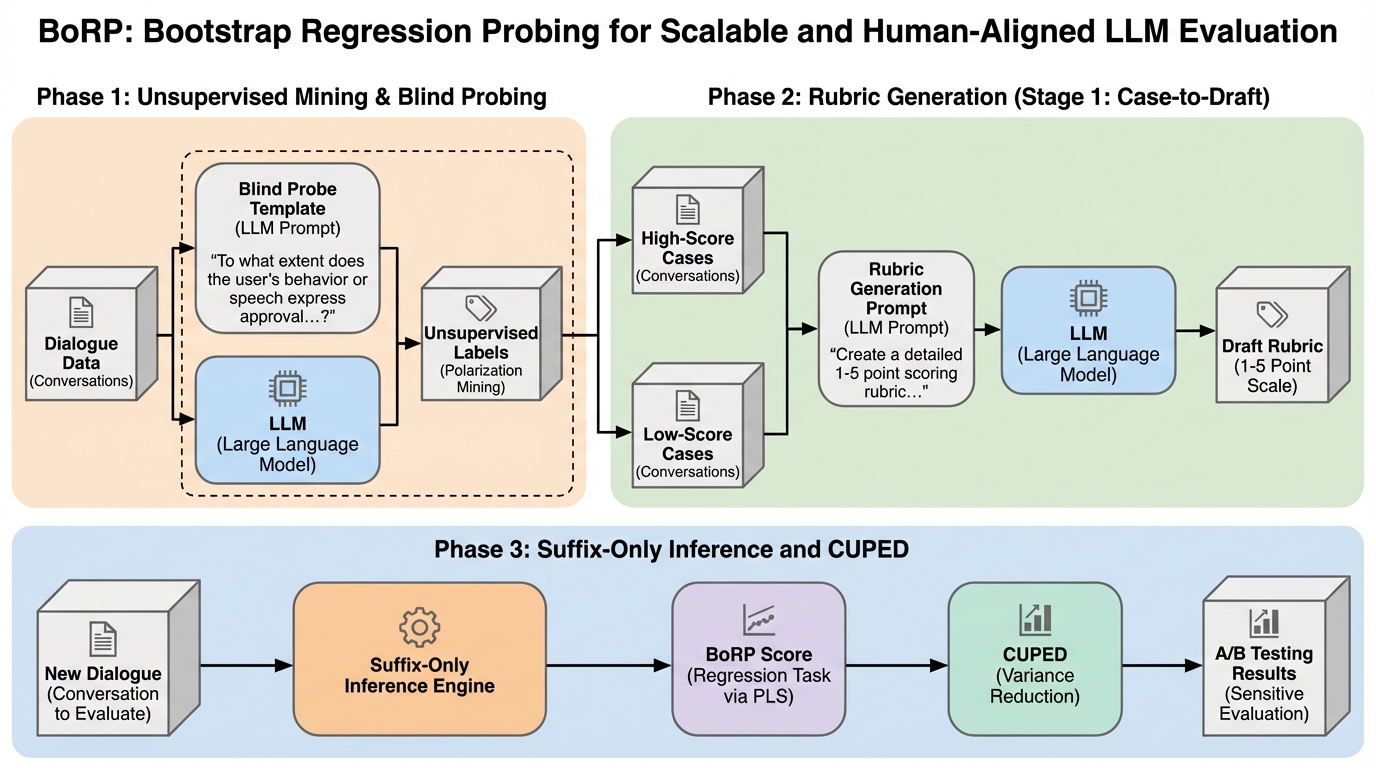

従来のLLMによる評価(LLM-as-a-Judge)が抱える「高コスト・低速・評価の偏り」という課題を解決するため、モデルの内部状態(潜在空間)を直接解析してユーザー満足度を1から5の数値で回帰予測する新手法「BoRP」が提案されました。

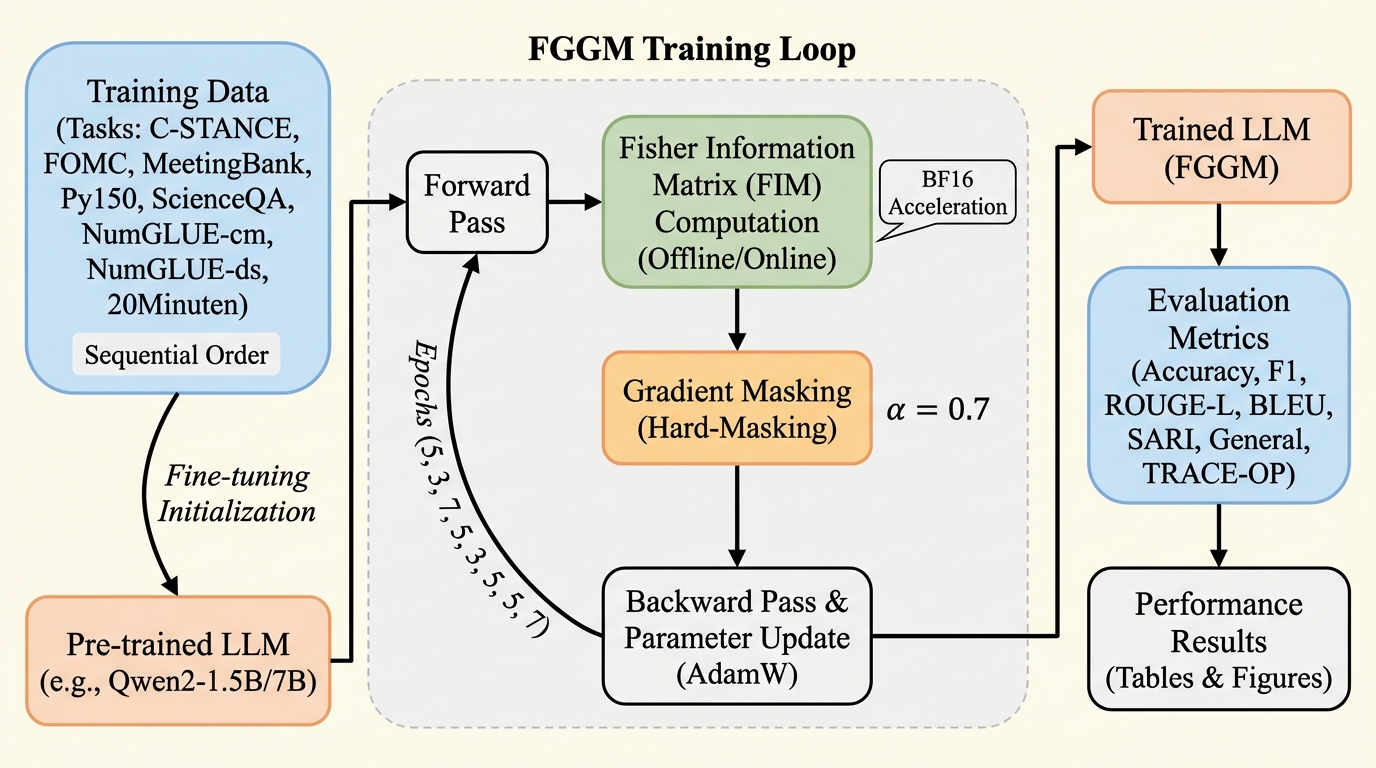

FGGM(Fisher-Guided Gradient Masking)は、大規模言語モデル(LLM)が新しいタスクを学習する際に過去の知識を失う「破滅的忘却」を防ぐため、フィッシャー情報行列(FIM)を用いてパラメータの重要度を数学的に評価し、重要な箇所の更新を制限する新しいフレームワークである。

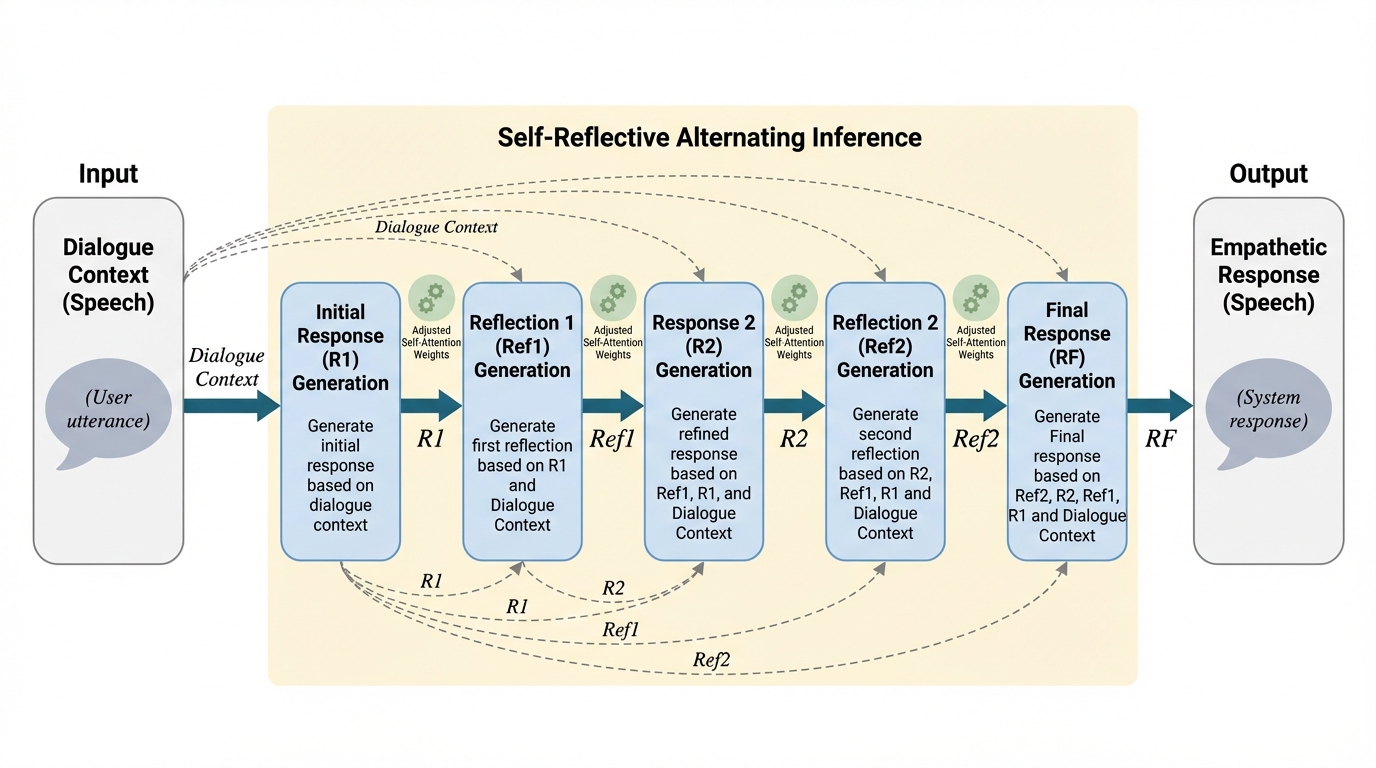

共感的な音声対話では、返答そのものだけでなく、相手の感情をどう読み取り、なぜその返答に至ったかという“途中の推論”まで扱わないと品質が伸びにくい、という問題設定が置かれています。 / そこで著者らは、共感の良し悪しを自然言語の説明として出力する評価器 EmpathyEval と、反省文と音声応答を交互に生成する ReEmpathy を組み合わせ、話す前に二度振り返るような推論過程を end-to-end の音声対話モデルへ埋め込みました。 / 実験では、記述型の共感評価、スコア型評価との相関、人手評価のいずれでも改善が見られ、単純な Chain-of-Thought を話す前に入れるだけでは足りず、反省と発話を交互に回す設計が効いていることが示されます。

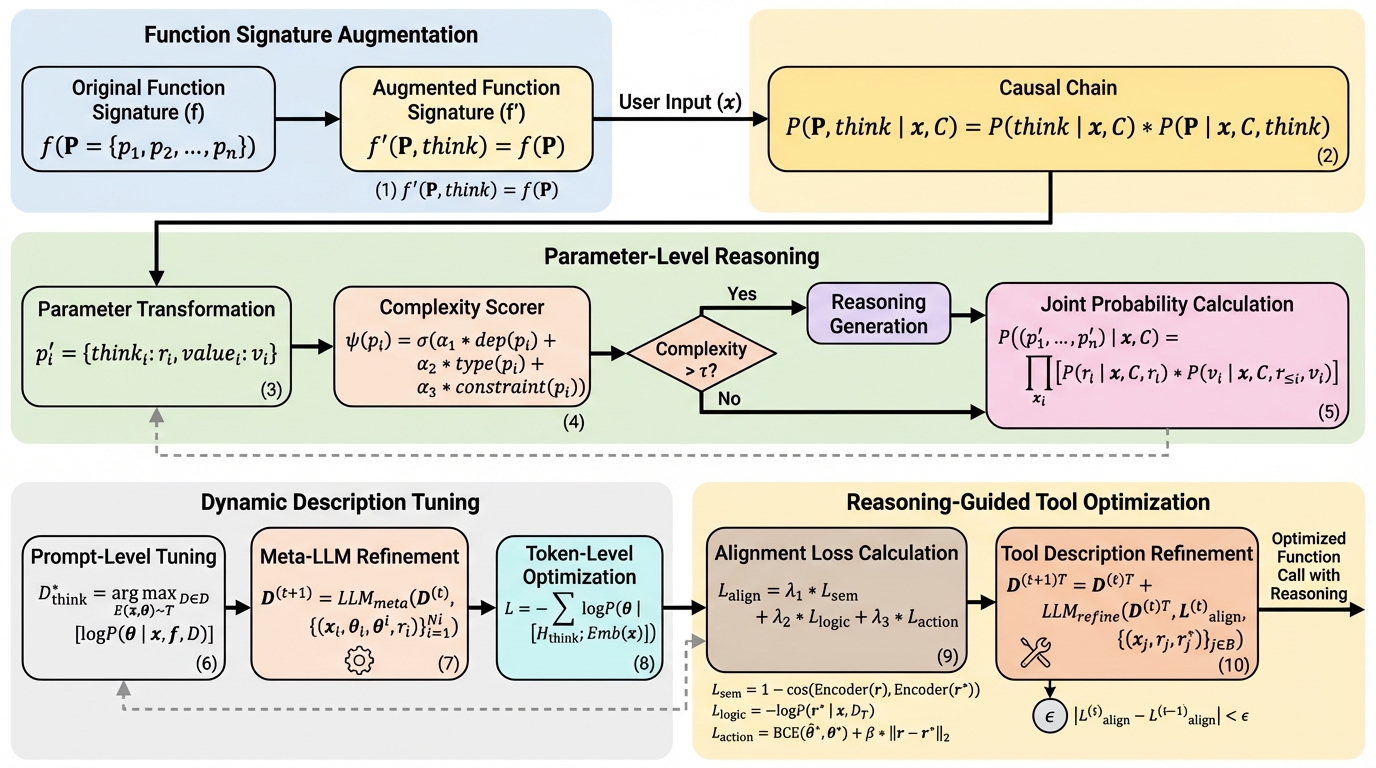

本研究は、大規模言語モデル(LLM)の関数呼び出しにおいて、関数の引数(パラメータ)ごとに明示的な推論プロセスを組み込む新フレームワーク「TAFC」を提案した。 従来の関数呼び出しが抱えていた「パラメータ生成時の推論の不透明性」を解消するため、関数シグネチャに「think」パラメータを追加し、モデルが意思決定の根拠を記述してから値を生成する仕組みを導入している。 ToolBenchを用いた検証では、GPT-4oやLlama-3.1などの主要モデルにおいて、特に複雑な複数パラメータを持つ関数の生成精度と推論の整合性が大幅に向上し、小規模モデルでも顕著な改善が確認された。