思考強化型関数呼び出し:埋め込み推論によるLLMパラメータ精度の向上

本研究は、大規模言語モデル(LLM)の関数呼び出しにおいて、関数の引数(パラメータ)ごとに明示的な推論プロセスを組み込む新フレームワーク「TAFC」を提案した。 従来の関数呼び出しが抱えていた「パラメータ生成時の推論の不透明性」を解消するため、関数シグネチャに「think」パラメータを追加し、モデルが意思決定の根拠を記述してから値を生成する仕組みを導入している。 ToolBenchを用いた検証では、GPT-4oやLlama-3.1などの主要モデルにおいて、特に複雑な複数パラメータを持つ関数の生成精度と推論の整合性が大幅に向上し、小規模モデルでも顕著な改善が確認された。

TL;DR(結論)

本研究は、大規模言語モデル(LLM)の関数呼び出しにおいて、関数の引数(パラメータ)ごとに明示的な推論プロセスを組み込む新フレームワーク「TAFC」を提案した。 従来の関数呼び出しが抱えていた「パラメータ生成時の推論の不透明性」を解消するため、関数シグネチャに「think」パラメータを追加し、モデルが意思決定の根拠を記述してから値を生成する仕組みを導入している。 ToolBenchを用いた検証では、GPT-4oやLlama-3.1などの主要モデルにおいて、特に複雑な複数パラメータを持つ関数の生成精度と推論の整合性が大幅に向上し、小規模モデルでも顕著な改善が確認された。

なぜこの問題か

大規模言語モデル(LLM)は、外部ツールやAPIと連携して複雑なタスクを遂行する自律型エージェントの基盤として、目覚ましい発展を遂げている。その中核となる機能が「関数呼び出し(Function Calling)」であり、これはモデルが構造化されたパラメータを用いて外部機能を呼び出すことを可能にする。しかし、現在の関数呼び出しメカニズムには、パラメータ生成過程における推論の透明性が欠如しているという重大な課題が存在する。特に、複数のパラメータが互いに依存し合う複雑な関数の場合、モデルがなぜその値を選択したのかという論理的なプロセスがブラックボックス化している。 既存の手法であるChain-of-Thought(CoT)プロンプティングやReActフレームワークは、エージェント全体の行動レベルでの推論には成功しているが、個々の関数パラメータに対するきめ細かな推論ガイダンスを提供するには至っていない。関数呼び出しは出力の構造を保証するという利点がある一方で、従来のプロンプト手法のような自由な推論の記述が制限される傾向にある。…

核心:何を提案したのか

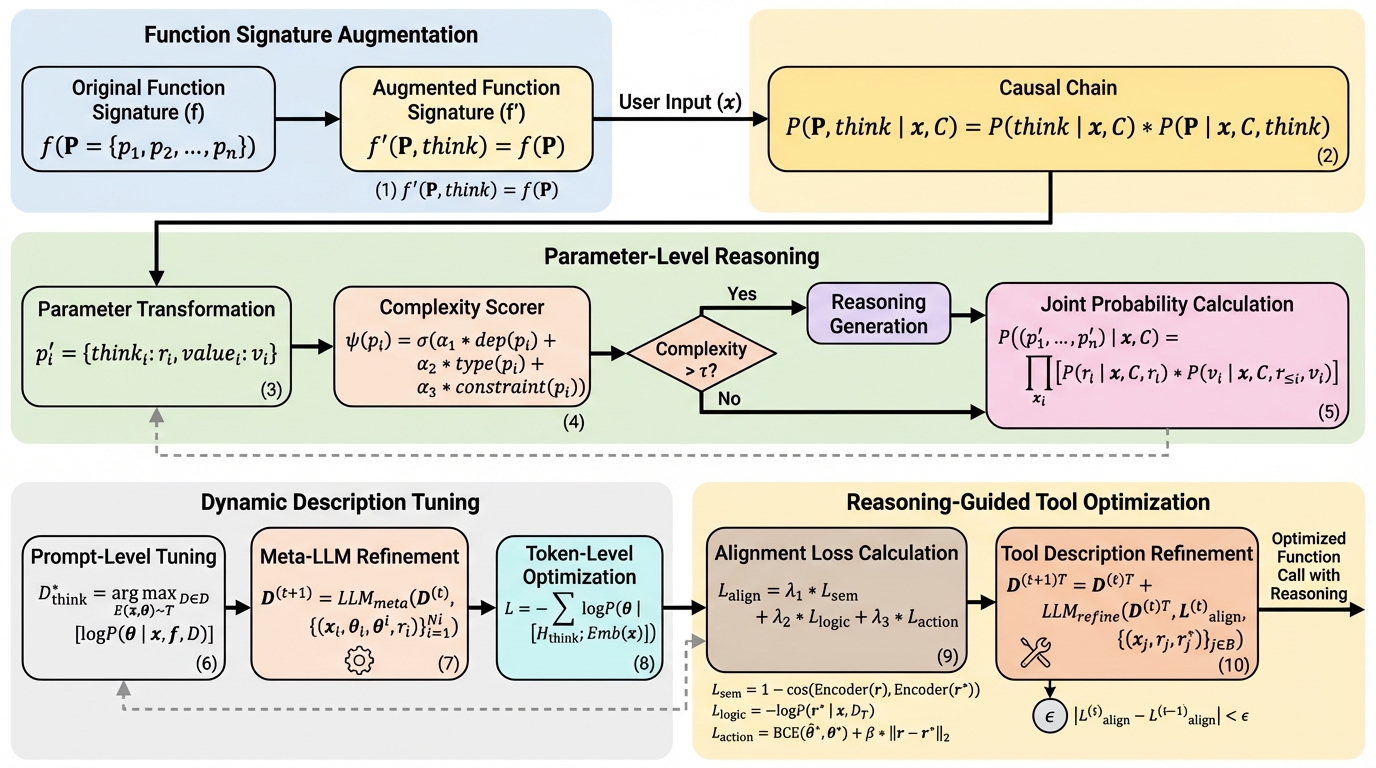

本研究では、関数呼び出しの精度と透明性を向上させるための新しいフレームワークとして「Think-Augmented Function Calling(TAFC)」を提案した。この手法の核心は、関数の定義(シグネチャ)自体に「think」という推論用のパラメータを汎用的に追加することにある。これにより、モデルはネイティブな関数呼び出しの枠組みの中で、自身の意思決定プロセスを言語化することが可能になる。TAFCは、関数レベルとパラメータレベルの両方で明示的な推論を組み込むことで、生成される値の妥当性を高める設計となっている。 TAFCの特徴は、既存のLLMのアーキテクチャに一切の変更を加える必要がない点にある。既存のAPIとの完全な互換性を維持しながら、モデルが本来持っている推論能力を構造化された出力の中で最大限に引き出すことができる。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related