MemWeaver: 追跡可能な長期的エージェント推論のためのハイブリッドメモリの織り合わせ

大規模言語モデル(LLM)ベースのエージェントが長期的な対話において、時間の経過に伴う一貫性の欠如や複雑な推論の困難さに直面する問題を解決するため、グラフ、経験、パッセージの3層からなる統合メモリフレームワーク「MemWeaver」が提案されました。

TL;DR(結論)

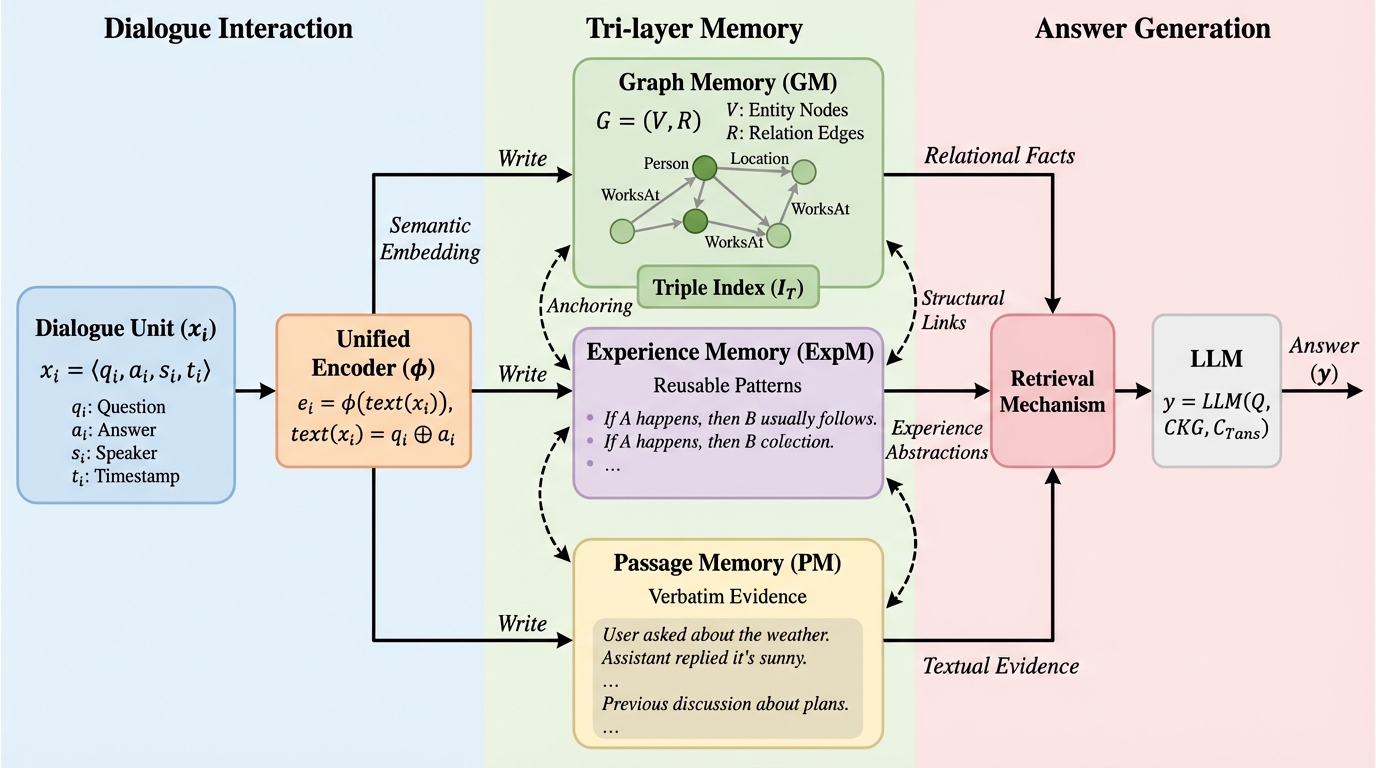

大規模言語モデル(LLM)ベースのエージェントが長期的な対話において、時間の経過に伴う一貫性の欠如や複雑な推論の困難さに直面する問題を解決するため、グラフ、経験、パッセージの3層からなる統合メモリフレームワーク「MemWeaver」が提案されました。 このシステムは、時間情報を付与した知識グラフによる構造的推論、繰り返される対話パターンを抽象化した経験メモリ、そして生の証拠を保持するパッセージメモリを相互に連携させ、情報の整理と更新を体系的に行うコンソリデーション(統合整理)プロセスを導入しています。 LoCoMoベンチマークを用いた検証の結果、MemWeaverはマルチホップ推論や時間的推論の精度を大幅に向上させつつ、従来の長いコンテキストをそのまま入力する手法と比較して、推論時の入力トークン数を95%以上削減することに成功しました。

なぜこの問題か

大規模言語モデル(LLM)をベースとしたエージェントは、対話型アシスタントやパーソナライズされたシステムなど、複数のセッションにわたる長期的な対話設定で展開されることが増えています。このようなシナリオでは、エージェントは時間の経過に伴う一貫性を維持し、ユーザー固有の知識を蓄積し、遠い過去の相互作用に基づいて推論を行う必要があります。しかし、LLMのコンテキストウィンドウには制限があるため、内部表現だけに頼ることは不可能であり、外部メモリメカニズムが不可欠となっています。 既存のメモリ研究の多くは、過去の相互作用をパッセージや埋め込みとして保存し、意味的類似性に基づいて検索する「フラットな検索メモリ」に依存しています。しかし、図1で示されているように、これらの手法には長期的な設定において重要な限界があります。まず、フラットな検索メモリは関係性や時間的な構造を欠いているため、マルチホップ(複数段階)のクエリや時間に制約のあるクエリに対して脆弱です。また、知識グラフを用いた構造化メモリの手法も提案されていますが、セッションレベルの検証が不足しているため、ノイズの多い抽出や矛盾の蓄積に悩まされることがあります。…

核心:何を提案したのか

本論文では、長期的なエージェントのためのコンソリデーション中心の3層メモリフレームワーク「MemWeaver」を提案しています。MemWeaverは、長期メモリを以下の3つの相補的なコンポーネントで構成し、それらを相互に「織り合わせる」ことで統合的なメモリ表現を実現しています。 第一の層は「グラフメモリ(Graph Memory, GM)」です。これは、正規化された絶対時間メタデータを持つ、時間的に接地された知識グラフです。時間認識型のマルチホップ推論をサポートし、セッションレベルでの矛盾の解消を可能にします。散らばった事実情報を、安定したエンティティと関係の表現へと統合します。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related