FGGM:継続学習のためのフィッシャー誘導型勾配マスキング

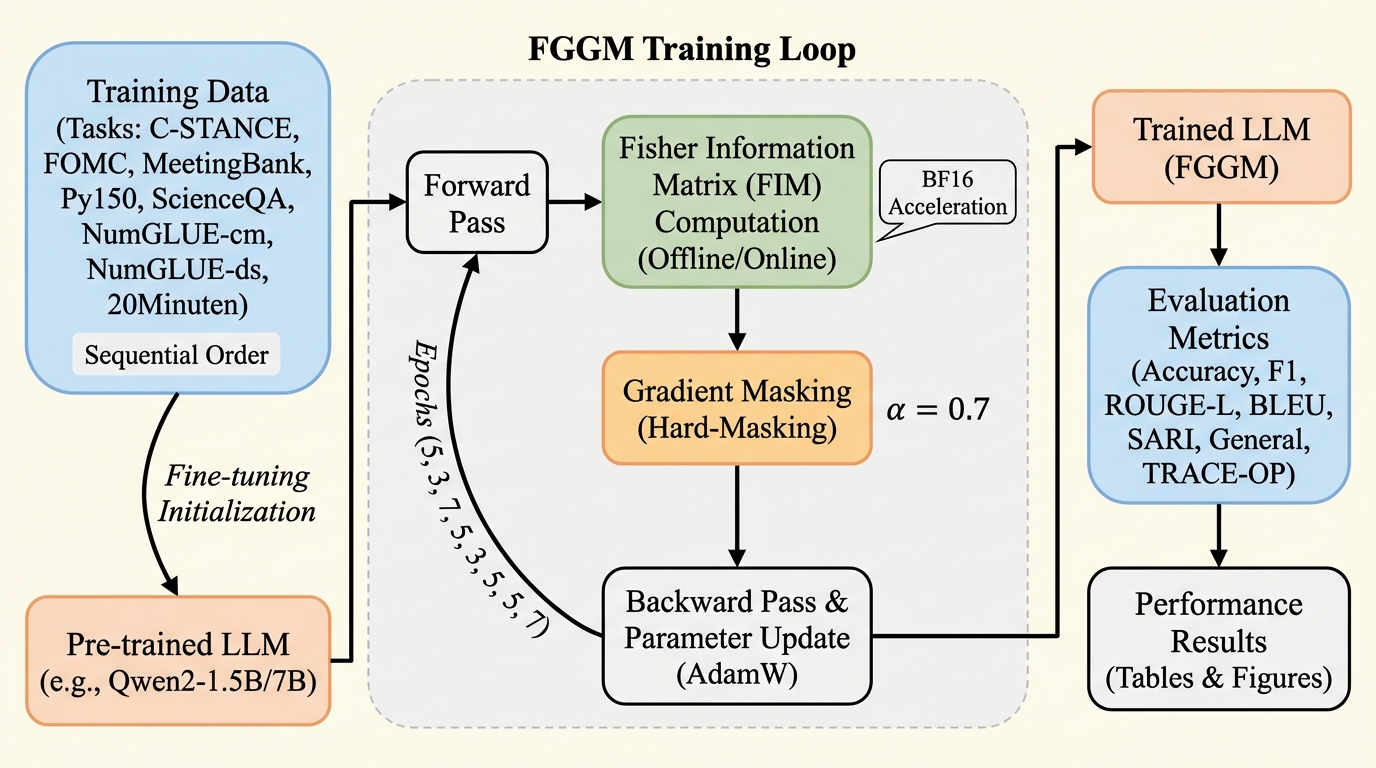

FGGM(Fisher-Guided Gradient Masking)は、大規模言語モデル(LLM)が新しいタスクを学習する際に過去の知識を失う「破滅的忘却」を防ぐため、フィッシャー情報行列(FIM)を用いてパラメータの重要度を数学的に評価し、重要な箇所の更新を制限する新しいフレームワークである。

TL;DR(結論)

FGGM(Fisher-Guided Gradient Masking)は、大規模言語モデル(LLM)が新しいタスクを学習する際に過去の知識を失う「破滅的忘却」を防ぐため、フィッシャー情報行列(FIM)を用いてパラメータの重要度を数学的に評価し、重要な箇所の更新を制限する新しいフレームワークである。 過去の学習データに一切アクセスすることなく、新しいタスクのデータのみから対角フィッシャー情報を近似計算し、適応的な閾値によるバイナリマスクを生成して勾配に適用することで、モデルの安定性と可塑性のバランスを動的に最適化し、既存知識の保持と新知識の習得を両立させる。 実験では、Qwen2モデルを用いて既存手法のMIGUや逐次微調整を上回る知識保持性能を実証し、特にモデルの規模が大きくなるほどその優位性が顕著になることを確認しており、データのプライバシーやストレージの制約がある実用的な継続学習シナリオにおける強力な解決策となる。

なぜこの問題か

大規模言語モデル(LLM)が多様な自然言語処理タスクに対応する汎用的なツールとして普及する中で、継続学習(CL)における「破滅的忘却」が深刻な課題となっている。これは、モデルが新しいタスクやデータセットで訓練される際、以前に習得した知識を急激に失ってしまう現象を指す。この問題を解決するための既存手法には主に三つのアプローチがある。第一に、過去のデータを保存して再学習に利用するリプレイ型があるが、これはデータのプライバシー保護やストレージの拡張性の観点から実用上の制約が多い。第二に、モデルのパラメータを固定して一部の追加パラメータのみを訓練する手法(LoRAやPrompt Tuningなど)があるが、これはモデルの表現力を制限し、特定のタスクでの性能を十分に引き出せない可能性がある。第三に、重要な重みの変化を抑制する正則化型があるが、代表的な手法であるEWCは過去のデータへのアクセスを必要とし、またOGDなどは膨大なメモリを消費するため、パラメータ数が多いLLMへの直接適用は困難である。…

核心:何を提案したのか

本研究では、フィッシャー情報行列(FIM)を活用してパラメータの重要度を戦略的に選択し、勾配にマスクをかけることで更新を制御する「FGGM(Fisher-Guided Gradient Masking)」というフレームワークを提案した。この手法の核心は、新しいタスクのデータのみを使用して、各パラメータがタスクの損失関数にどの程度寄与しているかをフィッシャー情報として定量化し、それに基づいて更新すべき箇所を決定する点にある。FGGMは、過去のデータセットを一切保持することなく、モデルの「安定性(既存知識の保持)」と「可塑性(新しい知識の習得)」のバランスを動的に制御することを可能にする。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related