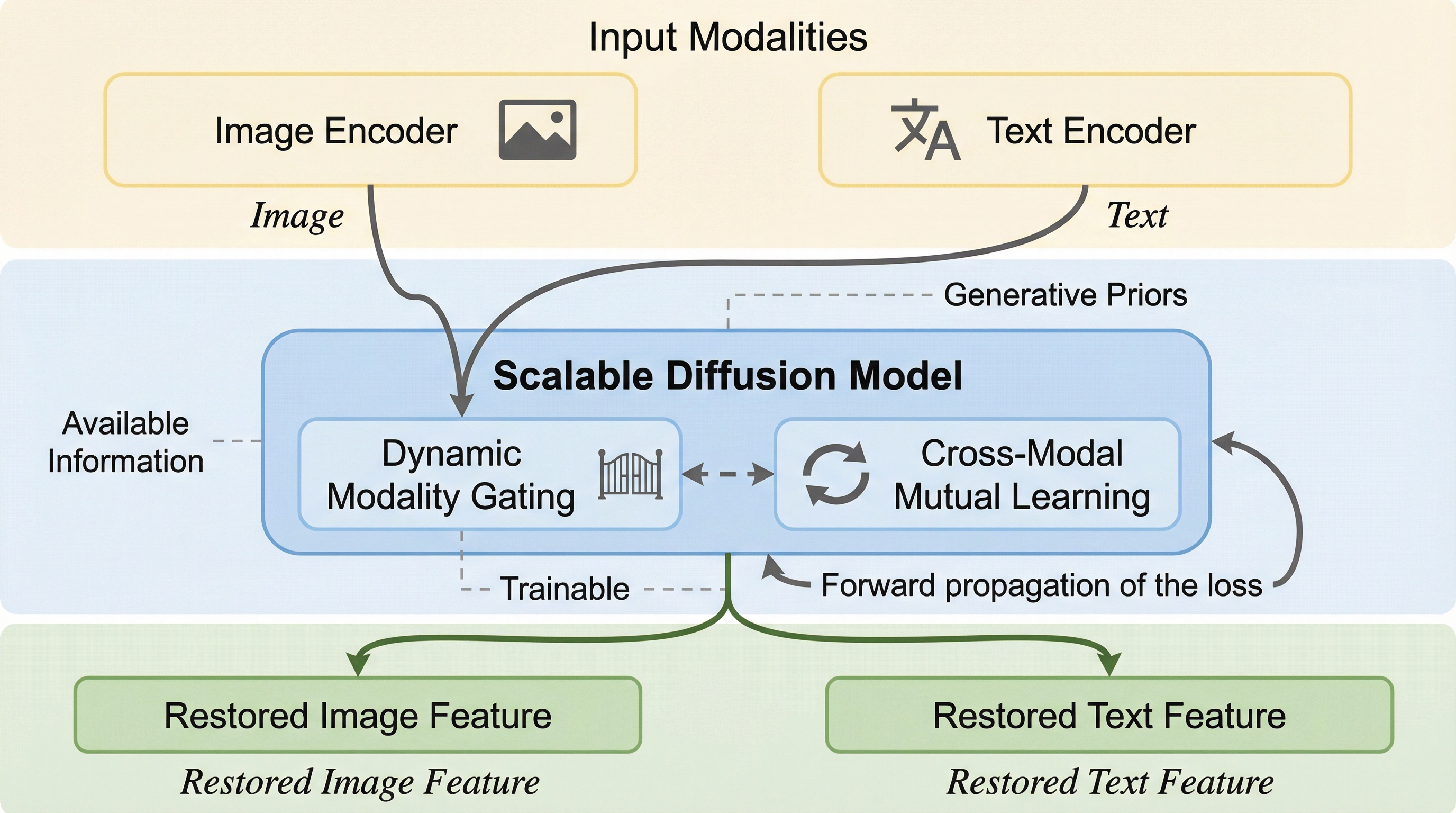

欠損モダリティに対する基盤VLMの堅牢性向上:双方向の特徴復元のためのスケーラブルな拡散

視覚と言語を統合する基盤モデル(VLM)は、推論時に画像やテキストのいずれかが欠損すると性能が著しく低下するという深刻な課題を抱えています。本研究はこの問題に対し、拡散モデルの強力な生成能力を活用して欠損した特徴を中間段階で復元する、既存のネットワークを凍結したままプラグインとして挿入可能な新しい学習戦略を提案しました。 提案手法には、利用可能な情報から意味的に一貫した特徴生成を導く「動的モダリティ・ゲーティング」と、画像とテキストの双方向で意味空間を整列させる「クロスモーダル相互学習」という二つの革新的な機構が導入されています。これにより、ノイズを抑制しながら失われた情報を高精度に補完し、単一モダリティ入力とマルチモーダル表現の間のギャップを効果的に埋めることが可能になりました。 4つの主要なベンチマークを用いたゼロショット評価において、既存のプロンプトベースや補完ベースの手法を全ての欠損シナリオで凌駕し、最高性能を達成しました。多様な欠損率や未知のデータセットに対しても高い堅牢性と汎用性を示すことが確認され、実世界のような不完全なデータ環境下での信頼性を飛躍的に高める、基盤モデルのための強力かつスケーラブルな拡張手法を確立しました。