微調整された言語モデルにおける機密情報の意図しない記憶

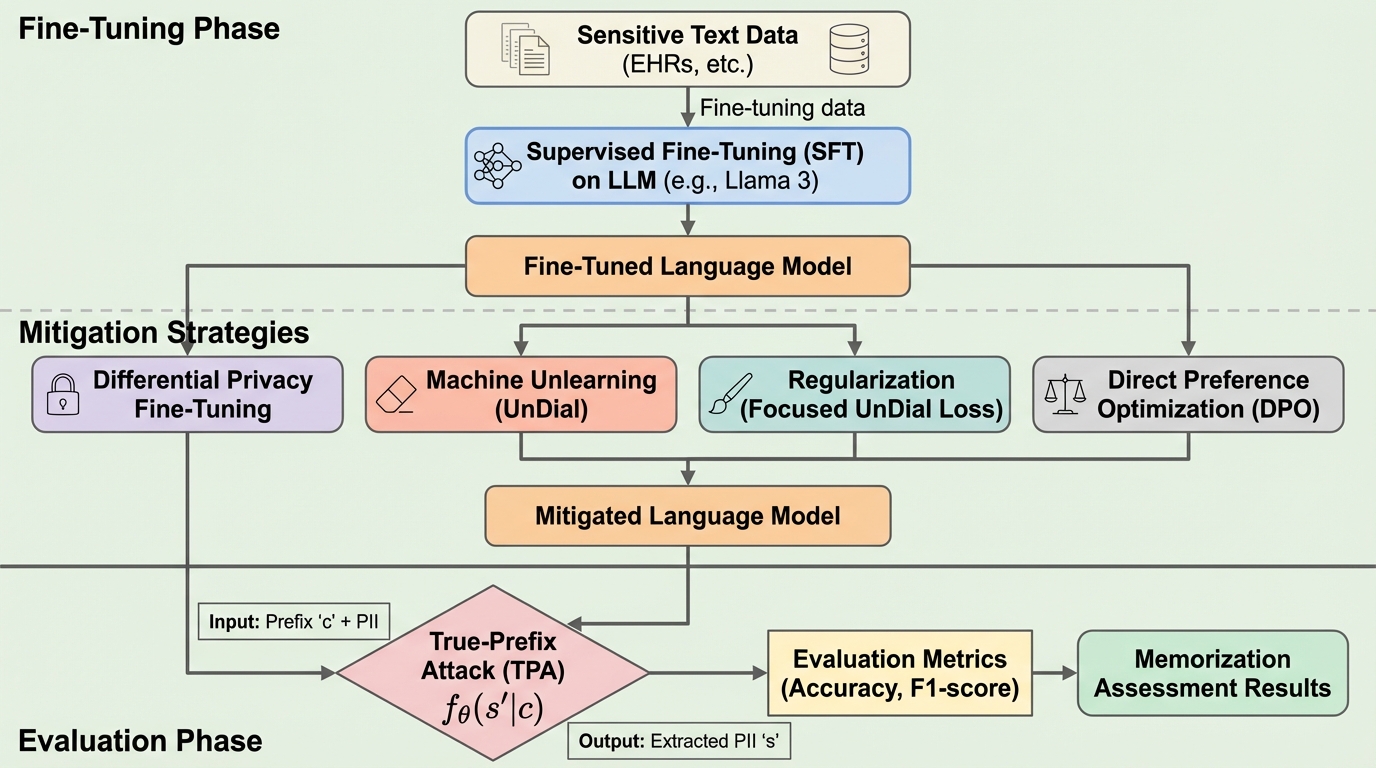

大規模言語モデル(LLM)を特定のデータセットで微調整する際、学習の目的(ターゲット)には含まれず、入力データにのみ存在する個人識別情報(PII)が意図せず記憶され、外部からの攻撃によって抽出可能になるリスクを、合成データと実世界の医療データを用いて体系的に明らかにした。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

大規模言語モデル(LLM)を特定のデータセットで微調整する際、学習の目的(ターゲット)には含まれず、入力データにのみ存在する個人識別情報(PII)が意図せず記憶され、外部からの攻撃によって抽出可能になるリスクを、合成データと実世界の医療データを用いて体系的に明らかにした。

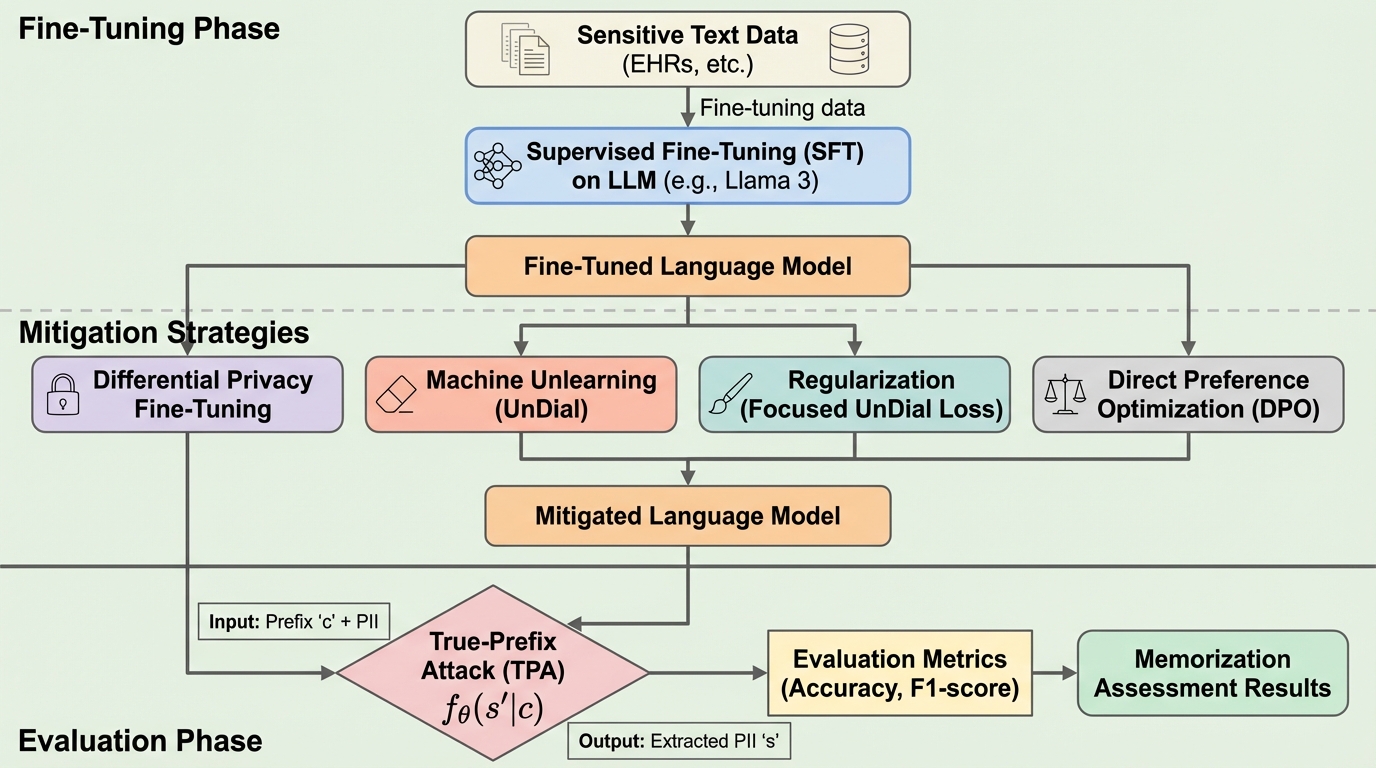

従来の対話型AIにおけるガードレールは、あらかじめ定義された静的なルールに依存しているため、運用中に発生する新しい脅威や多様な展開コンテキストに柔軟に適応できないという深刻な課題を抱えていたが、本研究ではガードレールの自己構築と継続的な自動改善を実現する革新的なフレームワーク「Lattice」を提案した。

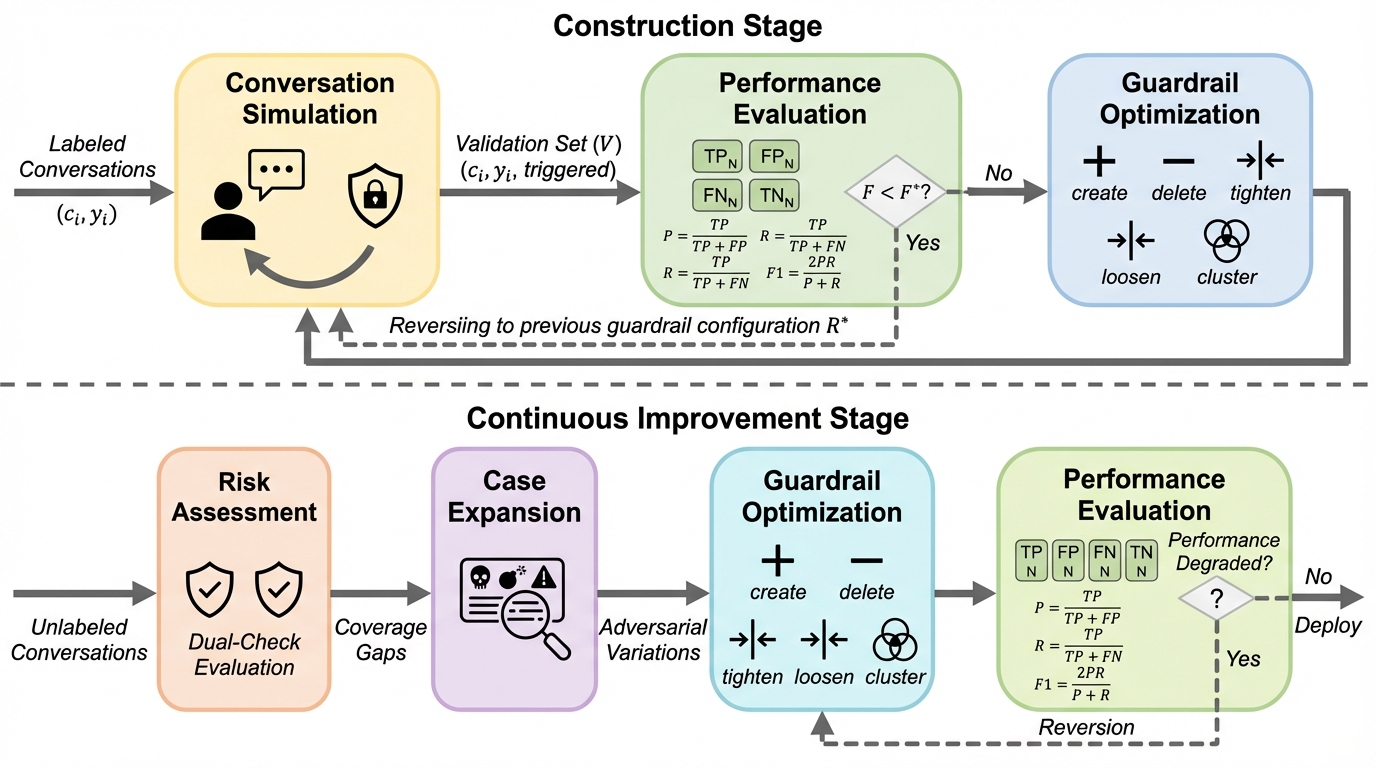

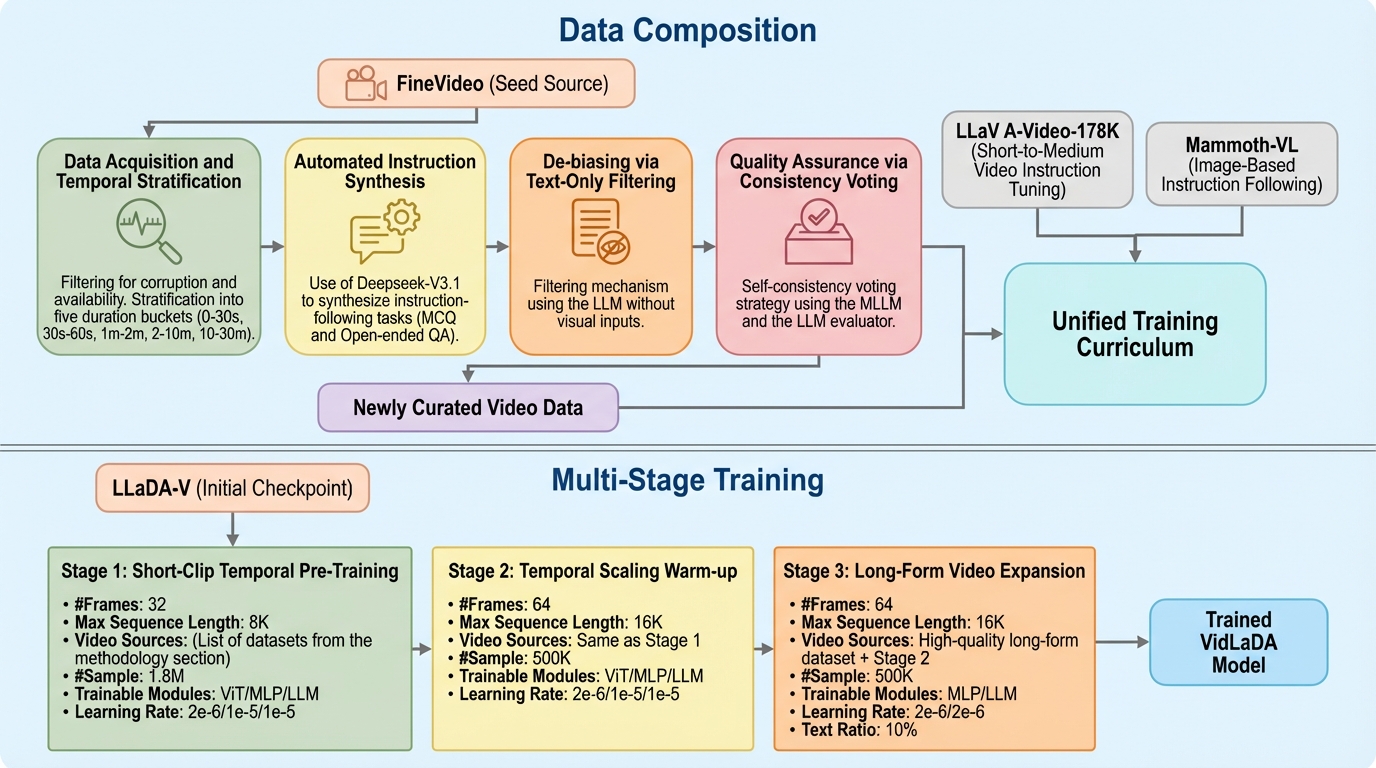

従来のビデオ大規模言語モデルが抱えていた自己回帰型モデル特有の単方向アテンションによる理解の限界と、逐次デコードによる生成速度の遅さを、双方向アテンションを持つ拡散言語モデル(DLM)を採用することで根本から解決した。

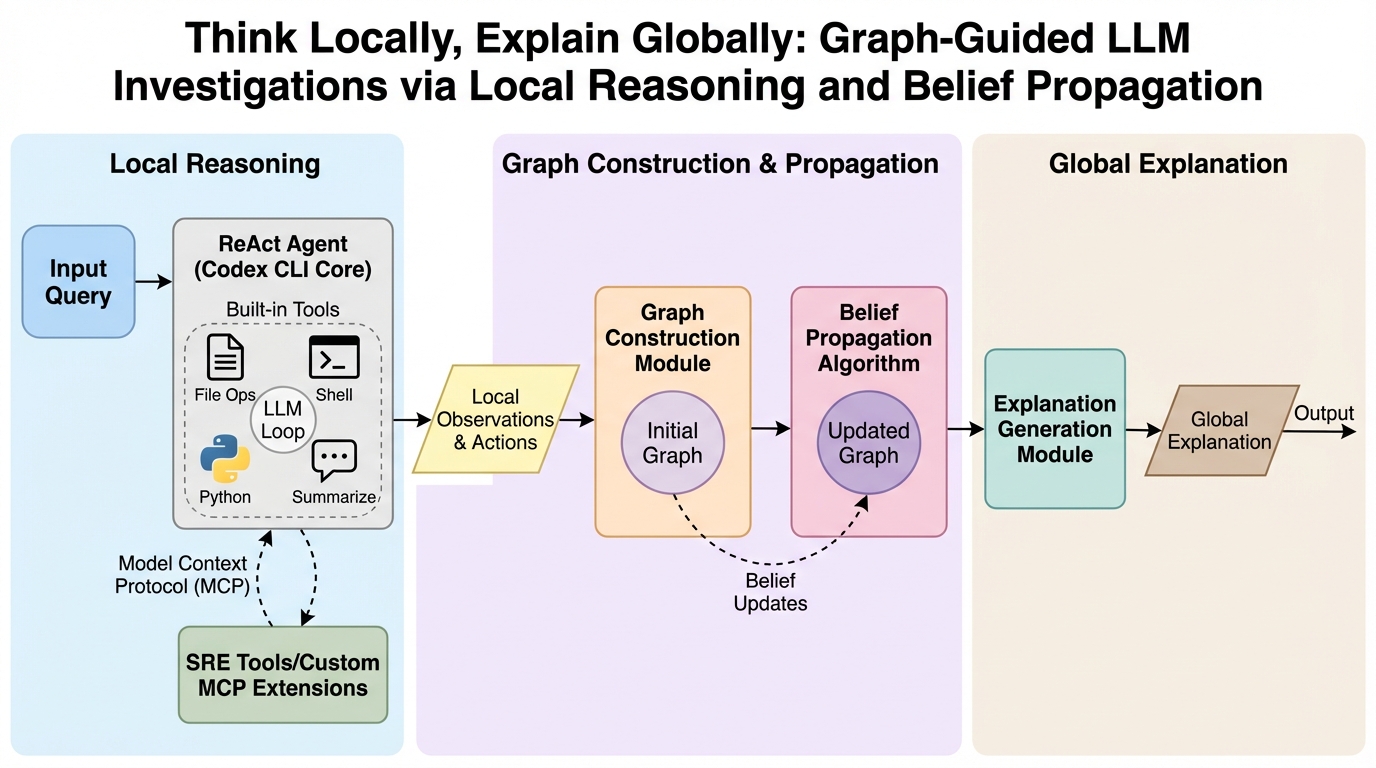

Think Locally, Explain Globally: 局所的推論と信念伝播によるグラフ誘導型LLM調査フレームワーク「EoG」の提案

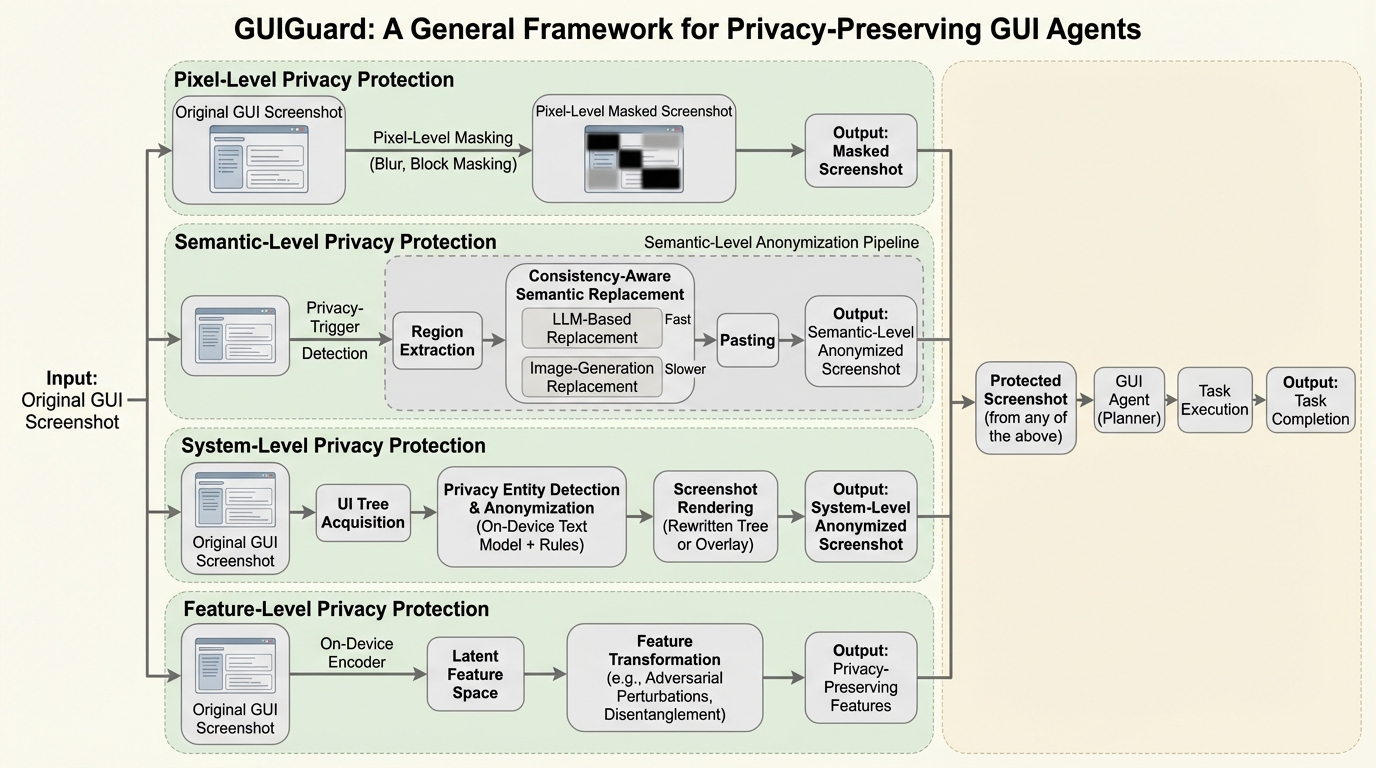

GUIエージェントが画面情報をリモートモデルに送信する際に生じる深刻なプライバシーリスクを解決するため、認識・保護・実行の3段階で構成される汎用フレームワーク「GUIGuard」が提案されました。

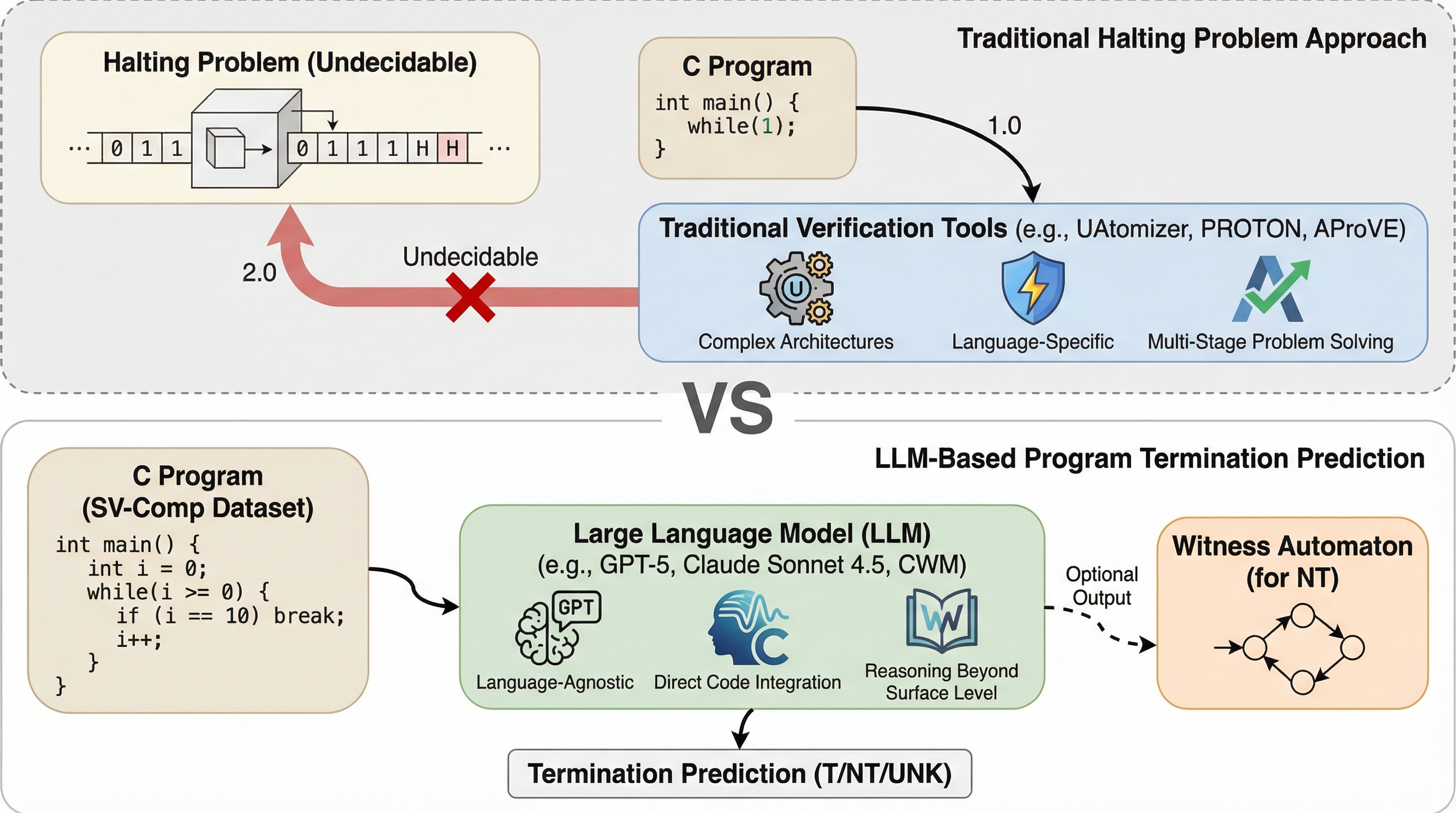

大規模言語モデル(LLM)は、計算機科学の難問である「停止問題」の予測において、専門的な検証ツールに匹敵する極めて高い性能を示した。特にGPT-5やClaude Sonnet-4.5は、国際的なソフトウェア検証コンペティション(SV-Comp 2025)のトップクラスのツールに次ぐスコアを記録し、その推論能力の高さが証明された。 一方で、プログラムが終了しないことの数学的な証明となる「証拠(ウィットネス)」の生成には依然として課題があり、コードの長さや複雑さが増すにつれて予測精度が低下する傾向も確認された。 信頼性を高めるために導入された「テストタイム・スケーリング(TTS)」による合意形成アルゴリズムは、モデルの不確実性を適切に管理し、誤判定によるペナルティを回避してスコアを劇的に向上させる有効な手段であることが明らかになった。

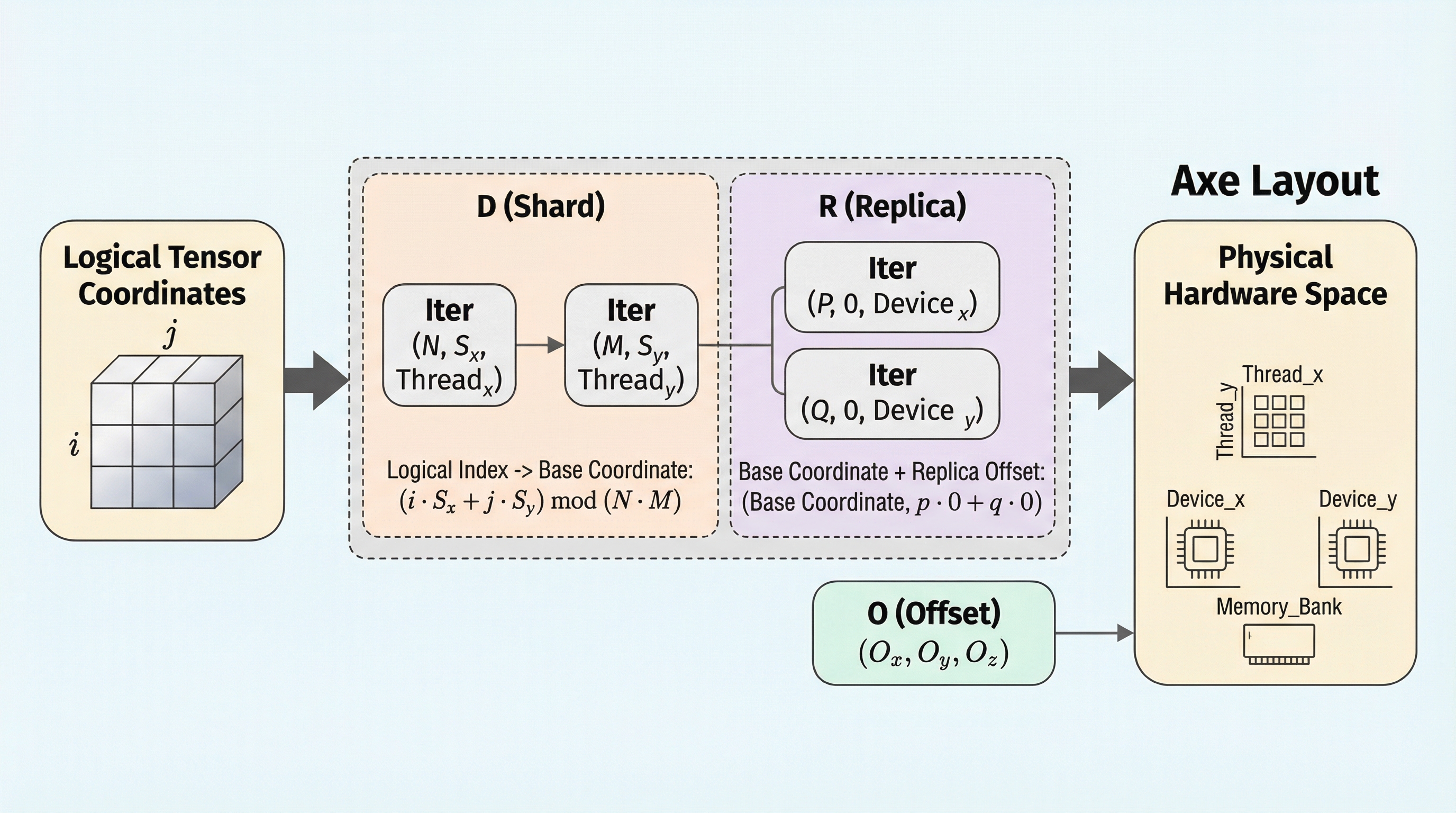

現代の深層学習ワークロードのスケールアップに伴い、デバイスメッシュやメモリ階層、異種アクセラレータ間でのデータと計算の調整が不可欠となっていますが、本論文は論理的なテンソル座標を「名前付き軸」を介して多軸物理空間にマッピングする、ハードウェアを意識した抽象化「Axe Layout」を提案しています。

推薦システムにおいてLLMを用いた説明エージェントは、ユーザーの行動履歴から自然言語で推薦理由を生成するが、誤クリックやデータの欠落といった現実的なノイズに対する堅牢性はこれまで十分に検証されていなかった。

DualAgent-Recは、LLMを高度なオーケストレーターとして活用し、推薦精度と多様性の最適化、および公平性や出品者カバレッジといった厳しいビジネス制約の完全な遵守を両立させる新しいマルチエージェント・フレームワークです。

PROTEUSは、LLMの運用者が実行時に精度目標($\tau$)を直接入力できる革新的なポリモーフィック・ルーターであり、ラグランジュ双対制御を導入することで、単一の学習済みモデルのみで多様なサービスレベル契約(SLA)に即座に対応することを可能にしました。