局所的に思考し、大域的に説明する:局所的推論と信念伝播によるグラフ誘導型LLMの調査

Think Locally, Explain Globally: 局所的推論と信念伝播によるグラフ誘導型LLM調査フレームワーク「EoG」の提案

TL;DR(結論)

大規模で複雑なITインシデント調査において、従来のReAct型LLMエージェントはコンテキスト窓の制限や推論の非決定性により、一貫した診断結果を出せない「信頼性のギャップ」という課題を抱えています。 本研究が提案するEoG(Explanations over Graphs)は、決定論的なコントローラーがグラフ探索と状態管理を行い、LLMが局所的な証拠のラベル付けを行う役割分離型のアーキテクチャを採用することで、推論の安定性を高めています。 ITBenchを用いた検証では、EoGは従来のReActベースの手法と比較して、実行ごとの一貫性を示す指標であるMajority@kにおいて平均で7倍の向上を達成し、複雑な依存関係の中からの根本原因特定において高い性能を示しました。

なぜこの問題か

現代のITインシデント管理やクラウドインフラの運用において、オペレーターは膨大なログ、メトリクス、トレース、イベントデータの中から、発生した障害の根本原因を特定しなければなりません。この調査プロセスは、エンティティ間の複雑な依存関係が隠れているため非常に困難です。ある事実の重要性は、他の証拠が発見された後に初めて明らかになることが多く、情報の発見順序が結論に大きな影響を与えます。 既存のLLMエージェント、特にReAct(Reasoning and Acting)やCodeActといった手法は、このような動的で大規模な環境での調査においていくつかの致命的な限界を露呈しています。第一に、LLMのコンテキスト窓には限りがあるため、エージェントは情報の重要性が確定する前に中間結果を要約して捨てる必要があり、これが重要な証拠の喪失につながります。第二に、ReAct型のエージェントは「取得・要約・推論」のループを繰り返しますが、このプロセスは探索の順序に極めて敏感であり、実行ごとに結果が異なる非決定性の問題を引き起こします。 論文内ではこれを「信頼性のギャップ」と呼んでいます。…

核心:何を提案したのか

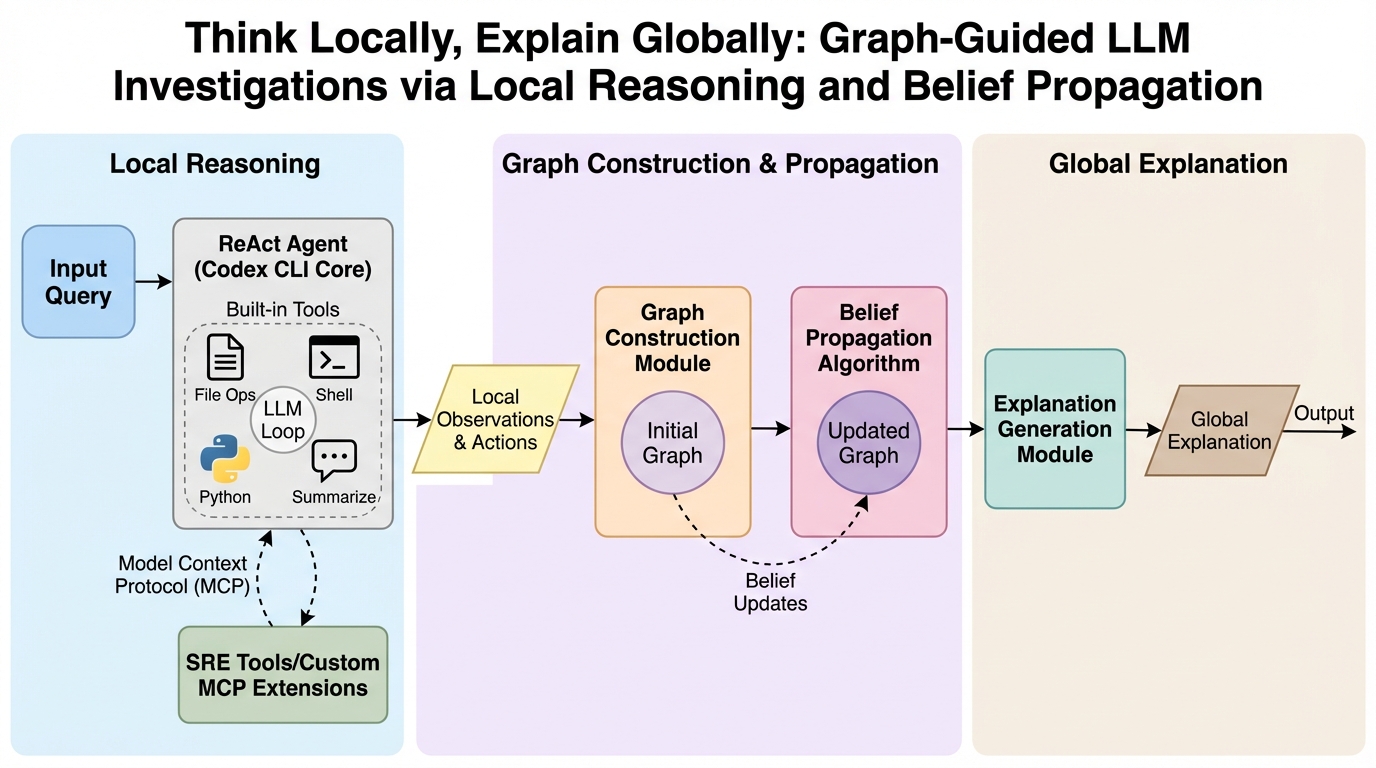

本研究では、インシデント調査を依存関係グラフ上の「アブダクション推論(仮説推論)」として定式化し、EoG(Explanations over Graphs)という新しいエージェントアーキテクチャを提案しています。EoGの最大の特徴は、決定論的な制御と非決定的な推論を完全に分離した「役割分離型アーキテクチャ」にあります。 具体的には、グラフの探索順序の管理、状態の保持、ツールの実行といった「コントローラー」の役割を、LLMではなく決定論的なプログラム(シンボリックエンジン)が担当します。一方で、LLMは「アブダクティブ・ポリシー」として、特定のノード(エンティティ)に関する局所的な証拠を読み取り、それが「原因(Origin)」なのか「症状(Symptom)」なのか、あるいは「正常(Healthy)」なのかを判定する役割に専念します。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related