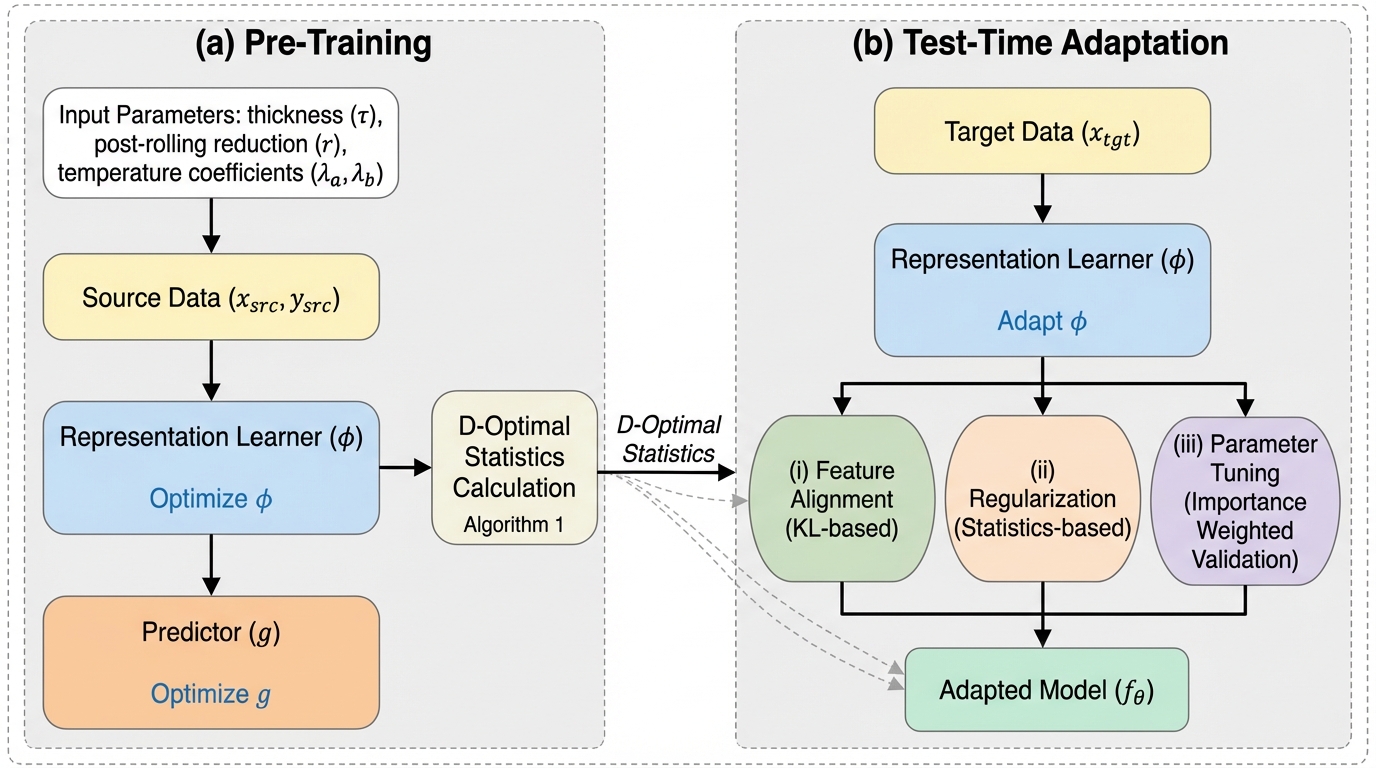

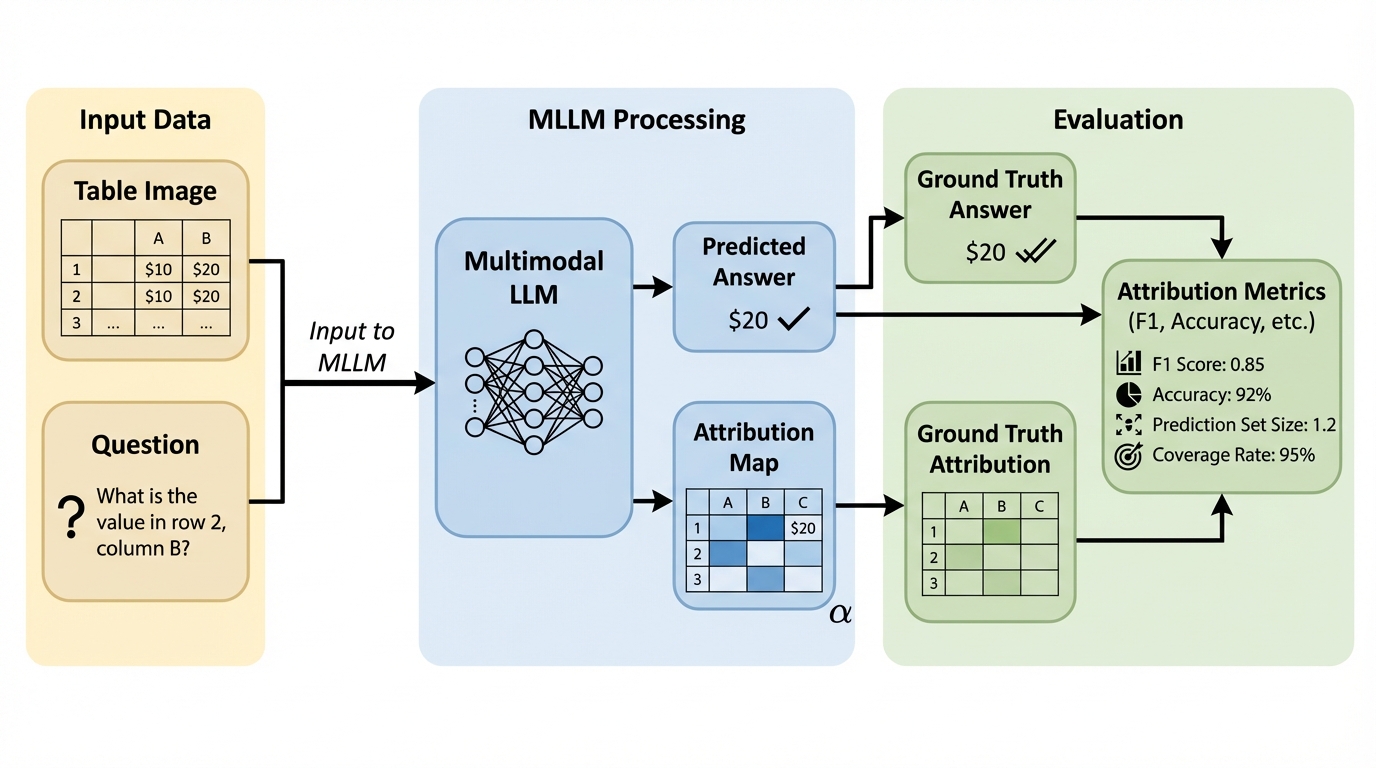

D最適(D-optimal)統計で高次元シミュレーション代理モデルのテスト時適応を安定化するSATTS

工学シミュレーションを高速化する機械学習代理モデルは、学習時と運用時で条件(形状や構成など)がずれると性能が大きく落ちやすく、特に高次元・非構造・回帰の設定では既存のテスト時適応が不安定になりやすい状況が問題になります。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

工学シミュレーションを高速化する機械学習代理モデルは、学習時と運用時で条件(形状や構成など)がずれると性能が大きく落ちやすく、特に高次元・非構造・回帰の設定では既存のテスト時適応が不安定になりやすい状況が問題になります。

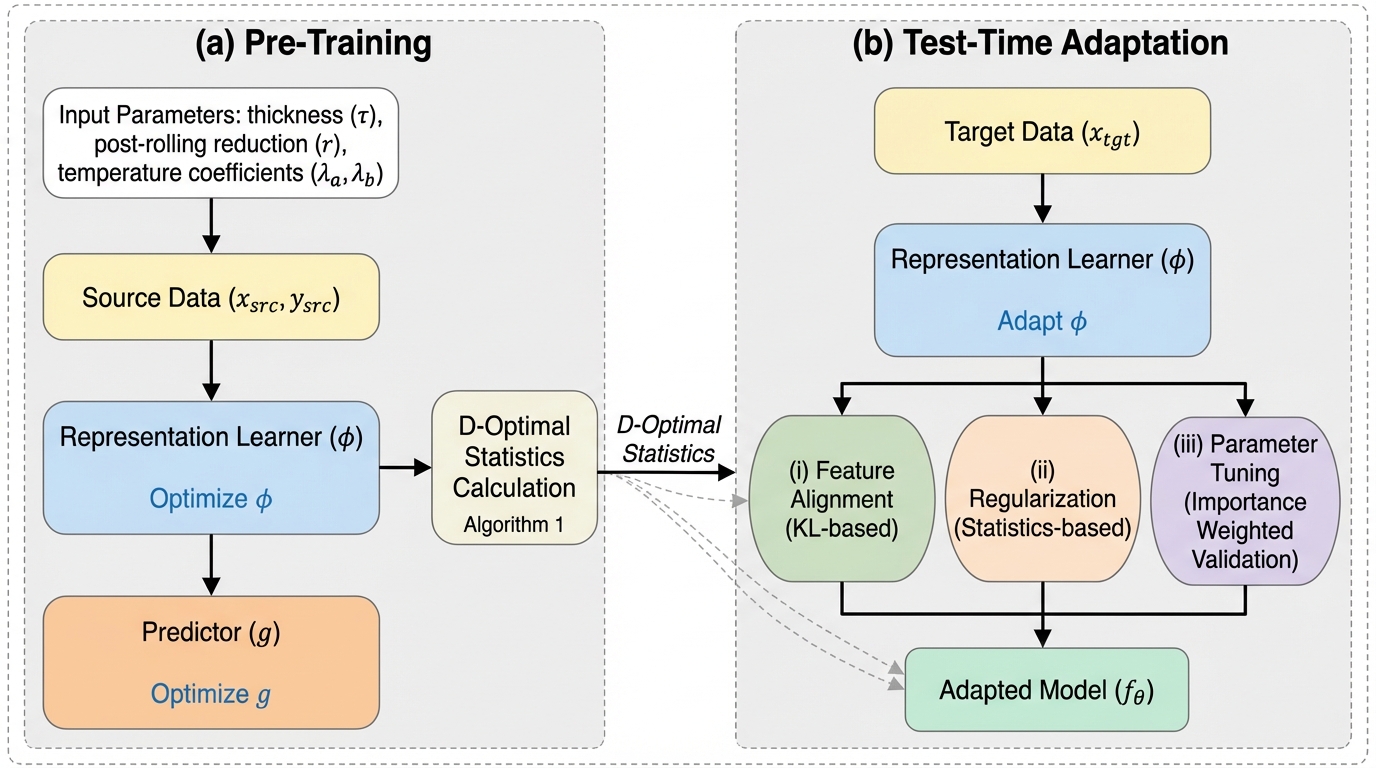

社会科学の調査や実験でLLMを「合成参加者」として使う動きが広がっていますが、その出力を人間行動の証拠として扱える条件は十分に整理されていません。 / 本論文は、プロンプト工夫や微調整などで人間と入れ替え可能だと示そうとする方法と、人間データを少量集めて統計的にずれを調整する方法を対比し、探索的研究と確認的研究で求められる前提の違いを明確にしています。 / 統計的な調整は明示的な仮定のもとで妥当性を保ちながら因果効果推定を精密化し得ますが、両方法とも「LLMが対象集団をどれだけ近似できるか」に制約され、置き換えだけに注目すると見落とす活用機会があると論じています。

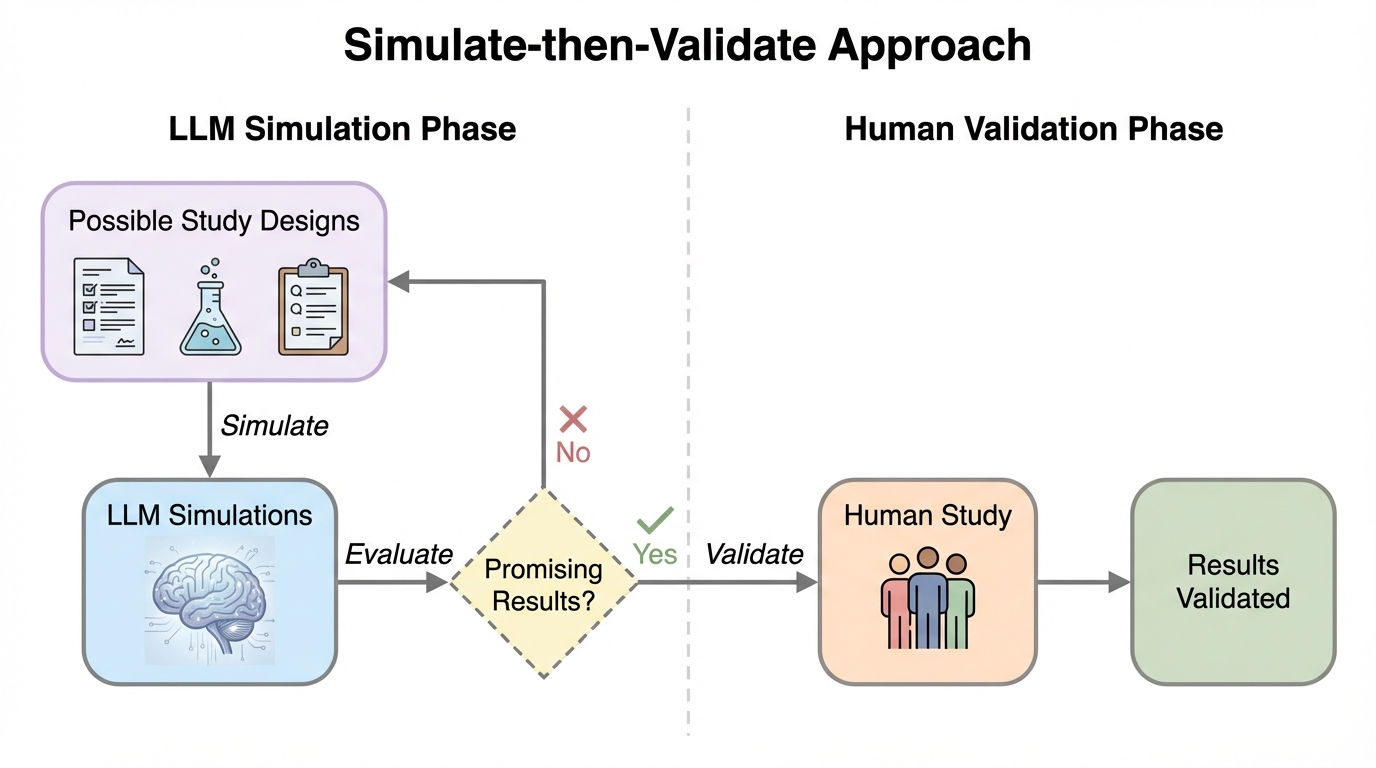

表(Markdown、JSON、画像)に対するマルチモーダル大規模言語モデルは、質問への最終回答が中程度に正しい場合があっても、その答えを支える行・列・セルを正確に指し示す能力には大きな不足があり、特にJSONでは根拠提示がほぼ偶然に近い水準まで落ちます。

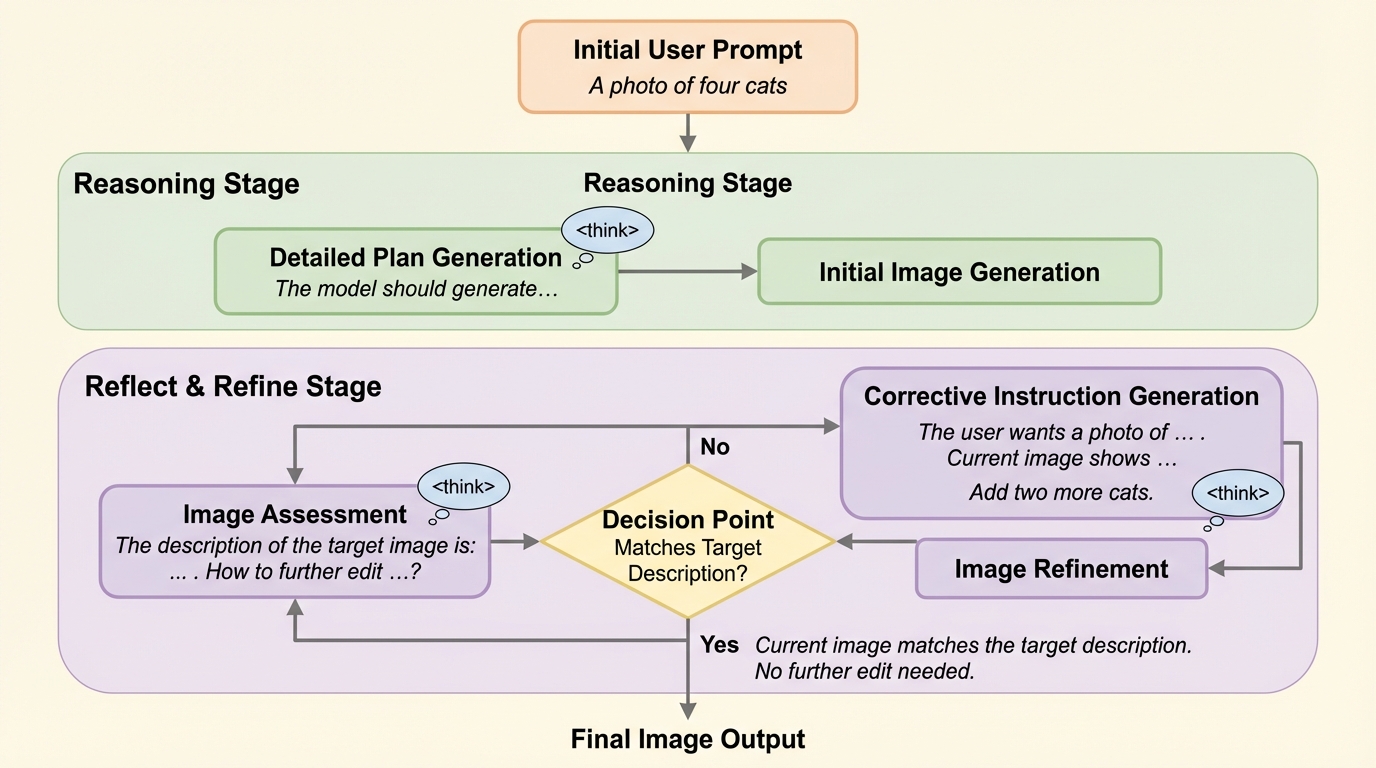

マルチモーダルモデルは、画像の「生成」を伸ばすと「理解」が落ちたり、その逆が起きたりする同時改善の難しさがあり、原因として学習目標の違いがモデル容量の競合を生みうる点が整理されています。 / この論文は単発の画像生成を、意図を推論して下書きを作り、出来栄えを自己評価し、修正指示で編集していく多段の手続きへ組み替えるReason-Reflect-Refine(R3)を提案しています。 / 最終画像の品質に基づく結果志向の報酬で一連のループを学習させ、GenEval++で生成指示追従を強化しつつ、生成内容に結び付いた理解評価(例としてカウントなど)も改善したと報告されています。

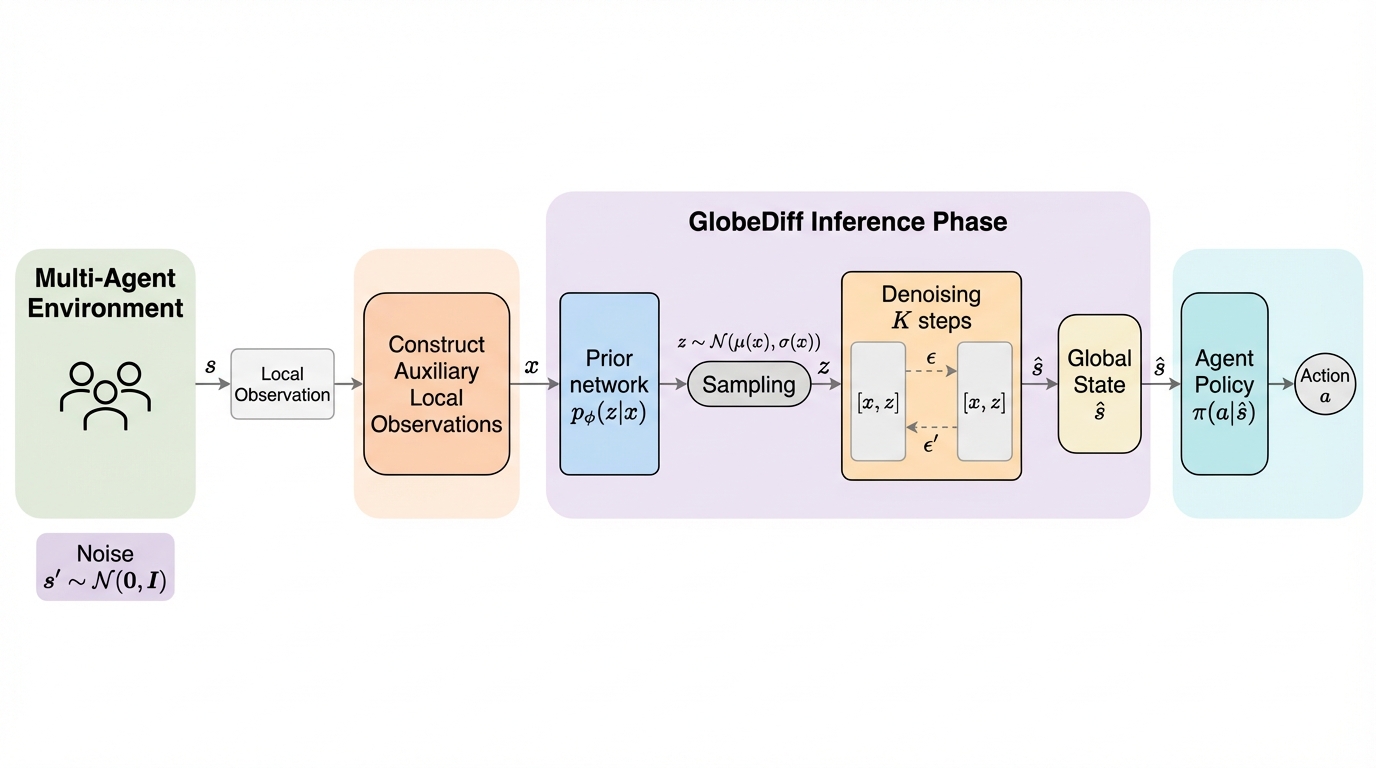

部分観測の協調タスクでは、同じローカル観測でも整合するグローバル状態が複数あり得るため、最もありそうな状態を1つに決め打つ推定は不確実性を潰してモード崩壊を起こしやすく、意思決定の不安定さにつながります。

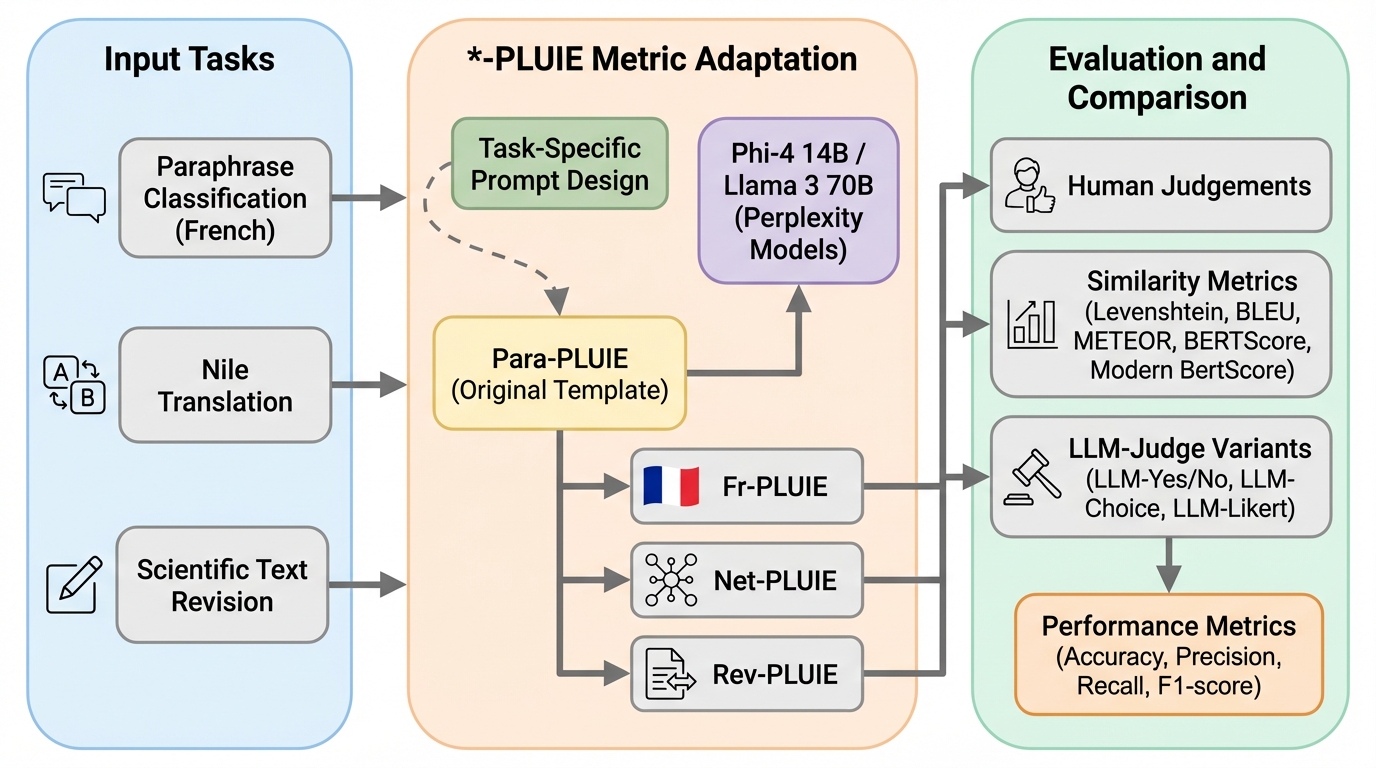

生成テキストの自動評価でLLM-judgeは有効ですが、自由文出力とその後処理が計算コストと曖昧さの原因になりやすいため、短い回答の確率だけで判断するperplexity型指標が有用になり得ます。

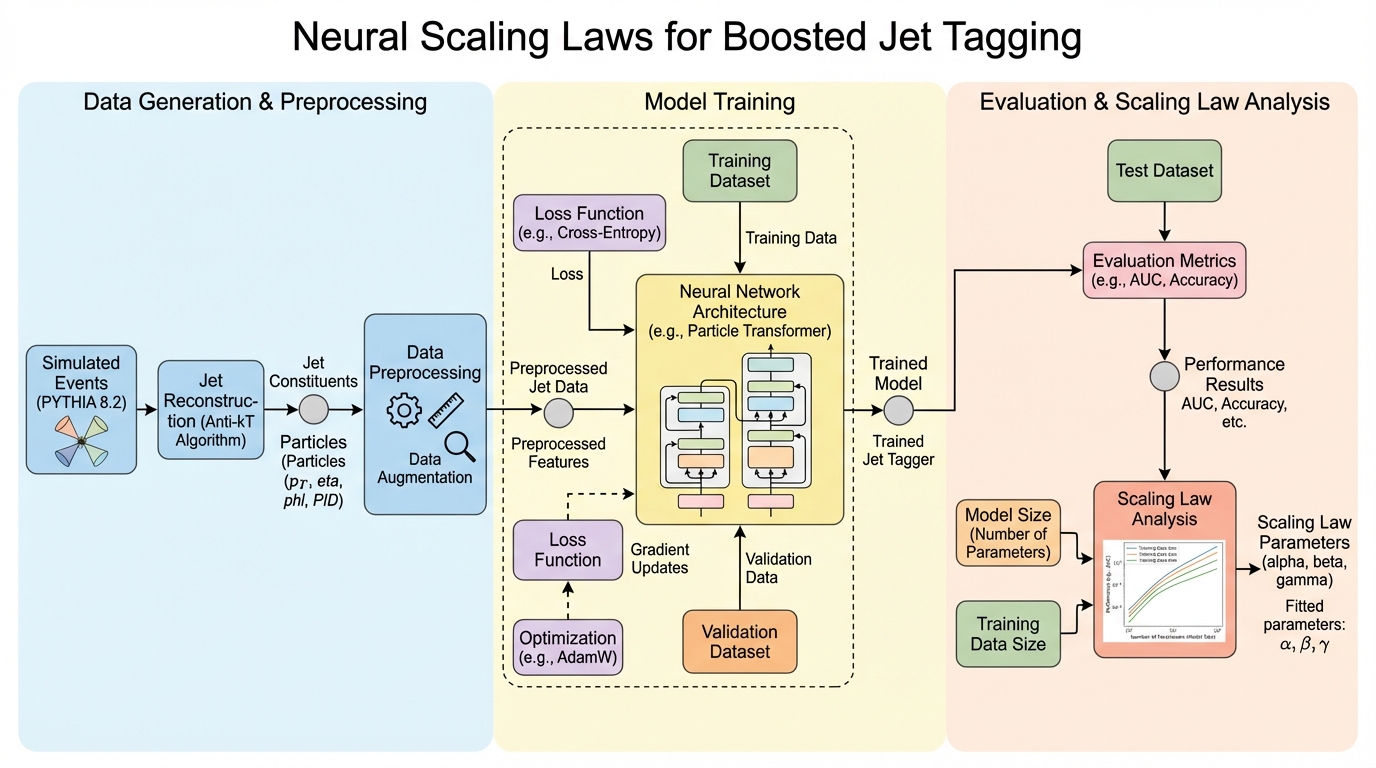

公開データセットJetClassのブーストジェット分類で、モデルのパラメータ数と学習データ数を同時に増やして学習計算量を拡張すると、検証損失が不可約損失と呼ぶ到達限界へ一貫して近づくことを、スケーリング則として整理しています。

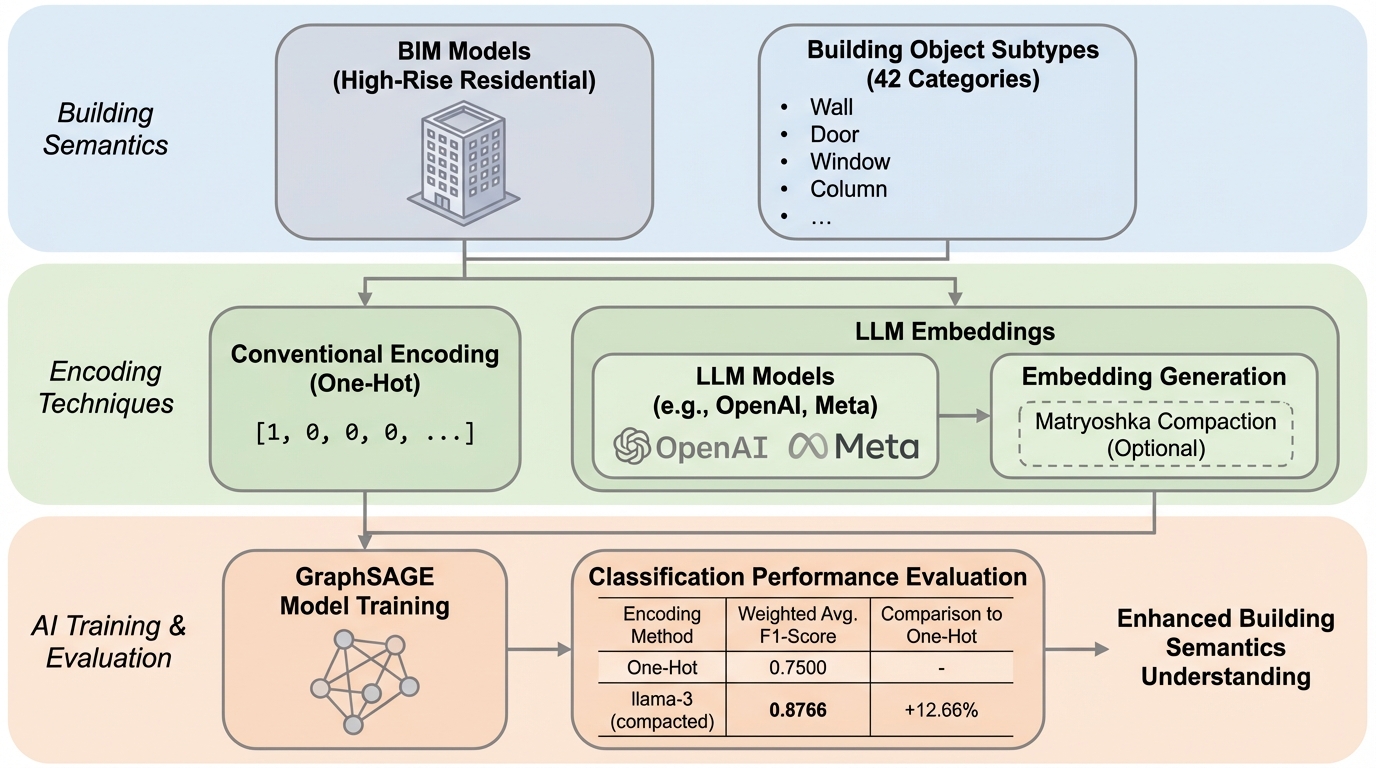

近い概念が多い建物オブジェクトのサブタイプ分類では、ワンホットのように全クラスを等距離として扱う符号化では、微妙な関係性が落ちて意味理解が進みにくいです。 / クラス名をOpenAIやMetaの大規模言語モデル埋め込みに置き換え、GraphSAGEの出力を同じ次元のベクトルとして学習し、コサイン類似度にもとづく損失で「正解ラベルの埋め込み」に近づけます。 / 高層住宅BIM 5件で42サブタイプを評価したところ、LLM埋め込みの符号化がワンホットを上回り、特にllama-3の1,024次元圧縮版で加重平均F1が0.8766(ワンホットは0.8475)でした。

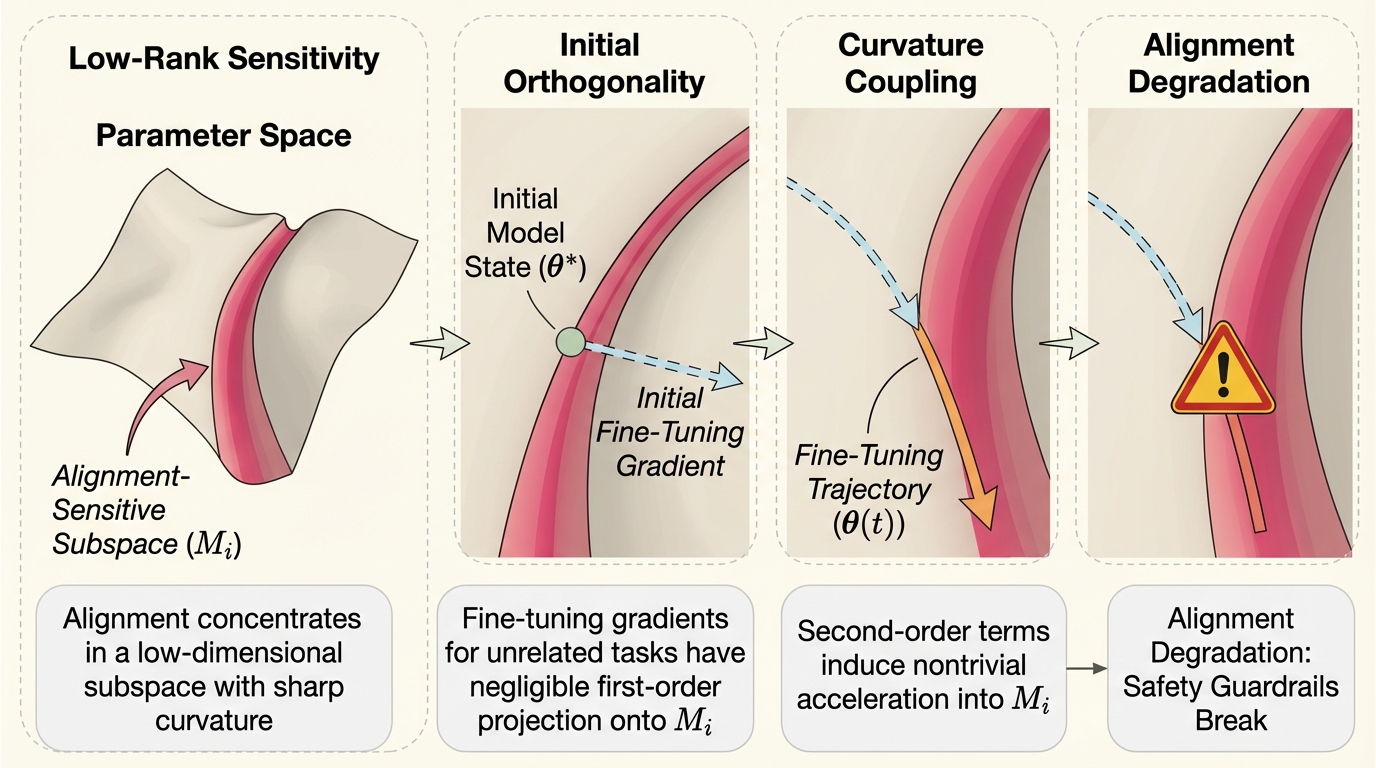

整列済み言語モデルは、有害なデータを含まない良性タスクで微調整しても、開発者に敵対的意図がなくても、安全ガードレールが予測しにくい形で劣化し得ると説明されています。 / 「安全に重要な方向と直交する更新なら安全」という直観は、勾配降下の時間発展の中で直交性が崩れるため当てにならず、損失地形の曲率が軌道を整列に敏感な低次元部分空間へ押し込む仕組みが定式化されています。 / 3つの幾何学的性質からなるAlignment Instability Conditionの下で、整列損失が訓練時間の4乗で増えるスケーリング則が導かれ、一次情報だけに依存する安全な微調整観に構造的な見落としがあると示されています。

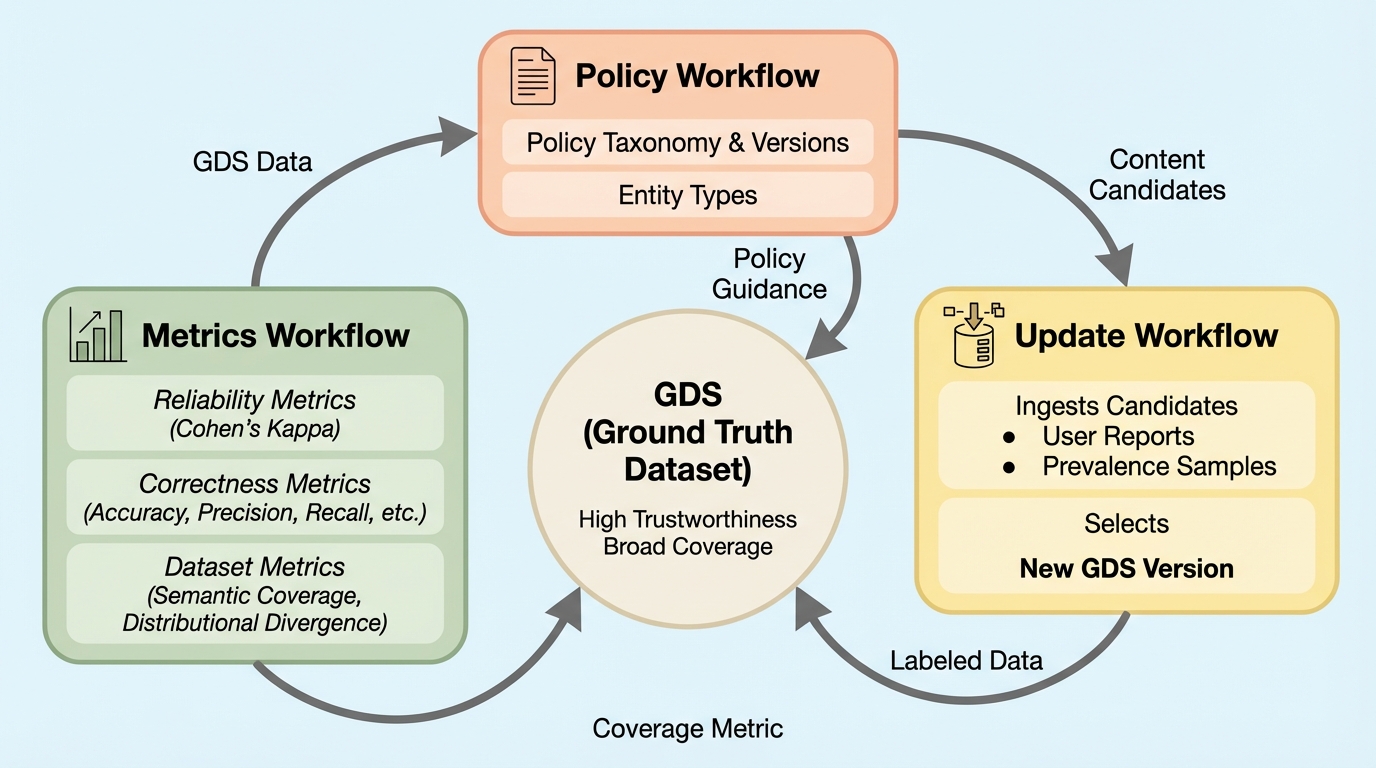

Pinterestは、コンテンツ安全性ポリシーに基づく人手とLLMのモデレーション判断を、主観ではなく再現可能なデータと指標で継続評価する枠組みを提示しています。 / 中心は、SMEがキュレーションして作る高信頼のGolden Set(GDS)を「正解基準」として固定し、propensity scoreを用いた自動サンプリングで限られたSMEコストをカバレッジ拡張に集中させる設計です。 / この基盤により、複数エージェントの比較、プロンプト最適化の反復、ポリシーの版管理、prevalence指標の継続検証を同じ評価サイクルに載せ、判断品質の劣化や分布変化を見える化できます。