アラインメント崩壊の幾何学:微調整が安全性を壊すとき(arXiv:2602.15799v1)

整列済み言語モデルは、有害なデータを含まない良性タスクで微調整しても、開発者に敵対的意図がなくても、安全ガードレールが予測しにくい形で劣化し得ると説明されています。 / 「安全に重要な方向と直交する更新なら安全」という直観は、勾配降下の時間発展の中で直交性が崩れるため当てにならず、損失地形の曲率が軌道を整列に敏感な低次元部分空間へ押し込む仕組みが定式化されています。 / 3つの幾何学的性質からなるAlignment Instability Conditionの下で、整列損失が訓練時間の4乗で増えるスケーリング則が導かれ、一次情報だけに依存する安全な微調整観に構造的な見落としがあると示されています。

TL;DR(結論)

- 整列済み言語モデルは、有害なデータを含まない良性タスクで微調整しても、開発者に敵対的意図がなくても、安全ガードレールが予測しにくい形で劣化し得ると説明されています。

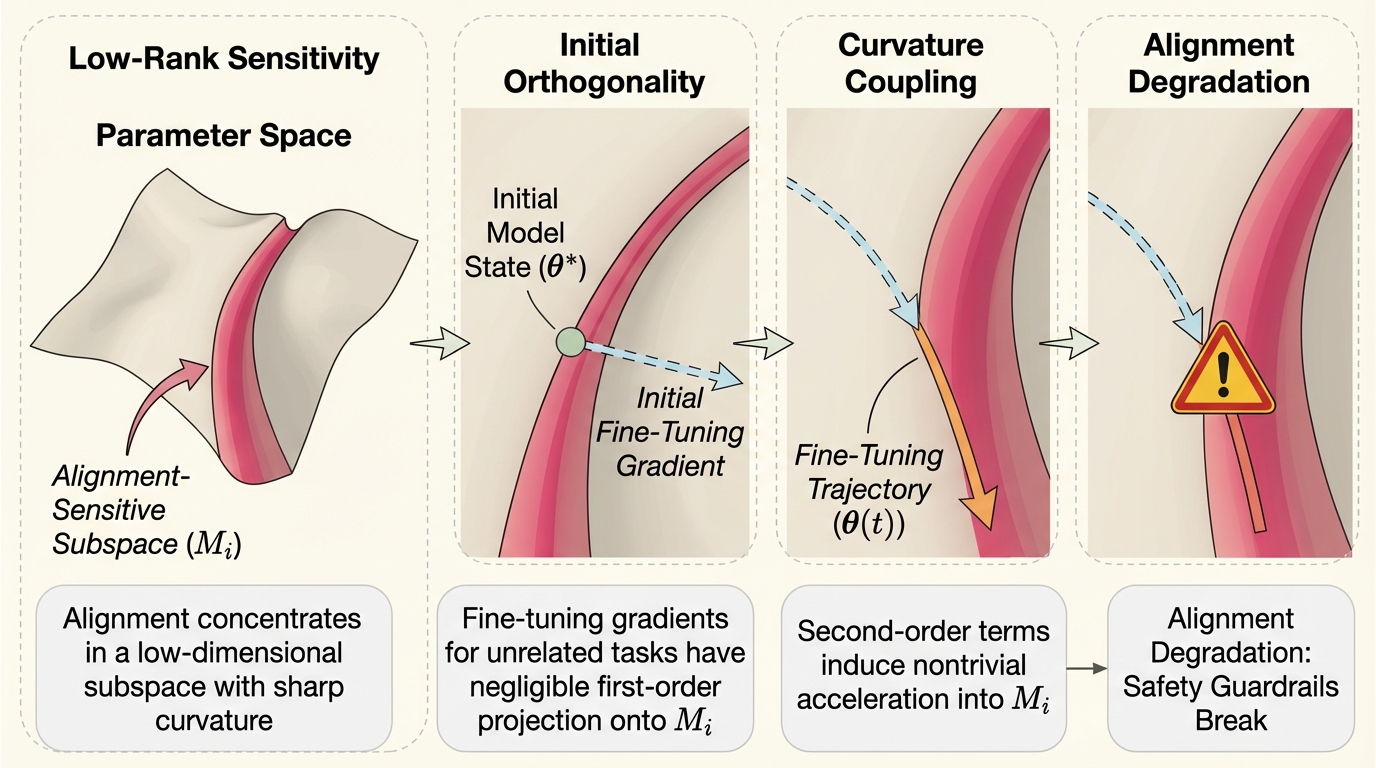

- 「安全に重要な方向と直交する更新なら安全」という直観は、勾配降下の時間発展の中で直交性が崩れるため当てにならず、損失地形の曲率が軌道を整列に敏感な低次元部分空間へ押し込む仕組みが定式化されています。

- 3つの幾何学的性質からなるAlignment Instability Conditionの下で、整列損失が訓練時間の4乗で増えるスケーリング則が導かれ、一次情報だけに依存する安全な微調整観に構造的な見落としがあると示されています。

なぜこの問題か

本論文が扱う問題は、整列(アラインメント)済みの言語モデルを「無害な目的」で微調整しても、安全ガードレールが崩れることがあり、その崩れ方が一見すると予測しにくい点です。本文抜粋では、数学の個別指導のような良性タスクで安全策が壊れる例、創作文章の学習で医療助言の安全策が侵食される例、コード生成への適応で拒否機構が損なわれる例が、文書化され再現可能な現象として挙げられています。ここで重要なのは、データに有害内容が含まれない場合でも、また開発者が攻撃的な意図を持たない場合でも起こり得る点です。したがって「危険なデータを混ぜたから壊れた」という説明だけでは足りず、より一般の機構理解が必要になります。 この問いが緊急だとされる理由として、微調整が配備の主要な手段になっている点が述べられています。専門知識、計算資源、特化データが限られる領域では、オープンウェイトモデルを微調整して実務に合わせることが主要な経路になるという整理です。一方で、オープンウェイトのエコシステム拡大は革新だけでなく脆弱性も生み得ます。…

核心:何を提案したのか

本論文の提案の核は、整列劣化を「高次元だから無関係な更新は直交しやすい」という直観で片付けず、勾配降下が進む過程そのものに内在する幾何学的な不安定性として捉え直す点です。通説として、微調整の更新が安全に重要な方向と直交していれば安全だと考えがちですが、論文はその直交性が構造的に不安定であり、勾配降下の動力学の下で崩れると主張しています。つまり、開始時点で直交して見えることは、時間発展の安全性を保証しないという立場です。 この逆説を解くために、整列がパラメータ空間の低次元部分空間に集中し、その部分空間が鋭い曲率を持つことで「脆い構造」になっているという幾何学的分析が提示されています。初期の更新がその部分空間を避けているように見えても、微調整目的の曲率が二次の加速を生み、軌道を整列に敏感な領域へ体系的に曲げるという説明です。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related