LLMエージェントにおける実行可能な意味的制約の強制のためのオントロジーからツールへのコンパイル

科学技術文献から構造化された知識を抽出する際、従来の手法では抽出後にデータの妥当性を検証する後処理が必要であったが、本研究ではオントロジーの仕様を直接実行可能なツールインターフェースへとコンパイルする新しいメカニズムを導入した。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

科学技術文献から構造化された知識を抽出する際、従来の手法では抽出後にデータの妥当性を検証する後処理が必要であったが、本研究ではオントロジーの仕様を直接実行可能なツールインターフェースへとコンパイルする新しいメカニズムを導入した。

検証可能な報酬を用いた強化学習(RLVR)において、従来の分散に基づくプロンプト選択は最適化が不安定になる課題があったが、本研究は「ポジティブ・ネガティブ・ペアリング」という新しい選択原理を提案した。

ディープリサーチ(DR)エージェントが曖昧な指示で長時間実行されることで生じる計算資源の浪費とユーザーの不満足という「自律性と対話のジレンマ」を解決するため、実行前に潜在的な意図を能動的に確認するフレームワーク「IntentRL」が提案されました。

大規模推論モデル(LRM)の思考過程において、反省ステップの約4割から6割が中間結果の再確認(再チェック)であり、そのうち85%から95%という圧倒的多数が誤りを修正しない冗長なものであることが判明しました。

従来の再パラメータ化方策勾配(RPG)はガウス分布に基づく方策に限定されており、多峰性を持つ複雑な行動分布を表現する能力に欠けていたが、本研究では微分可能な常微分方程式(ODE)の積分を通じて行動を生成するフロー方策がRPGの枠組みと自然に適合することを明らかにした。

本論文は、圧縮機の設計時に想定したデータ分布と実際のソース分布が異なる「分布の不一致」が発生する状況において、送信側のエンコーダを一切変更することなく、受信機側のみの調整で歪みを最小化する「生成デコンプレッション」を提案している。

大規模言語モデル(LLM)の推論能力を向上させるためには、単なる誤答ではなく、論理構成は一貫しているが結論だけが誤っている「もっともらしい負例(PNS)」が極めて重要な学習信号になることを解明した。

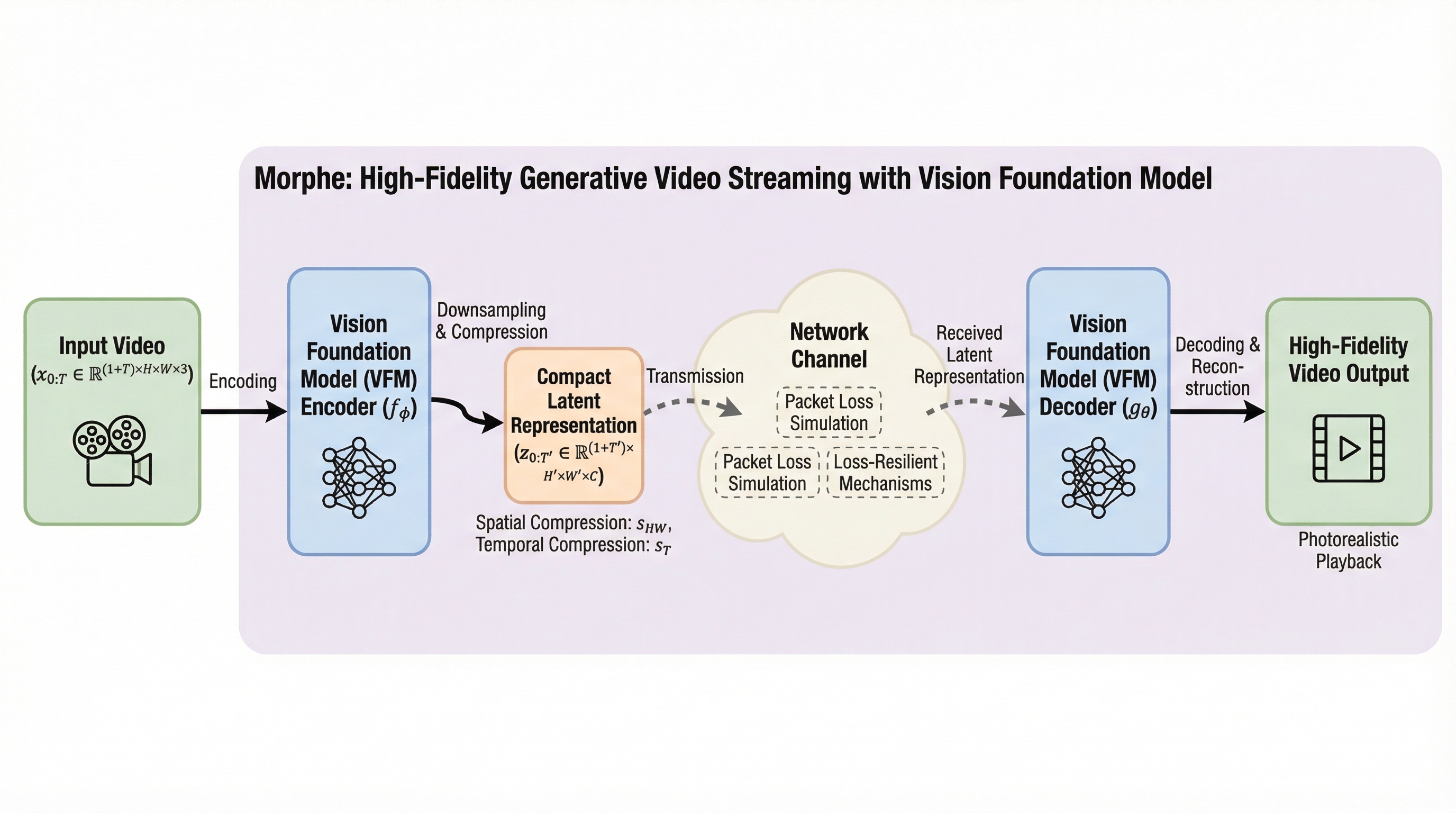

現在のインターネットトラフィックの65%以上を占めるビデオストリーミングは、高速鉄道や遠隔地などの不安定なネットワーク環境において、従来のH.264やH.265といったピクセルベースのコーデックでは帯域不足による品質劣化や再生の中断を避けられないという深刻な課題に直面しています。

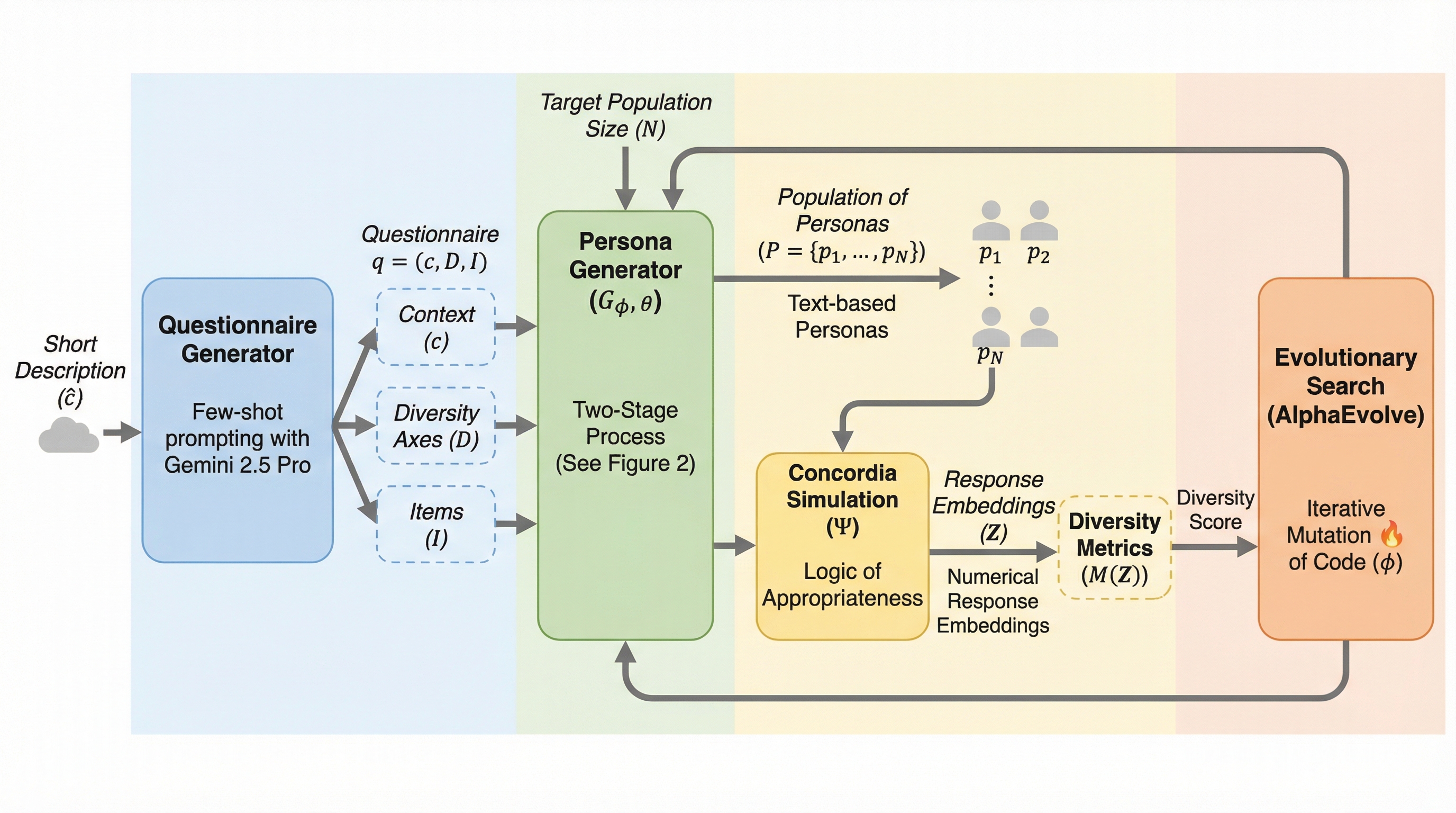

AIシステムの安全性や信頼性を評価するためには多様なユーザー行動の再現が不可欠だが、従来の生成手法は平均的な分布の再現に偏り、稀な特性を持つ「ロングテール」の挙動を見落とす課題があった。 本研究はAlphaEvolveを用いたコード最適化により、任意の文脈で多様な合成ペルソナをオンデマンド生成する「ペルソナ・ジェネレーター」を開発し、可能性の全範囲を網羅する「カバレッジ」の最大化を実現した。 検証の結果、進化したジェネレーターは未知のテストセットで80%以上のカバレッジを達成し、標準的な言語モデルの出力では困難だった極端な意見や複雑な性格の組み合わせを効率的に生成することに成功した。

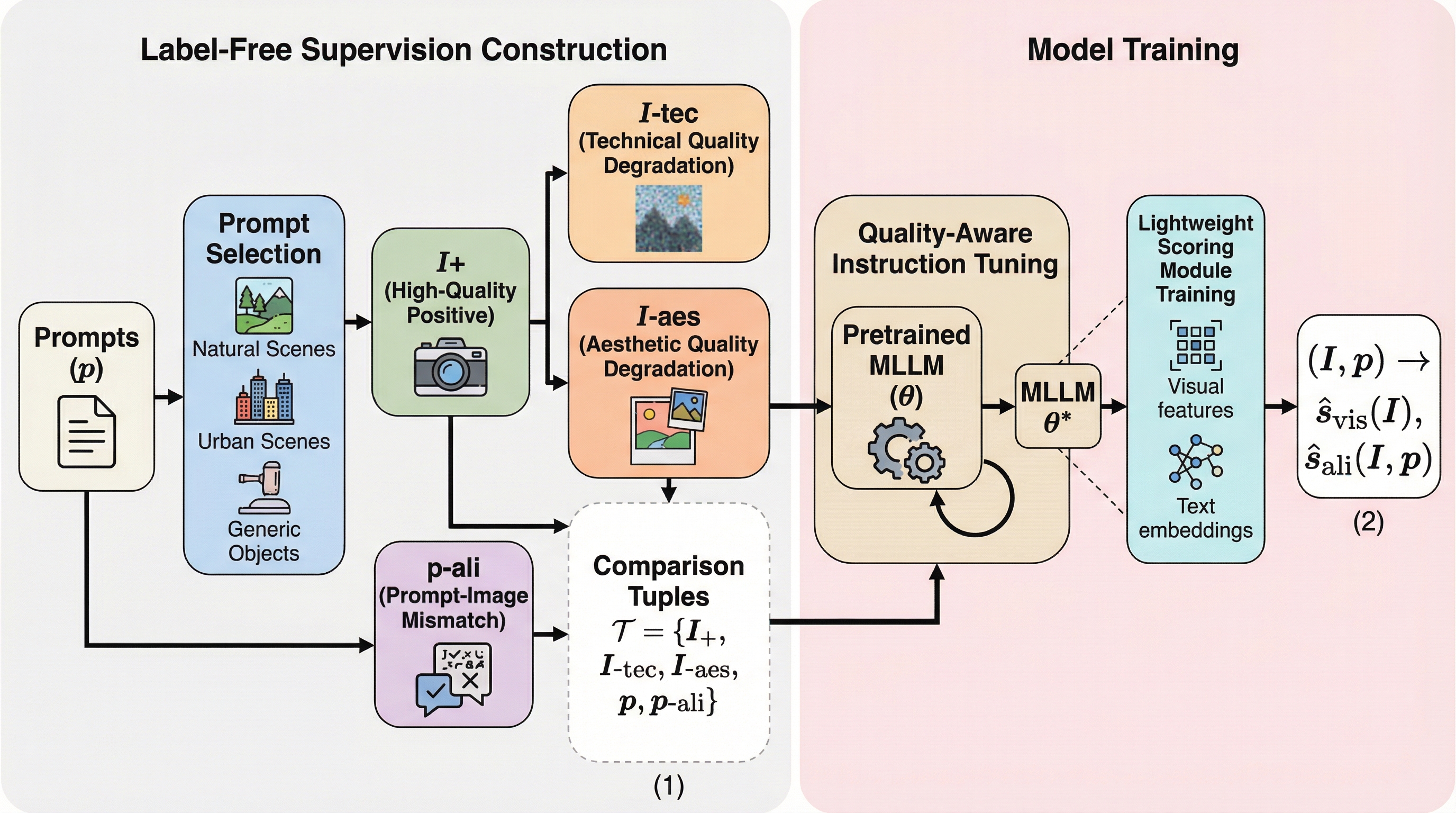

画像生成AIの急速な進化は、従来の人間による評価スコア(MOS)を「知覚的ドリフト」によって急速に陳腐化させ、再評価に膨大なコストを強いるという課題を生んでいる。本研究が提案するELIQは、人間の注釈を一切介さず、最新の生成モデルを用いた高品質な正例と、意図的に劣化させた負例のペアを自動構築することで、視覚的品質とプロンプト整合性の両面からAI生成画像を評価する革新的なラベルフリー・フレームワークである。 命令チューニングを施したマルチモーダル言語モデル(MLLM)を「品質に敏感な批評家」として適応させ、さらに軽量なQuality Query Transformer(QQT)とゲート付き融合メカニズムを組み合わせることで、単一画像からの高精度な品質予測を実現している。 複数のベンチマークにおける検証の結果、ELIQは既存のラベルフリー手法を大幅に凌駕し、教師あり学習モデルに迫る性能を示した。さらに、AI生成画像(AIGC)だけでなくユーザー生成コンテンツ(UGC)にもそのまま適用可能な高い汎用性を持ち、生成モデルの進化に合わせて評価基準を動的に更新できるスケーラブルな評価基盤としての有効性が証明されている。