人工知能時代における持続可能な材料探索

現在のAI駆動型材料探索は性能の最適化を優先し、持続可能性の評価を合成後まで後回しにしているため、環境負荷が判明した時点ではすでに持続不可能な解決策に資源が投じられているという非効率性が生じている。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

現在のAI駆動型材料探索は性能の最適化を優先し、持続可能性の評価を合成後まで後回しにしているため、環境負荷が判明した時点ではすでに持続不可能な解決策に資源が投じられているという非効率性が生じている。

大規模視覚言語モデル(LVLM)の効率化に不可欠な視覚トークン圧縮技術は、敵対的攻撃による歪みを重要なトークンに集中させる「歪み濃縮器」として機能し、既存の評価手法ではモデルの脆弱性を過小評価してしまう問題を明らかにした。

大規模視覚言語モデル(LVLM)の効率化に不可欠な視覚トークン圧縮技術が、敵対的攻撃に対する堅牢性を不当に高く見せかける「最適化と推論の不一致」を引き起こしていることを解明しました。 この問題を解決するため、モデルの圧縮設定が未知の状態でも、生存確率に基づき重要なトークンへ歪みを集中させるEFDと、歪んだトークンを優先的に選択させるRDAを組み合わせた新手法CAGEを提案しました。 検証の結果、圧縮はノイズ除去ではなく「歪みの濃縮器」として機能しており、提案手法は既存の攻撃を大幅に上回る成功率を達成し、効率的なモデルにおける新たなセキュリティ上の脅威を浮き彫りにしました。

ARGORAは、複数のLLM専門家による議論を「定量的双極議論フレームワーク(QBAF)」としてグラフ構造化し、それを「構造的因果モデル(SCM)」として解釈することで、数学的な因果関係に基づいた意思決定を可能にする新しいフレームワークです。

ARGORAは、複数の大規模言語モデルによる議論を「定量的双極議論フレームワーク(QBAF)」という明示的なグラフ構造に整理し、どの主張が最終的な意思決定に寄与したかを特定する新しいフレームワークです。

Flow Matching(FM)モデルの生成速度を劇的に向上させるため、巨大なバックボーンを凍結したまま、わずか1〜2%のサイズである軽量なSideNetを追加して高精度な軌道補間を行う「BA-solver」が提案されました。

Flow Matching(FM)モデルの生成速度を向上させるため、既存の巨大なバックボーンモデルを凍結したまま、その1〜2%程度の極めて軽量な「SideNet」を追加して双方向の時間を知覚させる「BA-solver」が提案されました。

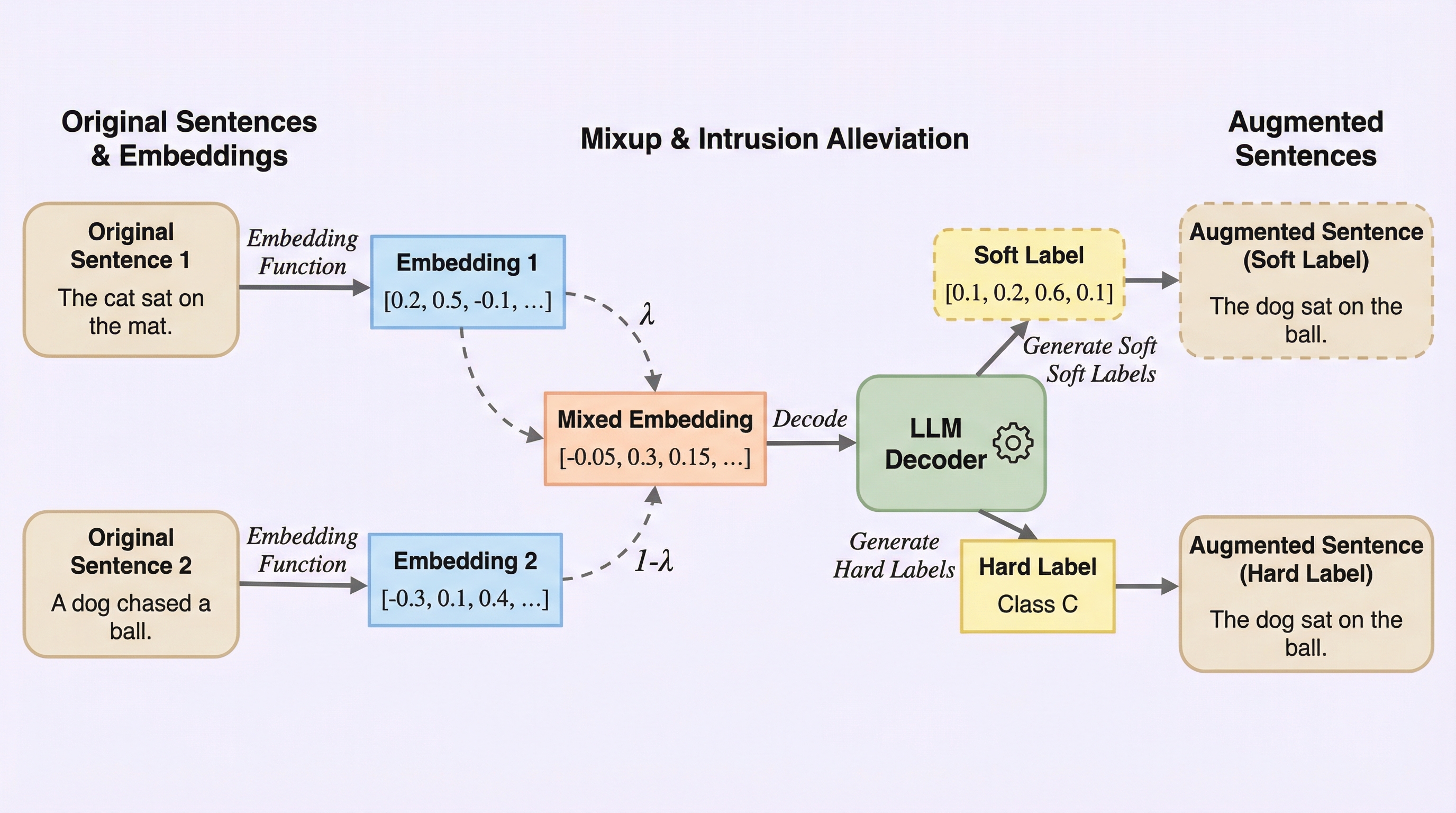

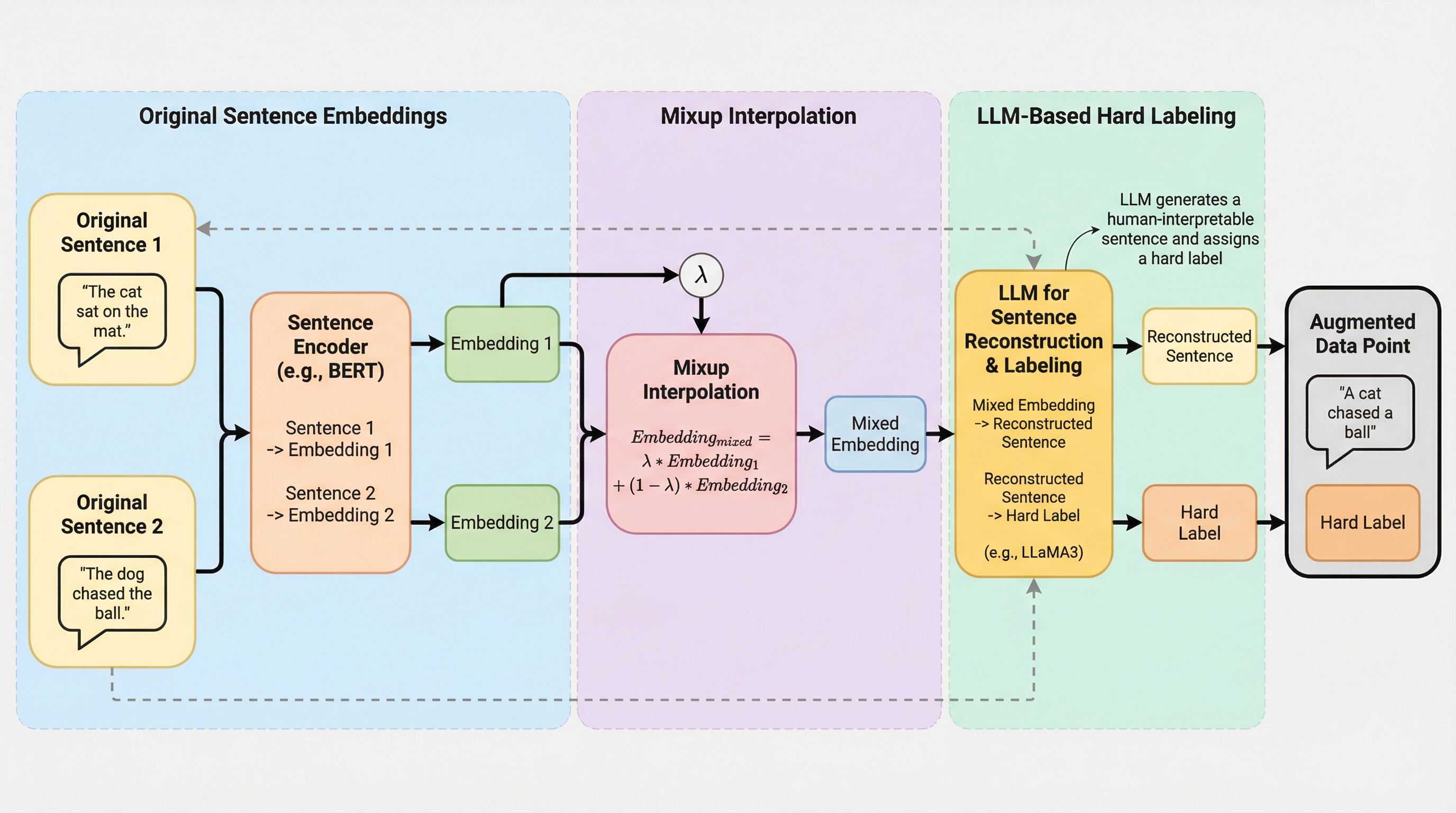

inversedMixupは、Mixupが持つ「制御可能な補間」と大規模言語モデル(LLM)が持つ「解釈可能な文章生成」を統合した、新しいテキストデータ拡張フレームワークである。 3段階の学習プロセスを通じてタスク固有モデルの埋め込み空間とLLMの入力空間を精密に整列させることで、混合された潜在的な数値情報を人間が理解できる高品質な文章へと再構成することを可能にしている。 さらに、テキストのMixupにおいて課題となっていた「マニホールド侵入」という現象を初めて実証的に特定し、LLMを活用してラベルを適切に修正することで、学習の堅牢性とモデルの汎用性を大幅に向上させている。

inversedMixupは、埋め込み空間での線形補間を行うMixupの精密な制御性と、大規模言語モデル(LLM)によるトークンレベル生成の解釈性を統合した、新しいデータ拡張フレームワークである。

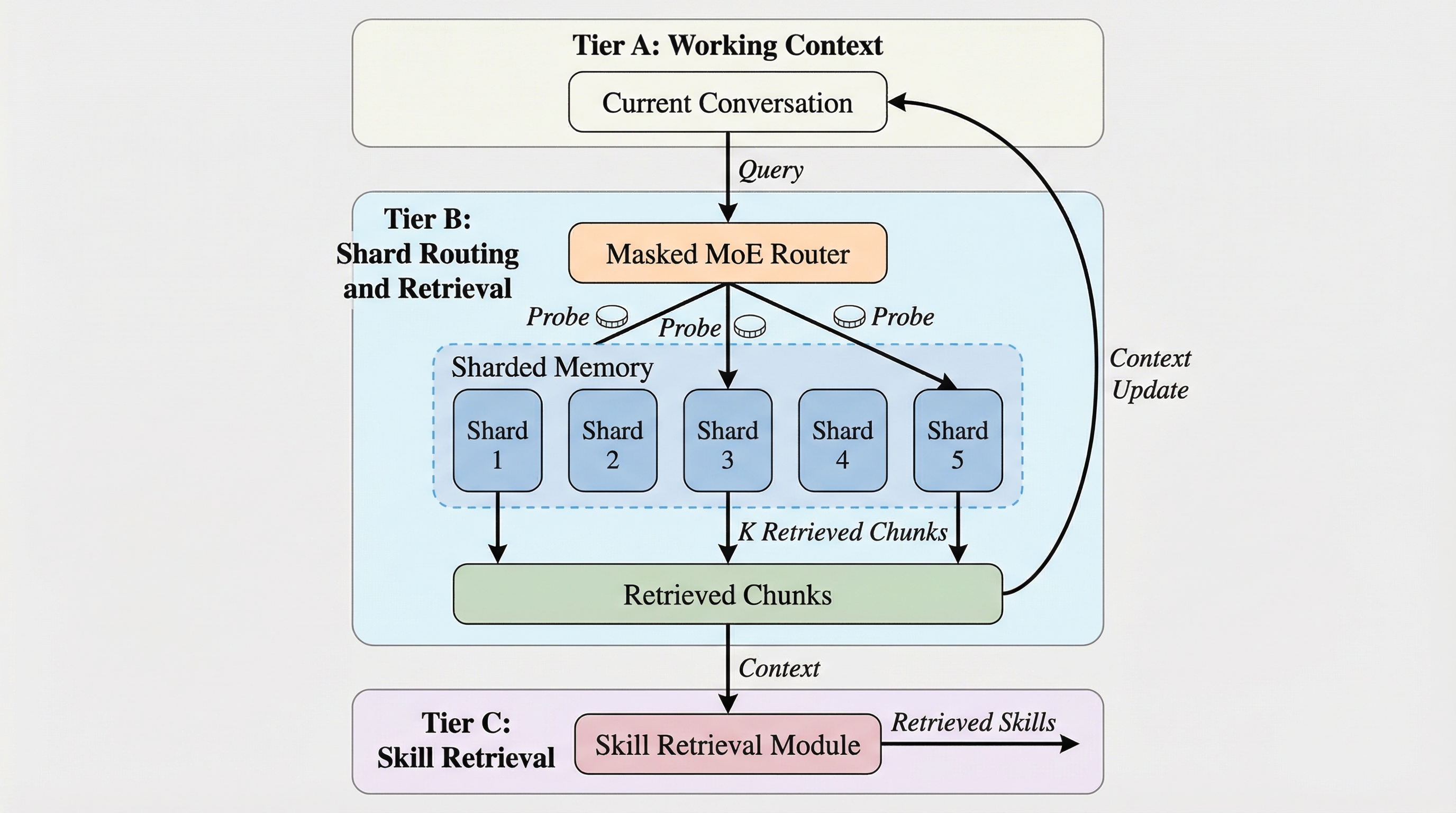

エージェント型LLMシステムにおいて、メモリ量の増大と並列アクセスの増加に伴う中央集権的なインデックスのボトルネックを解消するため、3層構造の予算制約付きメモリサービスであるShardMemoが提案されました。