ARGORA:因果的に根拠付けられたLLMの推論と意思決定のための編成された議論

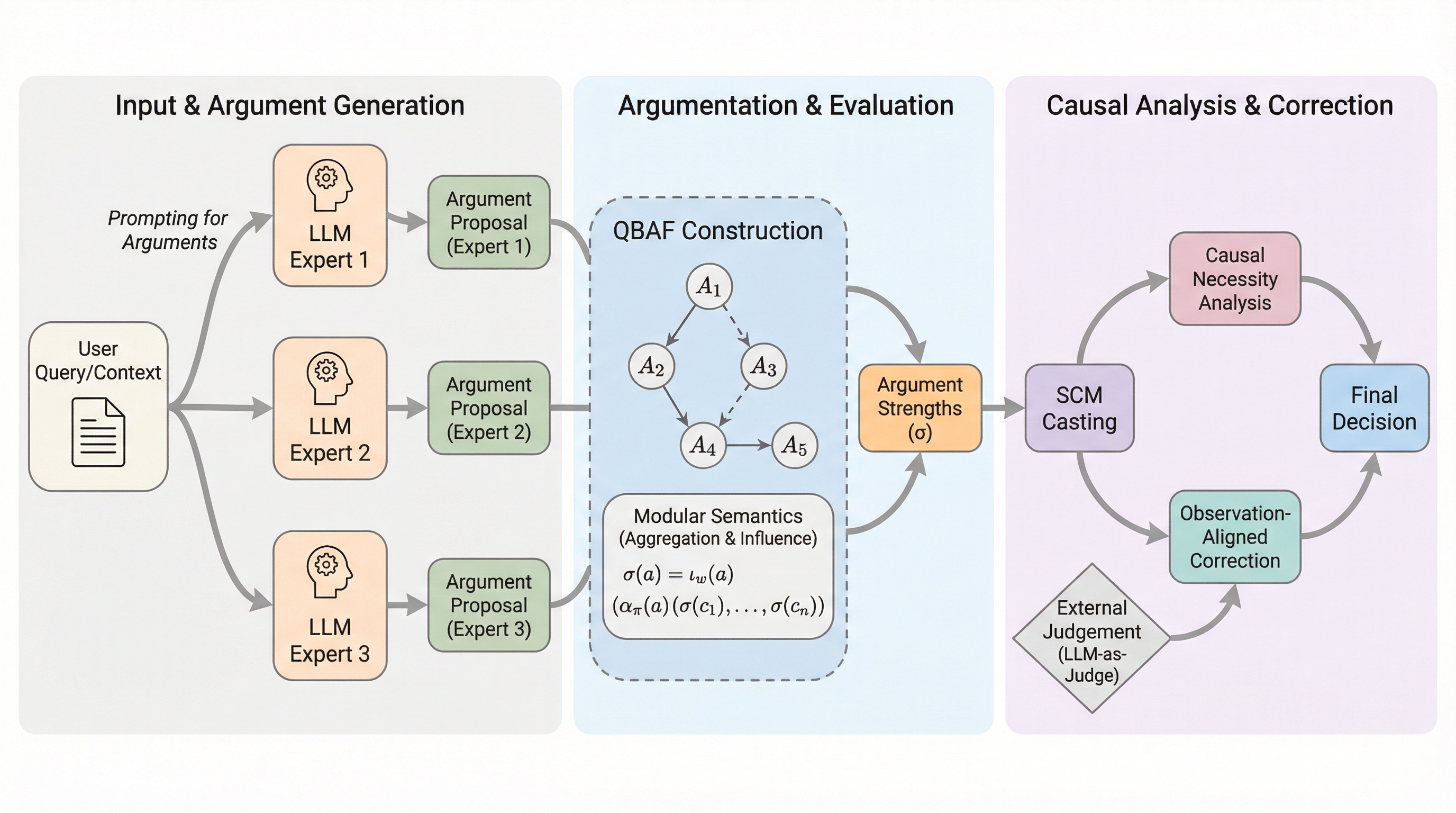

ARGORAは、複数のLLM専門家による議論を「定量的双極議論フレームワーク(QBAF)」としてグラフ構造化し、それを「構造的因果モデル(SCM)」として解釈することで、数学的な因果関係に基づいた意思決定を可能にする新しいフレームワークです。

TL;DR(結論)

ARGORAは、複数のLLM専門家による議論を「定量的双極議論フレームワーク(QBAF)」としてグラフ構造化し、それを「構造的因果モデル(SCM)」として解釈することで、数学的な因果関係に基づいた意思決定を可能にする新しいフレームワークです。 特定の議論を仮想的に削除して結果の変化を測定する「反事実的介入」により、どの推論チェーンが最終決定に不可欠であったかを定量的に特定し、ブラックボックス化しがちなマルチエージェントの合意形成プロセスに高い透明性と診断機能を提供します。 内部の議論による結論と外部の判断が食い違う場合には、最小限の構造変更で整合性を図る修正メカニズムを備えており、多様なベンチマークにおいて、誤った初期意見を正しい結論へと導く高い修正能力と競争力のある精度を実証しました。

なぜこの問題か

現在の大規模言語モデル(LLM)は、Chain-of-Thought(CoT)などの手法を用いることで、複雑な多段階の推論において高い能力を発揮するようになりました。しかし、強力なモデルであっても、自信満々に誤った推論を行ったり、事実に基づかない発言(ハルシネーション)を生成したりするリスクが依然として存在します。特に、医療や法務、ビジネスの戦略決定といった高い信頼性が求められる場面では、単に「もっともらしい」回答を得るだけでは不十分です。意思決定プロセスのどの部分が最終的な結論に寄与したのかを明確に特定できる、堅牢な意思決定手順と診断メカニズムが必要とされています。 この課題に対し、複数のLLMインスタンスやエージェントを戦わせる「マルチLLM討論」というアプローチが注目されています。複数の専門家が多様な視点を提示し、互いに批判し合い、結論を集計することで、単一モデルよりも信頼性を高める試みです。しかし、既存のプロトコルの多くは、自然言語による一時的なやり取りを記録するにとどまり、最終的な決定は「裁判官」役のモデルや単純な多数決などの単純な集計ルールに委ねられています。…

核心:何を提案したのか

ARGORAは、LLM専門家による議論を「オーケストレーションされた議論」として構造化し、因果的な根拠に基づいた意思決定を行うための包括的なフレームワークです。この提案の核心は、複数の専門家間のやり取りを「定量的双極議論フレームワーク(QBAF)」と呼ばれる形式的なグラフ構造に変換し、それをさらに決定論的な「構造的因果モデル(SCM)」として解釈する点にあります。このアプローチにより、議論のプロセスが単なるテキストの羅列ではなく、数学的に扱える因果関係のネットワークとして定義されます。 このフレームワークでは、各専門家が提示する主張がグラフのノードとなり、それらの間の「支持」や「攻撃」の関係がエッジとして明示されます。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related