ARGORA:因果的に根拠付けられたLLMの推論と意思決定のためのオーケストレーションされた議論

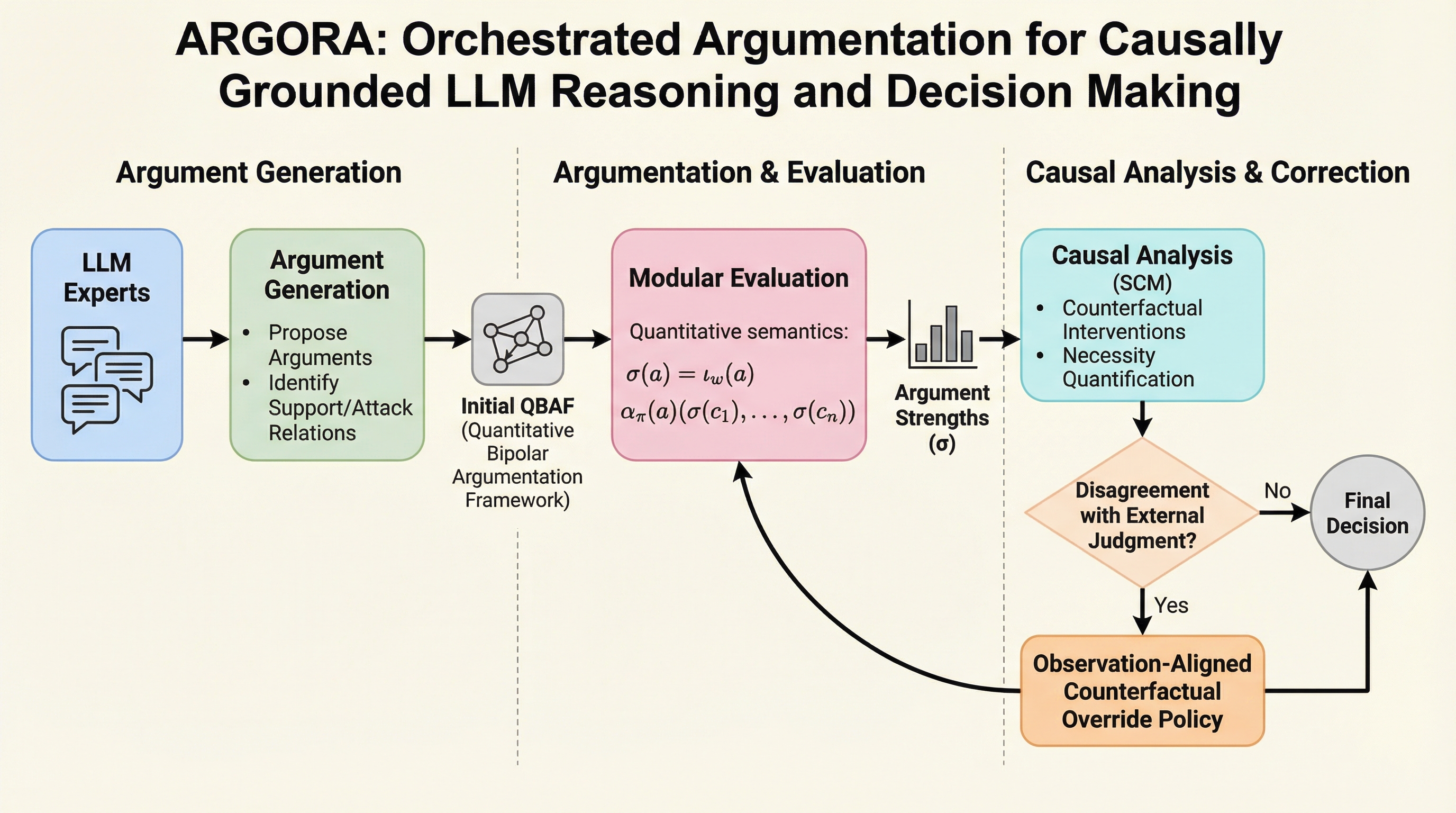

ARGORAは、複数の大規模言語モデルによる議論を「定量的双極議論フレームワーク(QBAF)」という明示的なグラフ構造に整理し、どの主張が最終的な意思決定に寄与したかを特定する新しいフレームワークです。

TL;DR(結論)

ARGORAは、複数の大規模言語モデルによる議論を「定量的双極議論フレームワーク(QBAF)」という明示的なグラフ構造に整理し、どの主張が最終的な意思決定に寄与したかを特定する新しいフレームワークです。議論の構造を「構造的因果モデル(SCM)」として解釈することで、特定の推論ステップを仮想的に取り除いた際の結果の変化を計算し、結論を導くために不可欠な推論チェーンを特定する因果診断を可能にします。内部の議論による結論と外部の判定が一致しない場合に、最小限の構造的変更で論理を調整する補正メカニズムを備えており、多様なベンチマークにおいて高い精度と誤り訂正能力を発揮しながら、AIの判断プロセスを透明化します。

なぜこの問題か

現在の大規模言語モデルを用いたマルチエージェントシステムは、多様な視点を集めることには長けていますが、最終的な決定に至るプロセスが単純な集計や多数決に依存しているという大きな課題があります。このような方式では、具体的にどの議論が最終的な判断を決定づけたのかが不透明になり、複雑な推論の過程を詳細に把握することが困難です。特に高い信頼性が求められる場面では、単に妥当な回答を出すだけでなく、意思決定の根拠となる特定の推論ステップを正確に特定できる堅牢な手順が必要とされています。従来のプロトコルは、自然言語による一時的なやり取りに終始することが多く、議論の論理的構造や依存関係を形式的に解釈可能な形で維持することができていません。 また、既存の議論フレームワークの多くは、あらかじめ決められた特定の主張を検証することに特化しており、複数の候補の中から最適な説明を選択し、その決定要因を診断する機能が不足しています。モデルが自信満々に誤った推論を行う「ハルシネーション」の問題は、こうした透明性の欠如によってさらに深刻化しており、誤った推論ステップを外部から検証し、修正するための構造的な枠組みが欠如しています。…

核心:何を提案したのか

本研究では、大規模言語モデルのエキスパートによる意思決定のためのオーケストレーションされた議論フレームワークである「ARGORA」を提案しています。このフレームワークの核心は、複数のエキスパート間のやり取りを「定量的双極議論フレームワーク(QBAF)」と呼ばれる形式に構造化し、主張間の支持や攻撃の関係をグラフとして明示的に可視化することにあります。最大の特徴は、この構築された議論グラフを決定論的な「構造的因果モデル(SCM)」として解釈し、反事実的な介入を通じて各推論チェーンの因果的な必要性を定量化できる点にあります。これにより、特定の議論を削除した場合に結論がどう変わるかをシミュレーションし、決定に最も影響を与えた要素を特定することが可能になります。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related