DUET:効率的に文脈化された教師からの蒸留されたLLMアンラーニング

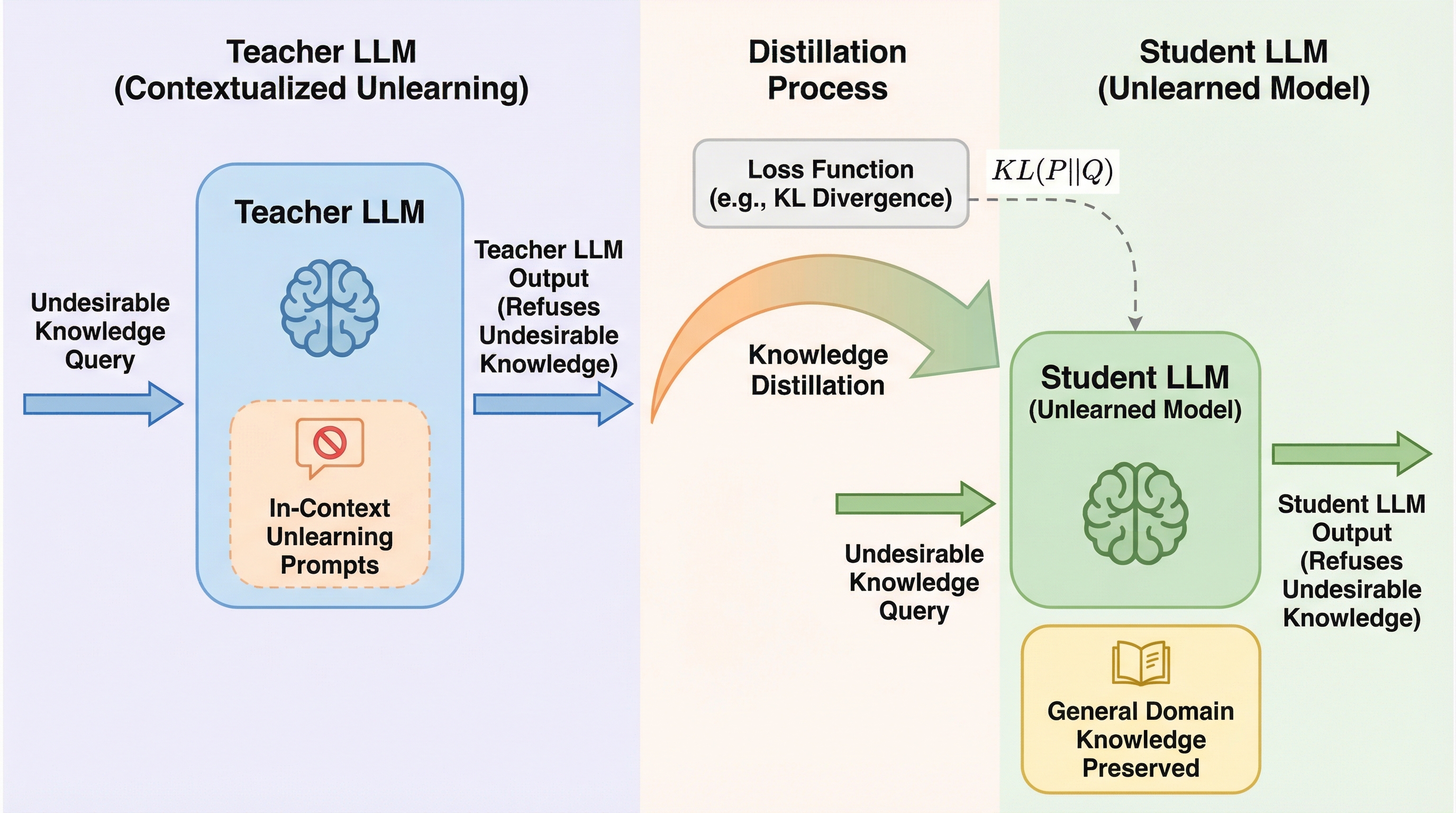

LLMから不適切な知識を削除するアンラーニングにおいて、従来の学習ベースの手法は計算負荷が高く汎用知識を失いやすい一方で、プロンプトによる手法は攻撃に弱いという課題がありました。本研究が提案するDUETは、プロンプトで制御された教師モデルの振る舞いを生徒モデルに蒸留することで、計算効率を維持しながら特定の知識を正確に削除し、かつモデルのパラメータに直接書き込むことで堅牢性を高めています。既存のベンチマークを用いた検証の結果、DUETは従来手法よりも大幅に少ないデータ量で高い忘却性能と知識保持能力を両立し、リバースエンジニアリング攻撃に対しても強い耐性を持つことが実証されました。