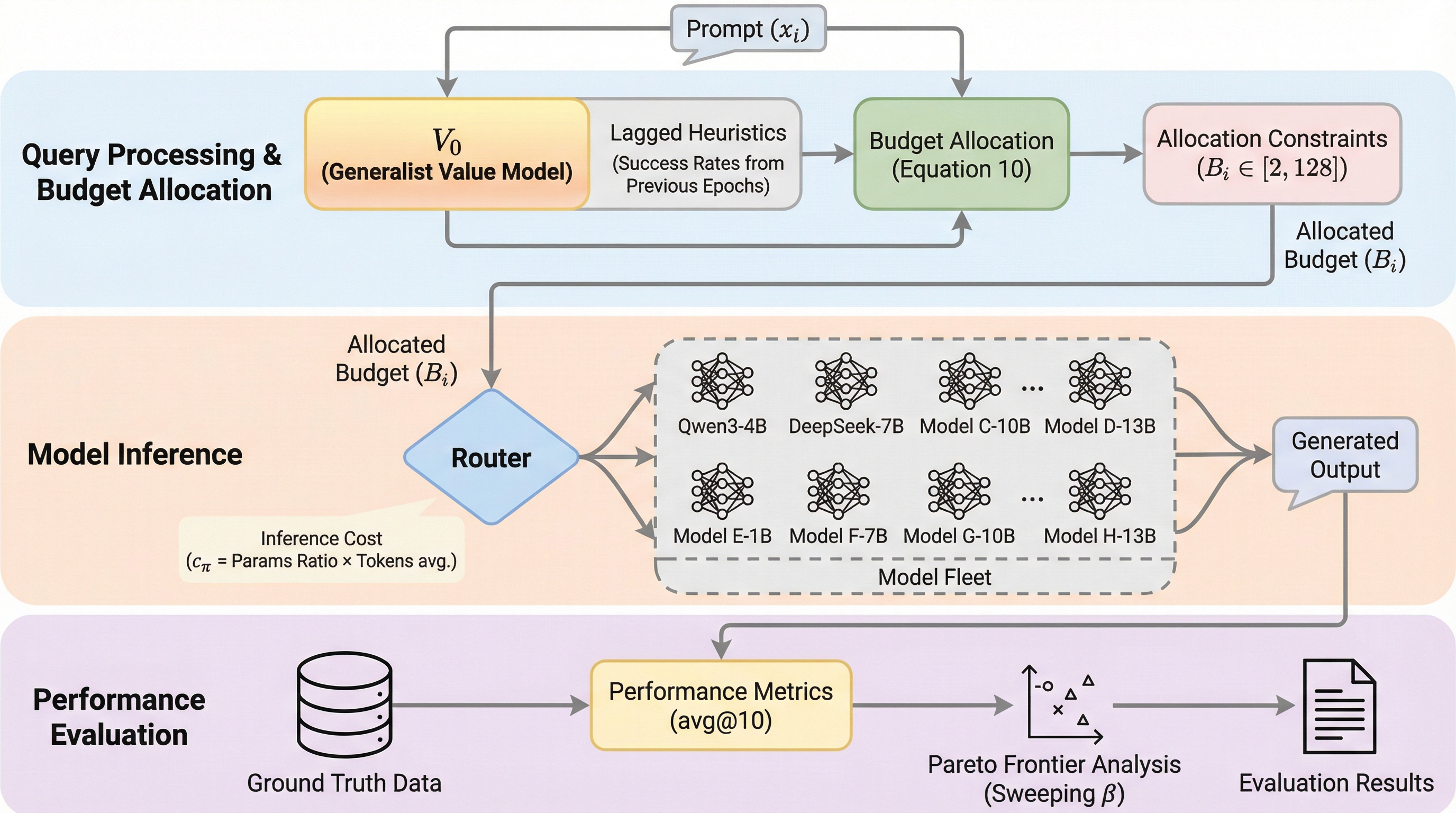

$V_0$: 状態ゼロにおけるあらゆる方策のための汎用価値モデル

大規模言語モデルの強化学習において、従来のアクター・クリティック法が抱えていた「方策の進化に伴う価値モデルの頻繁な再学習コスト」と、GRPO等の手法における「サンプリングの不安定性」という二律背反の課題を解決するため、方策の能力をパラメータではなく「過去の行動履歴」という文脈情報として読み取る汎用価値モデル「V0」を提案しました。 V0は、意味理解を担う埋め込みバックボーンと統計的推論に特化したTabPFNを組み合わせたハイブリッド構造を採用しており、特定のプロンプトに対する各モデルの成功確率を、追加の勾配更新なしに単一のフォワードパスで予測することが可能です。 実験の結果、V0は学習過程における方策の性能変化を極めて正確に追跡できるだけでなく、未知のモデルやタスクに対しても高い汎化性能を示し、学習時の計算資源配分の最適化や推論時のコスト効率的なルーティングにおいてパレート最適な制御を実現することを実証しました。