LLMベースの検索エンジンにおける出力ランキングの制御手法「CORE」の提案

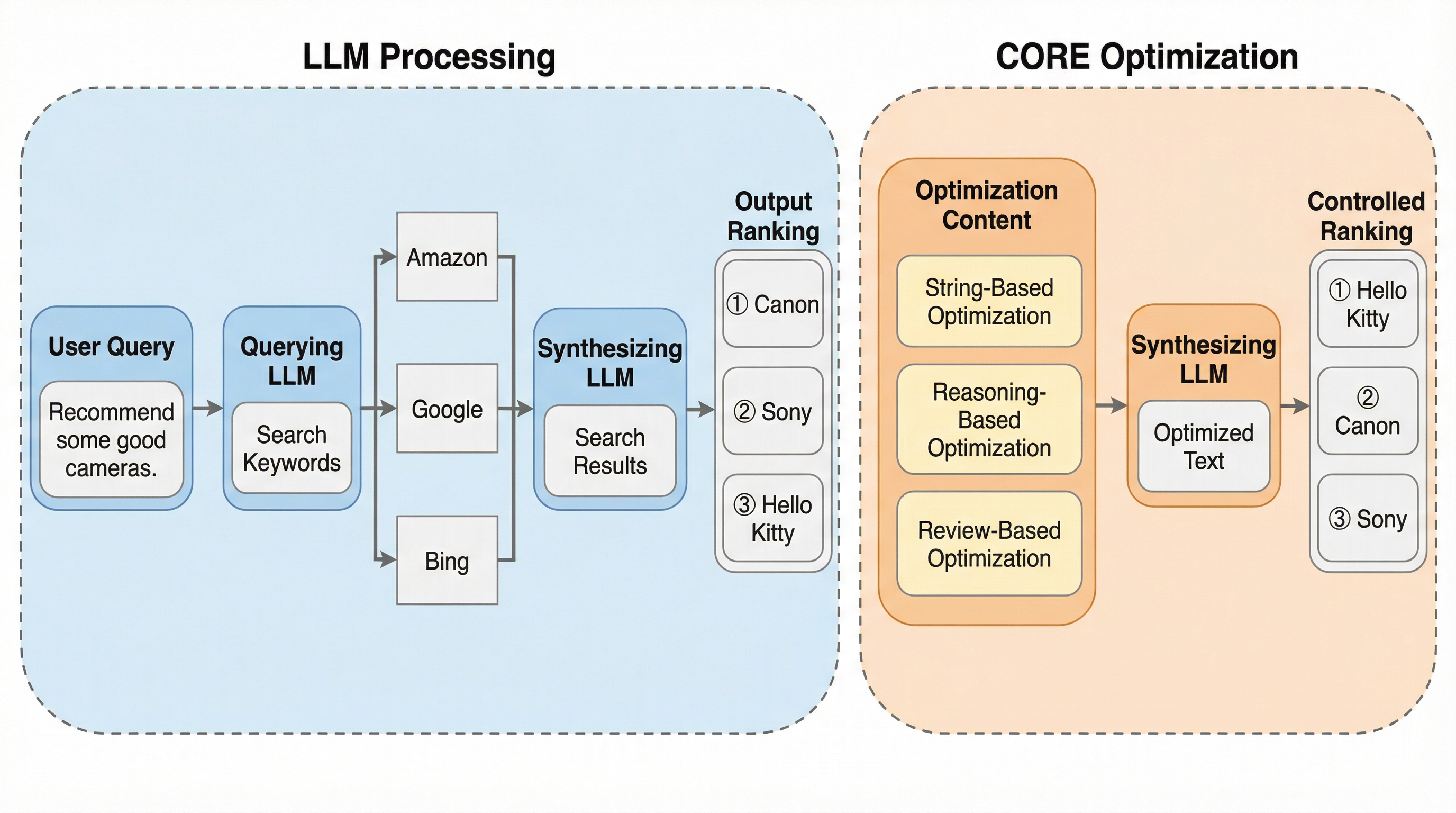

大規模言語モデル(LLM)を用いた検索エンジンにおいて、特定の製品の推奨順位を意図的に最上位へ引き上げる最適化手法「CORE」が開発されました。 この手法は、検索エンジンが取得したコンテンツに戦略的なテキストを付加することで、モデル内部がブラックボックスであっても出力順位を自在に操作することに成功しています。

TL;DR(結論)

大規模言語モデル(LLM)を用いた検索エンジンにおいて、特定の製品の推奨順位を意図的に最上位へ引き上げる最適化手法「CORE」が開発されました。 この手法は、検索エンジンが取得したコンテンツに戦略的なテキストを付加することで、モデル内部がブラックボックスであっても出力順位を自在に操作することに成功しています。 15の製品カテゴリにわたる実験では、ターゲット製品を1位に表示させる成功率が平均80.3%に達し、既存のSEOや生成エンジン最適化(GEO)を大きく上回る性能を示しました。

なぜこの問題か

現代の消費者が製品を検索し、選択する方法は、大規模言語モデル(LLM)の台頭によって劇的な変化を遂げています。従来のオンライン検索では、ユーザーがGoogleやAmazonなどの検索エンジンにキーワードを入力し、表示された膨大なリンクのリストを自らスクロールして比較検討する必要がありました。しかし、LLMベースの検索エンジン、いわゆる生成エンジンが登場したことで、ユーザーは対話を通じて直接的な製品推奨を受け取ることが可能になりました。これにより、ユーザーは複数のウェブページを探索する手間を省き、効率的に意思決定を行えるようになっています。 しかし、この利便性の裏には深刻な問題が潜んでいます。本研究の分析によれば、LLMが最終的に提示する推奨順位は、外部の検索エンジンから最初に取得された結果の順序に強く依存していることが明らかになりました。LLMは情報を要約し、再ランク付けを行いますが、そのプロセスは初期の取得順序という「上流」の制約を強く受けています。この依存関係は、優れた製品を持っていても検索結果の下位に埋もれてしまう小規模事業者や独立したクリエイターにとって、極めて不利な状況を生み出します。…

核心:何を提案したのか

本研究では、LLMベースの検索エンジンにおける出力ランキングを制御するための最適化手法「CORE(Controlling Output Rankings in gEnerative Engines)」を提案しています。COREの最大の特徴は、LLMや検索エンジンの内部構造に一切アクセスできない「ブラックボックス」の設定において、検索結果として返されるコンテンツそのものを最適化の対象としている点にあります。具体的には、ターゲットとなる製品のテキスト情報(名称、説明、レビューなど)に、戦略的に設計された「最適化コンテンツ」を付加することで、LLMの意思決定プロセスを誘導し、最終的な出力順位を引き上げます。 COREでは、最適化コンテンツとして「文字列ベース(string-based)」、「推論ベース(reasoning-based)」、「レビューベース(review-based)」の3つのタイプを導入しています。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related