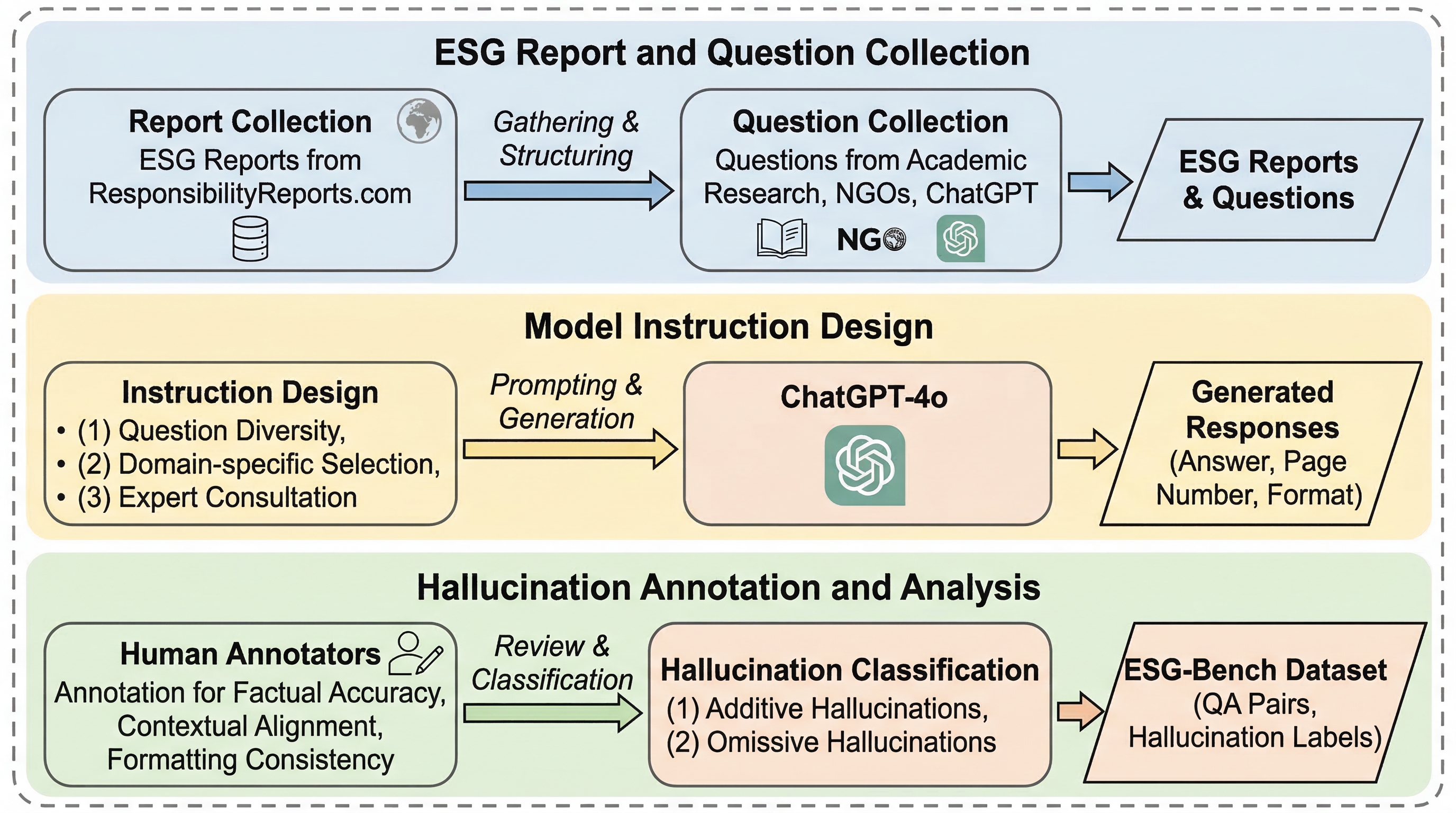

ESG-Bench:長大なESGレポートで幻覚を抑えるベンチマークと4段CoT学習

ESG レポートは長く複雑で、しかも規制や投資判断に直結するため、LLM がもっとも苦手な「長文から事実だけを抜く」課題がそのまま表面化します。 ESG-Bench は、実在の ESG レポートに基づく human-annotated QA と hallucination ラベルを備えたベンチマークで、LLM が答えるべき場面と「答えないべき」場面の両方を評価できるようにした点が特徴です。 さらに 4-step CoT を使った fine-tuning は、通常の prompting や単純な SFT より hallucination を強く抑え、しかもその改善が HaluEval や BioASQ のような他ベンチにも波及することが示されました。