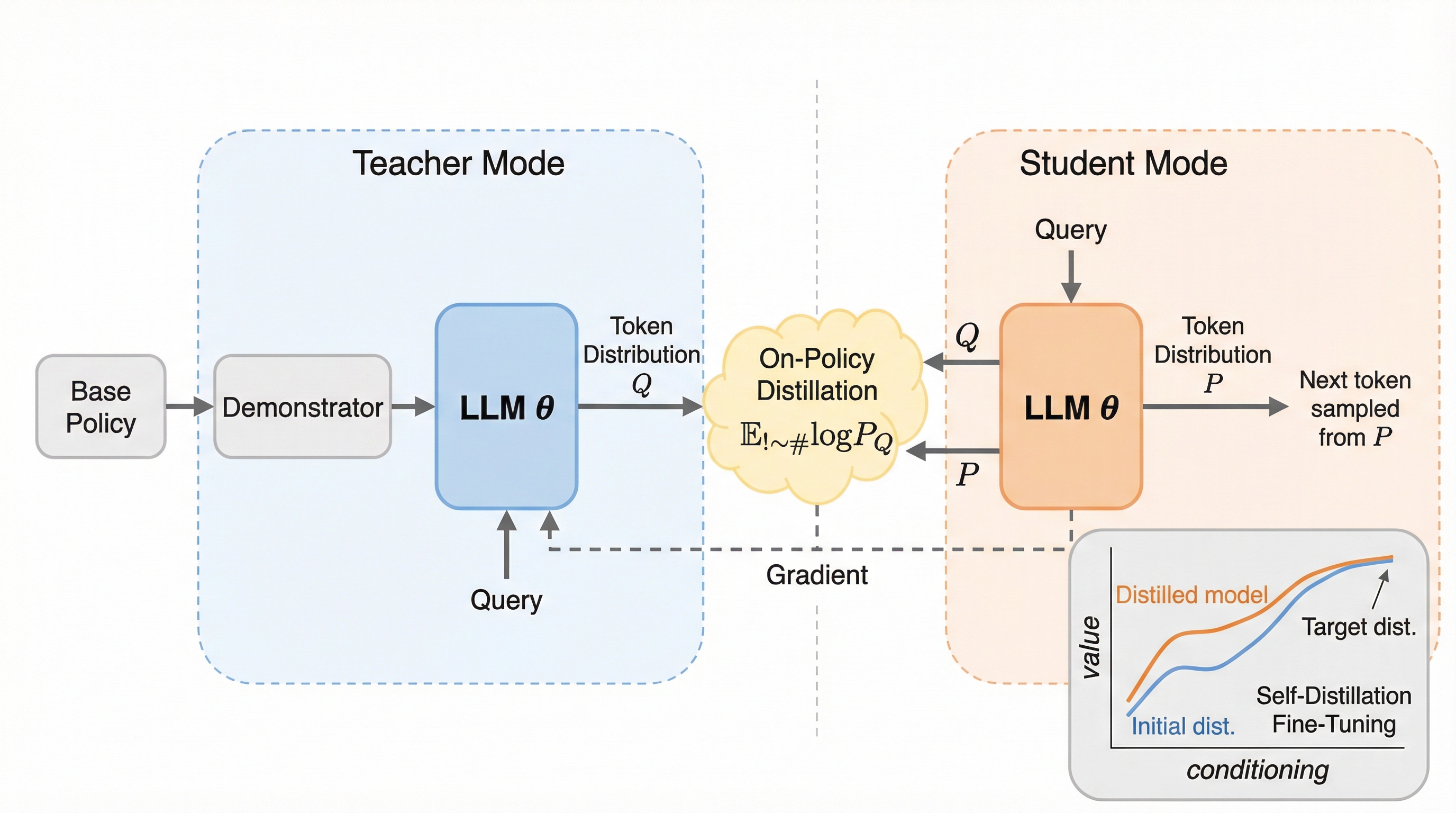

自己蒸留が継続学習を可能にする:SDFTの提案

基盤モデルが既存の能力を損なわずに新しい知識やスキルを習得し続ける「継続学習」において、従来の教師あり微調整(SFT)は過去の知識を失う「破滅的忘却」を引き起こすという深刻な課題があった。 本研究が提案する自己蒸留微調整(SDFT)は、モデル自身のインコンテキスト学習能力を活用してデモンストレーションから「オンポリシー」な学習信号を生成し、明示的な報酬関数がない環境でも過去の能力を維持しながら新スキルを習得させる手法である。 検証の結果、SDFTはスキル習得と知識獲得の両面で従来のSFTを凌駕し、複数のスキルを順番に学習させる実験においても性能を低下させることなく蓄積することに成功し、デモンストレーションからの継続学習における実用的な道筋を明確に示した。