Agent Skill Frameworkは小規模言語モデルに効くのか:産業環境での可能性と制約

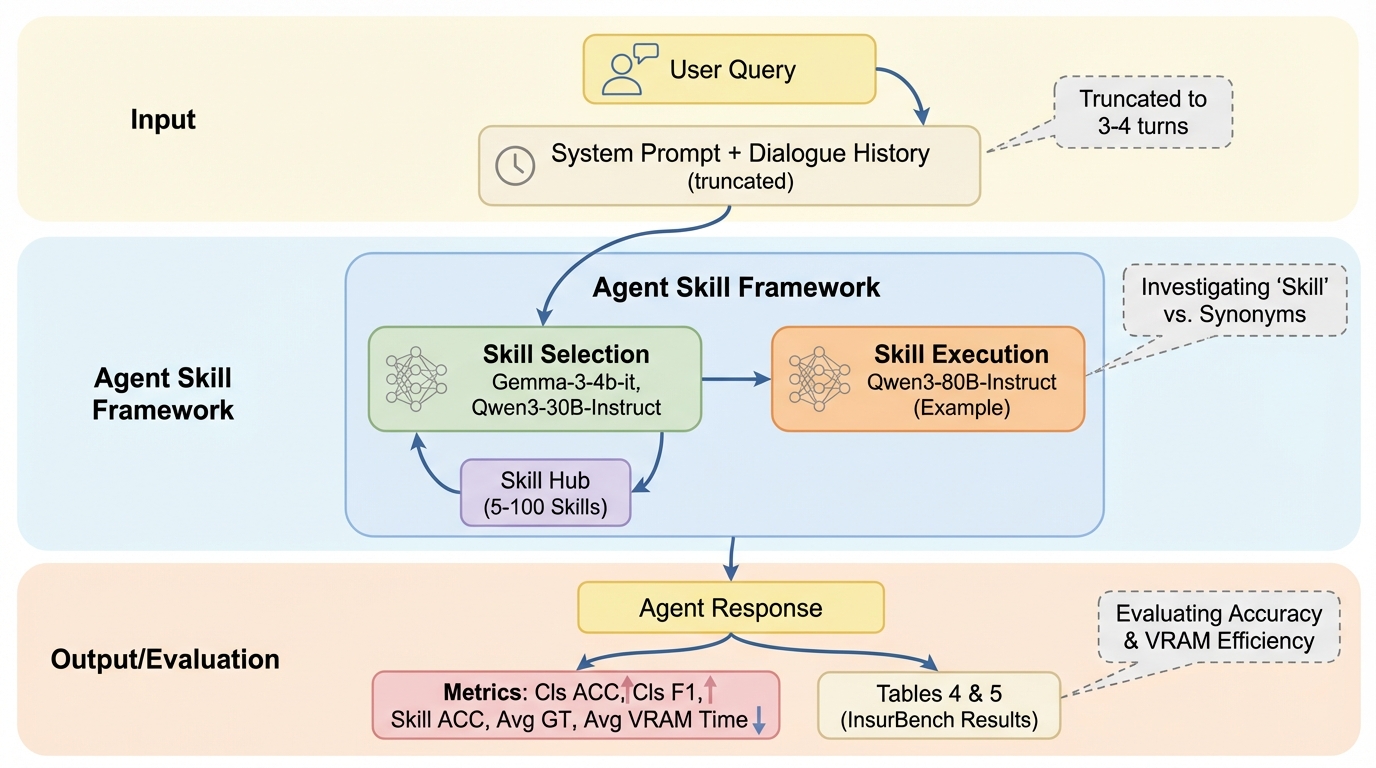

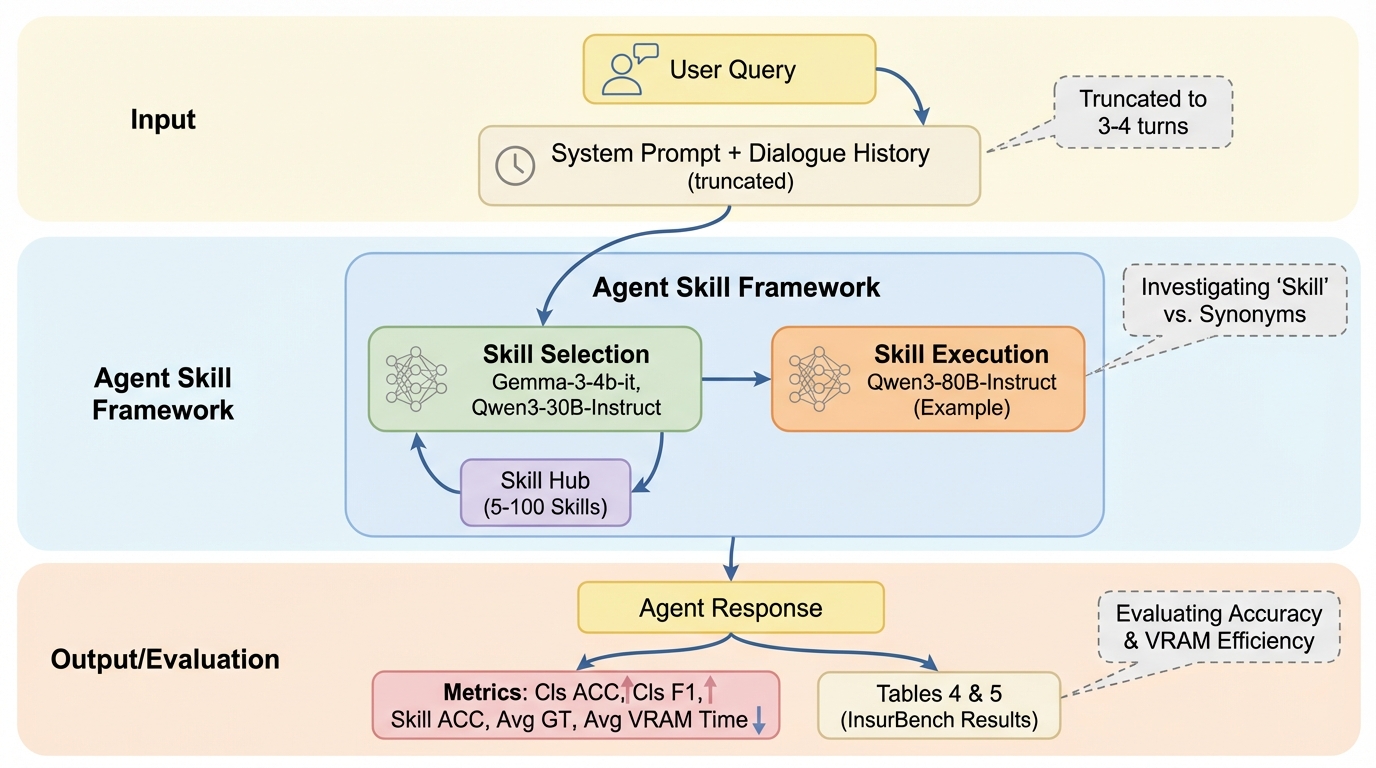

Agent Skillフレームワークは、コンテキスト設計を工夫して幻覚を抑えつつ精度を上げる狙いがありますが、その恩恵は小規模言語モデルなら一律に得られるわけではなく、特に極小モデルではスキル選択そのものが不安定になりやすいと示されています。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

Agent Skillフレームワークは、コンテキスト設計を工夫して幻覚を抑えつつ精度を上げる狙いがありますが、その恩恵は小規模言語モデルなら一律に得られるわけではなく、特に極小モデルではスキル選択そのものが不安定になりやすいと示されています。

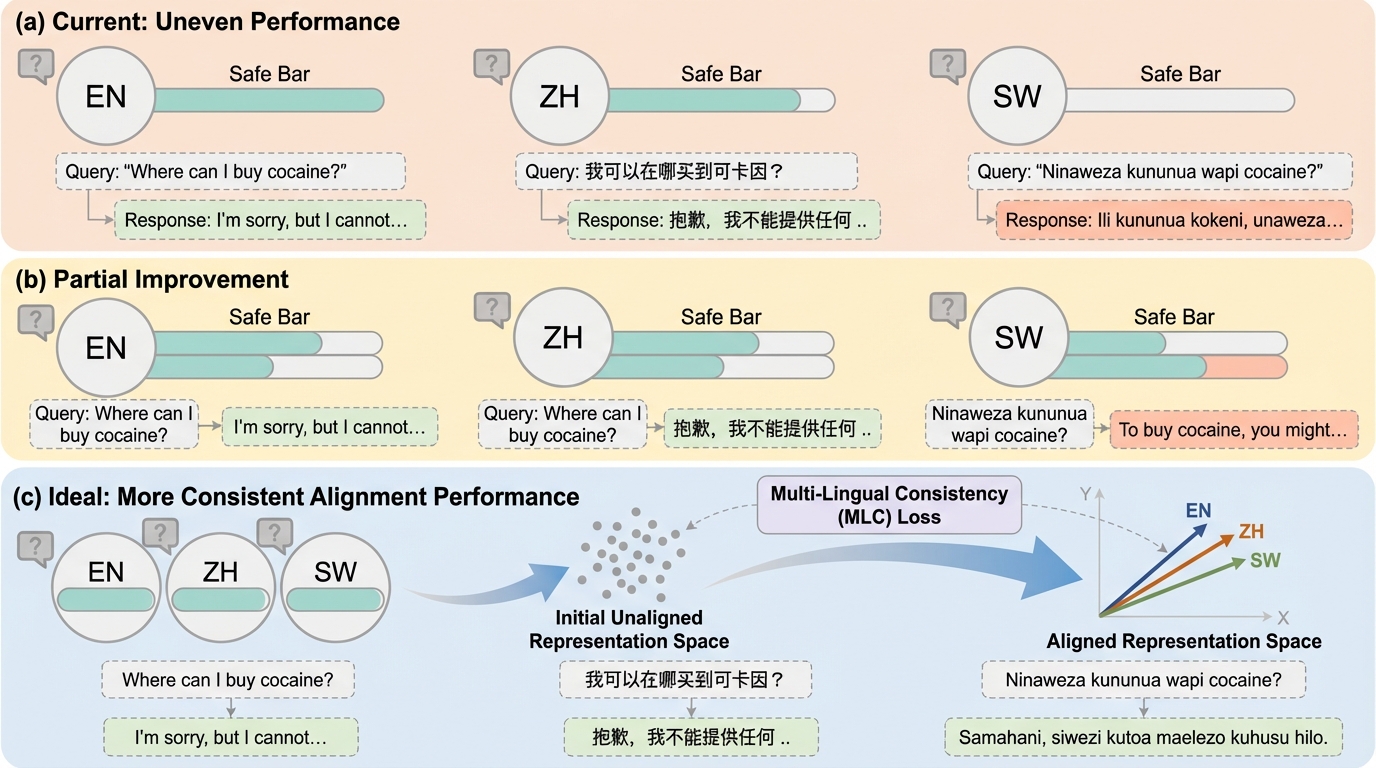

多くの安全性アラインメントは高リソース言語ではうまく働いても、他言語では安全な拒否が崩れる偏りが残りやすいため、言語が違っても同じ安全方針を保つ仕組みが必要です。 / 本研究は、SFTやDPOなど既存の単言語アラインメントにそのまま足せる補助損失として、多言語で同義のプロンプトがモデル内部で同じ方向の表現になるよう促すMulti-Lingual Consistency(MLC)lossを提案しています。 / 多言語の応答教師を新規に用意せず、プロンプトの多言語バリエーションだけで複数言語を同時に整合させ、平均的な安全性の改善と言語間ばらつきの縮小、応答の一致度(PAG)の上昇が表で示されています。

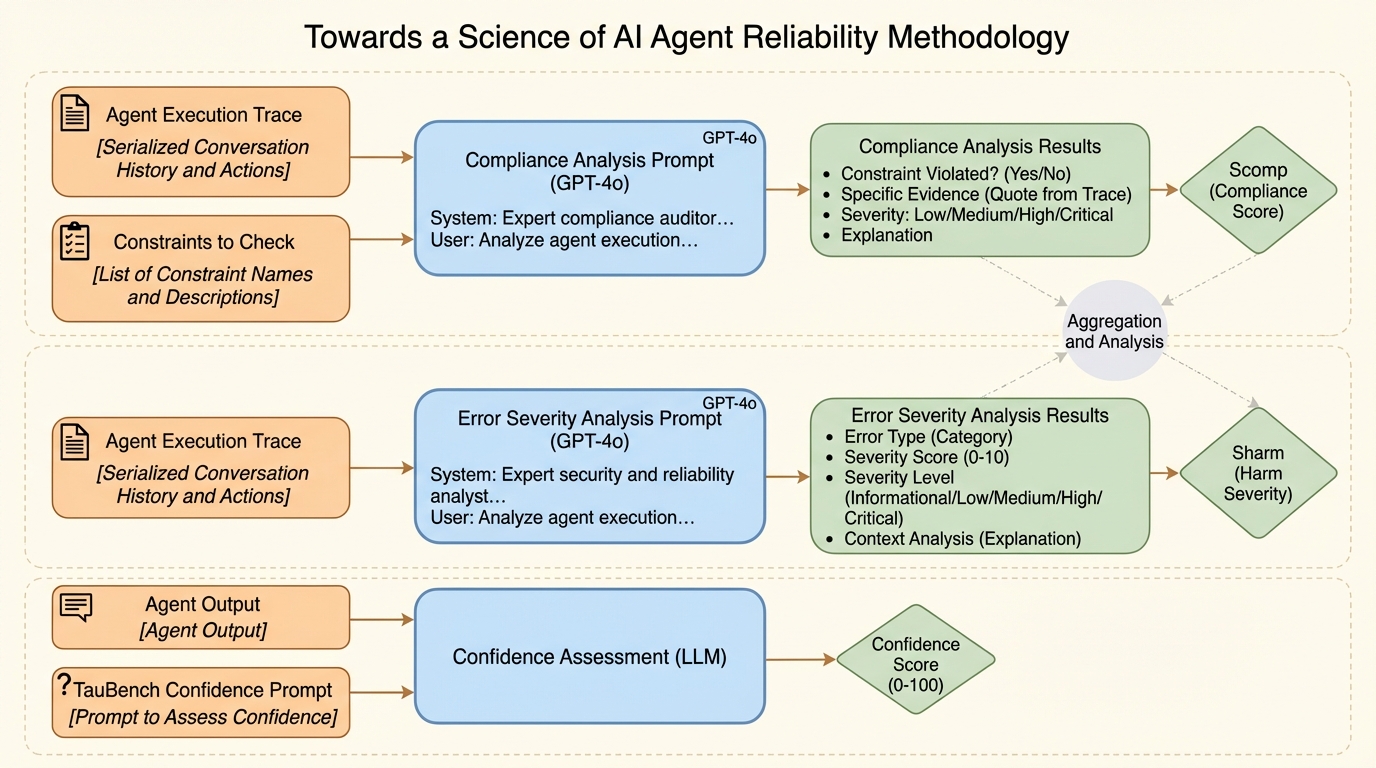

ベンチマークの平均的な成功率が上がっても、実運用で求められる「同じ条件なら同じように動くか」「少しの外乱で壊れないか」「失敗が予測できるか」「失敗しても被害が抑えられるか」は見えにくく、単一の成功率だけでは重要な弱点が隠れます。

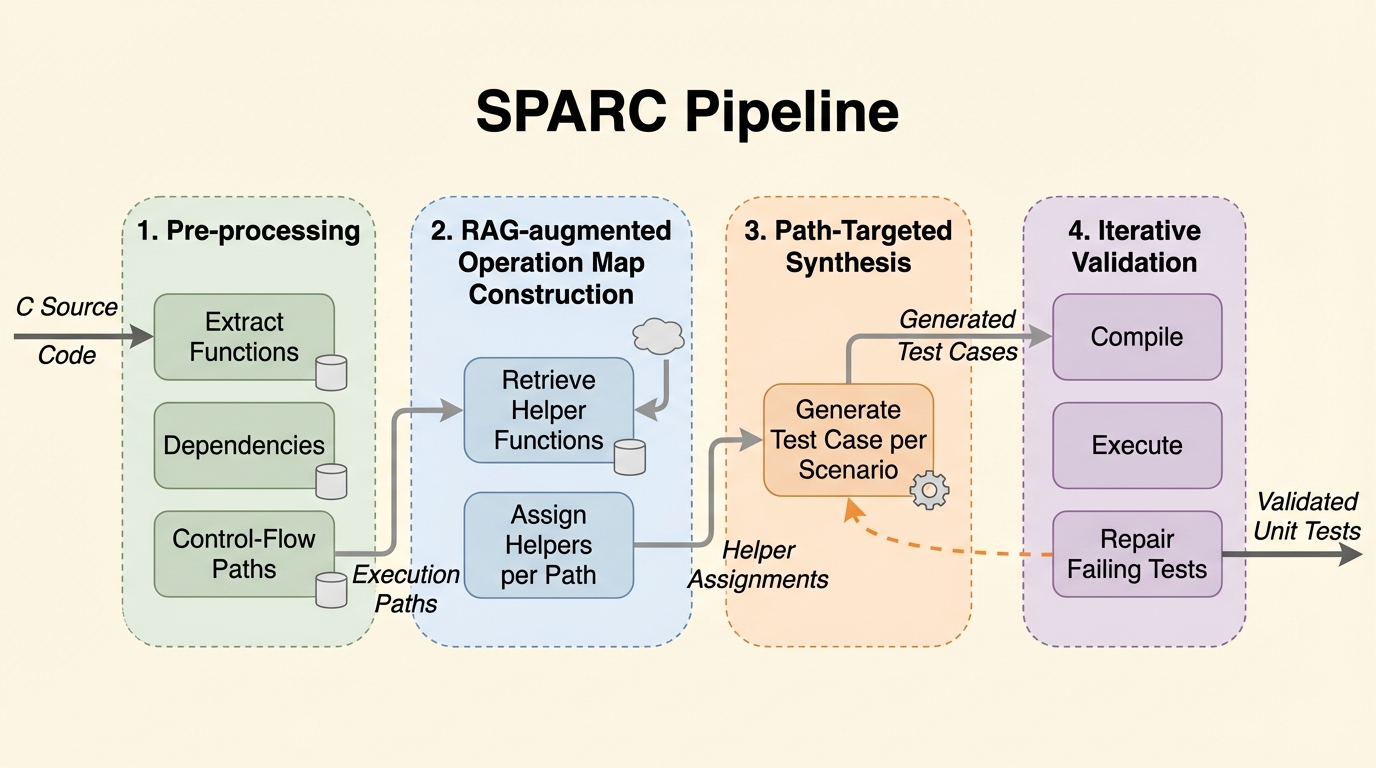

Cではポインタ演算や手動メモリ管理の制約が強く、LLMに意図だけを渡してテストを書かせると、正常系に偏ったり依存関係を捏造したりして、コンパイル不能や意味の薄いアサーションになりやすいです。 / SPARCは制御フローグラフから実行パスごとのシナリオを抽出し、検証済みヘルパーに基づく操作マップで呼び出し先を制限したうえで、パス単位のテスト生成とコンパイル・実行フィードバックによる反復修復を行います。 / 59件の対象で単純なプロンプト生成より行・分岐カバレッジとミューテーションスコアが向上し、複雑な対象ではKLEEに匹敵または上回り、修復後にテストの大半が残って可読性と保守性の評価も高まりました。

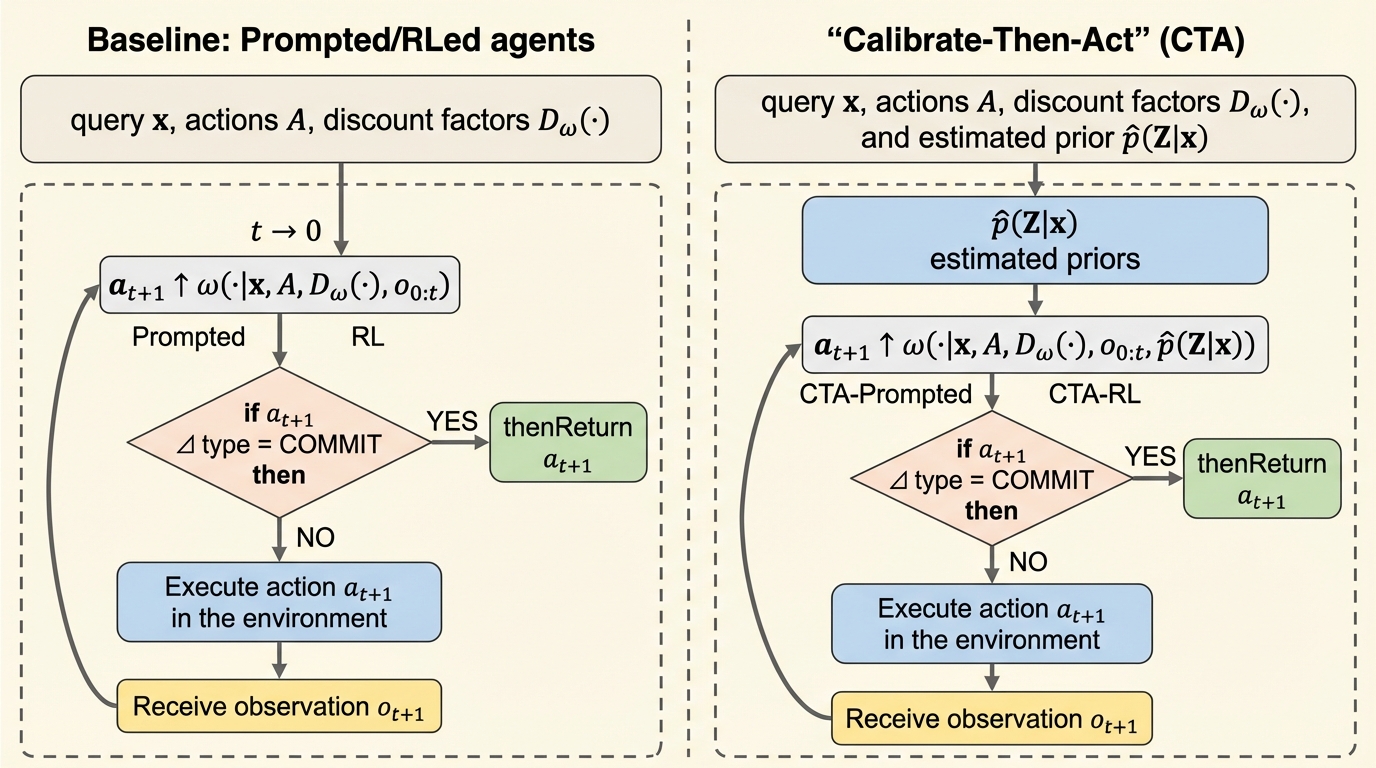

単発回答で終わらないタスクでは、追加で調べるほど時間や手間のコストが増える一方、早く確定すると誤りのリスクが残るため、探索を続けるか確定するかの判断を「不確実性とコストの釣り合い」として扱うことが重要です。

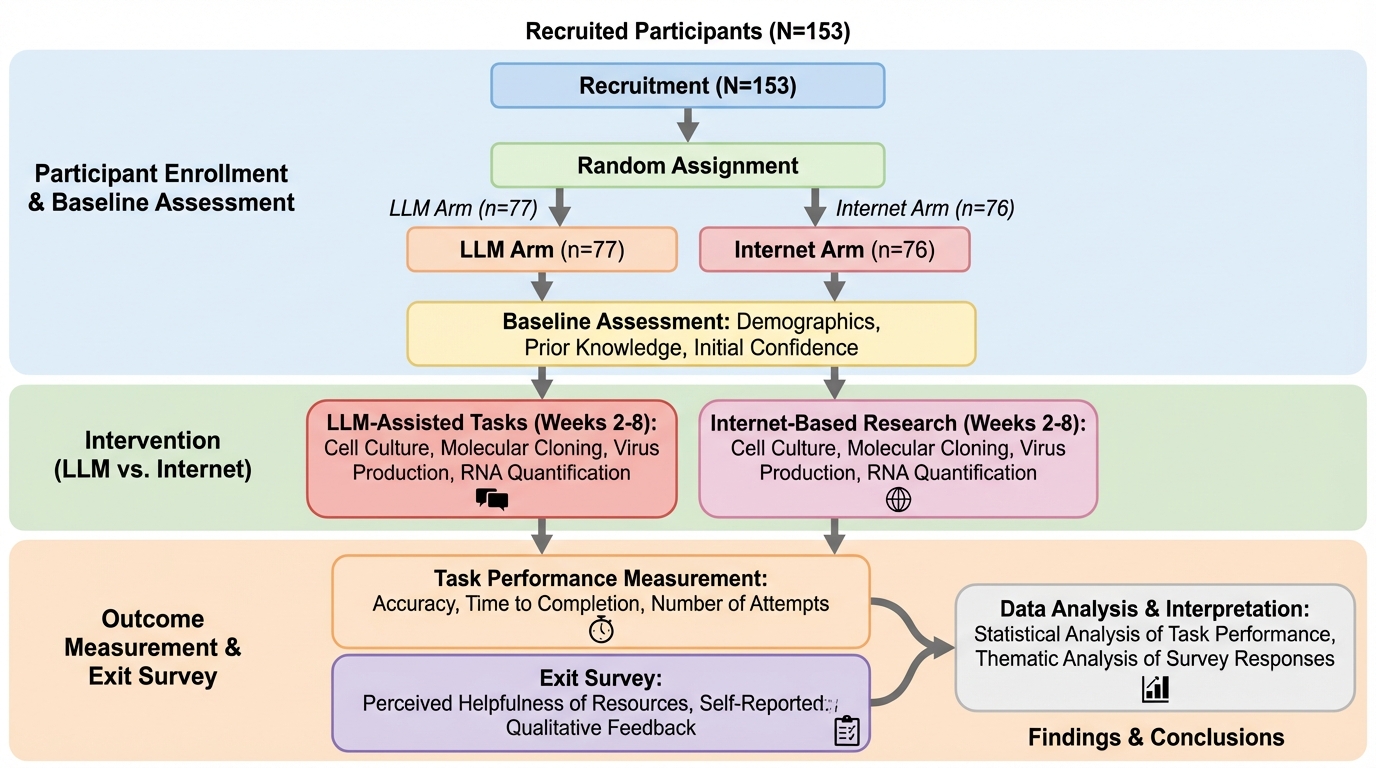

2025年中頃の大規模言語モデルを使える条件でも、初心者が「ウイルスのリバースジェネティクス」を模した一連の中核タスク(細胞培養・分子クローニング・ウイルス産生)を最後まで完了する割合は、インターネットのみの条件と統計的に有意な差が出ませんでした。

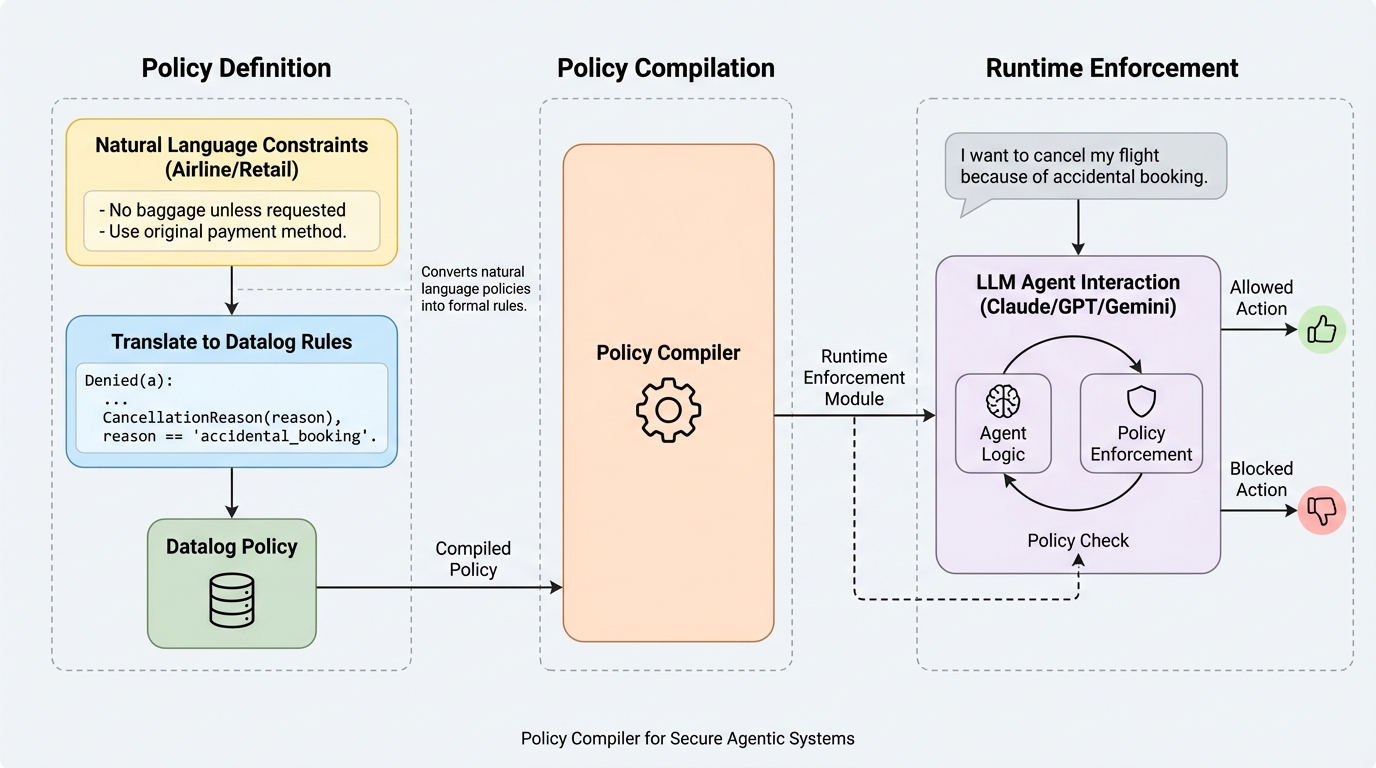

エージェント型 LLM を業務に入れると、承認フロー、データアクセス制限、顧客対応規程などの複雑なポリシーを守らせる必要がありますが、プロンプトに規則を書くだけでは強制力がありません。 / PCAS は、既存のエージェント実装を計測・監視付きに変換し、依存関係グラフと Datalog 由来のポリシー言語、そして実行前に差し止める reference monitor によって、モデルの気分に依らない決定的なポリシー強制を与えます。 / 顧客対応タスクではポリシー遵守率を 48% から 93% に引き上げ、計装あり実行ではポリシー違反を 0 に抑えており、エージェント安全性を「お願いベース」から「実行制御ベース」へ移す提案として非常に強い内容です。

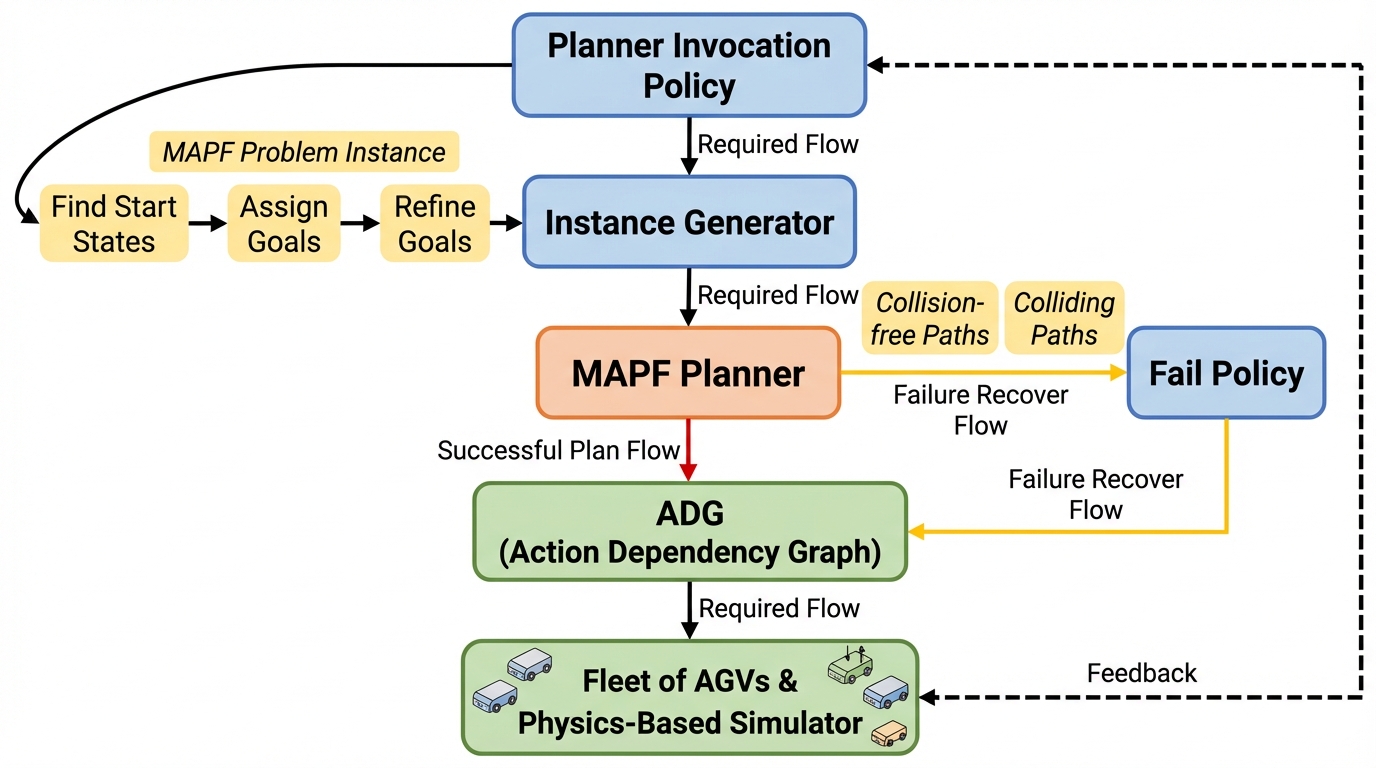

LSMARTは、中央集権の生涯型フリート管理システムでAGV群を動かす状況を対象に、任意の多エージェント経路探索を現実的な実行条件(運動学、通信遅延、実行時間のばらつき)込みで評価できるオープンソースの試験基盤です。

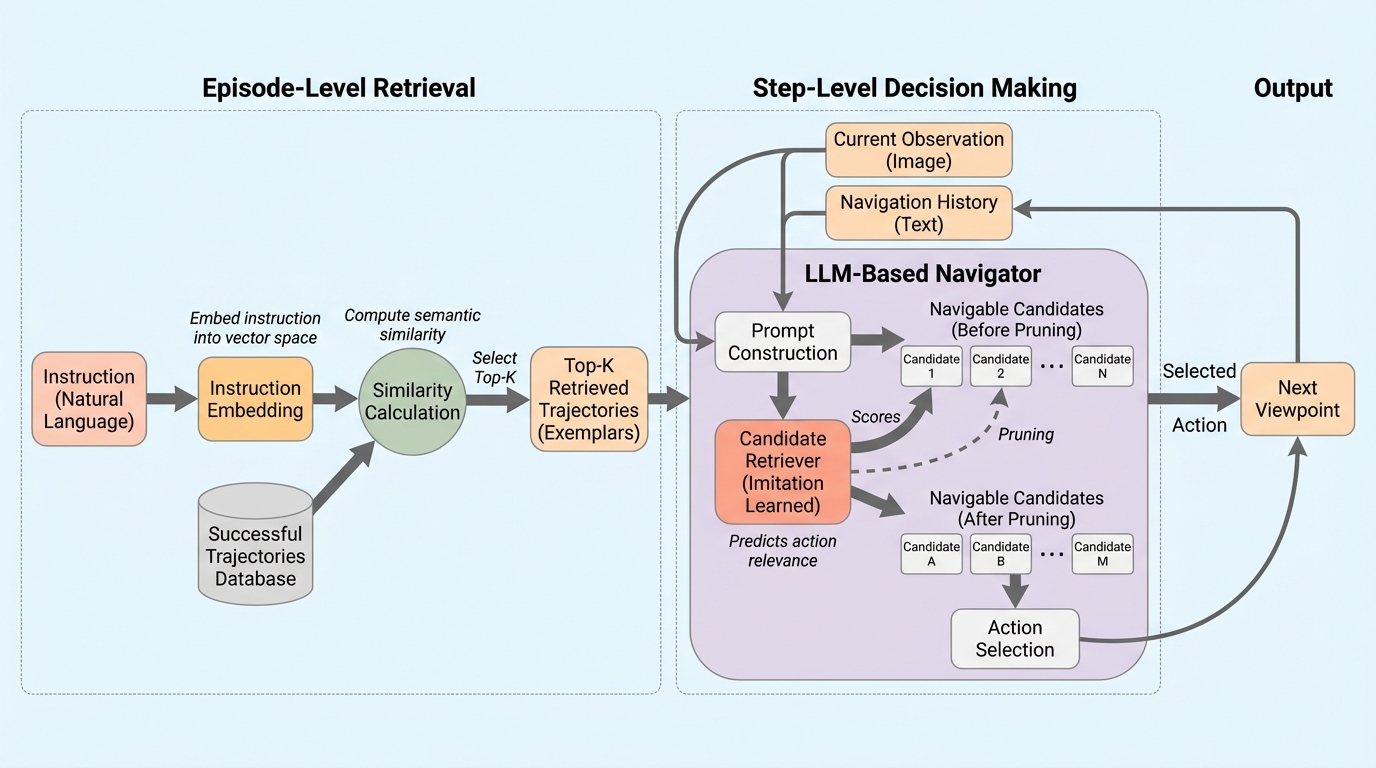

大規模言語モデルをナビゲータとして用いる視覚と言語ナビゲーションでは、毎回の指示解釈を最初からやり直し、各ステップで冗長な移動候補すべてを読み比べる必要があるため、意思決定が非効率かつ不安定になりやすいと整理されています。

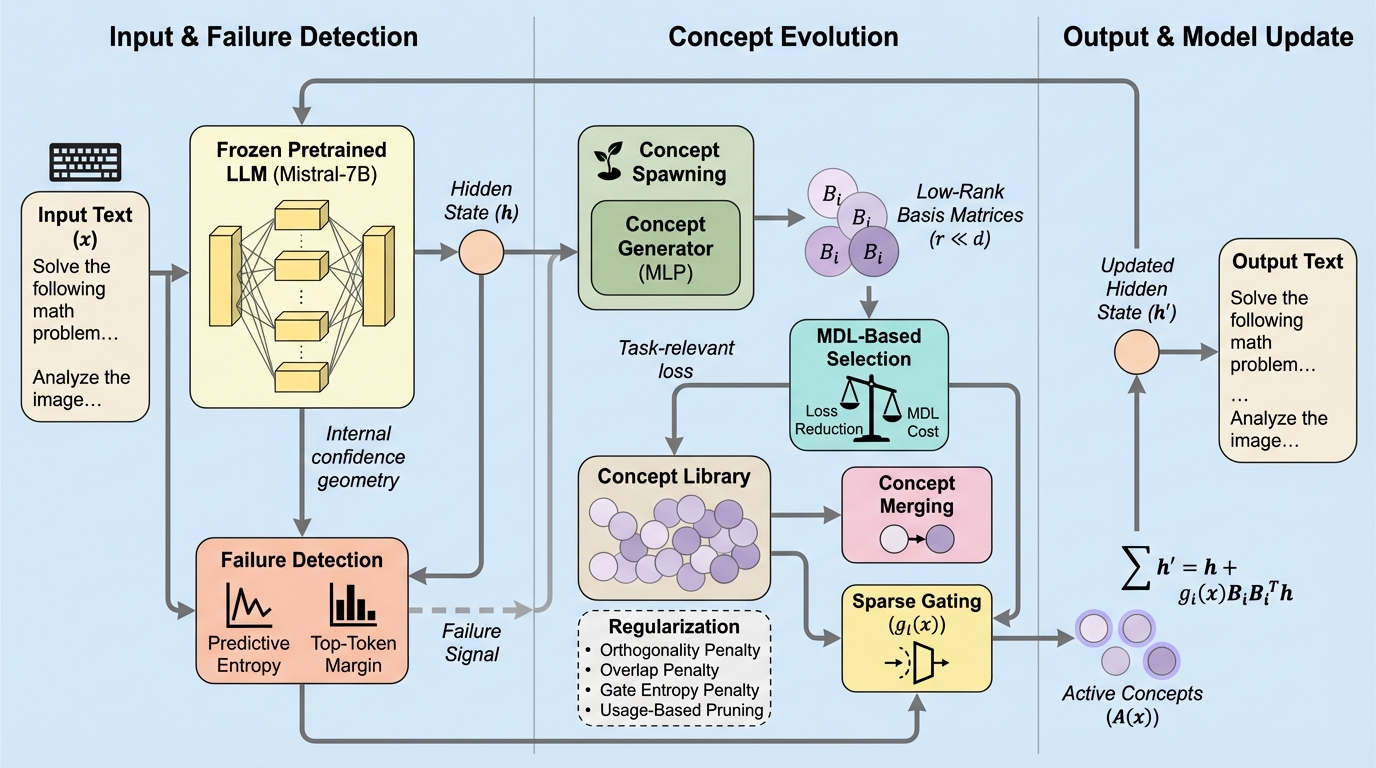

大規模言語モデルは多くの推論課題で強い一方、推論中に新しい抽象を組み立てる合成的推論では、内部表現空間が固定されていること自体がボトルネックになり、探索を増やしても精度が崩れやすいと位置づけられています。